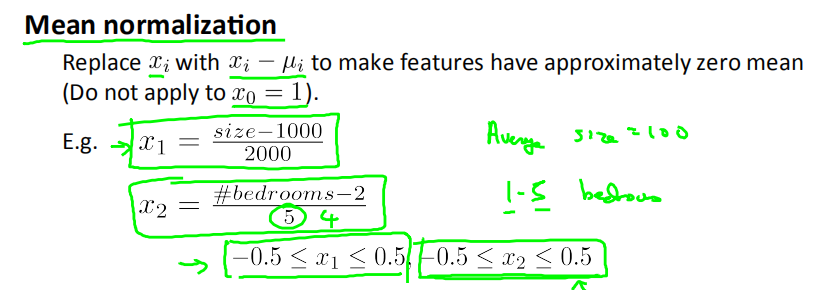

1.Mean normalization(均值归一化)

我们可以将均值归一化理解为特征缩放的另一种方法。

特征缩放和均值归一化的作用都是为了减小样本数据的波动使得梯度下降能够更快速的寻找到一条‘捷径’,从而到达全局最小值。因此,均值归一化则是先求得所有样本的均值u

从而通过如下两个例子公式或者其他公式:

[large x=frac{value - u}{max}

]

[large x=frac{value - u}{max-min}

]

使得样本数据在更小的范围内变化同样明显。在分母中,我们可以使用样本的max或者max-min,根据自身需求,选择最合适的归一化方法。

reference

https://www.jianshu.com/p/ef3534ddda15

两种归一化方法对比

https://www.cnblogs.com/wangqiang9/p/9285594.html

week2编程作业

reference

别人的代码

https://github.com/xiaovictor/Coursera-ML-using-matlab-python

别人的笔记

https://www.cnblogs.com/wangxin37/p/8297859.html