1.配置

1.1 建立复制

参与复制的Redis实例划分为主节点(master) 和从节点(slave)。默认情况下,Redis都是主节点。每个从节点只能有一个主节点,而主节点可以同时具有多个从节点。复制的数据流是单向的,只能由主节点复制到从节点。配置复制的方式有以下三种:

1) 在配置文件中加入slaveof {masterHost} {masterPort} 随 Redis启动生效。

2) 在 redis-server 启动命令后加入--slaveof {masterHost} {masterPort}生效。

3) 直接使用命令:slaveof {masterHost} {masterPort}生效。

综上所述,slaveof命令在使用时,可以运行期动态配置,也可以提前写到配置文件中。例如本地启动两个端口为6379和6380的 Redis 节点,在127.0.0.1:6380执行如下命令:

127.0.0.1:6380 >slaveof 127.0.0.1 6379

slaveof 配置都是在从节点发起,这时6379 作为主节点,6380作为从节点。复制关系建立后执行如下命令测试:

127.0.0.1:6379>set hello redis OK . 127.0.0.1:6379>get hello "redis" 127.0.0.1:6380>get hello "redis"

从运行结果中看到复制已经工作了,针对主节点6379的任何修改都可以同步到从节点6380中。

slaveof 本身是异步令,执行slaveof命令时,节点只保存主节点信息后返回,后续复制流程在节点内部异步执行。主从节点复制成功建立后,可以使用 info replication 命令查看复制相关状态,如下所示

1) 主节点6379复制状态信息:

127.0.0.1:6379>info replication # Replication role:master connected_slaves:1 slave0: ip=127.0 .0 .1,port=6379,state = online ,offset= 43 #lag=0 ....

2) 从节点6380复制状态信息:

127.0.0.1:6380>info replication # Replication role:slave master_host:127.0.0.1 master_port:6380 master_link_status:up master_last_io_seconds_ago:4 master_sync_in_progress:0

1.2 断开复制

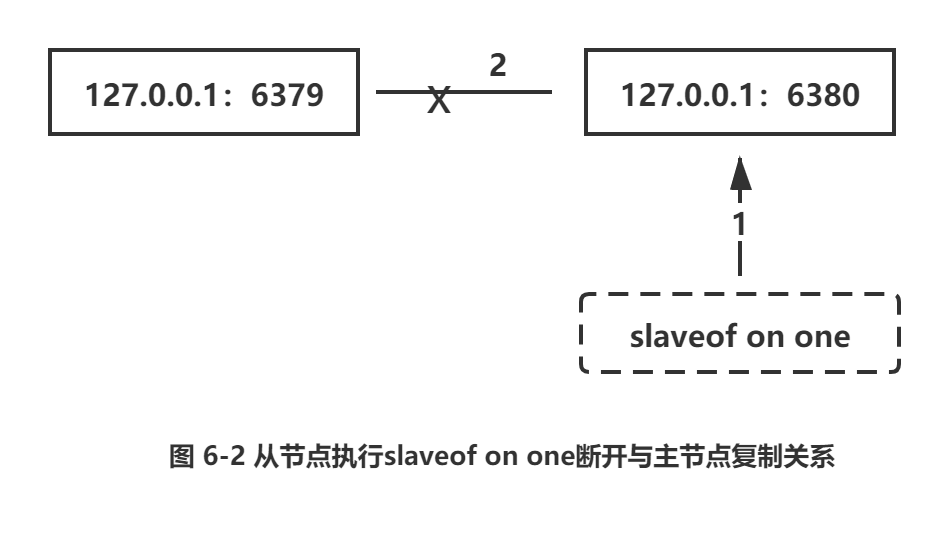

slaveof命令不但可以建立复制,还可以在从节点执行slaveof no one来断开与主节点复制关系。例如在6380节点上执行slaveof no one来断开复制。

断开复制主要流程:

1) 断开与主节点复制关系。

2) 从节点晋升为主节点。

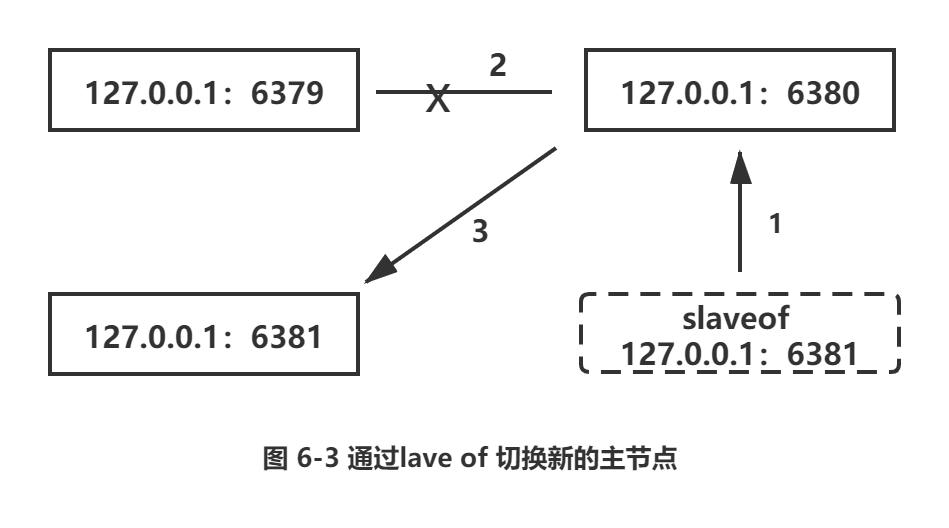

从节点断开复制后并不会抛弃原有数据,只是无法再获取主节点上的数据变化。通过slaveof命令还可以实现切主操作,所谓切主是指把当前从节点对主节点的复制切换到另一个主节点。执行slaveof {newMasterlp} {newMasterPort}命令即可,例如把6380节点从原来的复制6379节点变为复制6381节点,如图6-3所示。

切主操作流程如下:

1) 断开与旧主节点复制关系。

2) 与新主节点建复制关系。

3) 删除从节点当前所有数据。

4) 对新主节点进行复制操作。

切主后从节点会清空之前所有的数据,线上人工操作时小心slaveof在错误的节点上执行或者指向错误的主节点。

1.3 安全性

对于数据比较重要的节点,主节点会通过设置requirepass参数进行密码验证,这时所有的客户端访问必须使用auth命令实行校验。从节点与主节点的复制连接是通过一个特殊标识的客户端来完成,因此需要配置从节点的masterauth参数与主节点密码保持一致,这样从节点才可以正确地连接到主节点并发起复制流程。

1.4 只读

默认情况下,从节点使用slave-read-only=yes配置为只读模式。由于复制只能从主节点到从节点,对于从节点的任何修改主节点都无法感知,修改从节点会造成主从数据不一致。因此建议线上不要修改从节点的只读模式。

1.5 传输延迟

主从节点一般部署在不同机器上,复制时的网络延迟就成为需要考虑的问题,Redis为我们提供了repl-disable-tcp-nodelay 参数用于控制是否关闭 TCP_NODELAY, 默认关闭,说明如下:

□ 当关闭时,主节点产生的命令数据无论大小都会及时地发送给从节点,这样主从间延迟会变小,但增加了网络带宽的消耗。适用于主从之间的网络环境良好的场景,如同机架或同机房部署。

□ 当开启时,主节点会合并较小的TCP数据包从而节省带宽。默认发送时间间隔取决.于 Linux的内核,一般默认为40毫秒。这种配置节省了带宽但增大主从之间的延迟。适用于主从网络环境复杂或带宽紧张的场景,如跨机房部署。

部署主从节点时需要考虑网络延迟、带宽使用率、防灾级别等因素,如要求低延迟时,建议同机架或同机房部署并关闭 repl-disable-tcp-nodelay; 如果考虑高容灾性,可以同城跨机房部署并开启 repl-disable-tcp-nodelay。

1.6 拓扑

Redis的复制拓扑结构可以支持单层或多层复制关系,根据拓扑复杂性可以分为以下三种:一主一从、一主多从、树状主从结构,下面分别介绍。

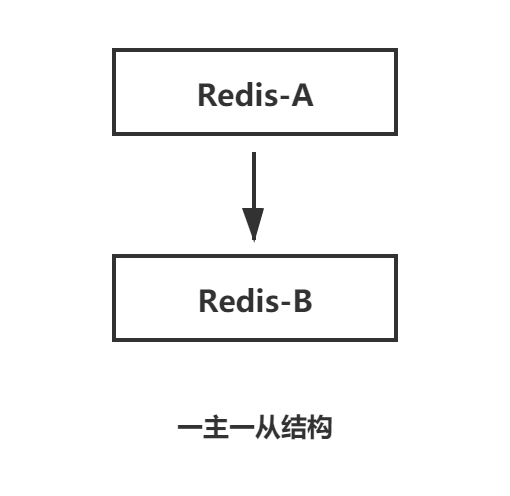

1.一主一从结构

一主一从结构是最简单的复制拓扑结构,用于主节点出现宕机时从节点提供故障转移支持。当应用写命令并发量较高且需要持久化时,可以只在从节点上开启AOF, 这样既保证数据安全性同时也避免了持久化对主节点的性能干扰。但需要注意的是,当主节点关闭持久化功能时,如果主节点脱机要避免自动重启操作。因为主节点之前没有开启持久化功能自动重启后数据集为空,这时从节点如果继续复制主节点会导致从节点数据也被清空的情况,丧失了持久化的意义。安全的做法是在从节点上执行 slaveof no one 断开与主节点的复制关系,再重启主节点从而避免这一问题。

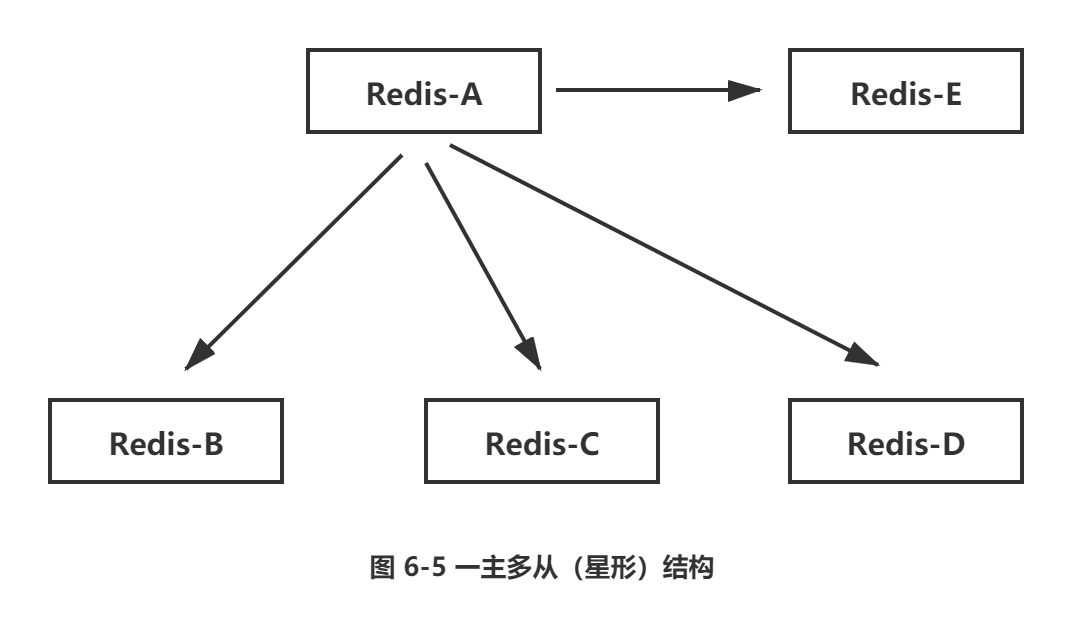

2.—主多从结构

一主多从结构(又称为星形拓扑结构)使得应用端可以利用多个从节点实现读写分离(见图6-5)。对于读占比较大的场景,可以把读命令发送到从节点来分担主节点压力。同时在日常开发中如果需要执行一些比较耗时的读命令,如:keys、sort等,可以在其中一台从节点上执行,防止慢查询对主节点造成阻塞从而影响线上服务的稳定性。对于写并发量较高的场景,多个从节点会导致主节点写命令的多次发送从而过度消耗网络带宽,同时也加重了主节点的负载影响服务稳定性。

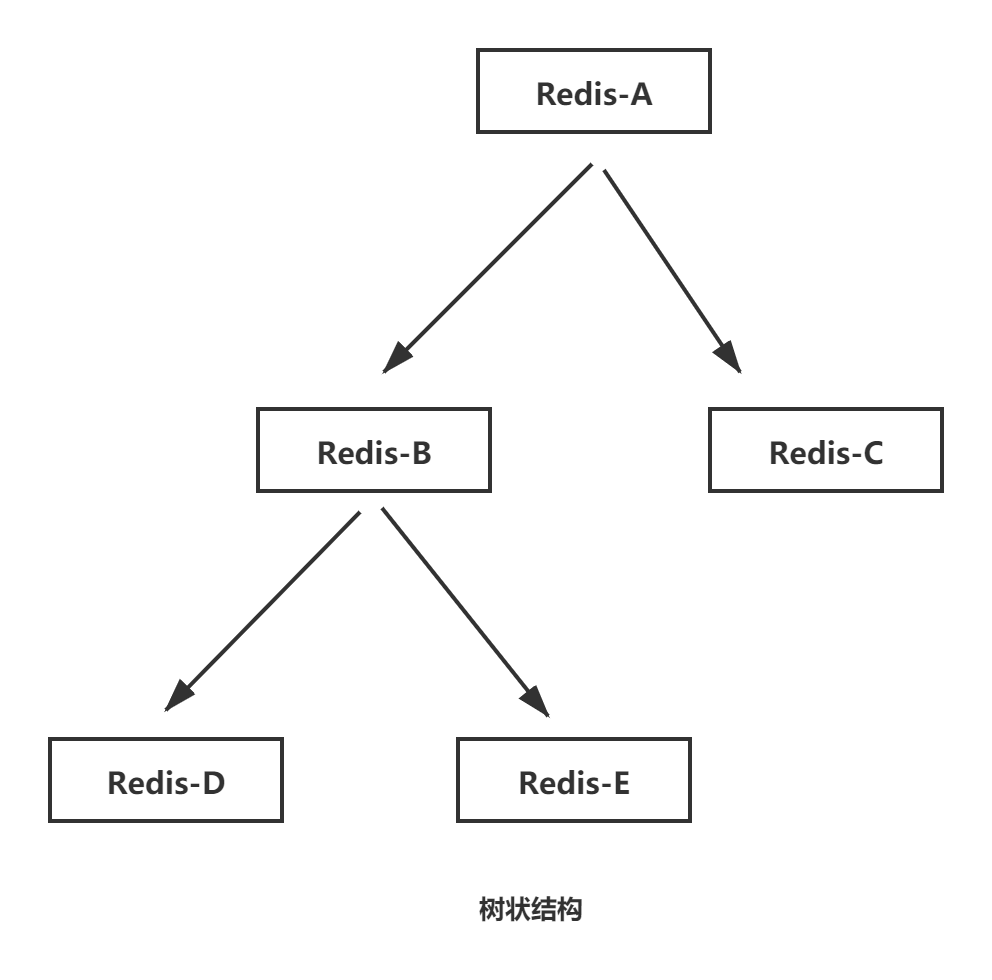

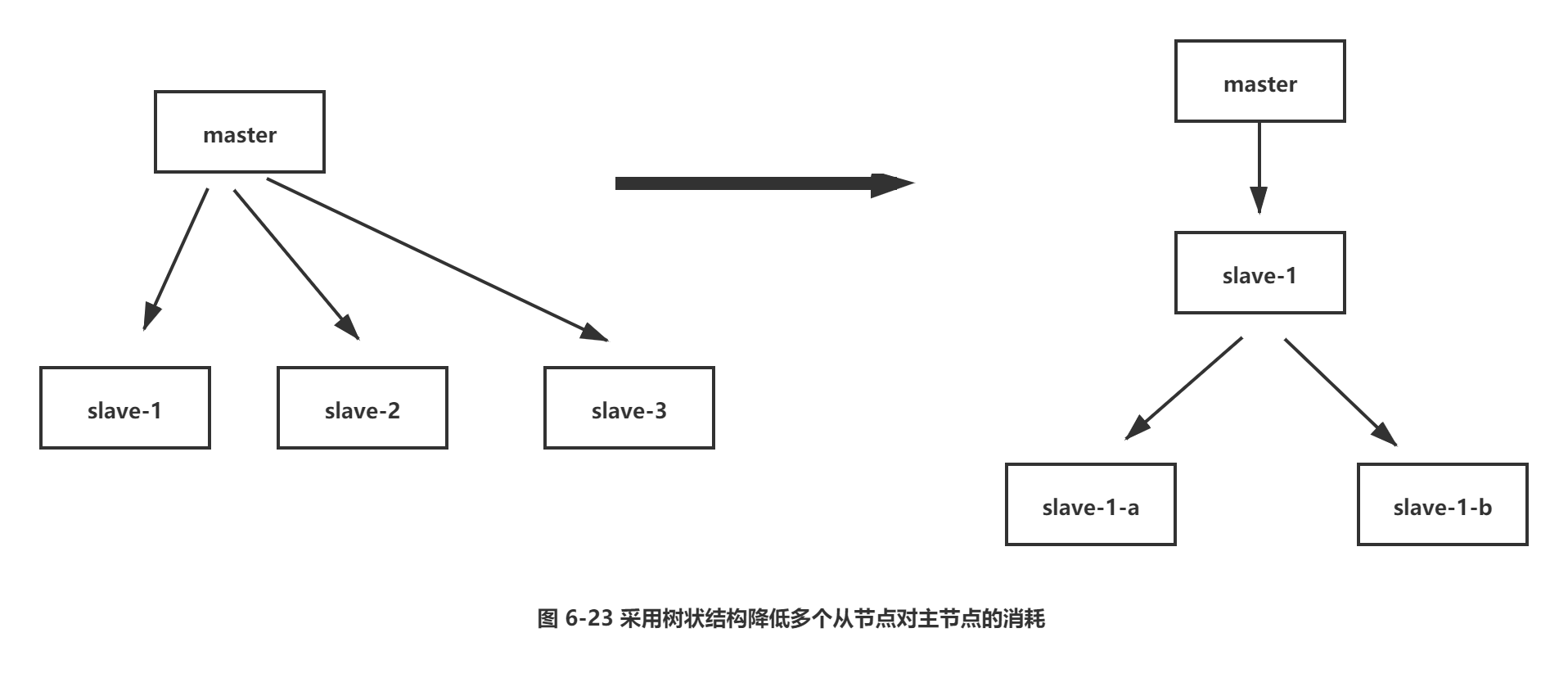

3.树状主从结构

树状主从结构(又称为树状拓扑结构)使得从节点不但可以复制主节点数据,同时可以作为其他从节点的主节点继续向下层复制。通过引入复制中间层,可以有效降低主节点负载和需要传送给从节点的数据量。如图所示,数据写入节点A后会同步到B和C节点,B节点再把数据同步到D和E节点,数据实现了一层一层的向下复制。当主节点需要挂载多个从节点时为了避免对主节点的性能干扰,可以采用树状主从结构降低主节点压力。

2.原理

2.1 复制过程

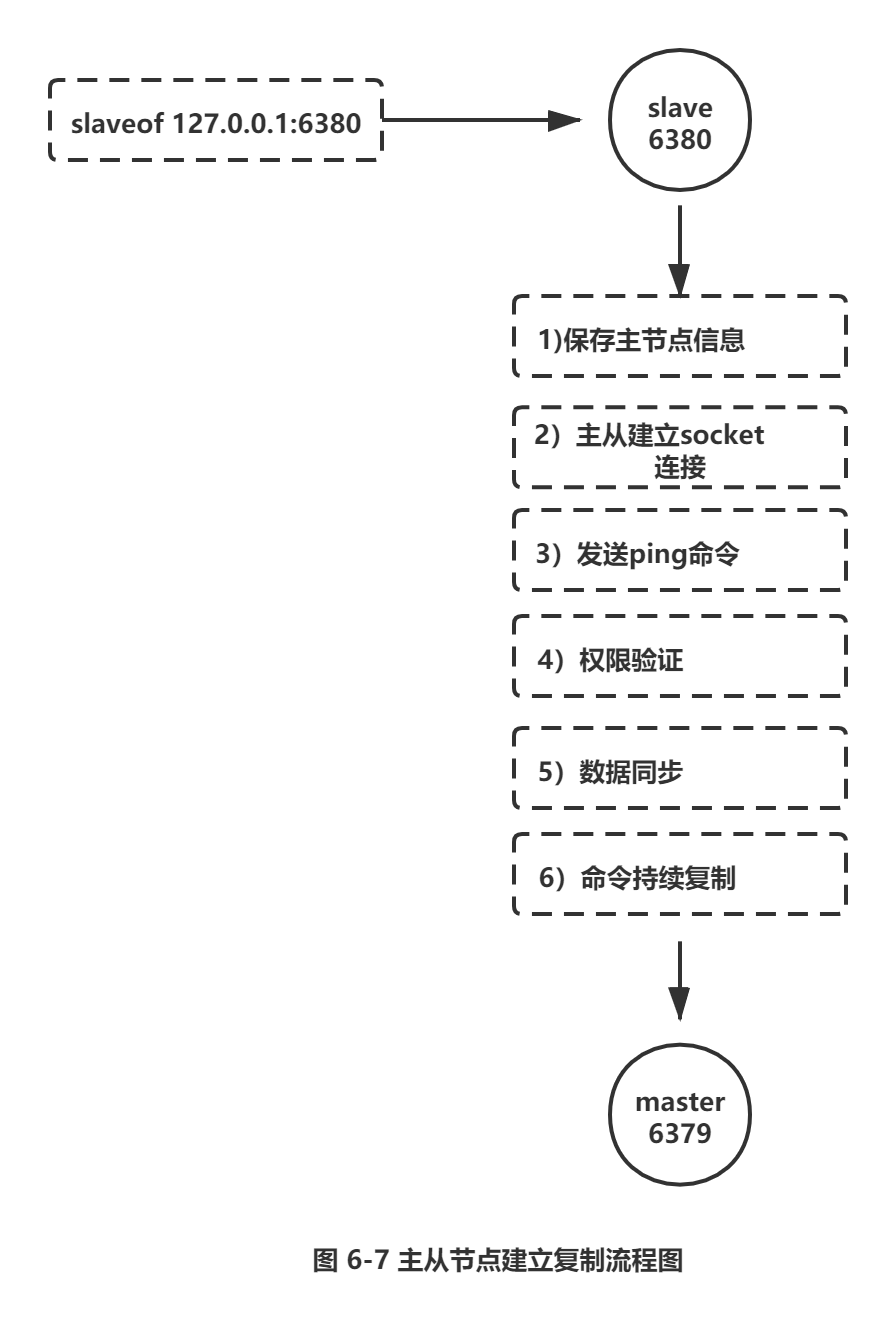

在从节点执行Slaveof命令后,复制过程便开始运作,下面详细介绍建立复制的完整流程,如图6-7所示。

从图中可以看出复制过程大致分为6个过程:

1) 保存主节点(master)信息。

执行slaveof后从节点只保存主节点的地址信息便直接返回,这时建立复制流程还没有开始,在从节点6380执行info replication可以看到如下信息:

master_host:127.0.0.1 master_port: 6379 master_link_status: down

从统计信息可以看出,主节点的ip和port被保存下来,但是主节点的连接状态(master_link_status)是下线状态。执行slaveof后Redis会打印如下日志:

SLAVE OF 127.0.0.1:6379 enabled (user request from 'id=65 addr=127.0.0.1:58090 fd=5 name= age = 11 idle=0 flags=N db=0 sub=0 psub=0 multi= -1 qbuf=0 qbuf-free= 32768 obl = 0 oll = 0 omem= 0 events=r cmd=slaveof')

通过该日志可以帮助运维人员定位发送slaveof命令的客户端,方便追踪和发现问题。

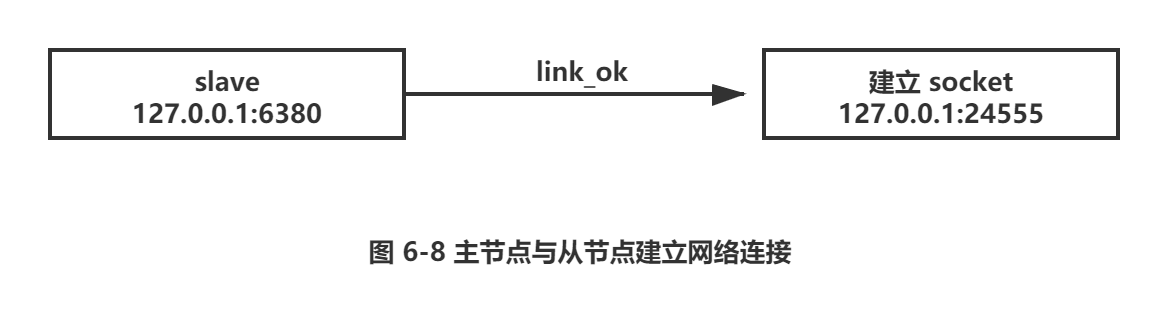

2) 从节点(slave) 内部通过每秒运行的定时任务维护复制相关逻辑,当定时任务发存在新的主节点后,会尝试与该节点建立网络连接,如图6-8所示。

从节点会建立一个socket套接字,例如图6-8中从节点建立了一个端口为24555的套接字,专门用于接受主节点发送的复制命令。从节点连接成功后打印如下日志:

* Connecting to MASTER 127.0.0.1:6379 * MASTER <-> SLAVE sync started

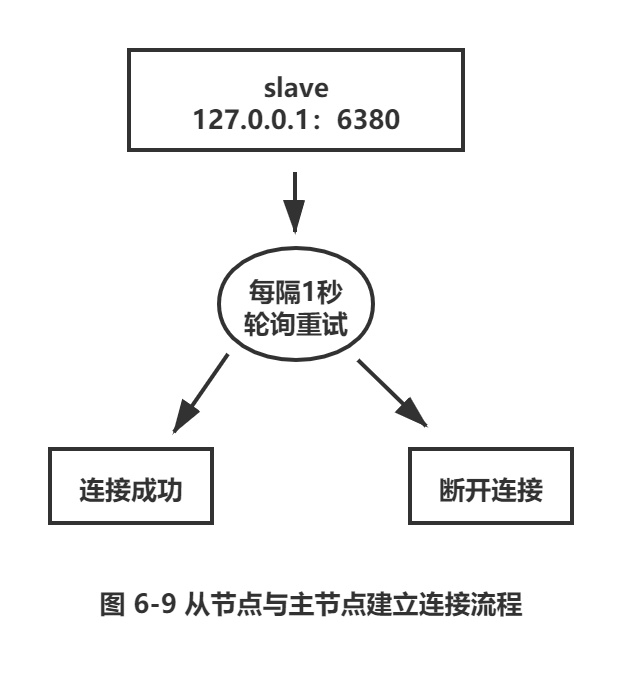

如果从节点无法建立连接,定时任务会无限重试直到连接成功或者执行slaveof no one取消复制,如图6-9所示。

关于连接失败,可以在从节点执行info replication査看master_link_down_since_seconds指标,它会记录与主节点连接失败的系统时间。从节点连接主节点失败时也会每秒打印如下日志,方便运维人员发现问题:

* Error condition on socket for SYNC: {socket_error_reason}

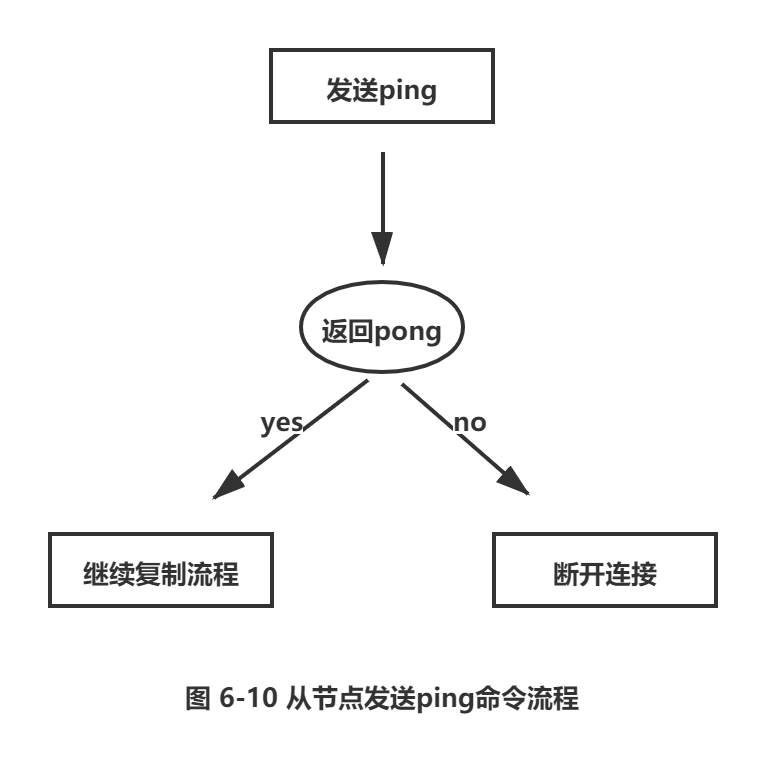

3) 发送ping命令

连接建立成功后从节点发送ping请求进行首次通信,ping请求主要目的如下:

□ 检测主从之间网络套接字是否可用。

□ 检测主节点当前是否可接受处理命令。

如果发送ping命令后,从节点没有收到主节点的pong回复或者超时,比如网络超时或者主节点正在阻塞无法响应命令,从节点会断开复制连接,下次定时任务会发起重连,如图 6-10所示。

从节点发送的Ping命令成功返回,Redis打印如下日志,并继续后续复制流程:

Master replied to PING, replication can continue...

4) 权限验证

如果主节点设置了 requirepass参数,则需要密码验证,从节点必须配置masterauth参数保证与主节点相同的密码才能通过验证;如果验证失败复制将终止,从节点重新发起复制流程。

5) 同步数据集

主从复制连接正常通信后,对于首次建立复制的场景,主节点会把持有的数据全部发送给从节点,这部分操作是耗时最长的步骤。Redis在 2.8版本以后采用新复制命令psync进行数据同步,原来的sync命令依然支持,保证新旧版本的兼容性。新版同步划分两种情况:全量同步和部分同步,下一节将重点介绍.

6) 命令持续复制

当主节点把当前的数据同步给从节点后,便完成了复制的建立流程。接下来主节点会持续地把写命令发送给从节点,保证主从数据一致性。

2.2 数据同步

Redis在2.8及以上版本使用psync命令完成主从数据同步,同步过程分为: 全量复制和部分复制。

□ 全量复制: 一般用于初次复制场景,Redis早期支持的复制功能只有全量复制,它会把主节点全部数据一次性发送给从节点,当数据量较大时,会对主从节点和网络造成很大的开销。

□ 部分复制:用于处理在主从复制中因网络闪断等原因造成的数据丢失场景,当从节点再次连上主节点后,如果条件允许,主节点会补发丢失数据给从节点。因为补发的数据远远小于全量数据,可以有效避免全量复制的过高开销。

部分复制是对老版复制的重大优化,有效避免了不必要的全量复制操作。因此当使用复制功能时,尽量采用2.8以上版本的Redis。

psync命令运行需要以下组件支持:

□ 主从节点各自复制偏移量。

□ 主节点复制积压缓冲区。

□ 主节点运行id。

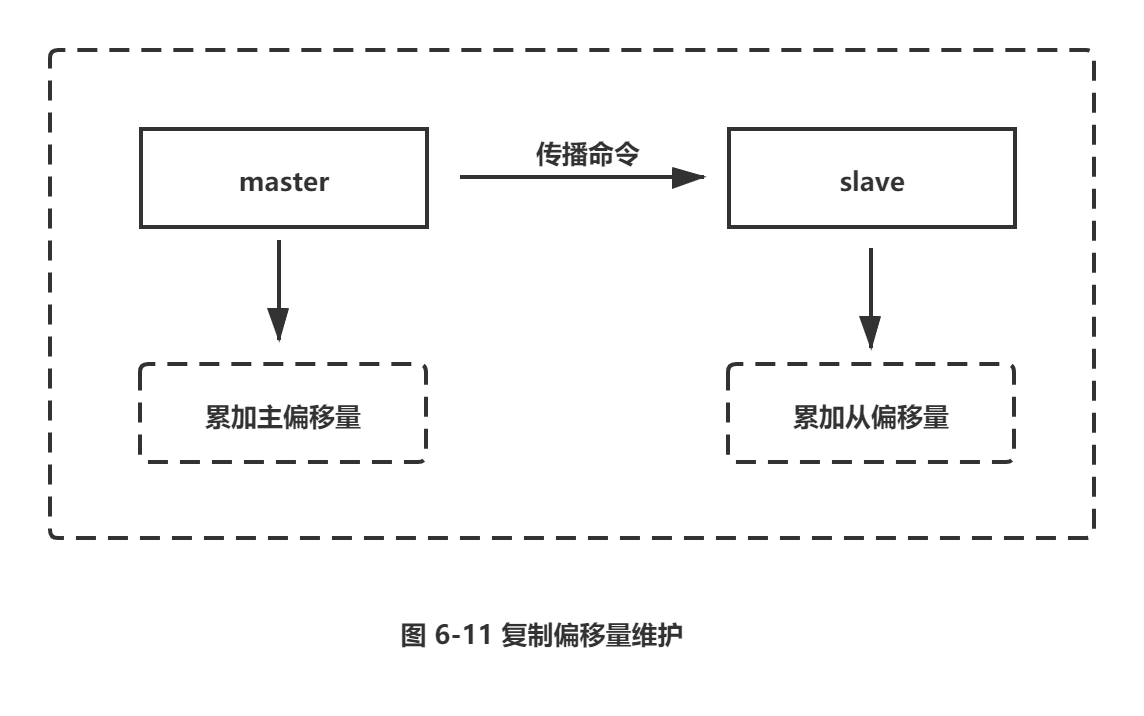

1.复制偏移量

参与复制的主从节点都会维护自身复制偏移量。主节点(master) 在处理完写人命令后,会把命令的字节长度做累加记录,统计信息在info relication中的master_repl_offset 指标中:

127.0.0.1:6379> info replication # Replication role:master master_repl_offset :1055130

从节点(slave) 每秒钟上报自身的复制偏移量给主节点,因此主节点也会保存从节点的复制偏移量,统计指标如下:

127.0.0.1:6379> info replication connected_slaves:1 slave0:ip=127.0.0.1,port=6380, state = online ,offset=1055214,lag = 1

从节点在接收到主节点发送的命令后,也会累加记录自身的偏移量。统计信息在 info relication 中的slave_repl_offset指标中:

127.0.0.1:6380> info replication # Replication role:slave slave_repl_offset :1055214

复制偏移量的维护如6-11所示。

通过对比主从节点的复制偏移量,可以判断主从节点数据是否一致。

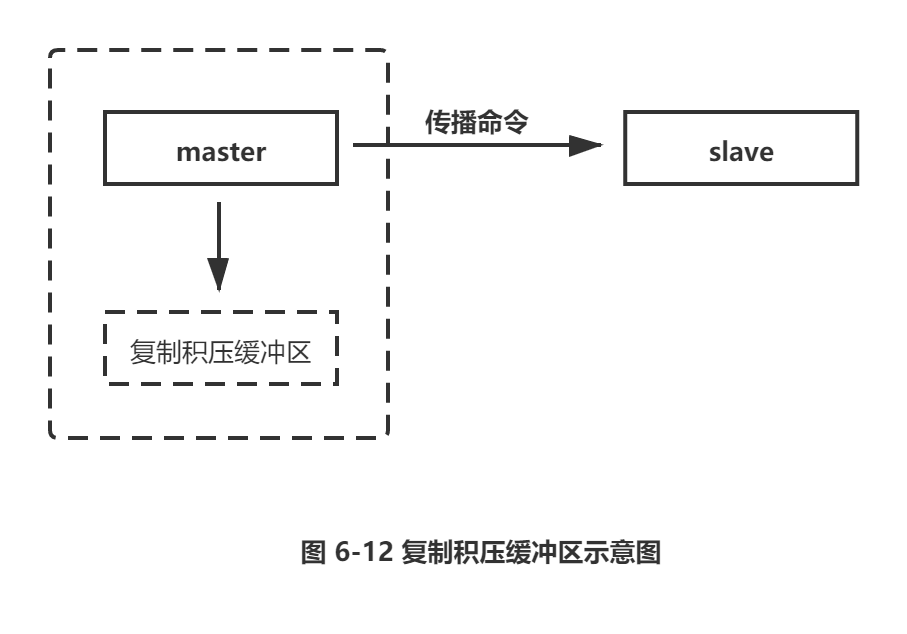

2.复制积压缓冲区

复制积压缓冲区是保存在主节点上的一个固定长度的队列,默认大小为1MB,当主节点有连接的从节点(slave) 时被创建,这时主节点(master) 响应写命令时,不但会把命令发送给从节点,还会写入复制积压缓冲区,如图6-12所示。

由于缓冲区本质上是先进先出的定长队列,所以能实现保存最近已复制数据的功能,用于部分复制和复制命令丢失的数据补救。复制缓冲区相关统计信息保存在主节点的info replication 中:

127.0.0.1:6379> info replication # Replication role:master repl_backlog_active:1 //开启复制缓冲区 repl_backlog_size: 1048576 //缓冲区最大长度 repl_backlog_first_byte_offset: 7479 //起始偏移量,计算当前缓冲区可用范围 repl_backlog_histlen: 1048576 //已保存数据的有效长度。 role:slave slave_repl_offset :1055214

根据统计指标,可算出复制积压缓冲区内的可用偏移量范围: [repl_backlog_first_byte_offset,repl_backlog_first_byte_offset+repl_backlog_histlen]

3.主节点运行ID

每个Redis节点启动后都会动态分配一个40位的十六进制字符串作为运行ID。运行 ID的主要作用是用来唯一识别Redis节点,比如从节点保存主节点的运行ID识别自己正在复制的是哪个主节点。如果只使用ip+port的方式识别主节点,那么主节点重启变更了整体数据集(如替换 RDB/AOF文件),从节点再基于偏移量复制数据将是不安全的,因此当运行 ID变化后从节点将做全量复制。可以运行 info server 命令查看当前节点的运行ID:

127.0.0.1:6379> info server # Server redis_version: 3.0.7 run_id:545f7c76183d0798a327591395bG30000ee6def9

需要注意的是 Redis 关闭再启动后,运行ID会随之改变,例如执行如下命令:

# redis-cli -p 6379 in fo server | grep run_id run_id:545f7c76183d0798a327591395b030000ee6def9 # redis-cli -p shutdown # redis-server redis-6379.conf # redis-cli -p 6379 info server I grep run_id run_id:2b2ec5f49f752f35c2b2da4d05775b5b3aaa57ca

如何在不改变运行ID的情况下重启呢?

当需要调优一些内存相关配置,例如:hash-max-ziplist-value等,这些配置需要 Redis 重新加载才能优化已存在的数据,这时可以使用 debug reload 命令重新加载RDB 并保持运行 ID 不变,从而有效避免不必要的全量复制。命令如下:

# redis-cli -p 6379 info server I grep run_id run_id:2b2ec5f49f752f35c2b2da4d05775b5b3aaa57ca # redis-cli debug reload OK # redis-cli -p 6379 info server I grep run_id run_id:2b2ec5f49f752f35c2b2da4d05775b5b3aaa57ca

debug reload命令会阻塞当前Redis节点主线程,阻塞期间会生成本地RDB快照并清空数据之后再加载RDB文件。因此对于大数据量的主节点和无法容忍阻塞的应用场景,谨慎使用。

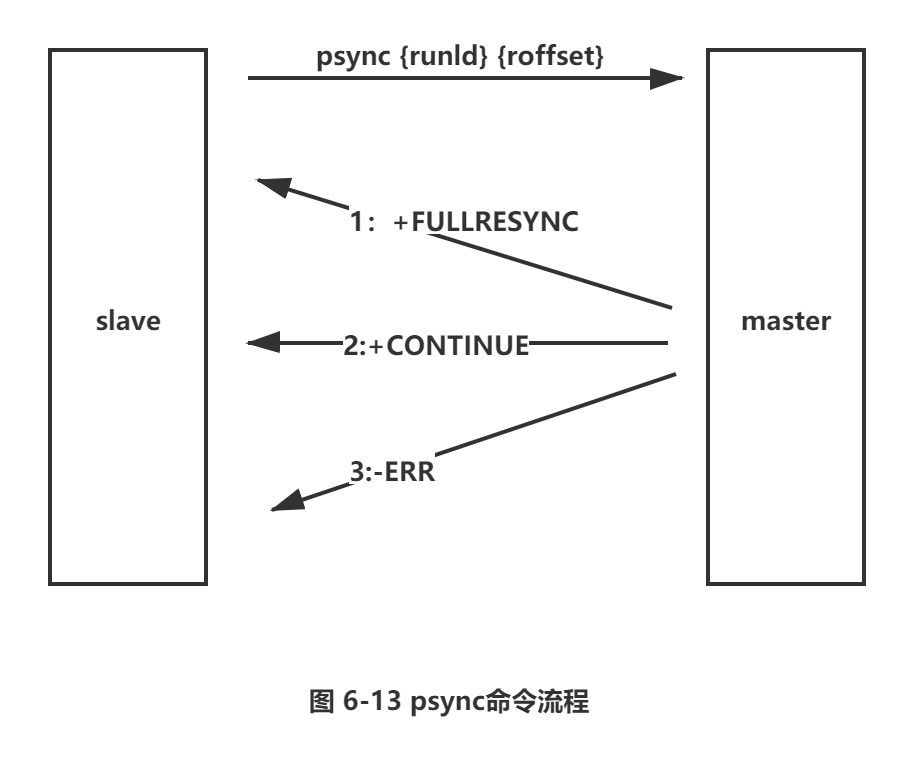

4.psync命令

从节点使用psync命令完成部分复制和全量复制功能,命令格式:psync {runld} {offset}, 参数含义如下:

□ runld: 从节点所复制主节点的运行id。

□ offset: 当前从节点已复制的数据偏移量。

psync命令运行流程如图6-13所示。

流程说明:

1) 从节点(slave) 发送psync命令给主节点,参数runld是当前从节点保存的主节点运行ID,如果没有则默认值为?,参数offset是当前从节点保存的复制偏移量,如果是第一次参与复制则默认值为-1。

2) 主节点(master) 根据psync参数和自身数据情况决定响应结果:

-

- 如果回复 +FULLRESYNC {runId}{offset},那么从节点将触发全量复制流程。

- 如果回复 +CONTINUE,从节点将触发部分复制流程。

- 如果回复 +ERR, 说明主节点版本低于Redis 2.8,无法识别psync命令,从节点将发送旧版的sync命令触发全量复制流程。

2.3 全量复制

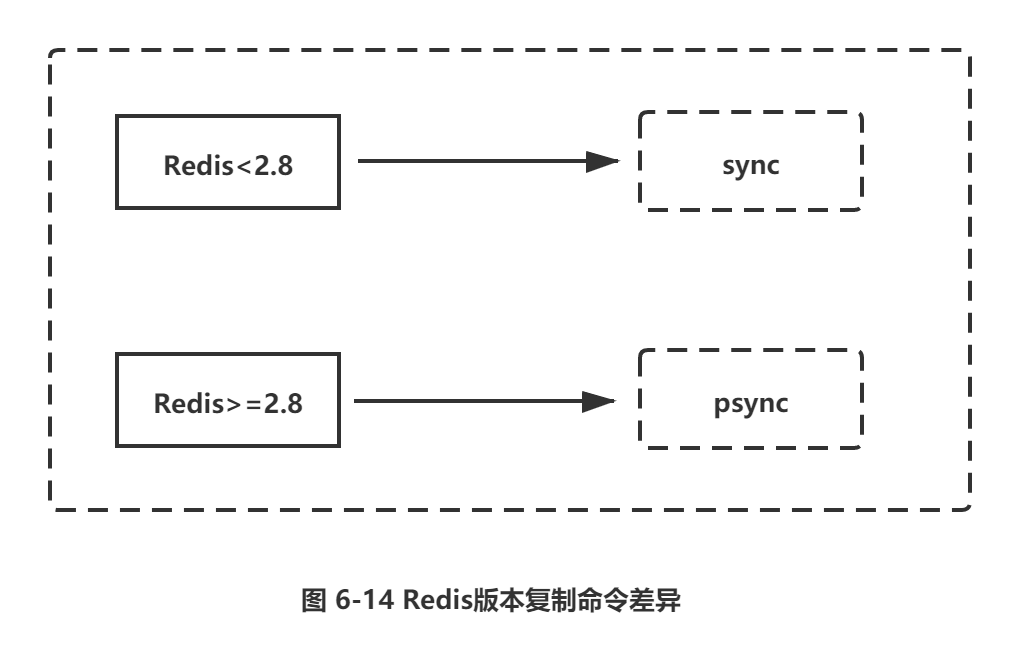

全量复制是Redis最早支持的复制方式,也是主从第一次建立复制时必须经历的阶段。触发全量复制的命令是sync和psync, 它们的对应版本如图6-14所示。

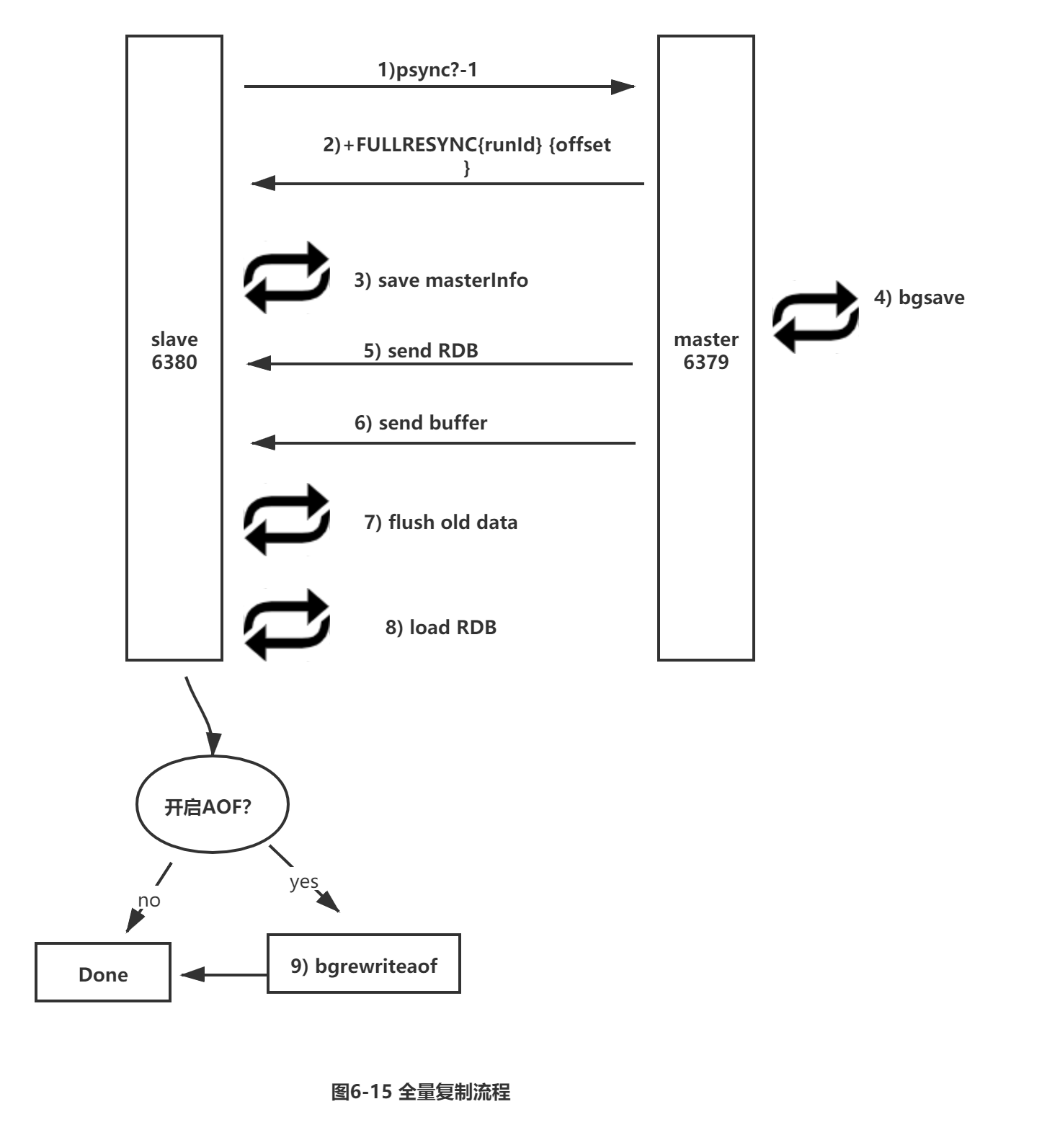

这里主要介绍psync全量复制流程,它与 2.8以前的sync全量复制机制基本一致。全量复制的完整运行流程如图6-15所示。

流程说明:

1) 发送psync命令进行数据同步,由于是第一次进行复制,从节点没有复制偏移量和主节点的运行所以发送psync ?-1。

2) 主节点根据 psync ?-1 解析出当前为全量复制,回复 +FULLRESYNC 响应0

3) 从节点接收主节点的响应数据保存运行ID和偏移量offset, 执行到当前步骤时从节点打印如下日志:

Partial resynchronization not possible (no cached master) Full resync from master : 92dlcbl4ff7ba97816216f7beb839efe036775b2:216789

4) 主节点执行bgsave保存RDB文件到本地,主节点bgsave相关日志如下:

M * Full resync requested by slave 127.0.0.1:6380 M * Starting BGSAVE for SYNC with target:disk C * Background saving started by pid 32618 C * RDB:0 MB of memory used by copy-on-write M * Background saving terminated with success

Redis3.0之后在输出的日志开头会有M、S、C 等标识,对应的含义是:M=当前为主节点曰志,S=当前为从节点曰志,C=子进程曰志,我们可以根据日志标识快速识别出每行日志的角色信息。

5) 主节点发送RDB文件给从节点,从节点把接收的RDB文件保存在本地并直接作为从节点的数据文件,接收完RDB后从节点打印相关日志,可以在日志中査看主节点发送的数据量:

16:24:03.057 * MASTER <-> SLAVE sync: receiving 24777842 bytes from master

需要注意,对于数据量较大的主节点,比如生成的RDB文件超过6GB以上时要格外小心。传输文件这一步操作非常耗时,速度取决于主从节点之间网络带宽,通过细致分析Full resync和MASTER <-> SLAVE这两行日志的时间差,可以算出RDB文件从创建到传输完毕消耗的总时间。如果总时间超过repl-timeout所配置的值(默认60秒),从节点将放弃接受RDB文件并清理已经下载的临时文件,导致全量复制失败,此时从节点打印如下日志:

M 27 May 12:10:31.169 # Timeout receiving bulk data from MASTER... If the problem persists try to set the 'repl-timeout' parameter in redis.conf to a larger value.

针对数据量较大的节点,建议调大repl-timeout参数防止出现全量同步数据超时。例如对于千兆网卡的机器,网卡带宽理论峰值大约每秒传输100MB,在不考虑其他进程消耗带宽的情况下,6GB的RDB文件至少需要60秒传输时间,默认配置下,极易出现主从数据同步超时。

关于无盘复制: 为了降低主节点磁盘开销,Redis支持无盘复制,生成的RDB文件不保存到硬盘而是直接通过网络发送给从节点,通过repl-diskless-sync参数控制,默认关闭。无盘复制适用于主节点所在机器磁盘性能较差但网络带宽较充裕的场景。注意无盘复制目前依然处于试验阶段,线上使用需要做好充分测试。

6) 对于从节点开始接收RDB快照到接收完成期间,主节点仍然响应读写命令,因此主节点会把这期间写命令数据保存在复制客户端缓冲区内,当从节点加载完RDB文件后,主节点再把缓冲区内的数据发送给从节点,保证主从之间数据一致性。如果主节点创建和传输RDB的时间过长,对于高流量写入场景非常容易造成主节点复制客户端缓冲区溢出。默认配置为 client-output-buffer-limit slave 256MB 64MB 60,如果 60 秒内缓冲区消耗持续大于64MB 或者直接超过256MB时,主节点将直接关闭复制客户端连接,造成全量同步失败。对应日志如下:

M 27 May 12:13:33.669 # Client id=2 addr=127.0.0.1: 24555 age=1 id le=1 flags=S qbuf=0 qbuf-free=0 obl=18824 oll=21382 omem=268442640 events=r cmd=psync scheduled to be closed ASAP for overcoming of output buffer limits .

因此,运维人员需要根据主节点数据量和写命令并发量调整client-output-buffer-limit slave 配置,避免全量复制期间客户端缓冲区溢出。

对于主节点,当发送完所有的数据后就认为全量复制完成,打印成功日志:Synchronization with slave 127.0.0.1:6380 succeeded,但是对于从节点全量复制依然没有完成,还有后续步骤需要处理。

7) 从节点接收完主节点传送来的全部数据后会清空自身旧数据,该步骤对应如下日志:

16:24:02.234 * MASTER <-> SLAVE sync: Flushing old data

8) 从节点清空数据后开始加载RDB文件,对于较大的RDB文件,这一步操作依然比较耗时,可以通过计算日志之间的时间差来判断加载RDB的总耗时,对应如下日志:

16:24:03.578 * MASTER <-> SLAVE sync: Loading DB in memory 16:24:06.756 * MASTER <-> SLAVE sync: Finished with success

对于线上做读写分离的场景,从节点也负责响应读命令。如果此时从节点正出于全量复制阶段或者复制中断,那么从节点在响应读命令可能拿到过期或错误的数据。对于这种场景,Redis复制提供了slave-serve-stale-data 参数,默认开启状态。如果开启则从节点依然响应所有命令。对于无法容忍不一致的应用场景可以设置no来关闭命令执行,此时从节点除了info和slaveof 命令之外所有的命令只返回“SYNC with master inprogress”信息。

9) 从节点成功加载完RDB后,如果当前节点开启了AOF持久化功能,它会立刻做bgrew riteaof操作,为了保证全量复制后AOF持久化文件立刻可用。

通过分析全量复制的所有流程,读者会发现全量复制是一个非常耗时费力的操作。它的时间开销主要包括:

□ 主节点 bgsave 时间。

□ RDB文件网络传输时间。

□ 从节点清空数据时间。

□ 从节点加载RDB的时间。

□ 可能的AOF重写时间。

例如我们线上数据量在6G左右的主节点,从节点发起全量复制的总耗时在2分钟左右。因此当数据量达到一定规模之后,由于全量复制过程中将进行多次持久化相关操作和网络数据传输,这期间会大量消耗主从节点所在服务器的CPU、内存和网络资源。所以除了第一次复制时采用全量复制在所难免之外,对于其他场景应该规避全量复制的发生。正因为全量复制的成本问题,Redis实现了部分复制功能。

2.4 部分复制

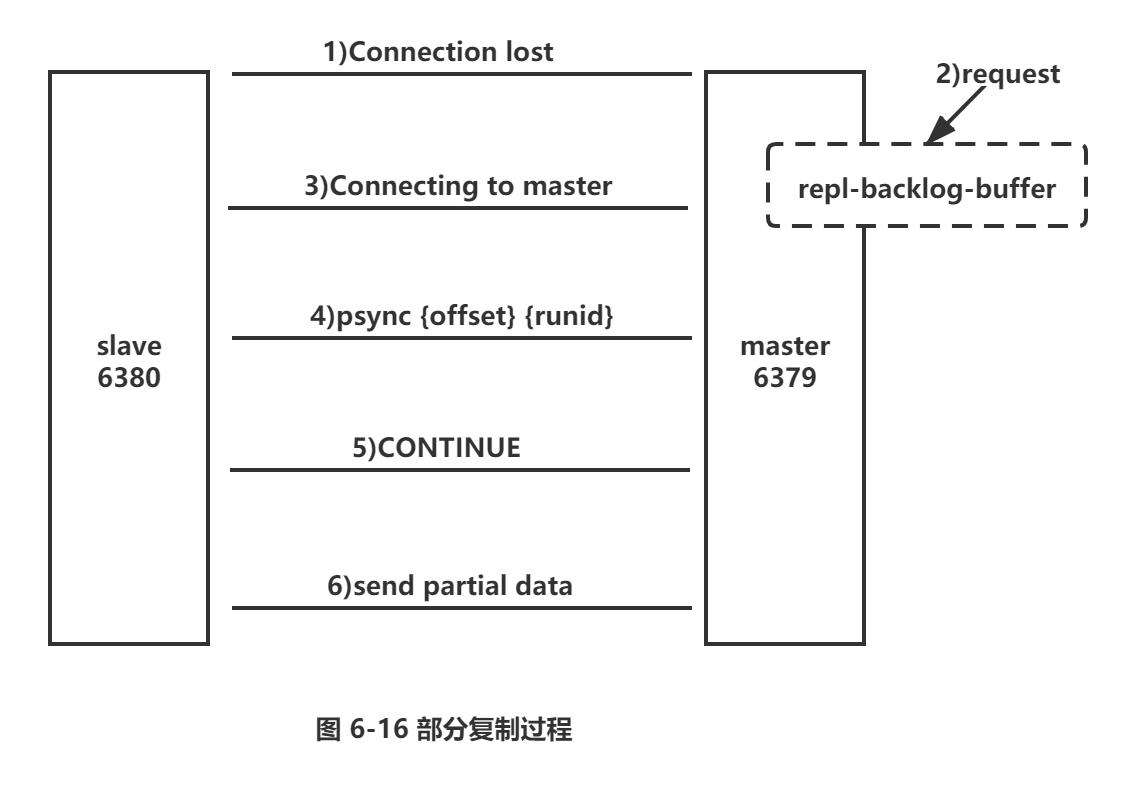

部分复制主要是Redis针对全量复制的过高开销做出的一种优化措施,使用psync {runld} {offset}命令实现。当从节点(slave) 正在复制主节点(master)时,如果出现网络闪断或者命令丢失等异常情况时,从节点会向主节点要求补发丢失的命令数据,如果主节点的复制积压缓冲区内存在这部分数据则直接发送给从节点,这样就可以保持主从节点复制的一致性。补发的这部分数据一般远远小于全量数据,所以开销很小。部分复制的流程如图6-16所示。

流程说明;

1) 当主从节点之间网络出现中断时,如果超过repl-timeout时间,主节点会认为从节点故障并中断复制连接,打印如下日志:

M # Disconnecting timedout slave:127.0.0.1:6380 M # Connection with slave 127.0.0.1:6380 lost .

如果此时从节点没有宕机,也会打印与主节点连接丢失日志:

S # Connection with master lost. S * Caching the disconnected master state.

2) 主从连接中断期间主节点依然响应命令,但因复制连接中断命令无法发送给从节点,不过主节点内部存在的复制积压缓冲区,依然可以保存最近一段时间的写命令数据,默认最大缓存1MB。

3) 当主从节点网络恢复后,从节点会再次连上主节点,打印如下日志:

S * Connecting to MASTER 127.0.0.1:6379 S * MASTER <-> SLAVE sync started S * Non blocking connect for SYNC fired the event. S * Master replied to PING, replication can continue...

4) 主从连接恢复后,由于从节点之前保存了自身已复制的偏移量和主节点的运行ID。因此会把它们当作psync参数发送给主节点,要求进行部分复制操作。该行为对应从节点日志如下:

S * Trying a partial resynchronization (request 2b2ec5f49f752f35c2b2da4d05775b5b3aaa57ca:49768480).

5) 主节点接到psync命令后首先核对参数runid是否与自身一致,如果一致,说明之前复制的是当前主节点;之后根据参数offset在自身复制积压缓冲区查找,如果偏移量之后的数据存在缓冲区中,则对从节点发送+C0NTINUE响应,表示可以进行部分复制。从节点接到回复后打印如下日志:

S * Successful partial resynchronization with master.

S * MASTER <-> SLAVE sync:Master accepted a Partial Resynchronization.

6) 主节点根据偏移量把复制积压缓冲区里的数据发送给从节点,保证主从复制进入正常状态。发送的数据量可以在主节点的日志获取,如下所示:

M * Slave 127.0.0.1:6380 asks for synchronization M * Partial resynchronization request from 127.0.0.1:6380 accepted. Sending 78 bytes of backlog starting from offset 49769216.

从日志中可以发现这次部分复制只同步了78字节,传递的数据远远小于全量数据。

2.5 心跳

主从节点在建立复制后,它们之间维护着长连接并彼此发送心跳命令。

主从心跳判断机制:

1) 主从节点彼此都有心跳检测机制,各自模拟成对方的客户端进行通信,通过client list命令查看复制相关客户端信息,主节点的连接状态为 flags=M, 从节点连接状态为flags=S。

2) 主节点默认每隔10秒对从节点发送Ping命令,判断从节点的存活性和连接状态。可通过参数repl-ping-slave-period控制发送频率。

3) 从节点在主线程中每隔1秒发送replconf ack {offset}命令,给主节点上报自身当前的复制偏移量。replconf命令主要作用如下:

-

- 实时监测主从节点网络状态。

- 上报自身复制偏移量,检查复制数据是否丢失,如果从节点数据丢失,再从主节点的复制缓冲区中拉取丢失数据。

- 实现保证从节点的数量和延迟性功能,通过min-slaves-to-write、min-slaves-max-lag参数配置定义。

主节点根据replconf命令判断从节点超时时间,体现在info replication统计中的 lag信息中,lag表示与从节点最后一次通信延迟的秒数,正常延迟应该在0 和 1之间。如果超过repl-timeout配置的值(默认60秒),则判定从节点下线并断开复制客户端连接。即使主节点判定从节点下线后,如果从节点重新恢复,心跳检测会继续进行。

2.6 异步复制

主节点不但负责数据读写,还负责把写命令同步给从节点。写命令的发送过程是异步完成,也就是说主节点自身处理完写命令后直接返回给客户端,并不等待从节点复制完成。

主节点复制流程:

1) 主节点6379接收处理命令。

2) 命令处理完之后返回响应结果。

3) 对于修改命令异步发送给6380从节点,从节点在主线程中执行复制的命令。

由于主从复制过程是异步的,就会造成从节点的数据相对主节点存在延迟。具体延迟多少字节,我们可以在主节点执行info replication命令查看相关指标获得。如下:

slave0:ip=127.0.0.1,port=6380,state=online,offset=841,lag=1

master_repl_offset:841

在统计信息中可以看到从节点slaveO信息,分别记录了从节点的ip和 port, 从节点的状态,offset表示当前从节点的复制偏移量,master_repl_offset表示当前主节点的复制偏移量,两者的差值就是当前从节点复制延迟量。Redis的复制速度取决于主从之间网络环境,repl-disable-tcp-nodelay,命令处理速度等。正常情况下,延迟在1秒以内。

3.开发与运维中的问题

理解了复制原理之后,本节我们重点分析基于复制的应用场景。通过复制机制,数据集可以存在多个副本(从节点)。这些副本可以应用于读写分离、故障转移(failover)、实时备份等场景。但是在实际应用复制功能时,依然有一些坑需要跳过。

3.1 读写分离

对于读占比较高的场景,可以通过把一部分读流量分摊到从节点(slave) 来减轻主节点(master)压力,同时需要注意永远只对主节点执行写操作。

当使用从节点响应读请求时,业务端可能会遇到如下问题:

□ 复制数据延迟。

□ 读到过期数据。

□ 从节点故障。

1.数据延迟

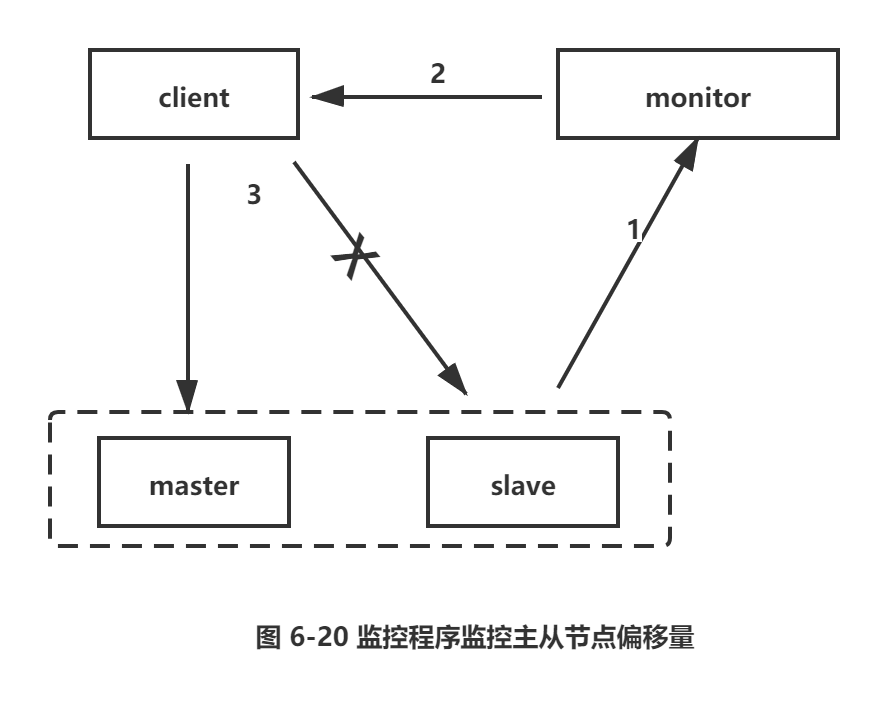

redis复制数据的延迟由于异步复制特性是无法避免的,延迟取决于网络带宽和命令阻塞情况,比如刚在主节点写入数据后立刻在从节点上读取可能获取不到。需要业务场景允许短时间内的数据延迟。对于无法容忍大量延迟场景,可以编写外部监控程序监听主从节点的复制偏移量,当延迟较大时触发报警或者通知客户端避免读取延迟过高的从节点,实现逻辑如图6-20所示。

说明如下:

1) 监控程序(monitor)定期检查主从节点的偏移量,主节点偏移量在info replication的master_repl_offset指标记录,从节点偏移量可以查询主节点的slaveO字段的offset指标,它们的差值就是主从节点延迟的字节量。

2) 当延迟字节量过高时,比如超过10MB。监控程序触发报警并通知客户端从节点延迟过高。可以采用Zookeeper的监听回调机制实现客户端通知。

3) 客户端接到具体的从节点高延迟通知后,修改读命令路由到其他从节点或主节点上。当延迟恢复后,再次通知客户端,恢复从节点的读命令请求。这种方案的成本比较高,需要单独修改适配Redis的客户端类库。如果涉及多种语言成本将会扩大。客户端逻辑需要识别出读写请求并自动路由,还需要维护故障和恢复的通知。采用此方案视具体的业务而定,如果允许不一致性或对延迟不敏感的业务可以忽略,也可以采用Redis集群方案做水平扩展。

2.读到过期数据

当主节点存储大量设置超时的数据时,如缓存数据,Redis内部需要维护过期数据删除策略,删除策略主要有两种:惰性删除和定时删除。

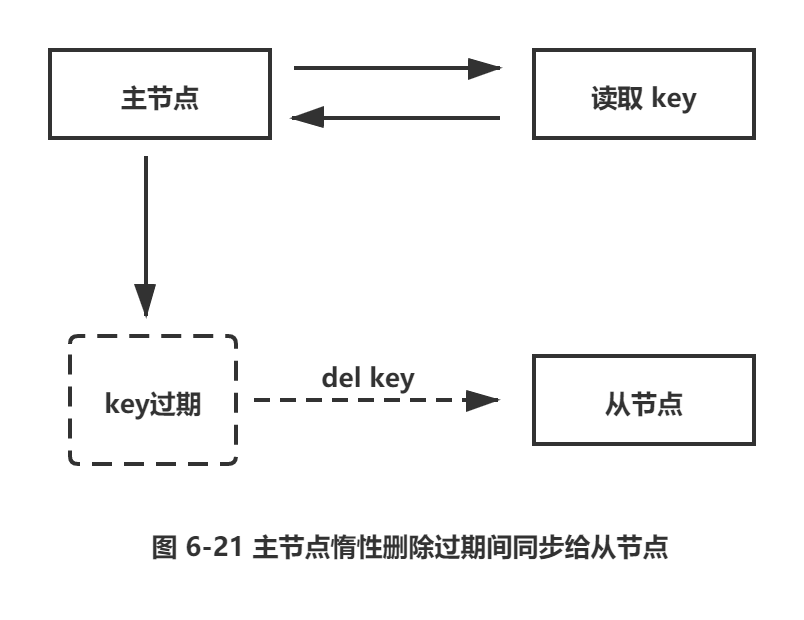

惰性删除:主节点每次处理读取命令时,都会检查键是否超时,如果超时则执行del命令删除键对象,之后del命令也会异步发送给从节点。需要注意的是为了保证复制的一致性,从节点自身永远不会主动删除超时数据,如图6-21。

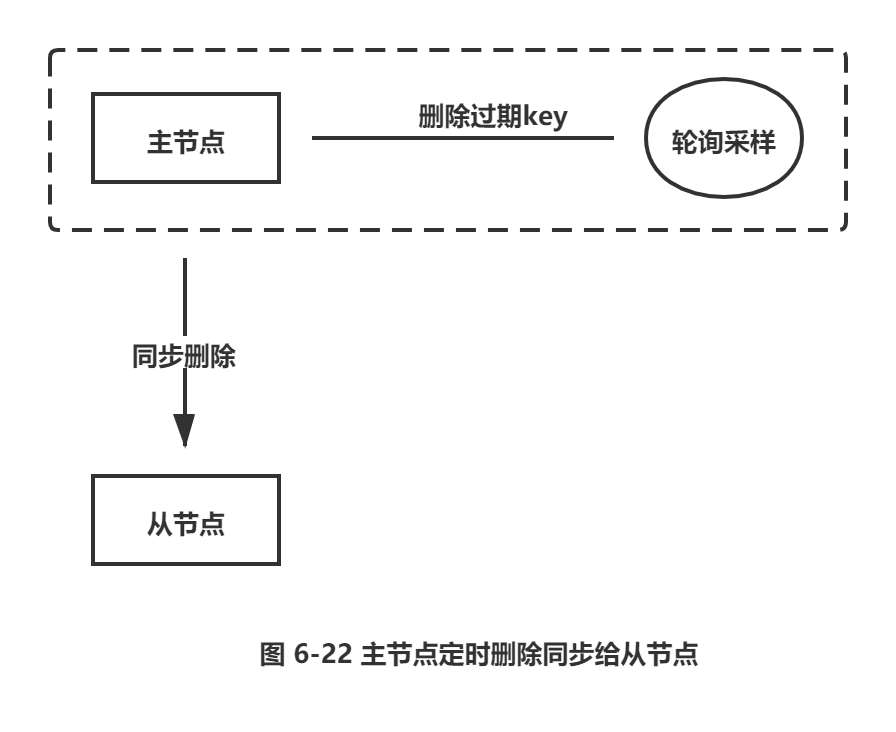

定时删除:Redis主节点在内部定时任务会循环采样一定数量的键,当发现采样的键过期时执行del命令,之后再同步给从节点,如图6-22所示。

如果此时数据大量超时,主节点采样速度跟不上过期速度且主节点没有读取过期键的操作,那么从节点将无法收到del命令。这时在从节点上可以读取到已经超时的数据。Redis3.2版本解决了这个问题,从节点读取数据之前会检查键的过期时间来决定是否返回数据,可以升级到3.2版本来规避这个问题。

3.从节点故障冋题

对于从节点的故障问题,需要在客户端维护可用从节点列表,当从节点故障时立刻切换到其他从节点或主节点上。这个过程类似上文提到的针对延迟过高的监控处理,需要开发人员改造客户端类库。

综上所出,使用Redis做读写分离存在一定的成本。Redis本身的性能非常高,开发人员在使用额外的从节点提升读性能之前,尽量在主节点上做充分优化,比如解决慢查询,持久化阻塞,合理应用数据结构等,当主节点优化空间不大时再考虑扩展。建议大家在做读写分离之前,可以考虑使用Redis Cluster等分布式解决方案,这样不止扩展了读性能还可以扩展写性能和可支撑数据规模,并且一致性和故障转移也可以得到保证,对于客户端的维护逻辑也相对容易。

3.2 主从配置不一致

主从配置不一致是一个容易忽视的问题。对于有些配置主从之间是可以不一致,比如:主节点关闭AOF在从节点开启。但对于内存相关的配置必须要一致,比如maxmemory,hash-max-ziplist-entries等参数。当配置的maxmemory从节点小于主节点,如果复制的数据量超过从节点maxmemory时,它会根据maxmemory-policy策略进行内存溢出控制,此时从节点数据已经丢失,但主从复制流程依然正常进行,复制偏移量也正常。修复这类问题也只能手动进行全量复制。当压缩列表相关参数不一致时,虽然主从节点存储的数据一致但实际内存占用情况差异会比较大。

3.3 规避全量复制

全量复制是一个非常消耗资源的操作,前面做了具体说明。因此如何规避全量复制是需要重点关注的运维点。下面我们对需要进行全量复制的场景逐个分析:

□ 第一次建立复制: 由于是第一次建立复制,从节点不包含任何主节点数据,因此须进行全量复制才能完成数据同步。对于这种情况全量复制无法避免。当对数据量较大且流量较高的主节点添加从节点时,建议在低峰时进行操作,或者尽量规避使用大数据量的Redis节点。

□ 节点运行ID不匹配: 当主从复制关系建立后,从节点会保存主节点的运行ID,如果此时主节点因故障重启,那么它的运行ID会改变,从节点发现主节点运行ID不匹配时,会认为自己复制的是一个新的主节点从而进行全量复制。对于这种情况应该从架构上规避,比如提供故障转移功能。当主节点发生故障后,手动提升从节点为主节点或者采用支持自动故障转移的哨兵或集群方案。

□ 复制积压缓冲区不足: 当主从节点网络中断后,从节点再次连上主节点时会发送psync {offset} {runld}命令请求部分复制,如果请求的偏移量不在主节点的积压缓冲区内,则无法提供给从节点数据,因此部分复制会退化为全量复制。针对这种情况需要根据网络中断时长,写命令数据量分析出合理的积压缓冲区大小。网络中断一般有闪断、机房割接、网络分区等情况。这时网络中断的时长一般在分钟级(net_break_time)。写命令数据量可以统计高峰期主节点每秒info replication的master_repl_offset 差值获取(write_size_per_minute)。积压缓冲区默认为1MB,对于大流量场景显然不够,这时需要增大积压缓冲区,保证 repl_backlog_size > net_break_time * write_size_per_minute,从而避免因复制积压缓冲区不足造成的全量复制。

3.4 规避复制风暴

复制风暴是指大量从节点对同一主节点或者对同一台机器的多个主节点短时间内发起全量复制的过程。复制风暴对发起复制的主节点或者机器造成大量开销,导致CPU、内存、带宽消耗。因此我们应该分析出复制风暴发生的场景,提前采用合理的方式规避。规避方式有如下几个。

1.单主节点复制风暴

单主节点复制风暴一般发生在主节点挂载多个从节点的场景。当主节点重启恢复后,从节点会发起全量复制流程,这时主节点就会为从节点创建RDB快照,如果在快照创建完毕之前,有多个从节点都尝试与主节点进行全量同步,那么其他从节点将共享这份RDB快照。这点Redis做了优化,有效避免了创建多个快照。但是,同时向多个从节点发送RDB快照,可能使主节点的网络带宽消耗严重,造成主节点的延迟变大,极端情况会发生主从节点连接断开,导致复制失败。

解决方案首先可以减少主节点(master)挂载从节点(slave)的数量,或者采用树状复制结构,加人中间层从节点用来保护主节点,如图 6-23所示。

2.单机器复制风暴

由于Redis的单线程架构,通常单台机器会部署多个Redis实例。当一台机器(machine)上同时部署多个主节点(master)时。如果这台机器出现故障或网络长时间中断,当它重启恢复后,会有大量从节点(slave)针对这台机器的主节点进行全量复制,会造成当前机器网络带宽耗尽。

如何避免?方法如下:

□ 应该把主节点尽量分散在多台机器上,避免在单台机器上部署过多的主节点。

□ 当主节点所在机器故障后提供故障转移机制,避免机器恢复后进行密集的全量复制。

4.总结

1. 复制支持树状结构,从节点可以复制另一个从节点,实现一层层向下的复制流。

2. Redis 2.8之后复制的流程分为: 全量复制和部分复制。全量复制需要同步全部主节点的数据集,大量消耗机器和网络资源。而部分复制有效减少因网络异常等原因造成的不必要全量复制情况。通过配置合理的复制积压缓冲区尽量避免全量复制。

3. 主从节点之间维护心跳和偏移量检查机制,保证主从节点通信正常和数据一致。

4. Redis为了保证高性能复制过程是异步的,写命令处理完后直接返回给客户端,不等待从节点复制完成。因此从节点数据集会有延迟情况。

5. 当使用从节点用于读写分离时会存在数据延迟、过期数据、从节点可用性等问题,需要根据自身业务提前作出规避。

6. 在运维过程中,主节点存在多个从节点或者一台机器上部署大量主节点的情况下,会有复制风暴的风险