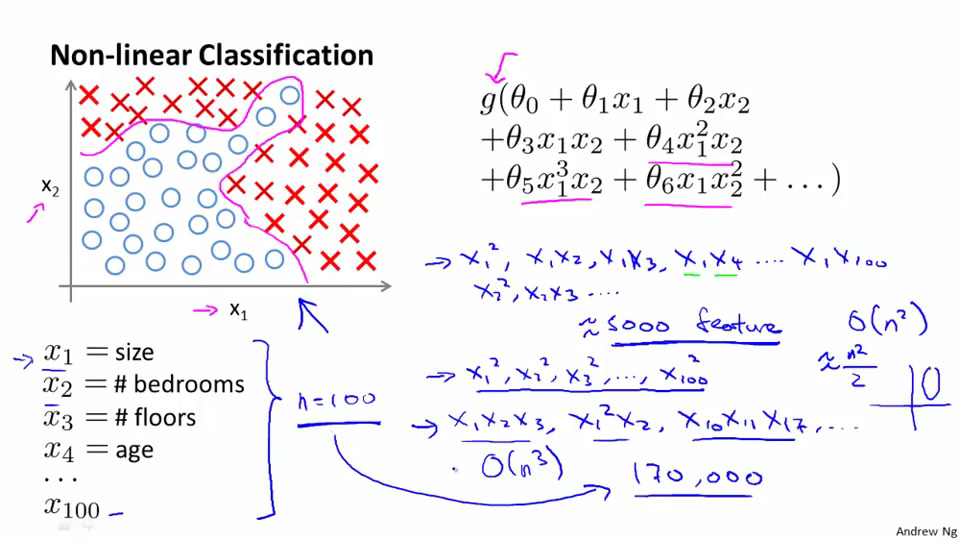

非线性分类器(Non-linear hypotheses)

为什么使用非线性分类器

我们举几个栗子:

假如我们有一个数据空间如左上角坐标系所看到的,那么我们要的模型须要如右边公式所看到的的预測函数.

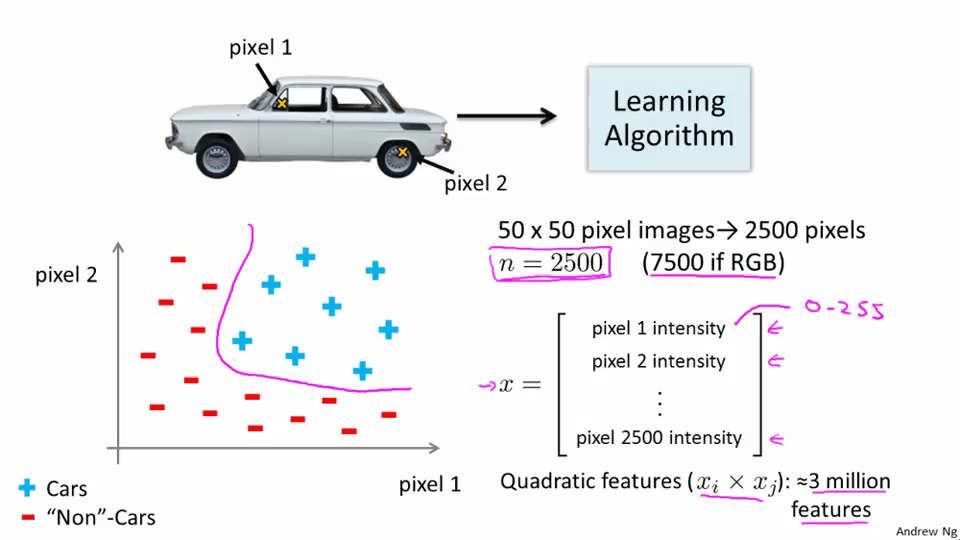

如果有n个特征那么计算二次多项式就有O(n^2)的复杂度.n能有多大?

我们来看以下这个栗子.

如果我们须要识别汽车,假如选取图像上两个点,那么就如左边坐标系所看到的,这没什么.

但实际上我们须要的数据空间时整张图片全部的像素.也就是如果图像是

刚才说的是灰度图,如果时RGB的话时

综上所述,线性分类器肯定是不行的.

神经网络

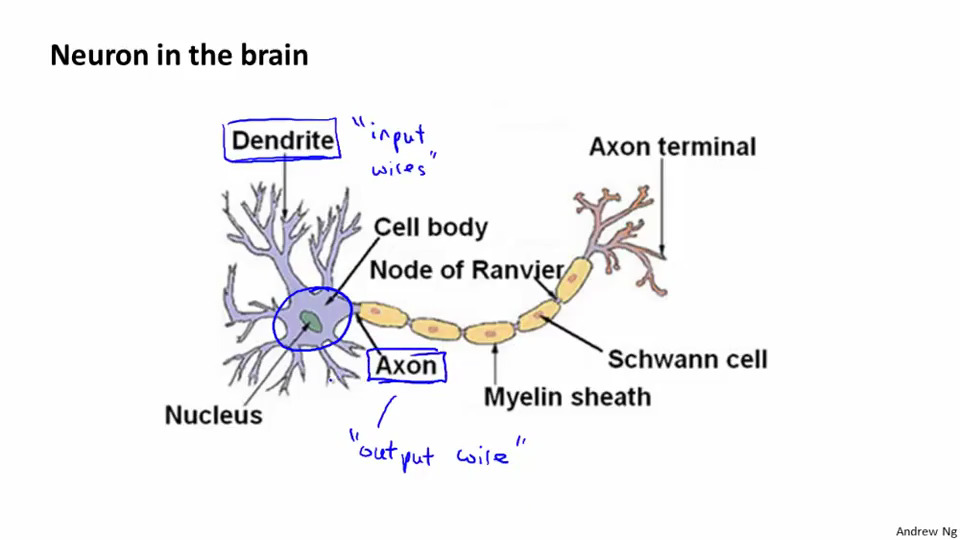

神经网络是模拟人类的神经元时发明的.

神经网络的表示

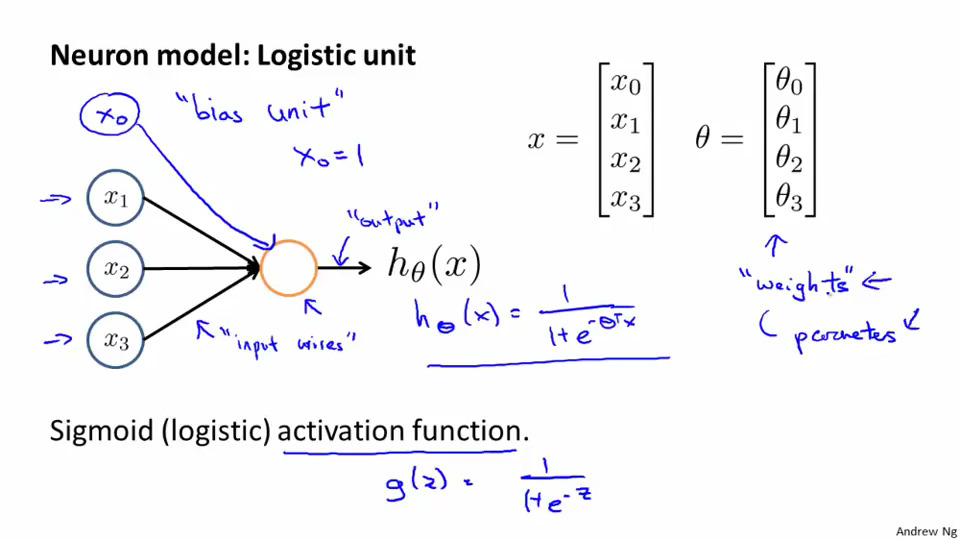

一个神经元(Neuron)就是如图所看到的,他和我们的逻辑回归表示并没有什么差别.

Sigmoid Function叫做激励(activation)函数.

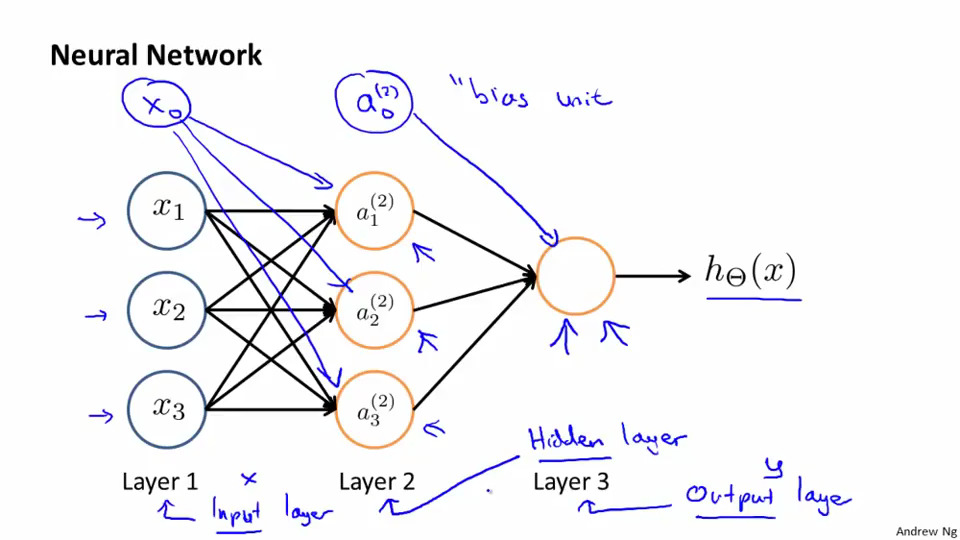

神经网络由多个神经元连接而成,当中第一层被称为输入层(input layer);最后一层被称为输出层(output layer);其它的被称为隐藏层(Hidden layer).

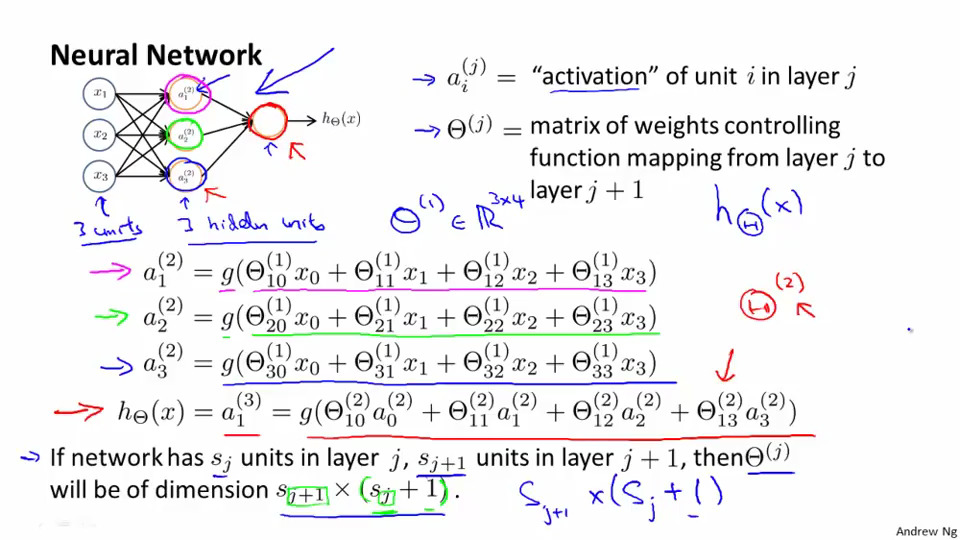

记号

a(j)i :

第j层第i个激励Θ(j) (波矩阵?):

第 j 层到第 j+1 层的參数控制映射

我们通常使用

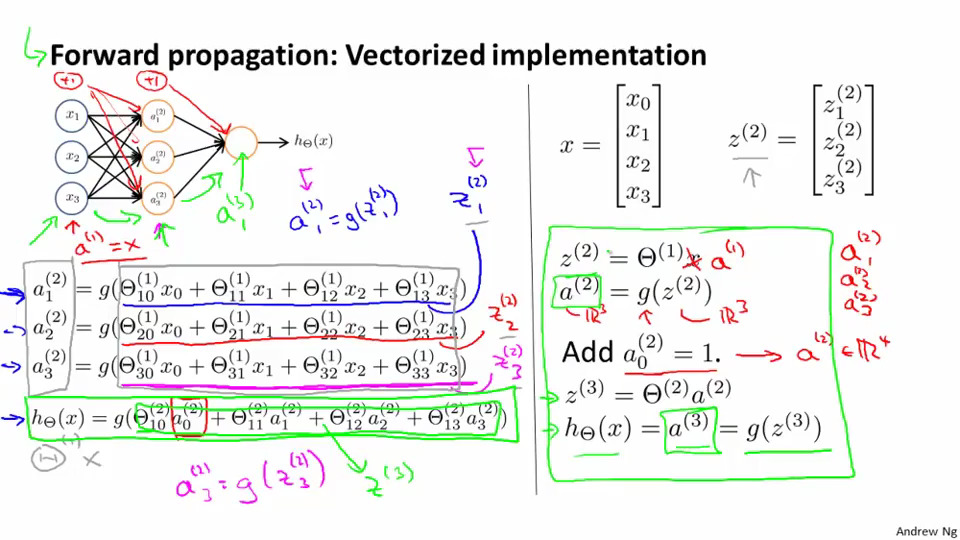

向量化(Vectorized)实现

我们能够将通过向量化来简化神经网络的计算.

我们能够把左下角图中Layer 2的Sigmoid函数提出,这样我们能够用

也就是右边所看到的的过程.

写成一般形式就是:

我们循环运行这个步骤.直到输出层输出

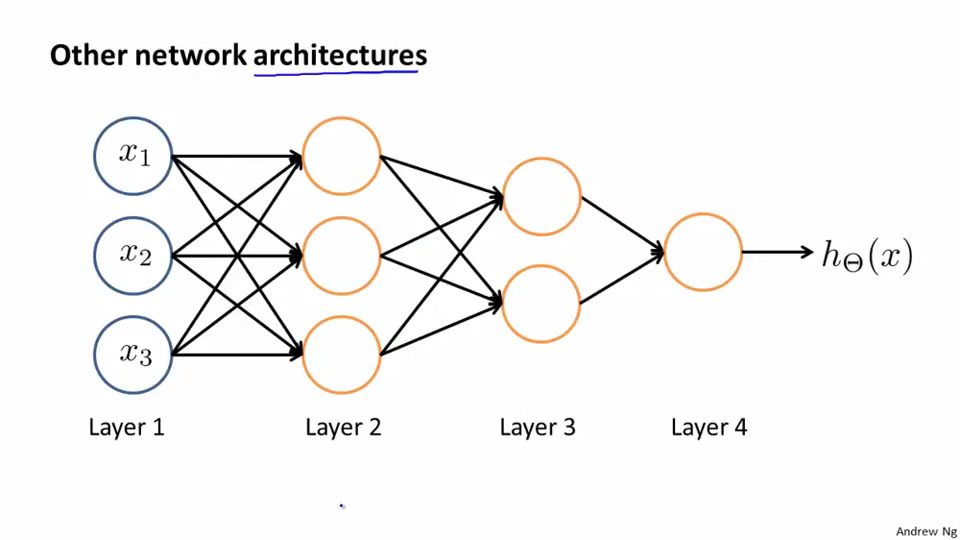

架构(Architecture)

我们把神经元连接的方式叫做架构.

神经网络栗子

为了方便我们理解神经网络,这里有几个栗子.

假如我们有右边的数据空间,那么比較好的边界就是如图所看到的.

我们先简化数据为左边的图,也就是说我们须要训练一个模型求得左下的y式,非常复杂.

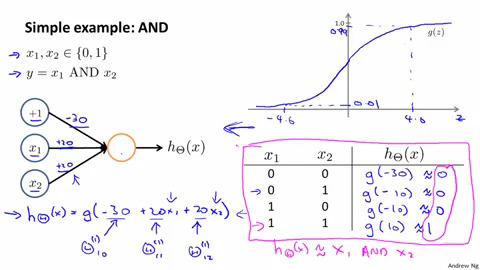

我们先来个简单的AND运算.如上图,如果我们的theta例如以下

那么就能预測出如真值表的值.

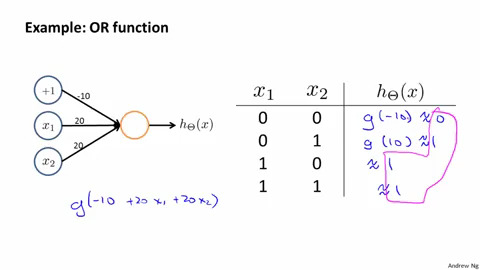

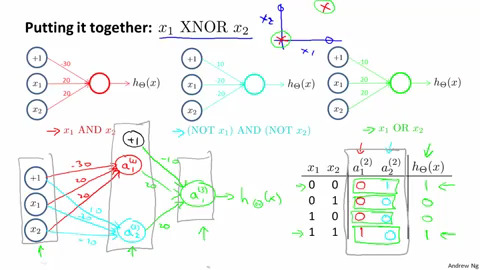

那么同理,我们就能训练出能求或与非的模型.那么我们要求XNOR运算怎么办?

这里我们来构建一个神经网络,每一个节点训练出不同的模型,达到不同的效果,最后达到输出层.

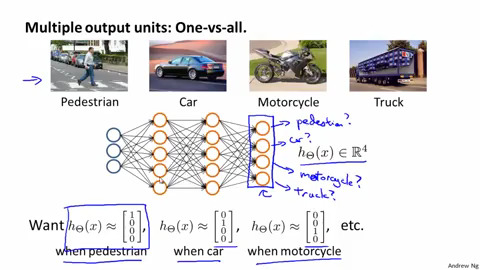

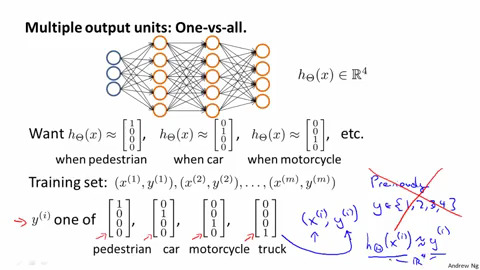

多类别分类

之前说过多类别分类问题採用(one vs all)

如果我们有4个类别须要识别,那么我们就有四个分类器.

每一个分类器的含义同之前,

代价函数

Tips:

数据空间=

Sl=第l层神经元数.

在神经网络中,神经单元的代价函数就是逻辑回归中的代价函数的一般式.

解释一下:

须要注意的是

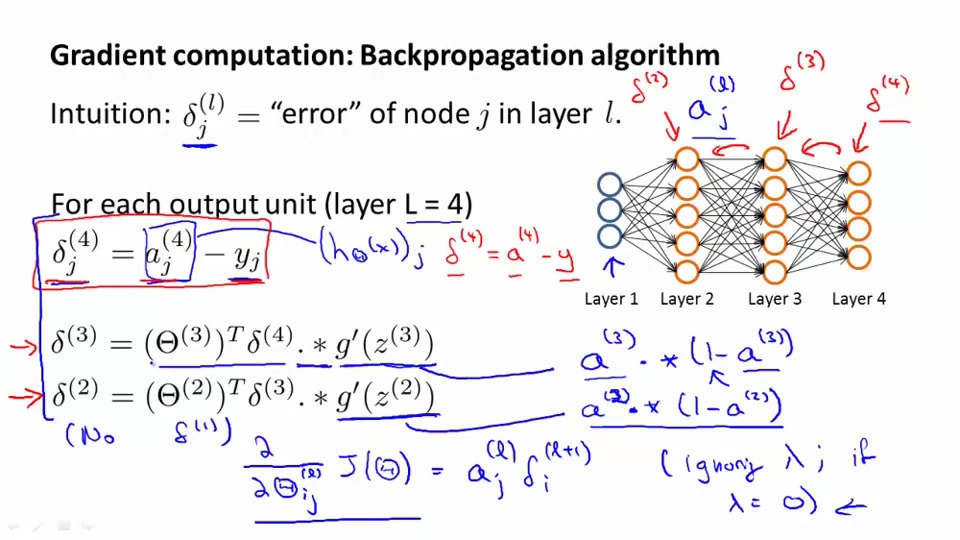

反向传播算法(Backpropagation Algorithm)

我们的目标是:

为了找到这个

J(Θ) ∂∂Θ(l)ijJ(Θ)

当中

那么我们须要计算的就是

直观上来说就是对每一个节点计算

如果我们有一个网络如图:

首先我们从输出节点開始求

变成向量化的形式:

然后往前倒推:

直到

那么忽略

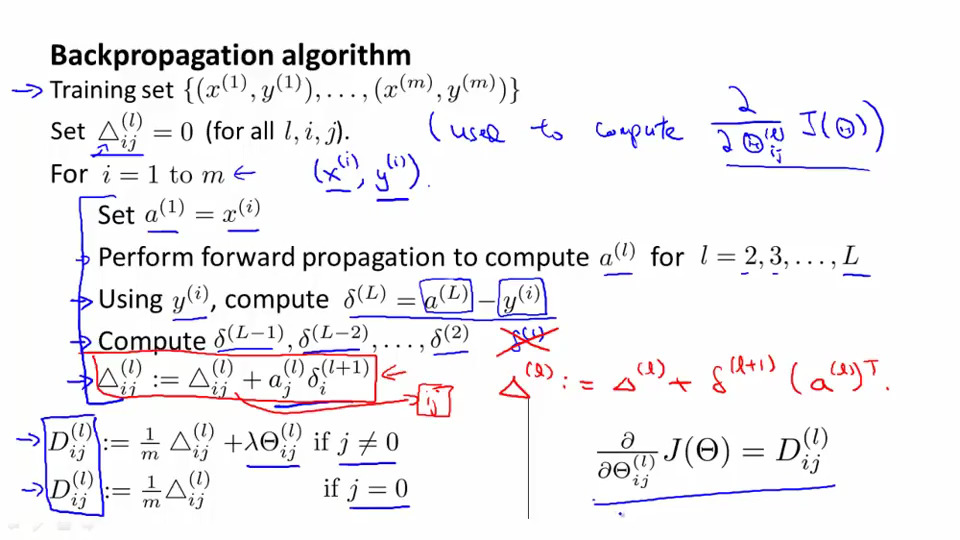

实现

使用上述公式

我们引入

对于每一组例子,

我们先用FP来计算

最后依照偏导项公式累加

若将

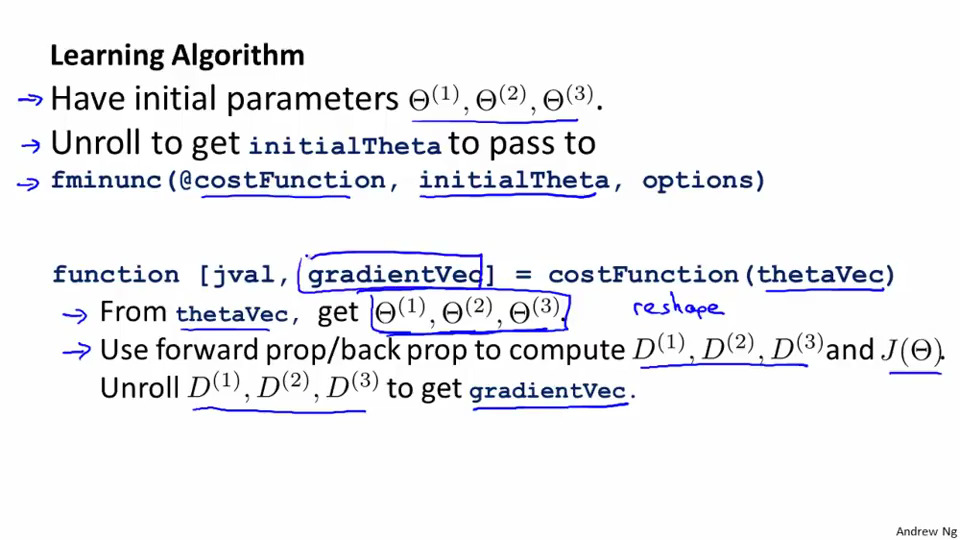

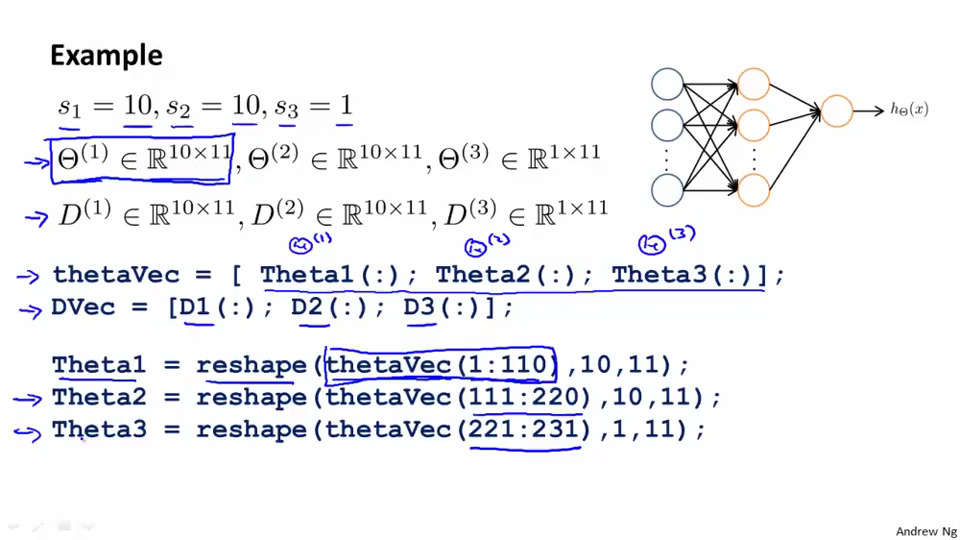

矩阵向量化(Matrices “Unroll” into vectors)

fminunc这些高级函数在使用的时候须要传递向量,而

我们能够把矩阵展开,来达到向量化的目的,然后在costFunction中重组

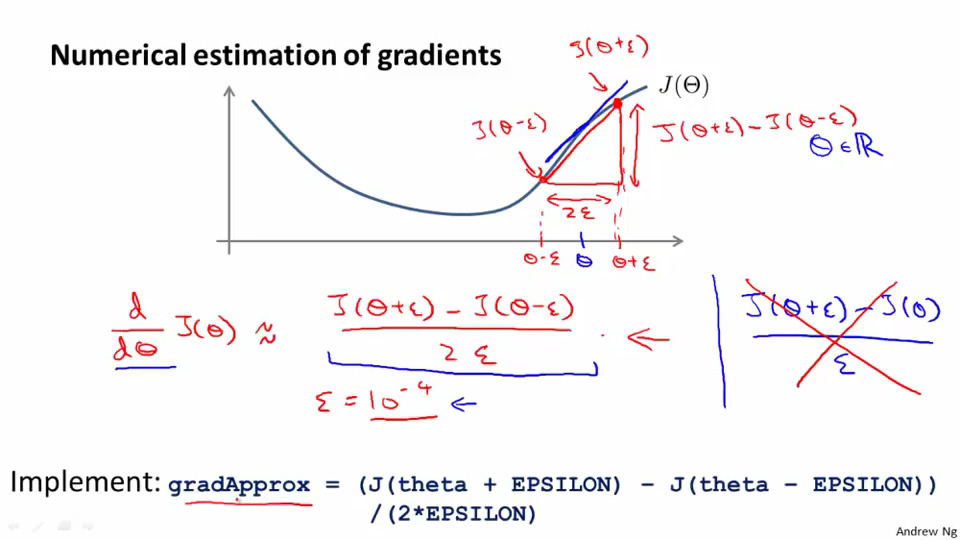

梯度检測(Gradient Checking)

简单的说就是使用双側差分(two sided difference)求近似导数.

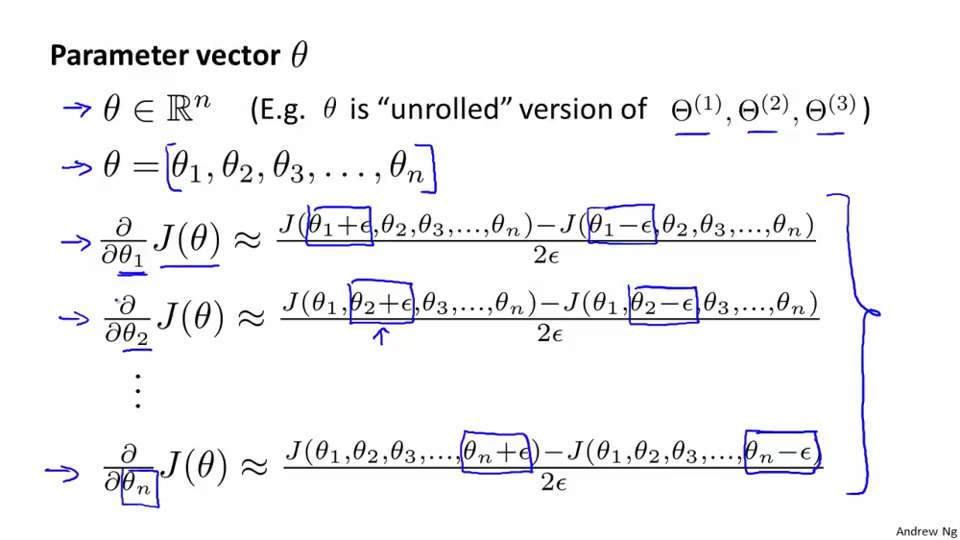

在神经网络中详细实现就是例如以下.

一般我们取

总结:

1. BP求DVec.

2. 求gradApprox.

3. 检測是否类似

4. 关闭检測(由于梯度检測非常慢),使用BP学习.

随机初始化(Random Initialization)

经过之前的学习,我们发现每一层的全部单元都会经过同样的训练.所以我们使用随机初始化来打破这样的对称性.

随机初始化指的是随机化初始的參数矩阵,使他们接近0却不全然同样.

总结

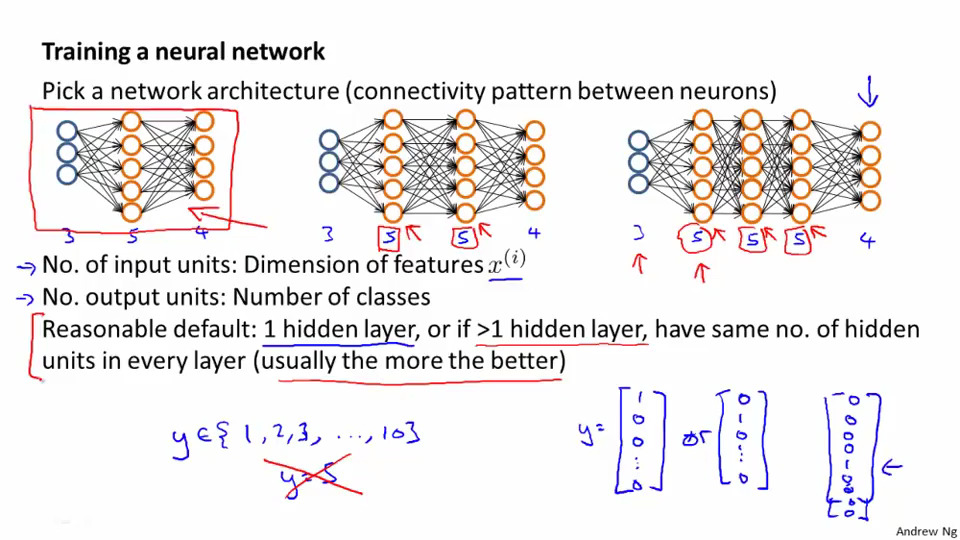

架构(Architecture)

- 输入单元数:特征空间维度.

- 输出单元数:类数

- 隐藏层:通常为一层,每层激励个数同样,数量选择时须要考虑输入输出层,通常稍大于输入层.

训练

- 随机初始化权重.

- FP求

hΘ ,也就是a . - 计算代价函数

J(Θ) - BP求

∂∂Θ(l)ijJ(Θ) . - 使用梯度检測比較BP所求

∂∂Θ(l)ijJ(Θ) ,然后关闭梯度检測. - 使用梯度下降等算法和BP求

Θ (J(Θ) 是非凸函数).

神经网络背景知识

起源

人们想要模拟大脑,由于大脑是最好的学习模型.

兴起与80s~90s,但随后衰退.可是今年由于数据量和计算速度的提高又变得兴起

思考

人类的大脑能学习非常多的东西,比方分辨事物,学习,计算,说话等等.

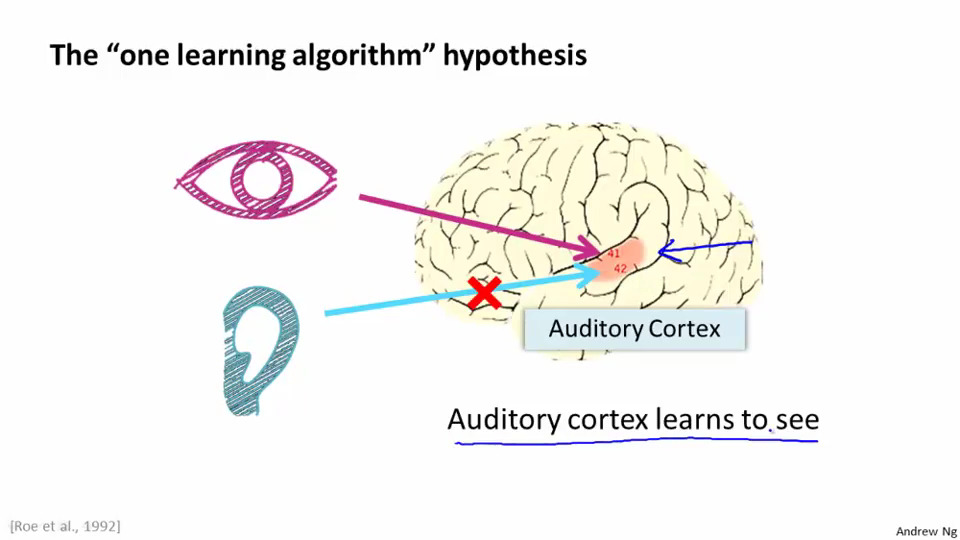

我们也能写非常多算法来模拟这些”任务”,实现该过程.可是大脑的学习应该是仅仅有一个学习算法的(The “one single learning algorithm” hypothesis).

实验(Neural Re-wired Experiment)

科学家把动物视神经切断,而把听觉神经连接到本来由视神经连接的位置(视觉皮层),最后发现动物能完毕视觉辨别任务.

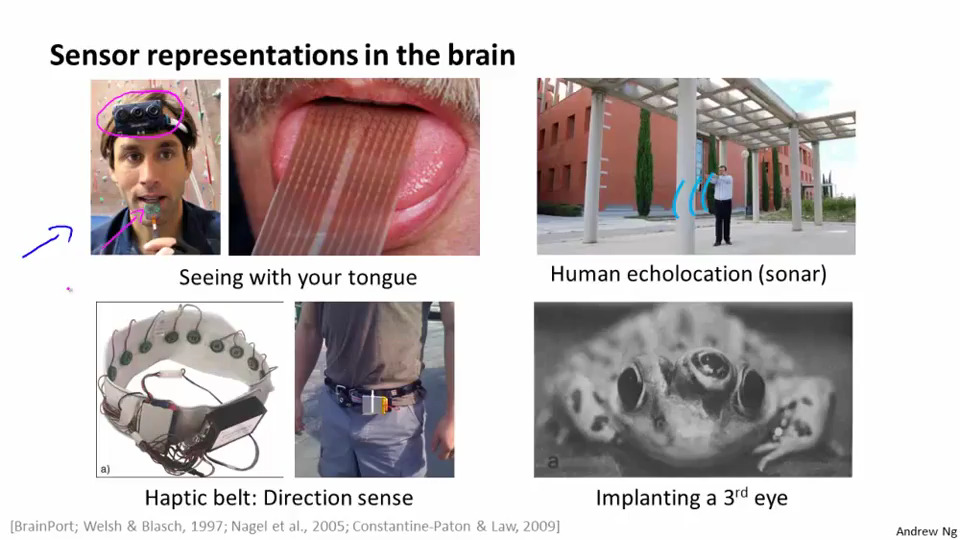

左上角:在额头上佩戴灰度摄像机,数据输出到舌头的电极,刺激舌头.失明的人能在几十分钟内学会”看”.

右上角:人类声呐定位.通过打响指或者咂舌来制造声音,通过听觉来分辨回声,定位周围的物体(这是一种训练,手机上玩过一个游戏叫 Echo还是Dark Echo的就是这样的感觉).

左下角:蜂鸣腰带,朝向北时腰带蜂鸣非常强,使人类拥有鸟类的方向感(这个..恩..).

右下角:给青蛙按第三仅仅眼睛,青蛙能学着使用(卧槽,那岂不是给人类大脑接一个高清摄像头即可,学习量可能有点大吧)