sigmoid

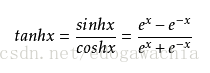

tanh

tanh函数定义如下:

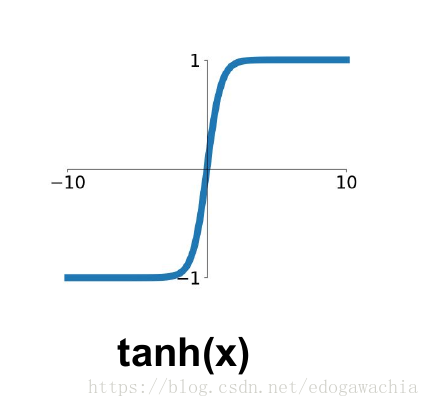

激活函数形状:

ReLU 大家族

ReLU

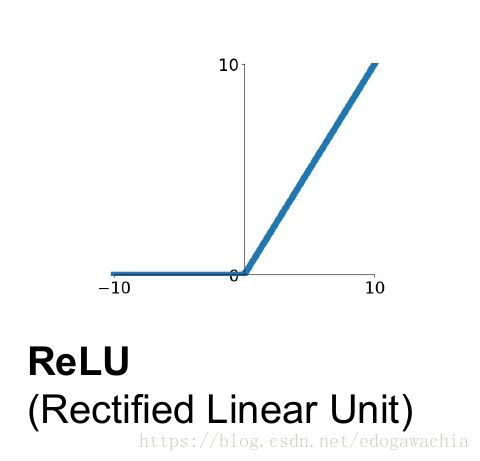

softmax 函数

softmax是一个函数,其主要用于输出节点的分类,它有一个特点,所以的值相加会等于1。

具体例子,可以举图像识别,比如图像识别数字,0~9, 线设置图像识别的输出数字为10个输出节点,然后通过softmax算法,算出对于一张图像的输入,其经过神经网络的计算,会输出10个值,那当前输出的值就是0~9的可能性,但是总和是1.那个数字的输出的概率最大,则这次手写数字的识别结果就是那个数字。