这一节的核心内容在于如何由hoeffding不等式 关联到机器学习的可行性。

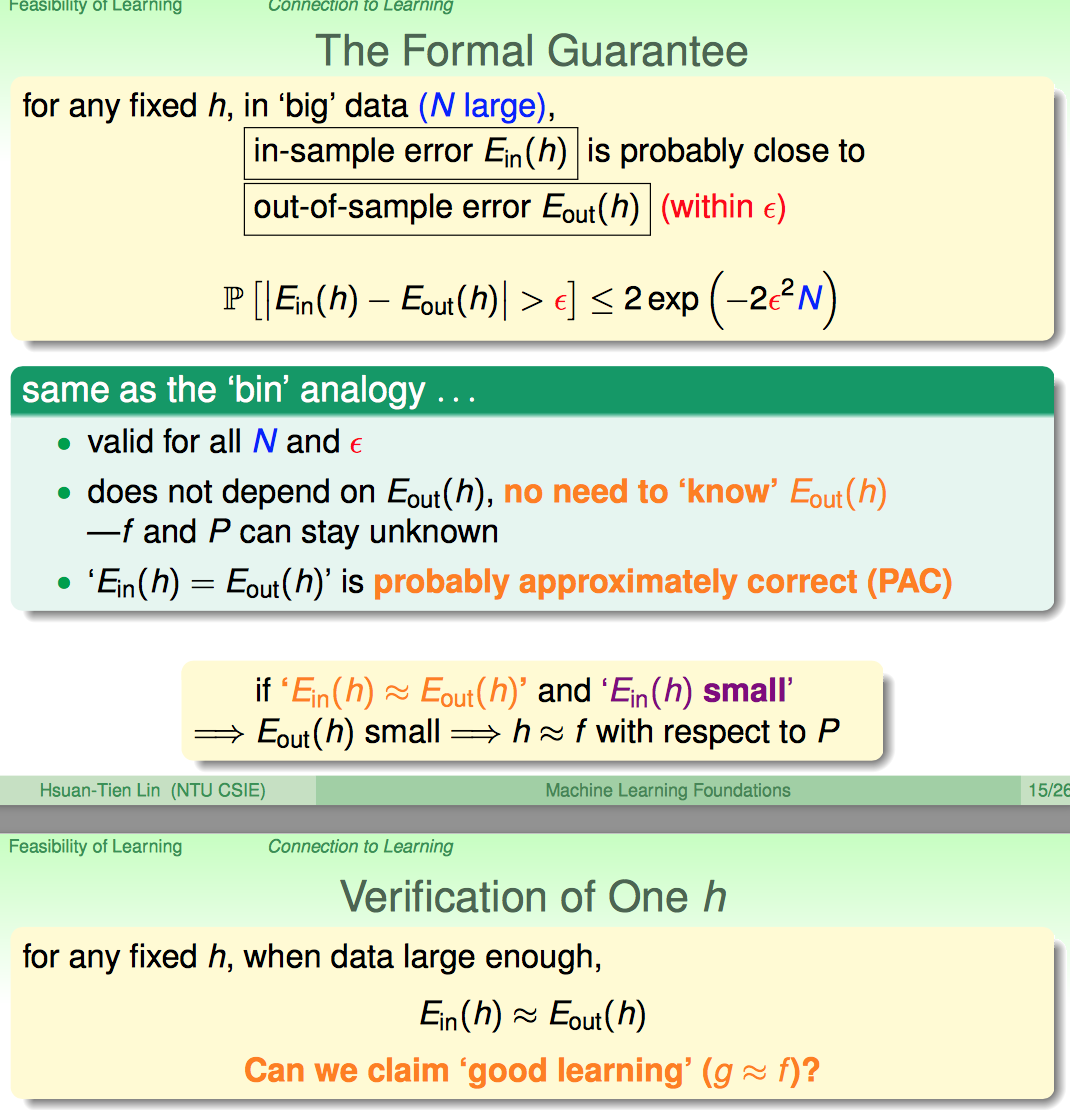

这个PAC很形象又准确,描述了“当前的可能性大概是正确的”,即某个概率的上届。

hoeffding在机器学习上的关联就是:

如果样本数量足够大,那么在训练集上获得的学习效果是可以平移到测试集上的。即如下,

这里保证的仅仅是“训练集的效果平移到测试集”,平移的仅仅是效果,没说效果好坏;如果训练效果是垃圾的,那么测试效果也基本是垃圾的。

如果假设空间是有限的,那么结果又如何呢?如下,

如果假设空间是有限的,根据公式推导:当N足够大的时候,可以保证‘踩雷’的概率很小,我们只要选一个表现最好的假设空间就OK了。

讲到这里,留了一个关子:如果假设空间不是有限的,那么机器学习是否可以行了?