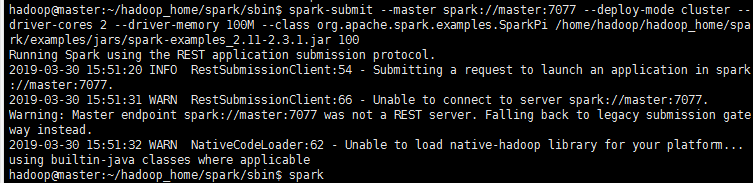

spark-submit --master spark://master:7077 --deploy-mode cluster --driver-cores 2 --driver-memory 100M --class org.apache.spark.examples.SparkPi /home/hadoop/hadoop_home/spark/examples/jars/spark-examples_2.11-2.3.1.jar 100

启动后发现在网页

master:8080

找不到完成后的信息

查找https://blog.csdn.net/ybdesire/article/details/70666544

在启动hadoop后

在启动spark时加入参数-h

即在sbin目录下

./start-all.sh -h

用-h参数启动Master,连接到Master的UI,确保URL是spark://master_ip:7077,而非spark://host_name:7077