1,ELK 日志收集

E: Elasticsearch

L: Logstash

K: Kibana

为什么用Elasticsearch 来存储日志:因为Elasticsearch方便扩展,本来就是处理PB级别的数据,可以存储足够多的日志数据。

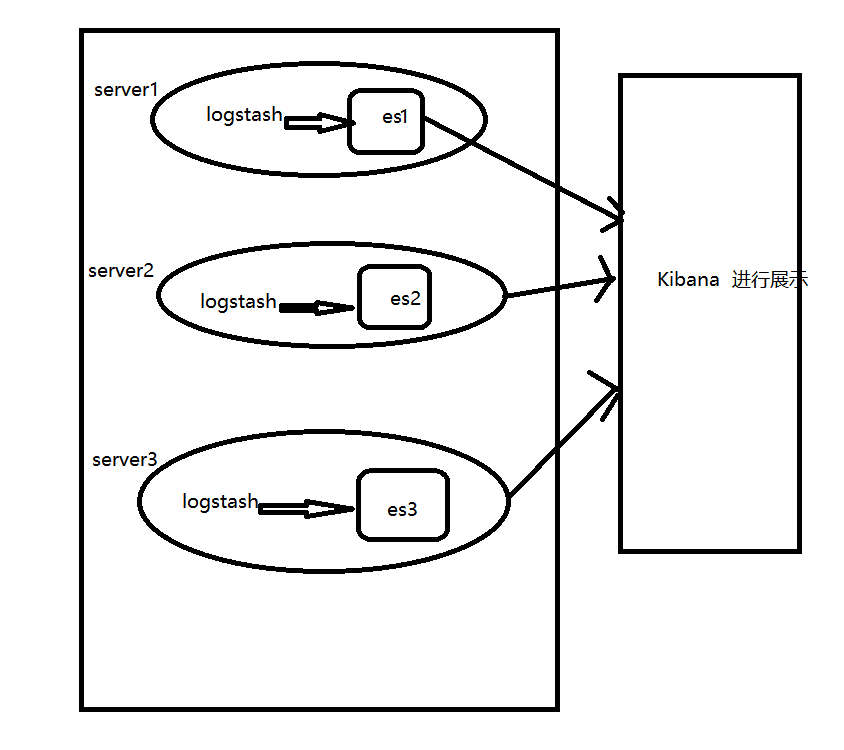

原理图大致如下:

2,为什么需要elk+kafka实现分布式日志收集。

因为单纯的使用elk 日志收集,进行io读取,容易数据丢失,logstash太多了,扩展不好。非实时性。

3, Logstash输入来源有那些?

本地文件、kafka、数据库、mongdb、redis

4,环境搭建

第一步:搭建Kafka 环境