- 权值越多,需要的样本量就会很大;

- 也即需要提供与网络规模相适应的大规模数据;

1. 模型的理解

能学习和存贮大量的输入-输出模式映射关系,而无需事前揭示描述和定义这种映射关系的数学方程。

BP 神经网络等价于一个通用的逼近器(universal approximator);

对于贝叶斯分类器或者逻辑斯特回归,其实它们只是寻找一个分类曲面,也即假设当前数据集存在这样的一个分类平面或者曲面,而这种分类假设对于真实世界的数据而言,常常表现出武断性,无法达到一种令人满意和信服的分类结果。

2. BP 反向传播局限性

BP:error Back Propagation,反向传播的是误差(

- 神经网络的设计具有较高技巧,同时也像一个灰箱系统,容易掩盖某些业务背景细节,容易产生过拟合;

- 事实上 BP 神经网络也不能支持太多的隐层数,原因在于:学习信号反向传播过程会越变越弱,容易陷入局部极小值;

- 太多的层数将会导致:

- 更多的局部极小值;

- 激活函数的选择更加难以确定;

- 太多的层数将会导致:

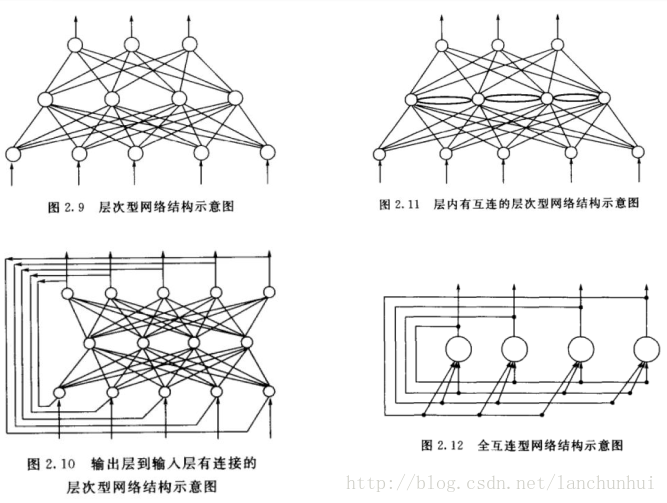

3. 人工神经网络的拓扑结构

- 第一种网络会用在普通的 BP 神经网络,有可叫多层前馈神经网络;

- 第四种网络会用在 Hopfield 网络中;