在运行别人的scrapy项目时,使用命令行 scrapy crawl douban(douban是该项目里爬虫的名字,烂大街的小项目---抓取豆瓣电影)。

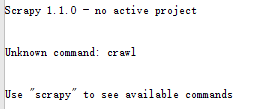

执行之后,出现报错如下:

上网搜寻无果。

大多数是说路径不对,需要进入到项目工程的路径下,然而,我在项目的路径里。

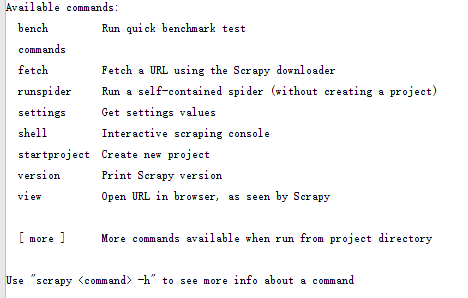

听从建议使用了“scrapy”命令行之后发现,能使用的命令如下:

没有crawl,很奇怪。反复查看后,发现了那句no active project,说明我的工程有问题。

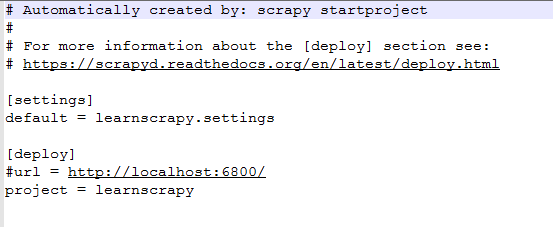

于是去看了看目录结构。查了下手册。在使用命令行startproject的时候,会自动生成scrapy.cfg

问题就出在这里,别人的项目文件中只有代码,没有配置文件,于是自己找了一个配置文件scrapy.cfg,格式如下:

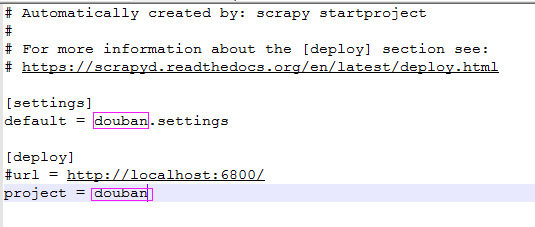

将里面的名字改为当前工程名称"douban":

将此文件保存,放在项目代码的外面,注意是项目代码的外面。不确定的可以看下scrapy文档->入门教程->创建项目,其中有目录结构。

放好,配置文件后,进入项目目录,执行scrapy crawl douban,完美抓取。