4-1 多功能

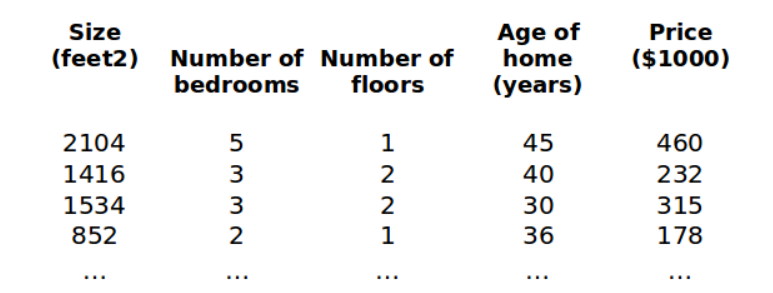

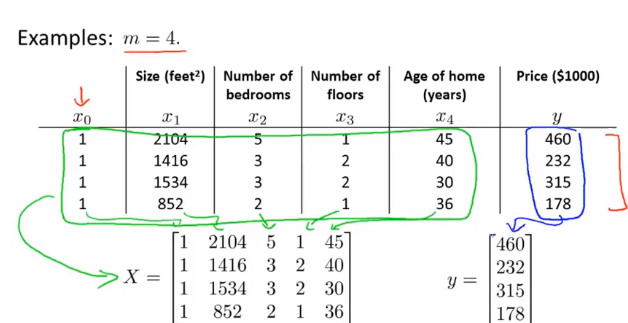

我们探讨了单变量/特征的回归模型,现在我们对房价模型增加更多的特征,例如房间数楼层等,构成一个含有多个变量的模型,模型中的特征为(x1,x2,x3,x4 .........)

n 代表特征的数量

x(i) 代表第 i 个训练实例,是特征矩阵中的第 i 行,是一个向量(vector)。

比方说,上图的

x(i)j 代表特征矩阵中第 i 行的第 j个特征,也就是第 i 个训练实例的第 j 个特征。

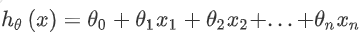

多变量的假设 h 表示为: 这个公式中有 n+1 个参数和 n个变量

这个公式中有 n+1 个参数和 n个变量

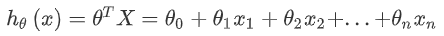

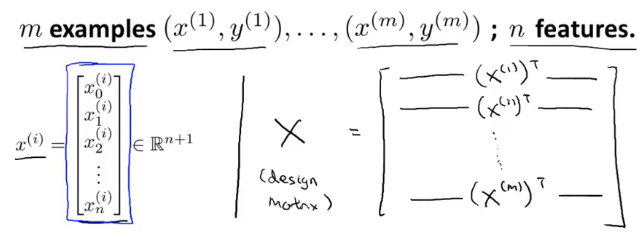

假如以上的 h 中引入 x0=1 ,此时模型中的参数是一个 n+1 维的向量,任何一个训练实例也都是 n+1 维的向量,特征矩阵的维度是 m*(n+1)。

因此公式可以简化为: ,其中上标代表矩阵转置。

,其中上标代表矩阵转置。

4-2 多元梯度下降法

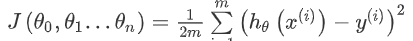

在多变量线性回归中,我们构建一个代价函数,则这个代价函数是所有建模误差的平方和

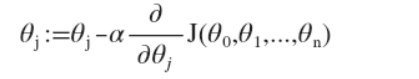

多变量线性回归的批量梯度下降算法为:

求导后为

我们开始随机选择一系列的参数值,计算所有的预测结果后,再给所有的参数一个新的值,如此循环直到收敛。

4-3 特征缩放

在我们面对多维特征问题的时候,我们要保证这些特征都具有相近的尺度,这将帮助梯度下降算法更快地收敛。

最简单的方法是令:xn = xn - μn / sn ,其中 μn 是平均值,sn 是标准差。

4-4 学习率

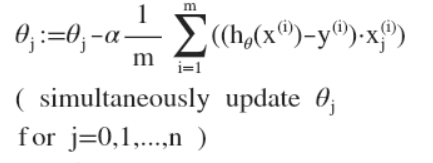

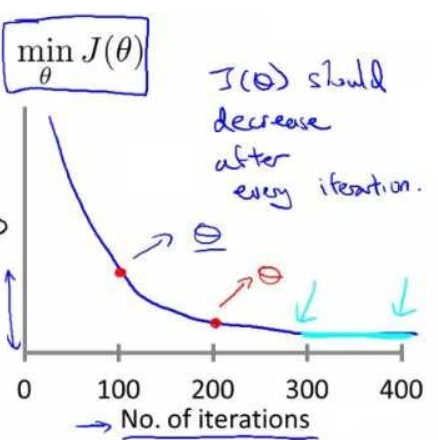

梯度下降算法收敛所需要的迭代次数根据模型的不同而不同,我们可以绘制迭代次数和代价函数的图表来观测算法在何时趋于收敛。

一些自动测试是否收敛的方法,例如将代价函数的变化值与某个阀值(例如0.001)进行比较,但通常看上面这样的图表更好。

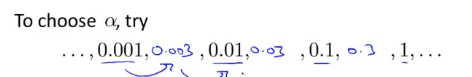

梯度下降算法的每次迭代受到学习率的影响,如果学习率过小,则达到收敛所需的迭代次数会非常高;如果学习率过大,每次迭代可能不会减小代价函数,可能会越过局部最小值导致无法收敛。

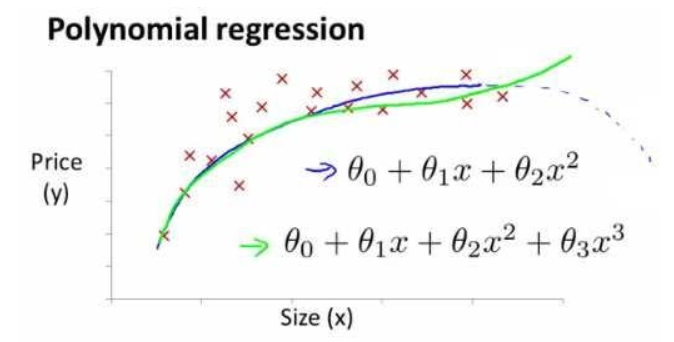

4-5 特征和多项式回归

线性回归并不适用于所有数据,有时我们需要曲线来适应我们的数据,比如一个二次方模型,或者三次方模型。

将三次方模型转化为线性回归模型

注:如果我们采用多项式回归模型,在运行梯度下降算法前,特征缩放非常有必要。

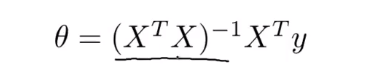

4-6 正规方程

我们都在使用梯度下降算法,但是对于某些线性回归问题,正规方程方法是更好的解决方案。

利用正规方程求参数

4-7 正规方程及不可逆性(可选)

有些矩阵不可逆怎么办

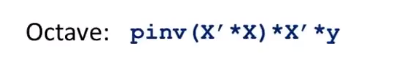

如果在Octave里,可以用伪逆函数 pinv () 来实现。

这种使用不同的线性代数库的方法被称为伪逆。

用它算出来的结果是正确的