一、大数据实时处理有什么意义呢?

我们得到数据可以进行数据分析,利用数据统计方法,从错综复杂的数据关系中梳理出事物的联系,建立一些BI(Business Intelligence)报表,对一些数据的有用信息进行可视化呈现,供我们进行分析和决策。

二、数据实时处理能做什么?

1)实时计算

我们从数据源端拿到的数据,很多时候复杂并且很不直观,我们想对得到的数据进行 ETL 操作、或者进行关联等等,那么我们就会用到数据的实时计算。

目前主流的实时计算框架有 Spark,Storm,Flink 等。现在还有阿里的开源产品:Blink

2)实时落地

数据的实时落地,意思是将我们的源数据或者计算好的数据进行实时的存储。在大数据领域,推荐使用 HDFS,HBASE,ES(ElasticSearch) 等进行存储。

3)实时展示与分析

我们拿到了数据,要会用数据的价值。数据的价值体现在数据中相互关联关系,或与历史关联,或能预测未来。我们实时得到数据,不仅能够利用前端框架进行实时展示,还可以对其中的一些数据进行算法训练,预测未来走势等。

三、数据实时处理框架介绍

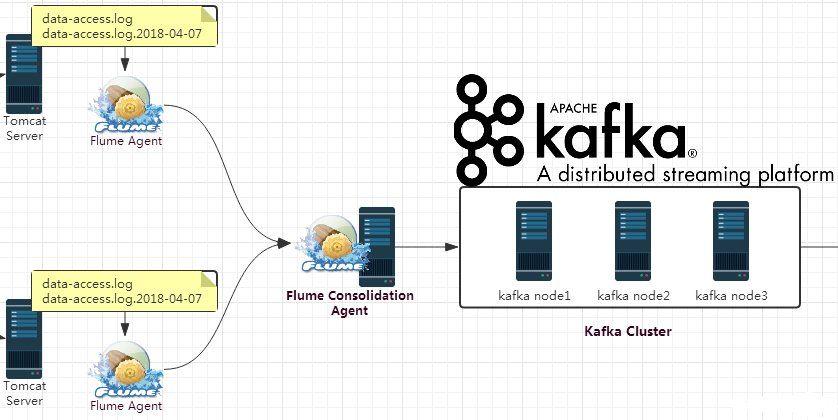

1)数据采集端: flume

flume 是一个分布式的数据收集系统,具有高可靠、高可用、事务管理、失败重启、聚合和传输等功能。数据处理速度快, 完全可以用于生产环境。

flume 的核心概念有:event,agent,source,channel,sink

event

flume 的数据流由事件 (event) 贯穿始终。event 是 flume 的基本数据单位,它携带日志数据并且携带数据的头信息,这些 event 由 agent 外部的 source 生成,当 source 捕获事件后会进行特定的格式化,然后 source 会把事件推入 channel 中。可以把 channel 看作是一个缓冲区,它将保存事件直到 sink 处理完该事件。sink 负责持久化日志或者把事件推向另一个 source。

agent

flume 的核心是 agent。agent 是一个 java 进程,运行在日志收集端,通过 agent 接收日志,然后暂存起来,再发送到目的地。 每台机器运行一个 agent。 agent 里面可以包含多个 source,channel,sink。

source

source 是数据的收集端,负责将数据捕获后进行特殊的格式化,将数据封装到 event 里,然后将事件推入 channel 中。flume 提供了很多内置的 source,支持 avro,log4j,syslog 等等。如果内置的 source 无法满足环境的需求,flume 还支持自定义 source。

channel

channel 是连接 source 和 sink 的组件,大家可以将它看做一个数据的缓冲区(数据队列),它可以将事件暂存到内存中也可以持久化到本地磁盘上, 直到 sink 处理完该事件。两个较为常用的 channel,MemoryChannel 和 FileChannel。

sink

sink 从 channel 中取出事件,然后将数据发到别处,可以向文件系统、数据库、hadoop、kafka,也可以是其他 agent 的 source。

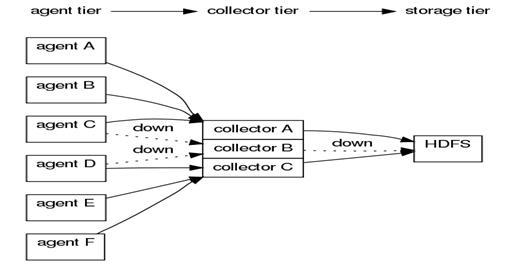

flume 的可靠性与可恢复性

flume 的可靠性:当节点出现故障时,日志能够被传送到其他节点上而不会丢失。Flume 提供了可靠性保障,收到数据首先写到磁盘上,当数据传送成功后,再删除;如果数据发送失败,可以重新发送。

flume 的可恢复性:可恢复性是靠 channel。

flume框架图:

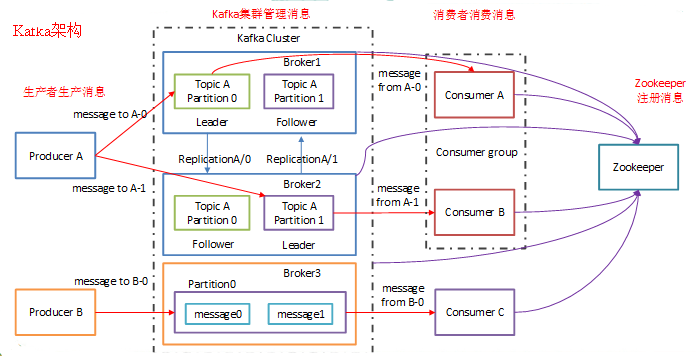

2)数据缓冲缓存: Kafka

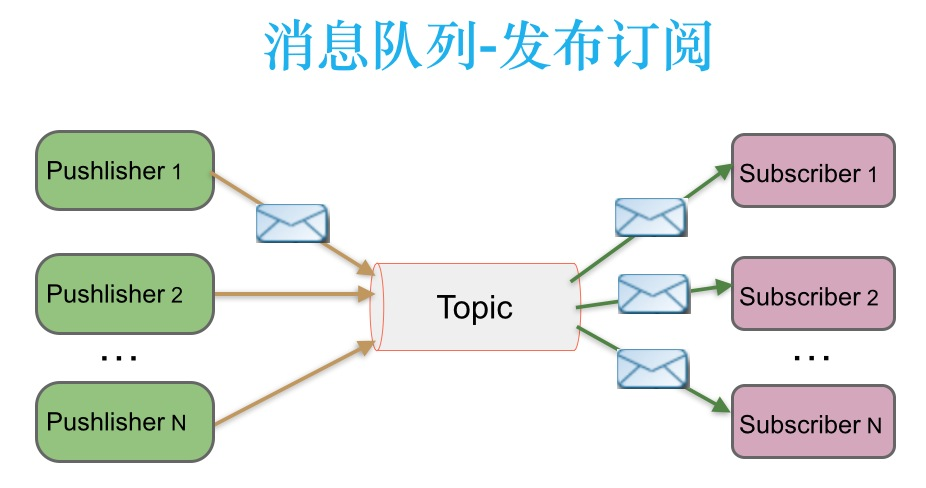

Kafka 是一个高吞吐量的分布式发布-订阅消息系统。企业中一般使用 kafka 做消息中间件,做缓冲缓存处理。需要 zookeeper 分布式协调组件管理。

kafka 的设计目标:

提供优秀的消息持久化能力,对 TB 级以上数据也能保证常数时间的访问性能。

高吞吐率。即使在非常廉价的机器上也能做到每台机每秒 100000 条消息的传输。

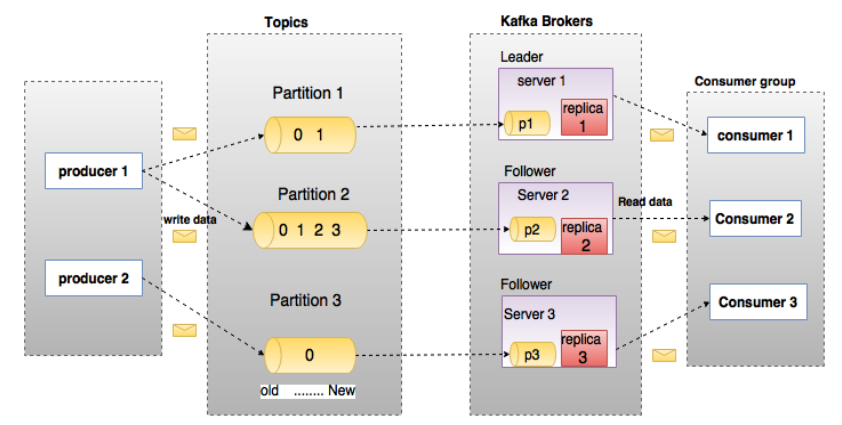

支持 kafka server 间的消息分区,及分布式消费,同时保证每个 partition 内的消息顺序传输。

同时支持离线数据处理和实时数据处理。

kafka 核心概念

broker:消息中间件处理结点,一个 kafka 节点就是一个 broker,多个 broker 可以组成一个 kafka 集群。

topic:主题,kafka 集群能够同时负责多个 topic 的分发。

partition:topic 物理上的分组,一个 topic 可以分为多个 partition,每个 partition 是一个有序的队列。

offset:每个 partition 都由一系列有序的、不可变的消息组成,这些消息被连续的追加到 partition 中。partition 中的每个消息都有一个连续的序列号叫做 offset,用于 partition 唯一标识一条消息。

producer:负责发布消息到 kafka broker。

consumer:消息消费者,向 kafka broker读取消息的客户端。

consumer group:每个 consumer 属于一个特定的 consumer group。

kafka架构图:

下图展示了Kafka的相关术语以及之间的关系:

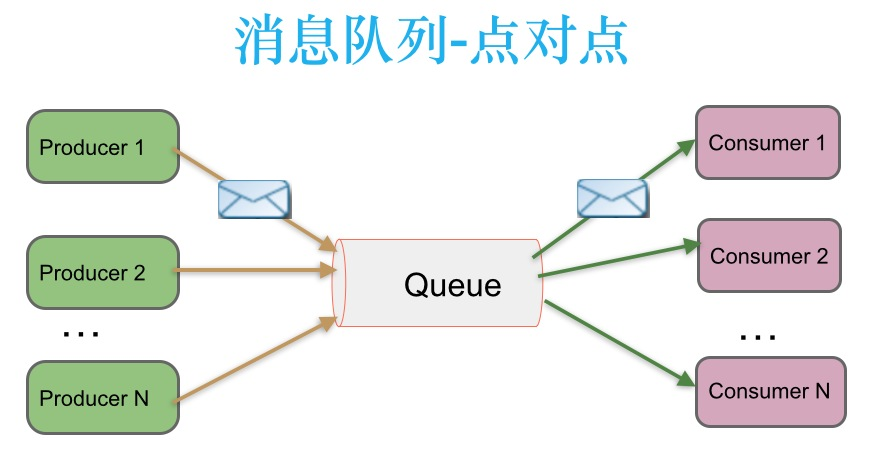

下面是2种消息传递方式:

实时处理框架下篇再讲