参考:

https://baijiahao.baidu.com/s?id=1568663805038898&wfr=spider&for=pc

Generative Adversarial Network

GAN基础和优点

这些惊艳的工作基本都是2016年8月甚至10月以后的,也就是 GAN 被提出两年后。这是因为,虽然 GAN 有非常吸引人的性质,想要训练好它并不容易。经过两年的摸索、思考与尝试,才有了如今的积累和突破。

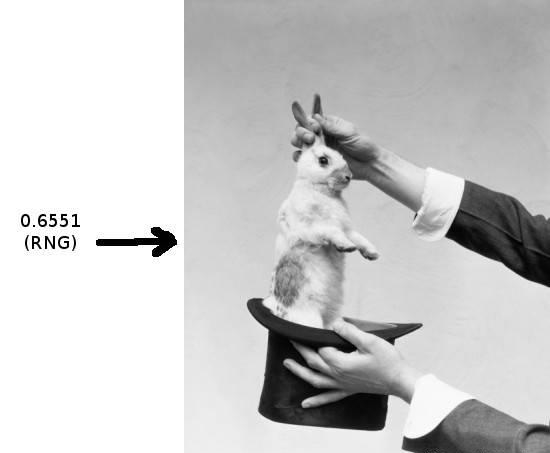

那么这个非常吸引人的 GAN 是什么样呢。其实 GAN 最初让人“哇”的地方在于,作为一个生成模型,GAN 就像魔术师变魔术一样,只需要一个噪音(噪音向量),就可以生成一只兔子!

在这样反复的练习中,作为魔术师的 GAN 扮演的是生成模型的角色,目的是要不断地提高自己的魔术水平,从而变出更活灵活现的兔子;而观众扮演的是一种判别模型的角色,目的是考察和激励魔术师提高自己的水平。但是这种激励是通过批评或者惩罚的方式完成的。

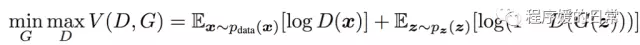

严格来说,一个 GAN 框架,最少(但不限于)拥有两个组成部分,一个是生成模型 G,一个是判别模型 D。在训练过程中,会把生成模型生成的样本和真实样本随机地传送一张(或者一个 batch)给判别模型 D。判别模型 D 的目标是尽可能正确地识别出真实样本(输出为“真”,或者1),和尽可能正确地揪出生成的样本,也就是假样本(输出为“假”,或者0)。

这两个目标分别对应了下方的目标函数的第一和第二项。

而生成模型的目标则和判别模型相反,就是尽可能最小化判别模型揪出它的概率。这样 G 和 D 就组成了一个 min-max game,在训练过程中双方都不断优化自己,直到达到平衡——双方都无法变得更好,也就是假样本与真样本完全不可区分。

这样 G 和 D 就组成了一个 min-max game,在训练过程中双方都不断优化自己,直到达到平衡——双方都无法变得更好,也就是假样本与真样本完全不可区分。

通过这样的巧妙设计,GAN 就拥有了一个非常吸引人的性质。GAN 中的 G 作为生成模型,不需要像传统图模型一样,需要一个严格的生成数据的表达式。这就避免了当数据非常复杂的时候,复杂度过度增长导致的不可计算。同时,它也不需要 inference 模型中的一些庞大计算量的求和计算。它唯一的需要的就是,一个噪音输入,一堆无标准的真实数据,两个可以逼近函数的网络。

剩下的就看不懂了。。。

能知识再多积累一些,再看剩下的吧:

https://mp.weixin.qq.com/s?__biz=MzAwMjM3MTc5OA==&mid=2652692740&idx=1&sn=f1b134f63eb0bf5e4d6759db4d740e58