一、中文分词工具

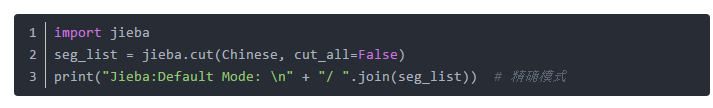

(1)Jieba

(2)snowNLP分词工具

(3)thulac分词工具

(4)pynlpir 分词工具

(5)StanfordCoreNLP分词工具

1.from stanfordcorenlp import StanfordCoreNLP

2.with StanfordCoreNLP(r'E:UsersEternal SunPycharmProjects1venvLibstanford-corenlp-full-2018-10-05', lang='zh') as nlp:

3. print("stanfordcorenlp分词: ",nlp.word_tokenize(Chinese))

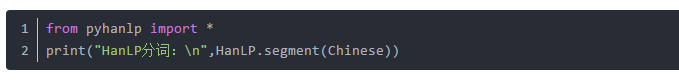

(6)Hanlp分词工具

分词结果如下:

二、英文分词工具

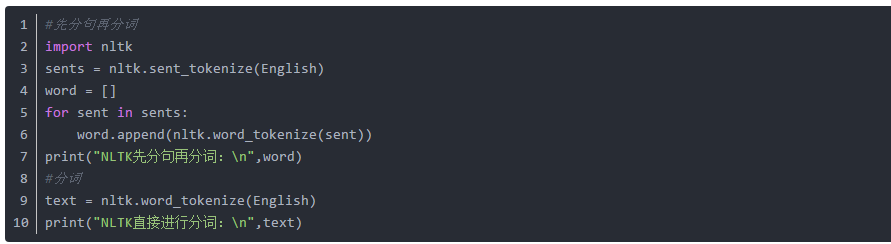

1. NLTK:

二者之间的区别在于,如果先分句再分词,那么将保留句子的独立性,即生成结果是一个二维列表,而对于直接分词来说,生成的是一个直接的一维列表,结果如下:

2. SpaCy:

3. StanfordCoreNLP:

分词结果