第二周 - 神经网络基础

第 11 题

神经元计算什么?

A.神经元计算激活函数后,再计算线性函数(z=Wx+b)

B.神经元计算一个线性函数(z=Wx+b),然后接一个激活函数

C.神经元计算一个函数g,它线性地缩放输入x(Wx+b)

D.神经元先计算所有特征的平均值,然后将激活函数应用于输出

第 12 题

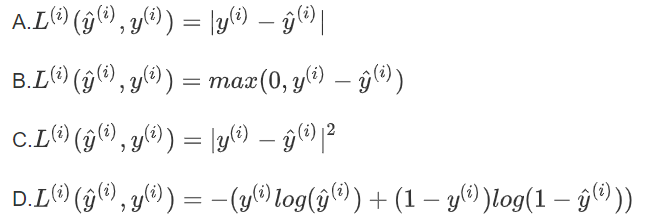

以下哪一个是逻辑回归的损失函数?

第 13 题

假设img是一个(32, 32, 3)数组,表示一个32x32图像,它有三个颜色通道:红色、绿色和蓝色。如何将其重塑为列向量?

A.x = img.reshape((1, 32*32, 3))

B.x = img.reshape((32*32*3, 1))

C.x = img.reshape((3, 32*32))

D.x = img.reshape((32*32, 3))

第 14 题

考虑以下两个随机数组a和b:

a = np.random.randn(2, 3) # a.shape = (2, 3) b = np.random.randn(2, 1) # b.shape = (2, 1) c = a + b

c的维度是什么?

A.c.shape = (3, 2)

B.c.shape = (2, 1)

C.c.shape = (2, 3)

D.计算不成立因为这两个矩阵维度不匹配

第 15 题

考虑以下两个随机数组a和b:

a = np.random.randn(4, 3) # a.shape = (4, 3) b = np.random.randn(3, 2) # b.shape = (3, 2) c = a * b

c的维度是什么?

A.c.shape = (4, 3)

B.c.shape = (3, 3)

C.c.shape = (4, 2)

D.计算不成立因为这两个矩阵维度不匹配

第 16 题

假设每个示例有nx个输入特性,,X=[X(1),X(2)…,X(m)]。X的维数是多少?

A.(m, 1)

B.(1, m)

C.(nx, m)

D.(m, nx)

第 17 题

np.dot(a,b)对a和b的进行矩阵乘法,而a*b执行元素的乘法,考虑以下两个随机数组a和b:

a = np.random.randn(12288, 150) # a.shape = (12288, 150) b = np.random.randn(150, 45) # b.shape = (150, 45) c = np.dot(a, b)

c的维度是什么?

A.c.shape = (12288, 150)

B.c.shape = (150, 150)

C.c.shape = (12288, 45)

D.计算不成立因为这两个矩阵维度不匹配

第 18 题

请考虑以下代码段:

# a.shape = (3,4) # b.shape = (4,1) for i in range(3): for j in range(4): c[i][j] = a[i][j] + b[j]

如何将之矢量化?

A.c = a + d

B.c = a +b.T

C.c = a.T + b.T

D.c = a.T + b

第 19 题

请考虑以下代码段:

a = np.random.randn(3, 3) b = np.random.randn(3, 1) c = a * b

c的维度是什么?

A.这会触发广播机制,b会被复制3次变成(3*3),而*操作是元素乘法,所以c.shape = (3, 3)

B.这会触发广播机制,b会被复制3次变成(3*3),而*操作是矩阵乘法,所以c.shape = (3, 3)

C.这个操作将一个3x3矩阵乘以一个3x1的向量,所以c.shape = (3, 1)

D.这个操作会报错,因为你不能用*对这两个矩阵进行操作,你应该用np.dot(a, b)

第 20 题

请考虑以下计算图:

输出J是?

A.J = (c - 1) * (b + a)

B.J = (a - 1) * (b + c)

C.J = a*b + b*c + a*c

D.J = (b - 1) * (c + a)

11-20题 答案

11.B 12.D 13.B 14.C 15.D 16.C 17.C 18.B 19.A 20.B