#读取英文歌词文件 file=open('dd.txt','r',encoding='utf-8') word=file.read() file.close() #排除符号 di='''.,''""?!:;''' for i in di: word=word.replace(i,'') #大写转换小写 空格分割 word=word.lower().split() #定义字典存放数据 diet={} for c in word: count=word.count(c) diet[c]=count for c in diet: print(diet[c],c) #排除介词等无关词语 de={'the','and','i','in','to','in','with','it'} for i in de: diet.pop(i) #排序 count = sorted(diet.items(),key=lambda items: items[1], reverse=True) #将结果存放在文件夹 f=open("F:text.txt",'w') for i in range(20): f.write(count[i][0]+" "+str(count[i][1] )+' ') f.close()

1.英文词频统

下载一首英文的歌词或文章

将所有,.?!’:等分隔符全部替换为空格

将所有大写转换为小写

生成单词列表

生成词频统计

排序

排除语法型词汇,代词、冠词、连词

输出词频最大TOP20

将分析对象存为utf-8编码的文件,通过文件读取的方式获得词频分析内容。

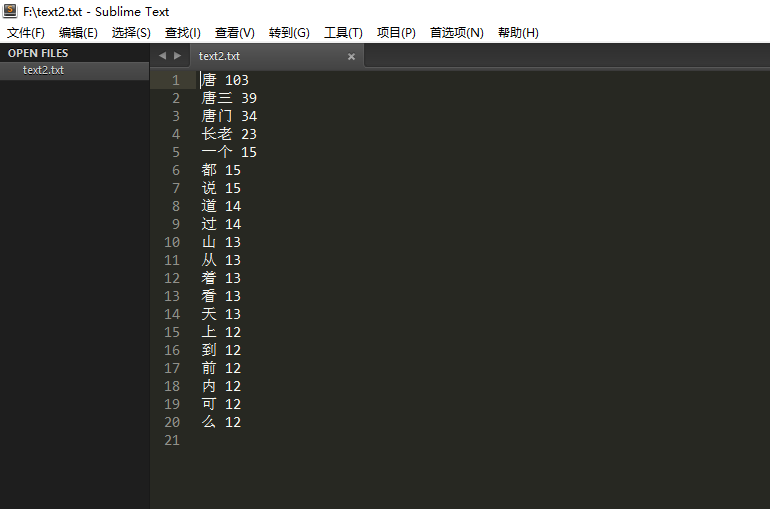

2.中文词频统计

下载一长篇中文文章。

从文件读取待分析文本。

news = open('gzccnews.txt','r',encoding = 'utf-8')

安装与使用jieba进行中文分词。

pip install jieba

import jieba

list(jieba.lcut(news))

生成词频统计

排序

排除语法型词汇,代词、冠词、连词

输出词频最大TOP20(或把结果存放到文件里)

#导入jieba import jieba #读取文件获取文件内容 file=open('f:text.txt','r',encoding='utf-8') word=file.read() file.close() #jieba分割获取list listword=jieba.cut_for_search(word) data=list(listword) #存放数据 diet={} for c in data: count=word.count(c) diet[c]=count #排除空格等 for c in diet: print(diet[c],c) de={' ',',','。','“','”','的','这','『','』','我','他','中','而','个','有','来','了','三','时','是','一','门','大','?','就','那','你','们','见','人','为','外','出','也','不'} for c in de: diet.pop(c) #排序 count = sorted(diet.items(),key=lambda items: items[1], reverse=True) #将结果存放在文件夹 f=open("F:text2.txt",'w') for i in range(20): f.write(count[i][0]+" "+str(count[i][1] )+' ') f.close()