原文链接:https://arxiv.org/pdf/1901.07973.pdf

DeepFashion2

在服装识别方面,现有的DeepFashion数据集存在问题,比如关键点稀少等,无法适用于现实环境。文章提出DeepFashion2来解决这些问题,可以用于服装检测、姿态估计、分割等。它包含801K的服装物品按照样式分为43K类。它的注释比同类更丰富。此外还有873K的卖家秀买家秀的配对,比DeepFashion大3.5倍。DeepFashion没有mask注释,而DeepFashion2有。

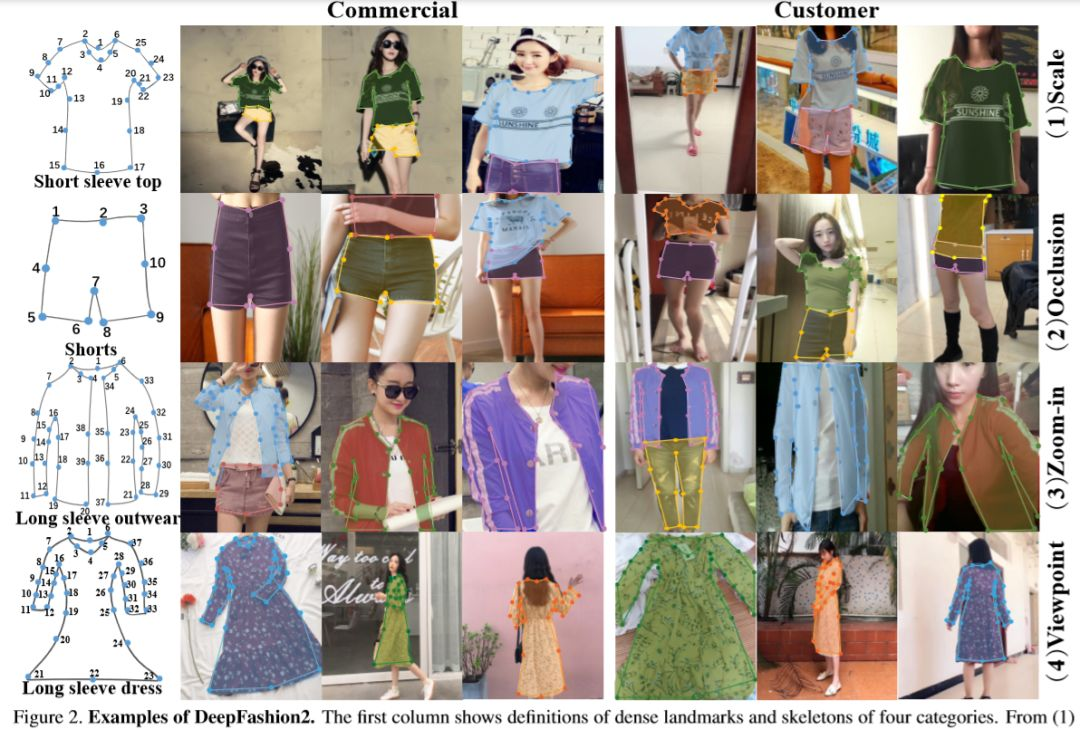

上图展示了DeepFashion和DeepFashion2,前者一张图只能识别一个物体,关键点少,边界框是用关键点估计的所以噪声比较大。后者识别出多个物体,人工标出了边界框和多达20个关键点。

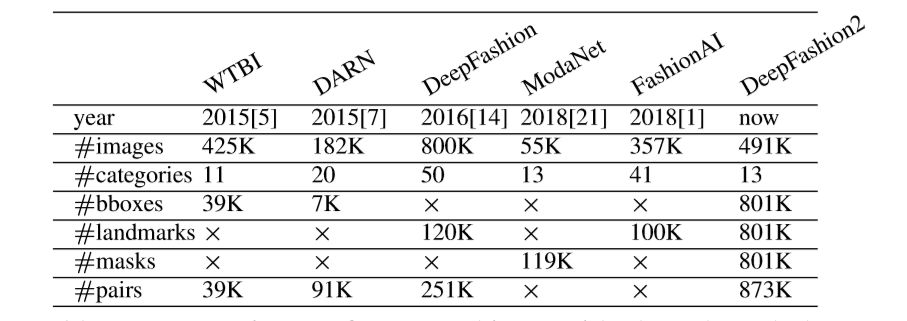

如上图,其他数据集有的从购物网站上获得数据,噪声较大;图片数量、边界框数量、关键点、mask、买家秀和卖家秀pair的数量都不如DeepFashion2。

DeepFashion2的优点有:

1 样本多,43.8K个种类,每个种类有12.7个样本,还有大量注释;

2 多功能,用于服装检测、分类、姿态评估、分割、检索等;

3 表现力,一张图有多个目标,且有13个关键点种类,每一类有23个关键点;

4 多样性,包括放缩、遮挡、放大、不同角度的图像(见上图)。

数据来自DeepFashion和购物网站并人工筛选;人工画上边界框和分类,标注关键点、姿态、遮挡等信息,然后自动生成图片轮廓。自动生成Mask并人工修正。

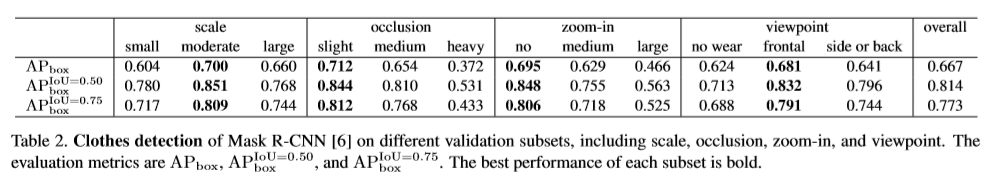

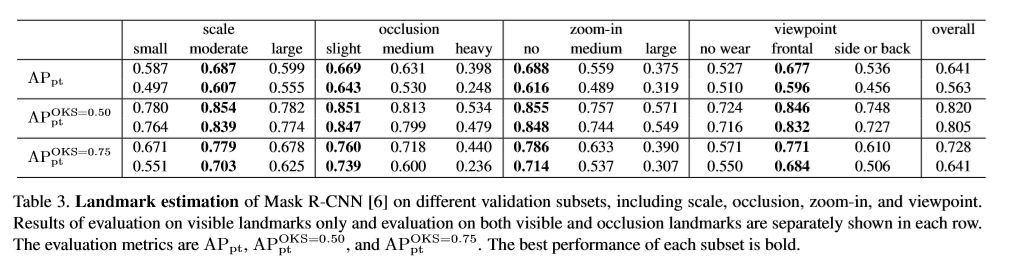

基于DeepFashion2做了四个benchmark,分别是服装检测、关键点检测、分割、卖家秀买家秀的检索(给定买家图片,检索卖家图片)。

Match R-CNN

基于Mask R-CNN提出了Match R-CNN,可以端到端地进行上述四个任务。

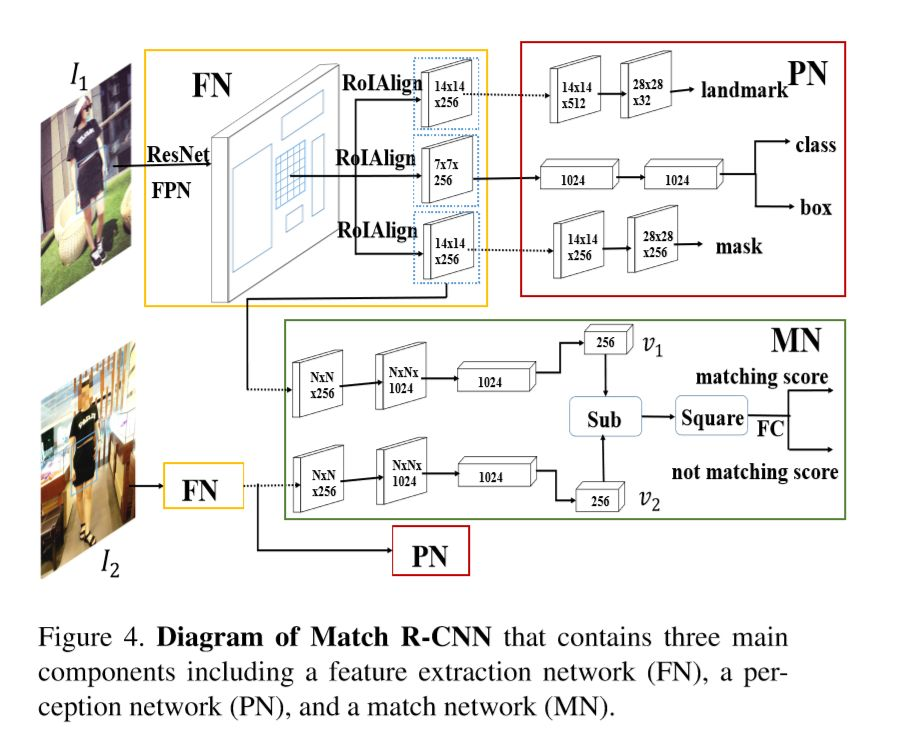

Match R-CNN读入两个图片,经过特征网络FN 感知网络PN和配对网络MN三个部分。

FN包括ResNet-FPN主干、RPN和RoIAlign模块。图片先读入ResNet50提取特征,然后进入FPN形成金字塔形feature map,RoIAlign从金字塔的不同层提取特征

PN有三个支线,分别处理不同任务。服装检测部分是两个全连接层,一个检测种类一个进行边界框的回归。关键点检测部分有8个卷积层和2个“反卷积层”。分割部分有4个卷积层,1个反卷积层和另一个卷积层。

MN包括特征提取器和一个服装检索的相似性学习网络。FN学到的RoI特征进入MN,产生特征向量用于检索。v1和v2进入相似性学习网络来获得I1和I2的相似度。特征提取器有4个卷积层,1个池化层,1个全连接层相似性学习网络包括减法、平方和1个全连接层。

代价函数:如图,其中box用的是smooth loss,其他的都是cross-entropy loss交叉熵。

网络实现:图片先resize,batch size16,学习率开始时是0.02并且每隔8、11、12代递减0.1,SGD的weight decay是10^-5,momentum 0.9。

Experiments

在DeepFashion2上测试了Mask R-CNN和Match R-CNN对于几个任务的准确率。证明现有网络受到遮挡、缩放等干扰较大,从而证明DeepFashion2给模型确实带来了挑战。