dockers网络介绍

docker 网络

Docker 本身的技术依赖于 Linux 内核虚拟化技术的发展。所以 Docker 对 Linux 内核的特性有很强的依赖。 本章主要介绍 Docker 所使用的 Linux 网络技术。

网络基础

Docker 本身的技术依赖于 Linux 内核虚拟化技术的发展。所以 Docker 对 Linux 内核的特性有很强的依赖。 本章主要介绍 Docker 所使用的 Linux 网络技术。

名称空间

为了支持网络协议栈的多个实例,Linux 在网络协议栈中引入了网络名称空间(Network Namespace),这些 独立的协议栈被隔离到不同的命名空间中。处于不同的命名空间的网络协议栈是完全隔离的,彼此之间无法进行 网络通信,就好像两个“平行宇宙”。通过这种对网络资源的隔离,就能在一个宿主机上虚拟多个不同的网络环 境,而 Docker 正是利用这种网络名称空间的特性,实现了不同容器之间的网络隔离。在 Linux 的网络命名空间 内可以有自己独立的 Iptables 来转发、NAT 及 IP 包过滤等功能。 Linux 的网络协议栈是十分复杂的,为了支持独立的协议栈,相关的这些全局变量都必须修改为协议栈私有。 最好的办法就是让这些全局变量成为一个 Net Namespace 变量的成员,然后为了协议栈的函数调用加入一个 Namespace 参数。这就是 Linux 网络名称空间的核心。所以的网络设备都只能属于一个网络名称空间。当然, 通常的物理网络设备只能关联到 root 这个命名空间中。虚拟网络设备则可以被创建并关联到一个给定的命名空 间中,而且可以在这些名称空间之间移动。

创建一个名称空间

[root@docker ~]# ip netns add test01

[root@docker ~]# ip netns add test02

[root@docker ~]# ip netns list

test02

test01

veth设备(成对出现,一对一)

引入 Veth 设备对是为了在不同的网络名称空间之间进行通信,利用它可以直接将两个网络名称空间链接起 来。由于要连接的两个网络命名空间,所以 Veth 设备是成对出现的,很像一对以太网卡,并且中间有一根直连 的网线。既然是一对网卡,那么我们将其中一端称为另一端的 peer。在 Veth 设备的一端发送数据时,它会将数 据直接发送到另一端,并触发另一端的接收操作。

创建vnet设备对

[root@docker ~]# ip link add veth type veth peer name veth001

[root@docker ~]# ip link show

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN mode DEFAULT group default qlen 1000

link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00

2: eth0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP mode DEFAULT group default qlen 1000

link/ether 00:0c:29:3c:09:3e brd ff:ff:ff:ff:ff:ff

3: eth1: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP mode DEFAULT group default qlen 1000

link/ether 00:0c:29:3c:09:48 brd ff:ff:ff:ff:ff:ff

4: docker0: <NO-CARRIER,BROADCAST,MULTICAST,UP> mtu 1500 qdisc noqueue state DOWN mode DEFAULT group default

link/ether 02:42:e8:28:3e:3f brd ff:ff:ff:ff:ff:ff

11: veth001@veth: <BROADCAST,MULTICAST,M-DOWN> mtu 1500 qdisc noop state DOWN mode DEFAULT group default qlen 1000

link/ether e6:99:ac:fa:0e:b3 brd ff:ff:ff:ff:ff:ff

12: veth@veth001: <BROADCAST,MULTICAST,M-DOWN> mtu 1500 qdisc noop state DOWN mode DEFAULT group default qlen 1000

link/ether 7a:59:d4:ee:77:11 brd ff:ff:ff:ff:ff:ff

绑定名称空间

[root@docker ~]# ip link set veth001 netns test01

[root@docker ~]# ip link show

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN mode DEFAULT group default qlen 1000

link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00

2: eth0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP mode DEFAULT group default qlen 1000

link/ether 00:0c:29:3c:09:3e brd ff:ff:ff:ff:ff:ff

3: eth1: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP mode DEFAULT group default qlen 1000

link/ether 00:0c:29:3c:09:48 brd ff:ff:ff:ff:ff:ff

4: docker0: <NO-CARRIER,BROADCAST,MULTICAST,UP> mtu 1500 qdisc noqueue state DOWN mode DEFAULT group default

link/ether 02:42:e8:28:3e:3f brd ff:ff:ff:ff:ff:ff

12: veth@if11: <BROADCAST,MULTICAST> mtu 1500 qdisc noop state DOWN mode DEFAULT group default qlen 1000

link/ether 7a:59:d4:ee:77:11 brd ff:ff:ff:ff:ff:ff link-netnsid 0

# 没了一个,绑定给了test01

查看不到veth,进入test01名称空间查看

[root@docker ~]# ip netns exec test01 bash

[root@docker ~]# ip a

1: lo: <LOOPBACK> mtu 65536 qdisc noop state DOWN group default qlen 1000

link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00

11: veth001@if12: <BROADCAST,MULTICAST> mtu 1500 qdisc noop state DOWN group default qlen 1000

link/ether e6:99:ac:fa:0e:b3 brd ff:ff:ff:ff:ff:ff link-netnsid 0

分配ip给test01

[root@docker ~]# ip netns exec test01 ip addr add 172.16.0.111/20 dev veth001

[root@docker ~]# ip netns exec test01 bash

[root@docker ~]# ip a

1: lo: <LOOPBACK> mtu 65536 qdisc noop state DOWN group default qlen 1000

link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00

11: veth001@if12: <BROADCAST,MULTICAST> mtu 1500 qdisc noop state DOWN group default qlen 1000

link/ether e6:99:ac:fa:0e:b3 brd ff:ff:ff:ff:ff:ff link-netnsid 0

inet 172.16.0.111/20 scope global veth001

valid_lft forever preferred_lft forever

分配ip给root

[root@docker ~]# ip addr add 172.16.0.112/20 dev veth

[root@docker ~]# ip a

12: veth@if11: <BROADCAST,MULTICAST> mtu 1500 qdisc noop state DOWN group default qlen 1000

link/ether 7a:59:d4:ee:77:11 brd ff:ff:ff:ff:ff:ff link-netnsid 0

inet 172.16.0.112/20 scope global veth

valid_lft forever preferred_lft forever

重启网卡

# root

[root@docker ~]# ip link set dev veth down

[root@docker ~]# ip link set dev veth up

# test01

[root@docker ~]# ip netns exec test01 bash

[root@docker ~]# ip link set dev veth001 down

[root@docker ~]# ip link set dev veth001 up

docker网络模式

HOST模式

如果启动容器的时候使用 host 模式,那么这个容器将不会获得一个独立的 Network Namespace,而是和宿主机共用一个 Network Namespace。容器将不会虚拟出自己的网卡,配置自己的 IP 等,而是使用宿主机的 IP 和端口。但是,容器的其他方面,如文件系统、进程列表等还是和宿主机隔离的。 使用 host 模式的容器可以直接使用宿主机的 IP 地址与外界通信,容器内部的服务端口也可以使用宿主机的 端口,不需要进行 NAT,host 最大的优势就是网络性能比较好,但是 docker host 上已经使用的端口就不能再用了,网络的隔离性不好

[root@docker ~]# docker rm -f `docker ps -a -q`

8776c7d4a966

f8ff1667469d

ca5cf720733f

a5008f3abaa9

09d5f27948e4

7147930d1a61

[root@docker ~]# docker ps

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

[root@docker ~]# docker run -d --name nginx1 --network host nginx

f41fb717d46ee57523b26edc17dfbb860b767dd4f73ead3ad25a65e49c680779

[root@docker ~]# docker ps

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

f41fb717d46e nginx "/docker-entrypoint.…" 6 seconds ago Up 5 seconds nginx1

[root@docker ~]# curl 127.0.0.1:80

<!DOCTYPE html>

<html>

<head>

<title>Welcome to nginx!</title>

# 查看端口

[root@docker ~]# netstat -tunlp

Active Internet connections (only servers)

Proto Recv-Q Send-Q Local Address Foreign Address State PID/Program name

tcp 0 0 0.0.0.0:80 0.0.0.0:* LISTEN 3892/nginx: master

tcp6 0 0 :::80 :::* LISTEN 3892/nginx: master

Containe模式

容器与容器间共享

这个模式指定新创建的容器和已经存在的一个容器共享一个 Network Namespace,而不是和宿主机共享。 新创建的容器不会创建自己的网卡,配置自己的 IP,而是和一个指定的容器共享 IP、端口范围等。同样,两个 容器除了网络方面,其他的如文件系统、进程列表等还是隔离的。两个容器的进程可以通过 lo 网卡设备通信

none模式

不指定,后续有需要的话自己加

bridge模式

当 Docker 进程启动时,会在主机上创建一个名为 docker0 的虚拟网桥,此主机上启动的 Docker 容器会连 接到这个虚拟网桥上。虚拟网桥的工作方式和物理交换机类似,这样主机上的所有容器就通过交换机连在了一个 二层网络中。 从 docker0 子网中分配一个 IP 给容器使用,并设置 docker0 的 IP 地址为容器的默认网关。在主机上创建 一对虚拟网卡 veth pair 设备,Docker 将 veth pair 设备的一端放在新创建的容器中,并命名为 eth0(容器的网 卡),另一端放在主机中,以 vethxxx 这样类似的名字命名,并将这个网络设备加入到 docker0 网桥中。可以 通过 brctl show 命令查看。 bridge 模式是 docker 的默认网络模式,不写--net 参数,就是 bridge 模式。使用 docker run -p 时,docker 实际是在 iptables 做了 DNAT 规则,实现端口转发功能。可以使用 iptables -t nat -vnL 查.

# 语法

docker network [cmd]

# 创建网桥

[root@docker ~]# docker network create baim0

7ad4615033e1b25380c8856d9b8bf7e3395069e371e5092b04bfea58a84dcd39

# 查看网桥

[root@docker ~]# docker network ls

NETWORK ID NAME DRIVER SCOPE

7ad4615033e1 baim0 bridge local

7ebc6fbbc51e bridge bridge local

40945640a86c host host local

40743b38b837 none null local

# 查看网桥信息

[root@docker ~]# docker network inspect baim0 # 或者id

# 连接一个容器

[root@docker ~]# docker network connect [网桥名] [容器名]

# 取消连接

[root@docker ~]# docker network disconnect [网桥名] [容器名]

# 删除一个网桥

[root@docker ~]# docker network rm chenyang

# 清除所有网桥(默认的和正在使用的除外)

[root@docker ~]# docker network prune

WARNING! This will remove all custom networks not used by at least one container.

Are you sure you want to continue? [y/N] y

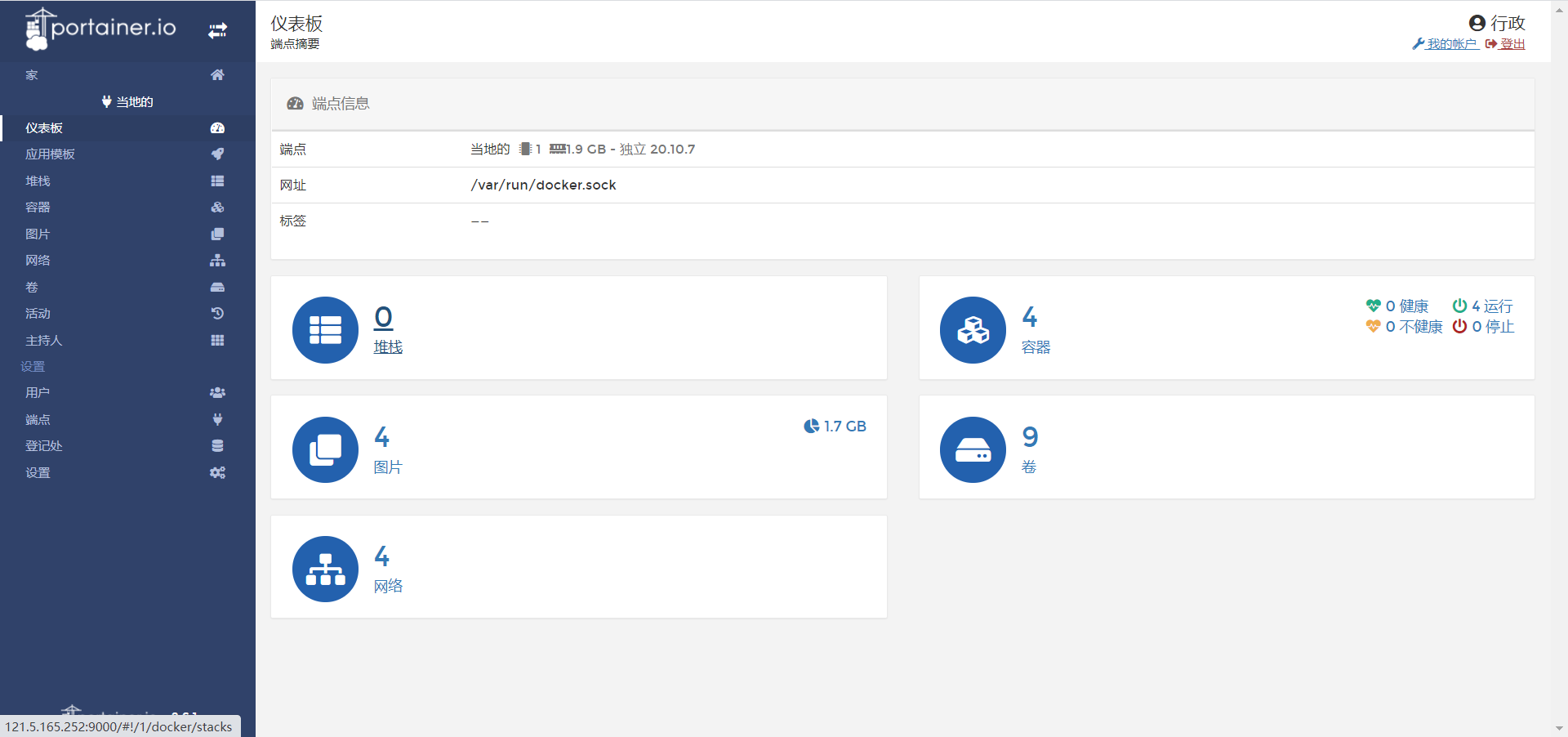

图形化界面

https://documentation.portainer.io/v2.0/deploy/ceinstalldocker/