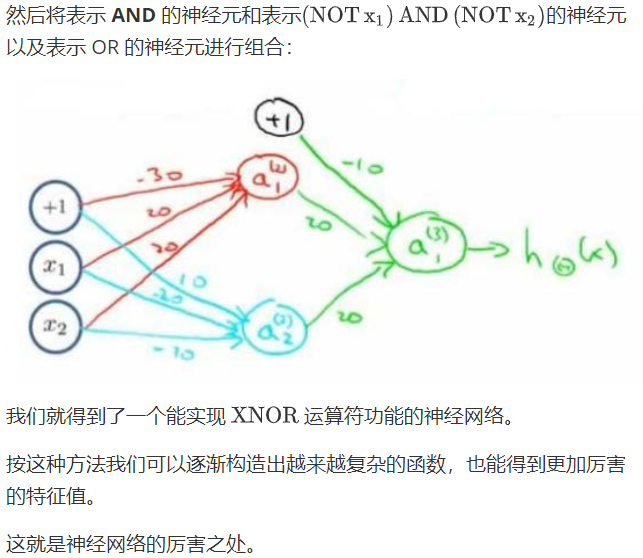

课时八 神经网络:表述

本章是神经网络的入门介绍,神经网络适用于非线性问题,特别是当特征数量很多时。本课时主要介绍了一些固定术语。

1、模型表示

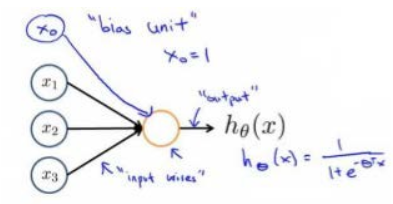

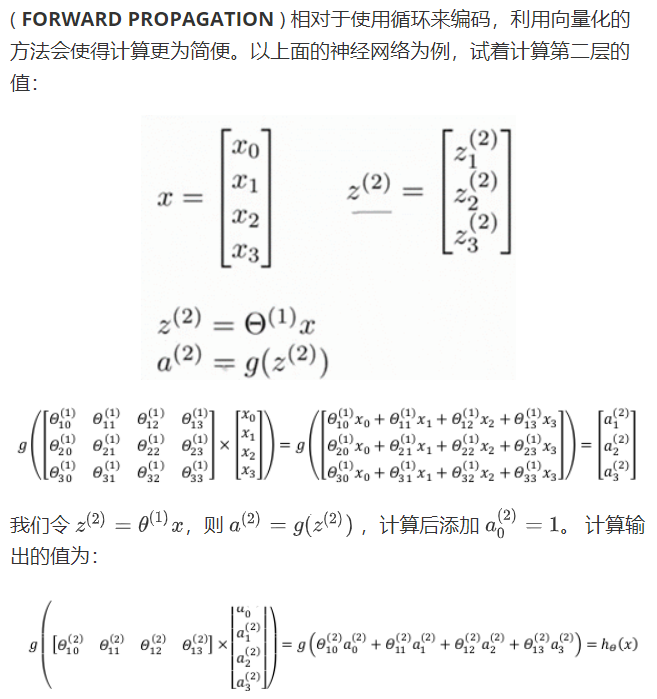

神经网络模型建立在很多神经元之上,每个神经元又是一个学习模型,这些神经元(也叫激活单元)采纳一些特征作为输入,并且根据本身的模型提供一个输出。下图是一个以逻辑回归模型作为自身学习模型的神经元案例,在神经网络中,参数又可被称为权重。

其中x0,x1这些是输入特征,假设函数h是和逻辑回归的假设函数形式一样的S型函数。

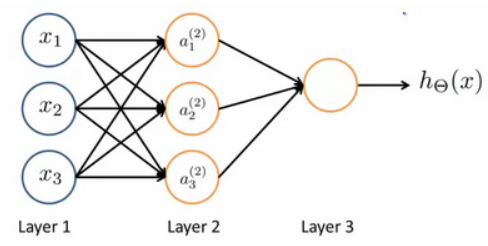

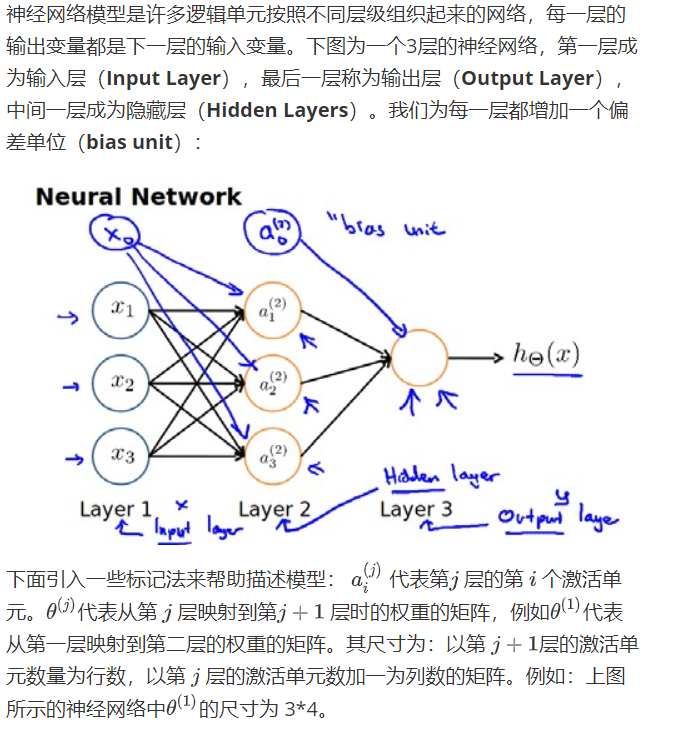

我们设计出了类似于神经元的神经网络,效果如下:

其中x1,x2,x3是输入单元,我们将原始数据输入给他,a1,a2,a3是中间单元,他们负责将数据进行处理然后呈递给下一层。最后是输出层,他负责计算h

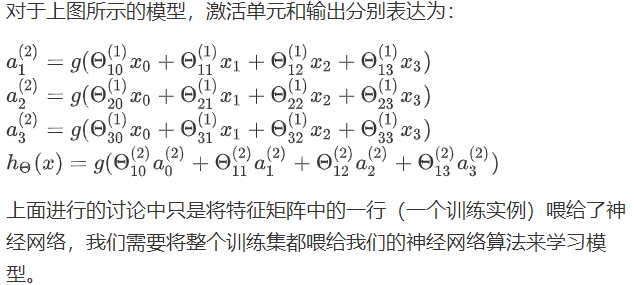

注意:例如 表示的是第一层即输入层到第二层的映射参数,下标10表示两个直接相连的逻辑单元,即1代表第二层中的第一个神经元,0表示第一层中的偏差单位。所以要注意下标中左边的数字代表目的层中的单元,右边的数字代表出发层的单元。(这个地方开始傻了,听课时没听清,到后边课才反应过来)

表示的是第一层即输入层到第二层的映射参数,下标10表示两个直接相连的逻辑单元,即1代表第二层中的第一个神经元,0表示第一层中的偏差单位。所以要注意下标中左边的数字代表目的层中的单元,右边的数字代表出发层的单元。(这个地方开始傻了,听课时没听清,到后边课才反应过来)

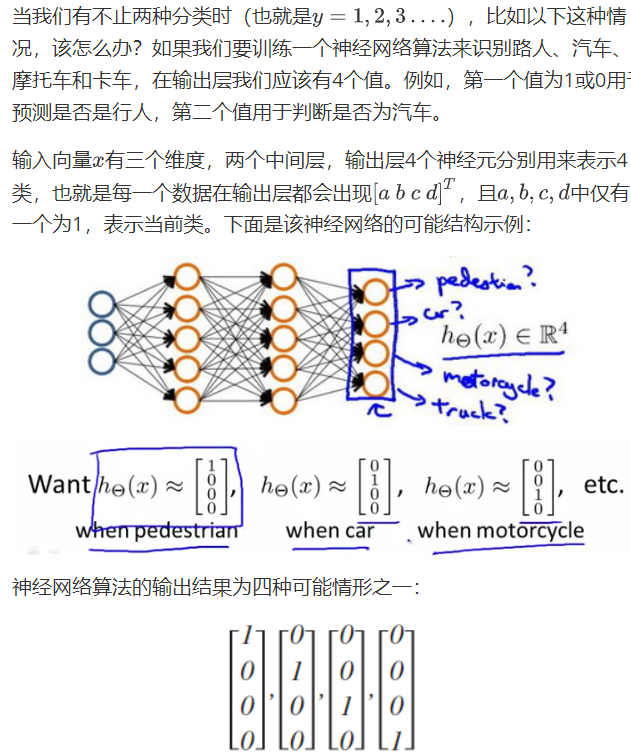

2、多分类

以上就是课时八的内容,因为课程内容多为理解记忆的东西,且需要很多图做辅助,所以本节笔记大多来自“机器学习初学者”网站提供的吴恩达老师的2014机器学习课程笔记http://www.ai-start.com/