本文由LeftNotEasy全部,公布于http://leftnoteasy.cnblogs.com。假设转载,请注明出处,在未经作者允许下将本文用于商业用途,将追究其法律责任。

本文由LeftNotEasy全部,公布于http://leftnoteasy.cnblogs.com。假设转载,请注明出处,在未经作者允许下将本文用于商业用途,将追究其法律责任。

前言:

上次写过一篇关于贝叶斯概率论的数学,近期时间比較紧,coding的任务比較重,只是还是抽出时间看了一些机器学习的书和视频,当中非常推荐两个:一个是 stanford的machine learning公开课,在verycd可下载,可惜没有翻译。只是还是能够看。另外一个是prml-pattern recognition and machine learning, Bishop的一部反响不错的书,并且是2008年的,算是比較新的一本书了。

前几天还准备写一个分布式计算的系列,仅仅写了个开头,又换到写这个系列了。以后看哪边的心得很多其它,就写哪一个系列吧。近期干的事情比較杂,有跟机器学习相关的,有跟数学相关的,也有跟分布式相关的。

这个系列主要想可以用数学去描写叙述机器学习,想要学好机器学习,首先得去理解当中的数学意义,不一定要到可以轻松自如的推导中间的公式,只是至少得认识这些 式子吧,不然看一些相关的论文可就看不懂了,这个系列主要将会着重于去机器学习的数学描写叙述这个部分,将会覆盖但不一定局限于回归、聚类、分类等算法。

回归与梯度下降:

回归在数学上来说是给定一个点集,可以用一条曲线去拟合之,假设这个曲线是一条直线,那就被称为线性回归,假设曲线是一条二次曲线,就被称为二次回归,回归还有非常多的变种,如locally weighted回归,logistic回归,等等,这个将在后面去讲。

用一个非常easy的样例来说明回归,这个样例来自非常多的地方,也在非常多的open source的软件中看到,比方说weka。大概就是,做一个房屋价值的评估系统,一个房屋的价值来自非常多地方,比方说面积、房间的数量(几室几厅)、地 段、朝向等等,这些影响房屋价值的变量被称为特征(feature),feature在机器学习中是一个非常重要的概念,有非常多的论文专门探讨这个东西。在 此处,为了简单,如果我们的房屋就是一个变量影响的,就是房屋的面积。

如果有一个房屋销售的数据例如以下:

面积(m^2) 销售价钱(万元)

123 250

150 320

87 160

102 220

… …

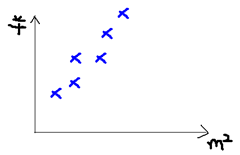

这个表类似于帝都5环左右的房屋价钱,我们能够做出一个图,x轴是房屋的面积。y轴是房屋的售价,例如以下:

如果来了一个新的面积,如果在销售价钱的记录中没有的,我们怎么办呢?

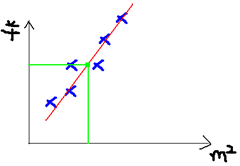

我们能够用一条曲线去尽量准的拟合这些数据,然后假设有新的输入过来,我们能够在将曲线上这个点相应的值返回。假设用一条直线去拟合,可能是以下的样子:

绿色的点就是我们想要预測的点。

首先给出一些概念和经常使用的符号,在不同的机器学习书籍中可能有一定的区别。

房屋销售记录表 - 训练集(training set)或者训练数据(training data), 是我们流程中的输入数据,一般称为x

房屋销售价钱 - 输出数据,一般称为y

拟合的函数(或者称为如果或者模型),一般写做 y = h(x)

训练数据的条目数(#training set), 一条训练数据是由一对输入数据和输出数据组成的

输入数据的维度(特征的个数,#features),n

以下是一个典型的机器学习的过程,首先给出一个输入数据,我们的算法会通过一系列的过程得到一个预计的函数,这个函数有能力对没有见过的新数据给出一个新的预计,也被称为构建一个模型。就如同上面的线性回归函数。

我们用X1,X2..Xn 去描写叙述feature里面的分量,比方x1=房间的面积,x2=房间的朝向,等等,我们能够做出一个预计函数:

θ在这儿称为參数,在这儿的意思是调整feature中每一个分量的影响力,就是究竟是房屋的面积更重要还是房屋的地段更重要。为了假设我们令X0 = 1,就能够用向量的方式来表示了:

我们程序也须要一个机制去评估我们θ是否比較好,所以说须要对我们做出的h函数进行评估,一般这个函数称为损失函数(loss function)或者错误函数(error function),描写叙述h函数不好的程度,在以下,我们称这个函数为J函数

在这儿我们能够做出以下的一个错误函数:

这个错误预计函数是去对x(i)的预计值与真实值y(i)差的平方和作为错误预计函数,前面乘上的1/2是为了在求导的时候,这个系数就不见了。

怎样调整θ以使得J(θ)取得最小值有非常多方法,当中有最小二乘法(min square),是一种全然是数学描写叙述的方法,在stanford机器学习开放课最后的部分会推导最小二乘法的公式的来源,这个来非常多的机器学习和数学书 上都能够找到,这里就不提最小二乘法,而谈谈梯度下降法。

梯度下降法是按以下的流程进行的:

1)首先对θ赋值,这个值能够是随机的,也能够让θ是一个全零的向量。

2)改变θ的值,使得J(θ)按梯度下降的方向进行降低。

为了更清楚,给出以下的图:

这是一个表示參数θ与误差函数J(θ)的关系图,红色的部分是表示J(θ)有着比較高的取值,我们须要的是,可以让J(θ)的值尽量的低。也就是深蓝色的部分。θ0,θ1表示θ向量的两个维度。

这是一个表示參数θ与误差函数J(θ)的关系图,红色的部分是表示J(θ)有着比較高的取值,我们须要的是,可以让J(θ)的值尽量的低。也就是深蓝色的部分。θ0,θ1表示θ向量的两个维度。

在上面提到梯度下降法的第一步是给θ给一个初值,如果随机给的初值是在图上的十字点。

然后我们将θ依照梯度下降的方向进行调整,就会使得J(θ)往更低的方向进行变化,如图所看到的,算法的结束将是在θ下降到无法继续下降为止。

当然,可能梯度下降的终于点并不是是全局最小点,可能是一个局部最小点,可能是以下的情况:

当然,可能梯度下降的终于点并不是是全局最小点,可能是一个局部最小点,可能是以下的情况:

上面这张图就是描写叙述的一个局部最小点,这是我们又一次选择了一个初始点得到的,看来我们这个算法将会在非常大的程度上被初始点的选择影响而陷入局部最小点

以下我将用一个样例描写叙述一下梯度降低的过程,对于我们的函数J(θ)求偏导J:(求导的过程假设不明确,能够温习一下微积分)

以下是更新的过程,也就是θi会向着梯度最小的方向进行降低。θi表示更新之前的值,-后面的部分表示按梯度方向降低的量,α表示步长,也就是每次依照梯度降低的方向变化多少。

一个非常重要的地方值得注意的是,梯度是有方向的,对于一个向量θ,每一维分量θi都能够求出一个梯度的方向,我们就能够找到一个总体的方向,在变化的时候,我们就朝着下降最多的方向进行变化就能够达到一个最小点,无论它是局部的还是全局的。

一个非常重要的地方值得注意的是,梯度是有方向的,对于一个向量θ,每一维分量θi都能够求出一个梯度的方向,我们就能够找到一个总体的方向,在变化的时候,我们就朝着下降最多的方向进行变化就能够达到一个最小点,无论它是局部的还是全局的。

用更简单的数学语言进行描写叙述步骤2)是这种: