坑:

在虚拟机上开启cdh 5.8.2集群后,在linux客户端使用 spark-shell 命令开启spark shell时候报错:

[root@master conf]# spark-shell Exception in thread "main" java.lang.NoClassDefFoundError: org/apache/hadoop/fs/FSDataInputStream at org.apache.spark.deploy.SparkSubmitArguments$$anonfun$mergeDefaultSparkProperties$1.apply(SparkSubmitArguments.scala:117) at org.apache.spark.deploy.SparkSubmitArguments$$anonfun$mergeDefaultSparkProperties$1.apply(SparkSubmitArguments.scala:117) at scala.Option.getOrElse(Option.scala:120) at org.apache.spark.deploy.SparkSubmitArguments.mergeDefaultSparkProperties(SparkSubmitArguments.scala:117) at org.apache.spark.deploy.SparkSubmitArguments.<init>(SparkSubmitArguments.scala:103) at org.apache.spark.deploy.SparkSubmit$.main(SparkSubmit.scala:114) at org.apache.spark.deploy.SparkSubmit.main(SparkSubmit.scala) Caused by: java.lang.ClassNotFoundException: org.apache.hadoop.fs.FSDataInputStream at java.net.URLClassLoader.findClass(URLClassLoader.java:381) at java.lang.ClassLoader.loadClass(ClassLoader.java:424) at sun.misc.Launcher$AppClassLoader.loadClass(Launcher.java:331) at java.lang.ClassLoader.loadClass(ClassLoader.java:357) ... 7 more

启动spark失败。网上找到的解决办法:

从spark1.4以后,所有spark的编译都是没有将hadoop的classpath编译进去的,所以必须在spark-env.sh中指定hadoop中的所有jar包。

具体设置如下:

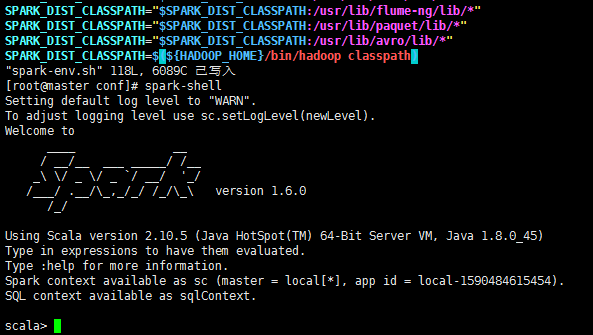

在spark/conf文件下spark-evn.sh中添加 (cdh中默认的配置文件在 /etc/spark/conf 路径下),有些带export,我不带也可以

这里实际上就是执行一条hadoop的命令,将hadoop的classpath引一下

SPARK_DIST_CLASSPATH=$(${HADOOP_HOME}/bin/hadoop classpath)

重启spark后,启动spark-shell

成功启动

但是此种方式,仅仅在master节点上修改了配置文件。故只能在master这台机上启动spark-shell,如果其它机器也能启动spark-shell需要每台都是如此配置。所以仅仅是在单节点上有效。