https://www.bilibili.com/video/BV184411Q7Ng?p=71

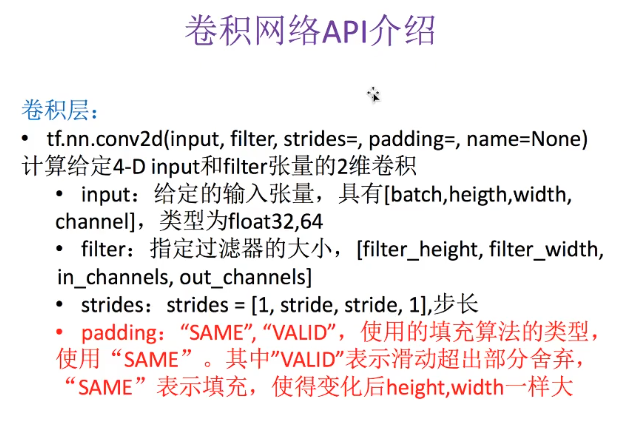

- 有多少个(对于3通道彩色图像来说,是组)filter,图像的输出通道数就是多少。

- 步长是1是为了观测更仔细。

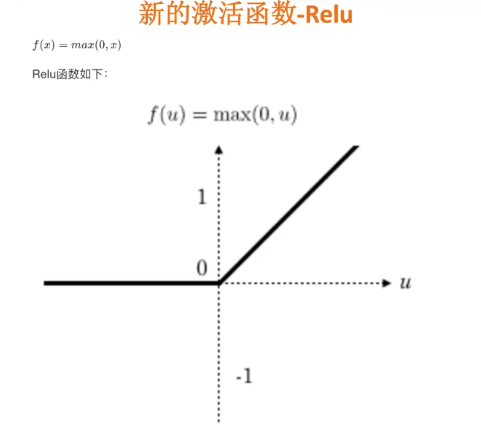

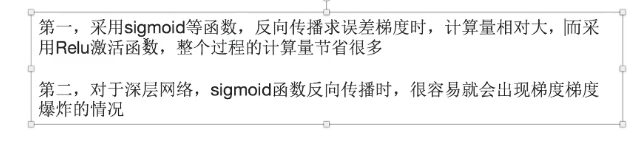

卷积神经网络为何不使用之前的sigmoid()函数,而要适用新的relu激活函数呢?

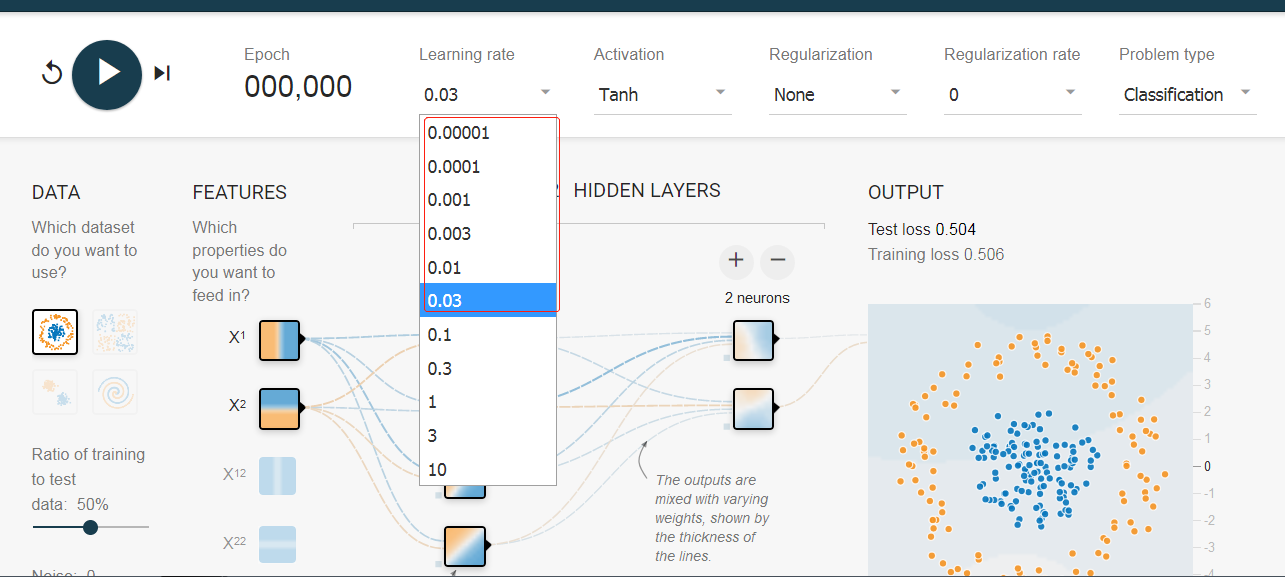

一个卷积神经网络进行分类的例子:

http://playground.tensorflow.org/#activation=tanh&batchSize=10&dataset=circle®Dataset=reg-plane&learningRate=0.03®ularizationRate=0&noise=0&networkShape=4,2&seed=0.37196&showTestData=false&discretize=false&percTrainData=50&x=true&y=true&xTimesY=false&xSquared=false&ySquared=false&cosX=false&sinX=false&cosY=false&sinY=false&collectStats=false&problem=classification&initZero=false&hideText=false

注解:

- 学习率一般选红色方框中的那些。

注解:

- 激活函数选择Linear,意味着没有激活函数。

- 没有激活函数,迭代次数再多,也无法完成分类。

- 增加一个激活函树,就相当于增加一个非线性分割的能力。

注解:

- 引起梯度爆炸的两种情况:1.学习率大。2.使用sigmoid函数。

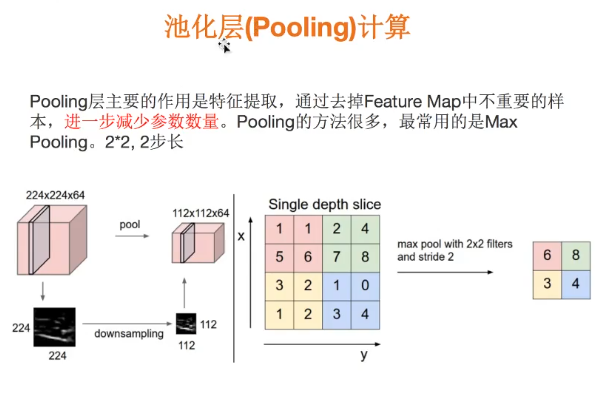

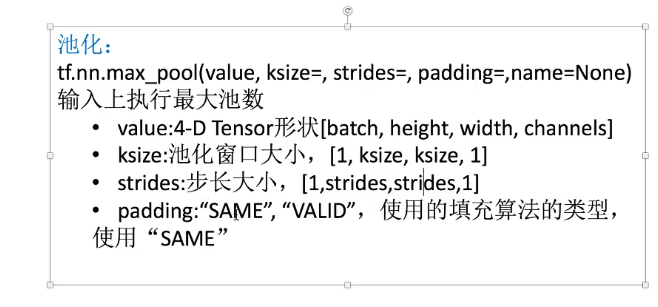

很多的filter会让图像的通道数或者说特征变得很多,所以需要池化层抵消掉这样的结局。

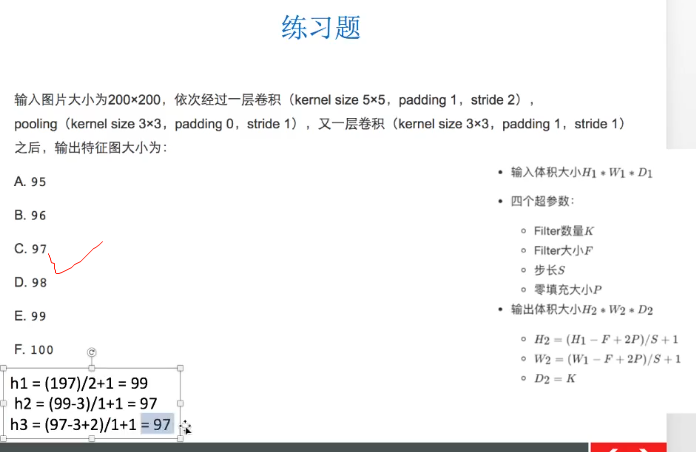

感觉这个答案应该是B