注解:

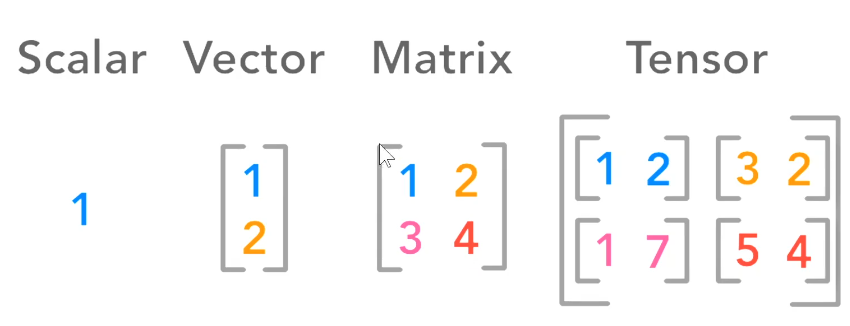

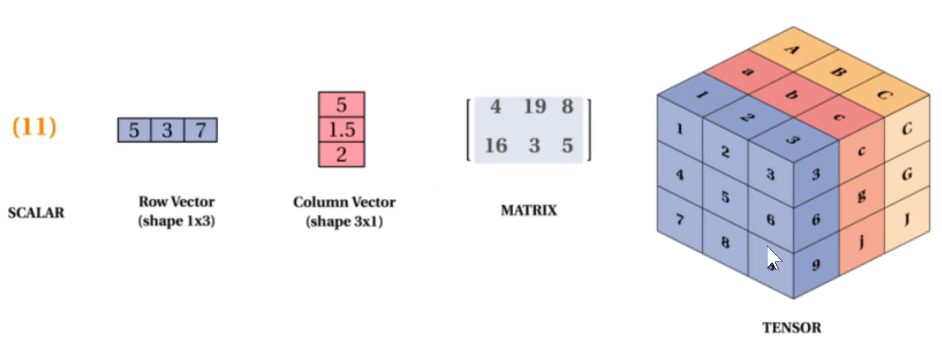

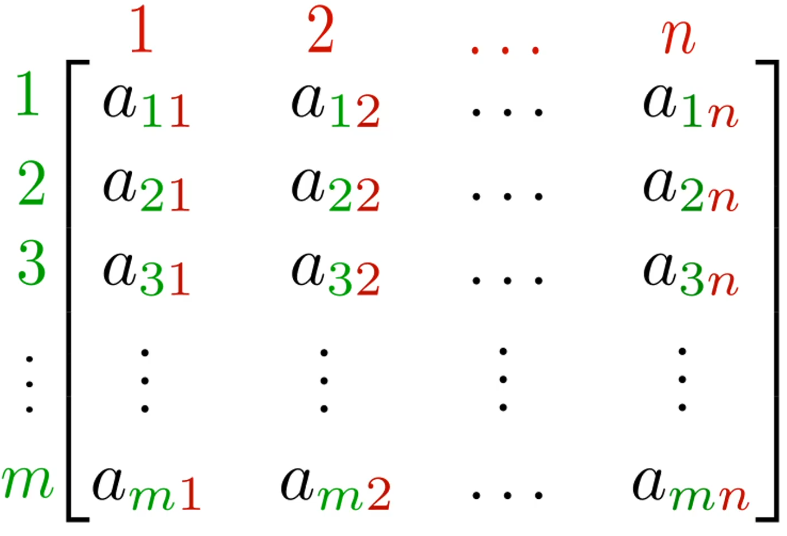

- 张量----一个四方块代表一个数字

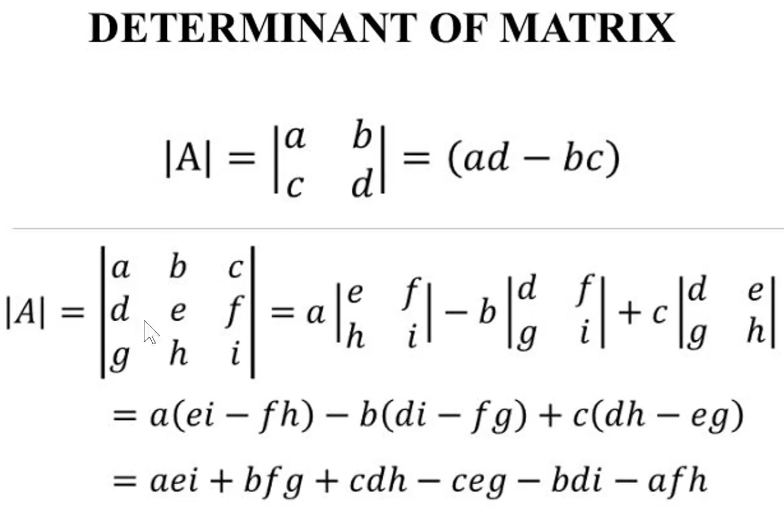

矩阵:

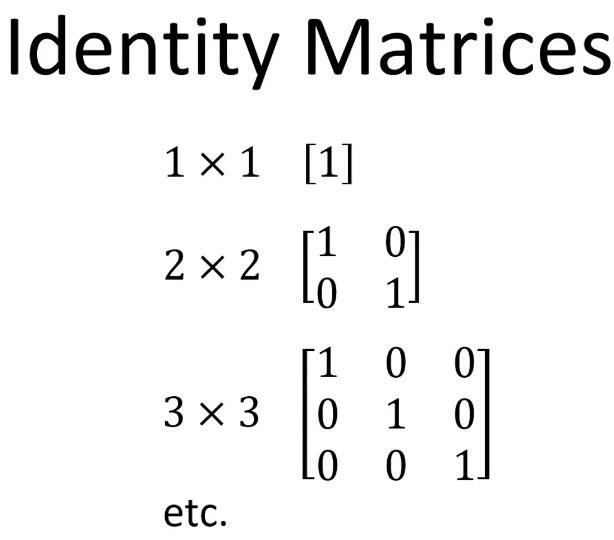

单位矩阵:

注解:

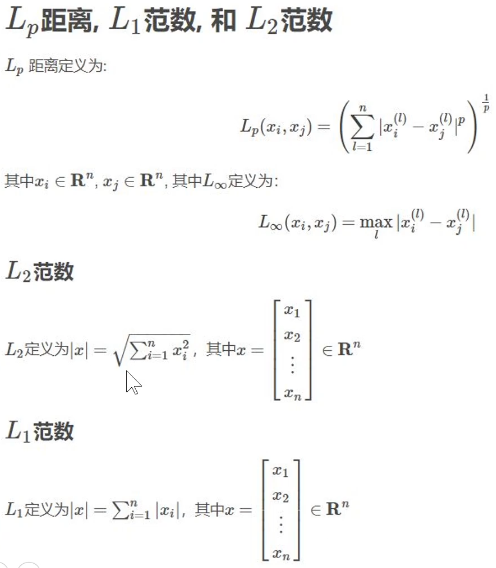

- L1范也叫曼哈顿距离、街区距离。

- 2范L2,也叫欧式距离。Lp中P=2的情况。

- p是无穷大,是切比雪夫距离。

- 各种各样的范数是闵可夫斯基距离取不同值的特例。

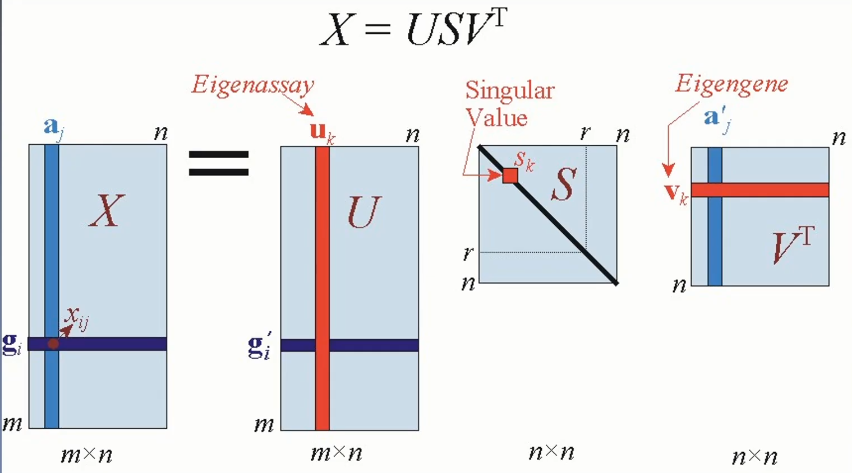

矩阵的分解是把一个矩阵分解成几个矩阵的乘积。

left singular vector of A:左奇异值

singular vector of A:奇异值本身

right singular vector of A:右奇异值

矩阵A分解成3个矩阵的乘积:

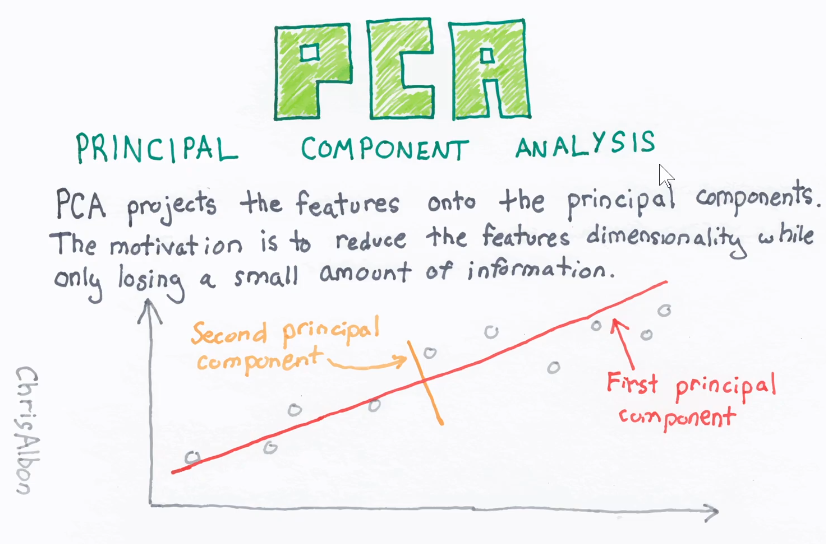

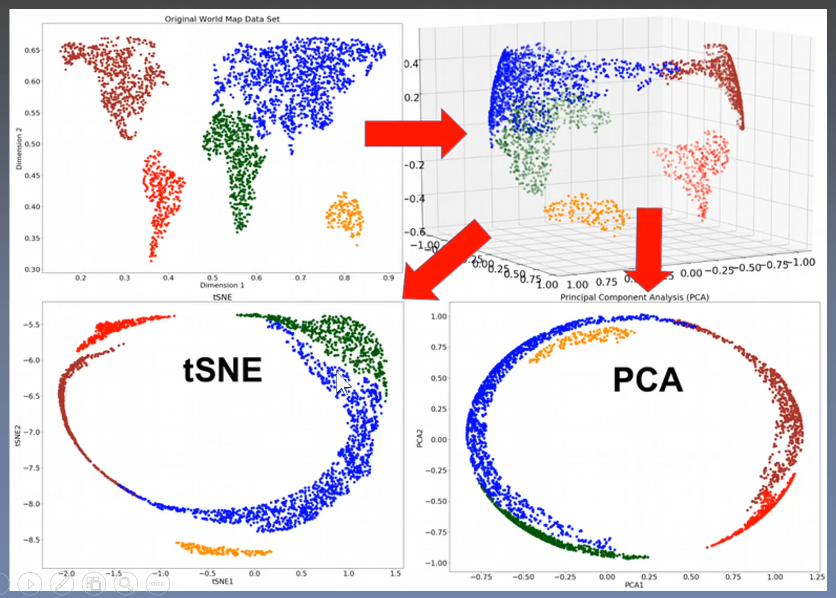

主成分分析:一种线性降维的算法,把高维空间的数据映射到低维。

下例是把二维的数据映射到一维空间上。二维数据映射到直线上。

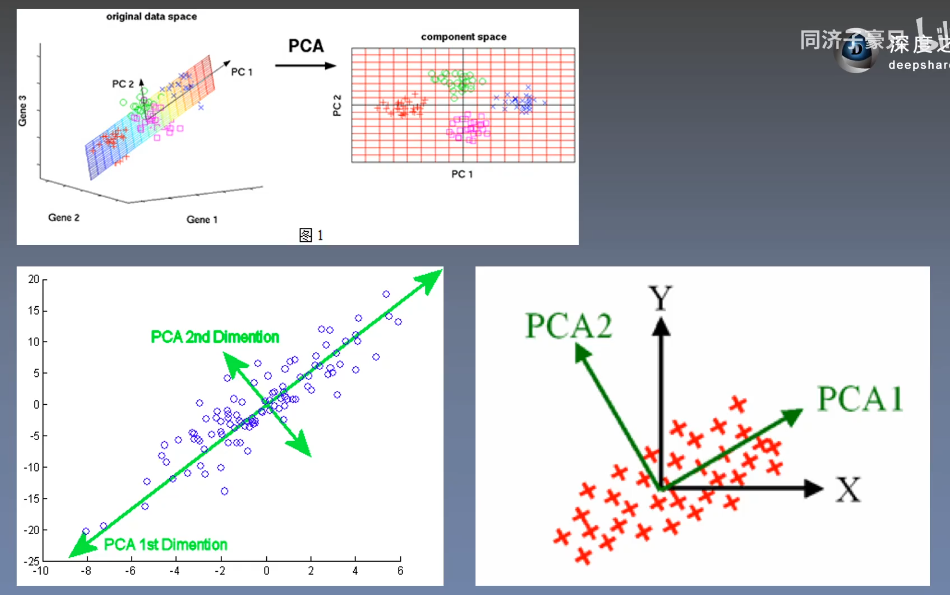

主成分分析就是在降维的过程中找到一个映射的主方向,从而最大程度的保留高维空间信息。比如把一个人从三维拍成二维,从左往右拍还是从前往后拍能最大程度的保留三维信息呢?答案显然是后者。

例子中,红色的线是第一主成分,跟红色的线正交的黄色的线称为第二主成分。把二维散点拍到那条红色直线上,就能最大程度的保留它们在二维空间中的信息。

也可以把三维数据拍到二维数据上,或者把4维数据拍到3维、2维数据上。关键是要找到第一主成分和第二主成分,第1主成分和第2主成分对应的是协方差矩阵的特征值和特征向量。

PCA属于线性降维。

tSNE属于非线性降维。【数据在高维空间中隔的比较远,在低维度空间中隔的也应该比较远,数据在高维空间中隔的比较近,在低维度空间中隔的也应该比较近】