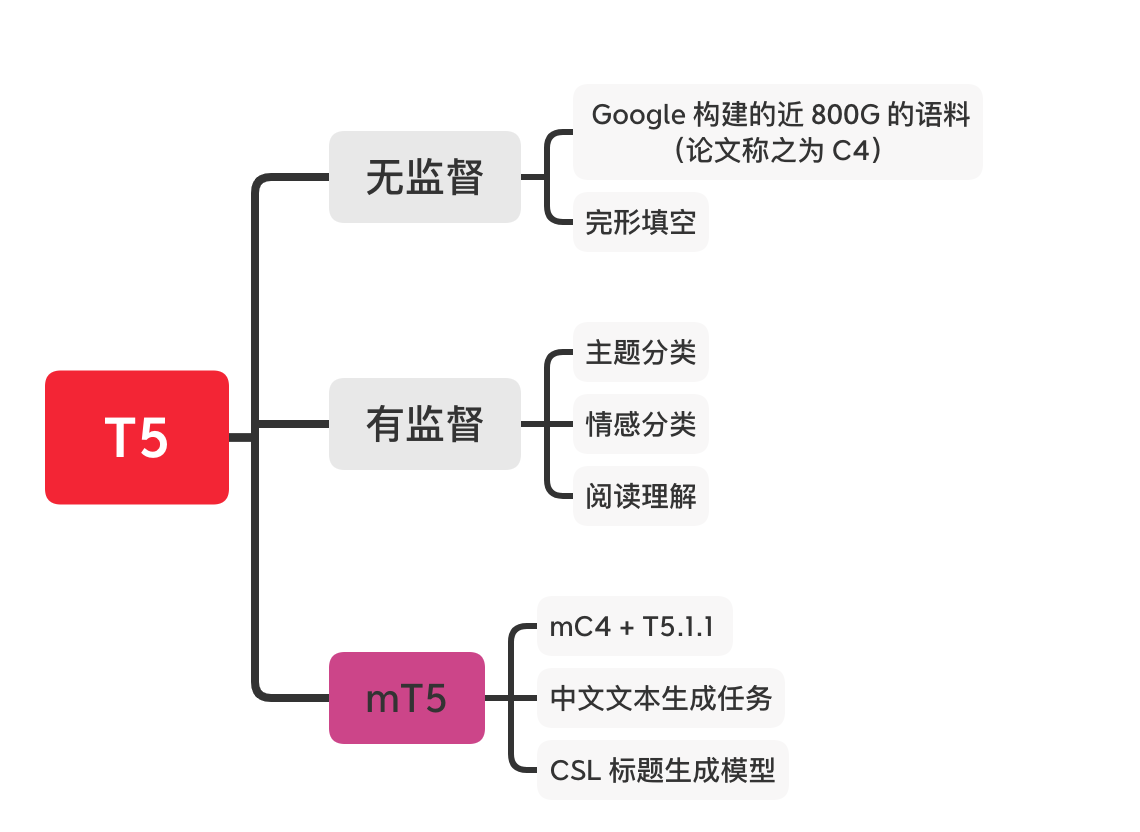

谷歌2019年发布的模型, 110 亿参数,一举刷新了GLUE、SuperGLUE 等多个 NLP 榜单的模型。

- mT5,即 Multilingual T5,是 T5 的多国语言版。

- mT5 跟 T5 一脉相承,整体基本一样,但在模型结构方面,mT5 用的是 T5.1.1方案。

- mT5 其实就是重新构建了多国语言版的数据集 mC4,然后使用 T5.1.1 方案训练了一波

- C4 是 Google 构建的近 800G 的语料

- 用 mT5 small 版本 finetune 出来的 CSL 标题生成模型,BLEU 指标能持平基于 WoBERT 的 UniLM 模型,并且解码速度快 130%;

- 而用 mT5 base 版本 finetune 出来的 CSL 标题生成模型,指标能超过基于 WoBERT 的 UniLM 模型 1% 以上,并且解码速度也能快 60%。