1 关于张量的四种定义

“张量”在不同的运用场景下有不同的定义。

第一个定义,张量是多维数组,这个定义常见于各种人工智能软件。听起来还好理解。--本文仅解释此种

2 多维数组

从第一个定义:张量是多维数组开始。

现在机器学习很火,知名开源框架tensor-flow是这么定义tensor(张量)的:

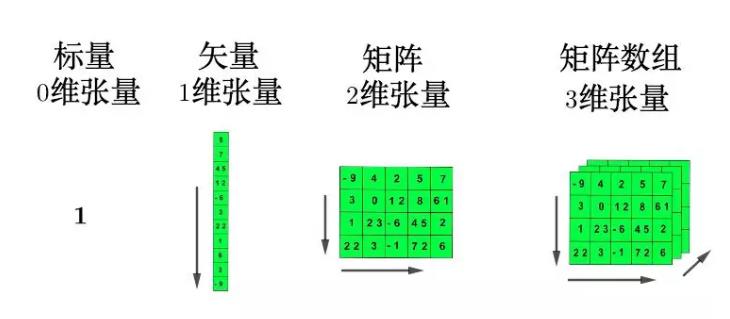

A tensor is a generalization of vectors and matrices to potentially higher dimensions

也就是说,张量(tensor)是多维数组,目的是把向量、矩阵推向更高的维度。

更具体点,也即是说:

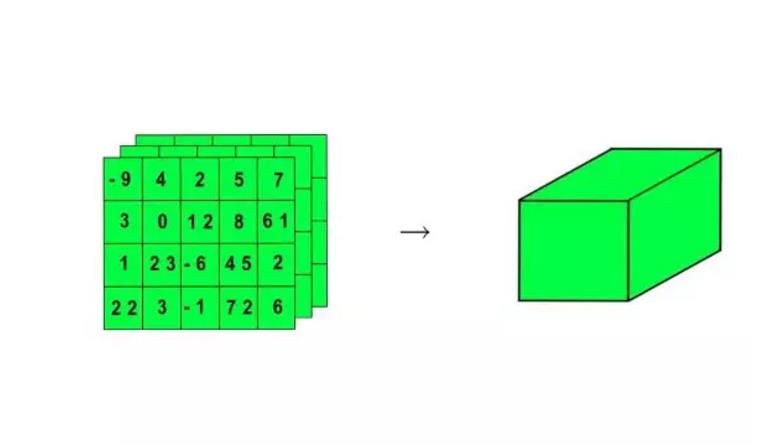

把三维张量画成一个立方体:

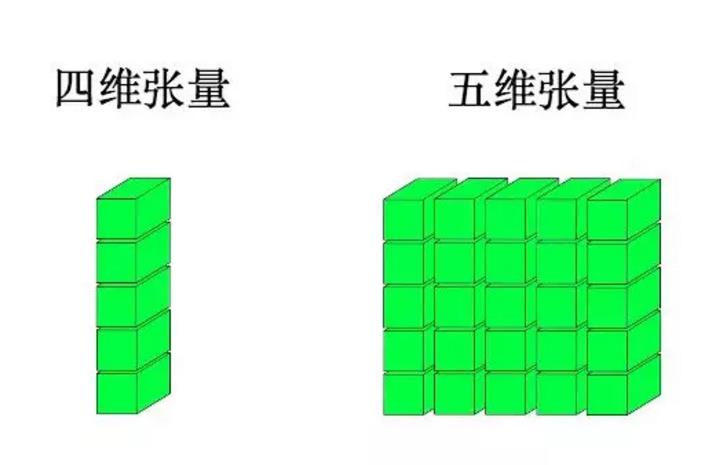

我们就可以进一步画出更高维的张量:

从数据结构上来看,张量就是多维数组。

这个定义本身没有错,但是没有真正反映张量的核心,但在机器学习中这样理解足够了

针对此理解,可参考:TensorFlow 基本使用 https://blog.csdn.net/goodshot/article/details/79677844

python 中 np.sum()函数 通俗易懂理解!(在tf中,sum跟np.num()使用axis方式相同了)

https://blog.csdn.net/goodshot/article/details/79506812