以每个像素为中心生成多个大小和宽高比(aspect ratio)不同的边界框。这些边界框被称为锚框(anchor box)

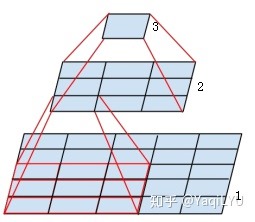

在卷积神经网络中,感受野(Receptive Field)的定义是卷积神经网络每一层输出的特征图(feature map)上的像素点在输入图片上映射的区域大小。再通俗点的解释是,特征图上的一个点对应输入图上的区域,如图所示

卷积神经网络层数越多,感受野也就越大

第2层左下角的值,是第1层左下红框中3x3区域的值经过卷积,也就是乘加运算计算出来的,即第2层左下角位置的感受野是第1层左下红框区域

第3层唯一值,是第2层所有3x3区域卷积得到的,即第3层唯一位置的感受野是第2层所有3x3区域

第3层唯一值,是第1层所有5x5区域经过两层卷积得到的,即第3层唯一位置的感受野是第1层所有5x5区域

某一层feature map(特性图)中某个位置的特征向量,是由前面某一层固定区域的输入计算出来的,那这个区域就是这个位置的感受野

Anchor box 与 感受野

感受野应该跟anchor大小相匹配,感受野比anchor大太多不好,小太多也不好。如果感受野比anchor小很多,就好比只给你一只脚,让你说出这是什么鸟一样。如果感受野比anchor大很多,则好比给你一张世界地图,让你指出故宫在哪儿一样

例:在YOLOv3中

YOLOv3通过聚类算法得到了3组anchor box(即:预训练得到的默认边界框),目标检测器通过预测对数空间(log-space)变换来确定边界框。

YOLOv3 的先验框anchor box一共有3组共9个,由k-means聚类得到。在COCO数据集上,这9个先验框按不同尺寸特征图分组如下,每组3个:

13x13特征图对应:【(116*90),(156*198),(373*326)】

26x26特征图对应:【(30*61),(62*45),(59*119)】

52x52特征图对应:【(10*13),(16*30),(33*23)】

特征图越小,感受野越大,对大目标越敏感,所以选用大的anchor box;特征图越大,感受野越小,对小目标越敏感,所以选用小的anchor box。

【感受野大 --> 大的anchor box】

【感受野小 --> 小的anchor box】