实验二 K-近邻算法及应用

| 作业属于课程 | 机器学习实验—计算机18级 |

|---|---|

| 作业要求链接 | 实验二 K-近邻算法及应用 |

| 学号 | 3180701110 |

【实验目的】

1.理解K-近邻算法原理,能实现算法K近邻算法;

2.掌握常见的距离度量方法;

3.掌握K近邻树实现算法;

4.针对特定应用场景及数据,能应用K近邻解决实际问题。

【实验内容】

1.实现曼哈顿距离、欧氏距离、闵式距离算法,并测试算法正确性。

2.实现K近邻树算法;

3.针对iris数据集,应用sklearn的K近邻算法进行类别预测。

4.针对iris数据集,编制程序使用K近邻树进行类别预测。

【算法及测试结果】

K近邻法是基本且简单的分类与回归方法。K近邻法的基本做法是:对给定的训练实例点和输入实例点,首先确定输入实例点的K个最近邻训练实例点,然后利用这K个训练实例点的类的多数来预测输入实例点的类。

曼哈顿距离、欧氏距离、闵式距离算法

#导数学模块.itertools模块包含创建有效迭代器的的函数:combinations

import math

from itertools import combinations

def L(x, y, p=2):

# x1 = [1, 1], x2 = [5,1]

if len(x) == len(y) and len(x) > 1:

sum = 0

for i in range(len(x)):

sum += math.pow(abs(x[i] - y[i]), p)

return math.pow(sum, 1 / p)

else:

return 0

#输入

x1 = [1, 1]

x2 = [5, 1]

x3 = [4, 4]

#计算x1与x2和x3之间的距离

for i in range(1, 5):#用range函数依次给i赋值整数1~4

r = {'1-{}'.format(c): L(x1, c, p=i) for c in [x2, x3]}#创建字典

print(min(zip(r.values(), r.keys())))#输出p=i时,x2和x3中距离x1最近的点

结果截图

K近邻树算法

python 实现,遍历所有数据点,找出n个距离最近的点的分类情况,少数服从多数

#导入模块

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

%matplotlib inline

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from collections import Counter

# data输入

iris = load_iris() //获取Iris数据集

df = pd.DataFrame(iris.data, columns=iris.feature_names)#建表

df['label'] = iris.target //将表的最后一列作为目标列

df.columns = ['sepal length', 'sepal width', 'petal length', 'petal width', 'label']#定义表中每一列

# data = np.array(df.iloc[:100, [0, 1, -1]])

df#打印表

结果截图

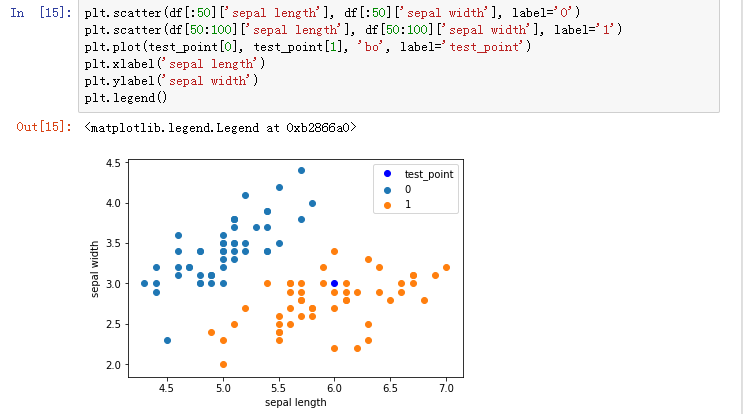

#散点图

plt.scatter(df[:50]['sepal length'], df[:50]['sepal width'], label='0') //绘制前50个数据的散点图

plt.scatter(df[50:100]['sepal length'], df[50:100]['sepal width'], label='1') //绘制50-100个数据的散点图

plt.xlabel('sepal length')

plt.ylabel('sepal width') //设置x,y轴坐标名

plt.legend() //绘图

结果截图

data = np.array(df.iloc[:100, [0, 1, -1]]) //iloc函数:通过行号来取行数据,读取数据前100行的第0,1列和最后一列

X, y = data[:,:-1], data[:,-1] //X为data数据集中去除最后一列所形成的新数据集,y为data数据集中最后一列数据所形成的新数据集

# 选取训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2) //train_test_split函数用于将矩阵随机划分为训练子集和测试子集

#建立一个类KNN,用于k-近邻的计算

class KNN:

# 初始化

def __init__(self, X_train, y_train, n_neighbors=3, p=2):#初始化数据,neighbor表示邻近点,p为欧氏距离

self.n = n_neighbors

self.p = p

self.X_train = X_train

self.y_train = y_train

def predict(self, X):

#取出n个点,放入空的列表,列表中存放预测点与训练集点的距离及其对应标签

knn_list = []

for i in range(self.n):#遍历邻近点

dist = np.linalg.norm(X - self.X_train[i], ord=self.p)#计算训练集和测试集之间的距离

knn_list.append((dist, self.y_train[i]))

#保证knn_list列表中的点是距离最小的点

for i in range(self.n, len(self.X_train)):

'''max(num,key=lambda x: x[0])用法:

x:x[]字母可以随意修改,求最大值方式按照中括号[]里面的维度,

[0]按照第一维,

[1]按照第二维

'''

max_index = knn_list.index(max(knn_list, key=lambda x: x[0])) //找出列表中距离最大的点

dist = np.linalg.norm(X - self.X_train[i], ord=self.p) //计算训练集和测试集之间的距离

if knn_list[max_index][0] > dist: //若当前数据的距离大于之前得出的距离,就将数值替换

knn_list[max_index] = (dist, self.y_train[i])

#统计

knn = [k[-1] for k in knn_list]

count_pairs = Counter(knn) //统计标签的个数

max_count = sorted(count_pairs, key=lambda x:x)[-1] //将标签升序排列

return max_count

#计算测试算法的正确率

def score(self, X_test, y_test):

right_count = 0

n = 10

for X, y in zip(X_test, y_test):

label = self.predict(X)

if label == y:

right_count += 1

return right_count / len(X_test)

clf = KNN(X_train, y_train)#调用KNN算法进行计算

clf.score(X_test, y_test)#计算正确率

结果截图

test_point = [6.0, 3.0]

print('Test Point: {}'.format(clf.predict(test_point)))

结果截图

plt.scatter(df[:50]['sepal length'], df[:50]['sepal width'], label='0')

plt.scatter(df[50:100]['sepal length'], df[50:100]['sepal width'], label='1')

plt.plot(test_point[0], test_point[1], 'bo', label='test_point')

plt.xlabel('sepal length')

plt.ylabel('sepal width')

plt.legend()

结果截图

scikit-learn 实例(针对iris数据集,应用sklearn的K近邻算法进行类别预测)

# 导包

from sklearn.neighbors import KNeighborsClassifier

# 调用

clf_sk = KNeighborsClassifier()

clf_sk.fit(X_train, y_train)

结果截图

clf_sk.score(X_test, y_test) //计算正确率

结果截图

针对iris数据集,编制程序使用K近邻树进行类别预测

kd树是一种对 k 维空间中的实例点进行存储以便对其进行快速检索的树形数据结构。

kd树是二叉树,表示对维空间的一个划分(partition)。构造kd树相当于不断地用垂直于坐标轴的超平面将维空间切分,构成一系列的 k 维超矩形区域。kd 树的每个结点对应于一个维超矩形区域。

构造kd树的方法如下:

构造根结点,使根结点对应于维空间中包含所有实例点的超矩形区域;通过下面的递归方法,不断地对维空间进行切分,生成子结点。在超矩形区域(结点)上选择一个坐标轴和在此坐标轴上的一个切分点,确定一个超平面,这个超平面通过选定的切分点并垂直于选定的坐标轴,将当前超矩形区域切分为左右两个子区域 (子结点);这时,实例被分到两个子区域。这个过程直到子区域内没有实例时终止(终止时的结点为叶结点)。在此过程中,将实例保存在相应的结点上。

通常,依次选择坐标轴对空间切分,选择训练实例点在选定坐标轴上的中位数 (median)为切分点,这样得到的kd树是平衡的。注意,平衡的kd树搜索时的效率未必是最优的。

# kd-tree每个结点中主要包含的数据结构如下

class KdNode(object):

def __init__(self, dom_elt, split, left, right):

self.dom_elt = dom_elt # k维向量节点(k维空间中的一个样本点)

self.split = split # 整数(进行分割维度的序号)

self.left = left # 该结点分割超平面左子空间构成的kd-tree

self.right = right # 该结点分割超平面右子空间构成的kd-tree

class KdTree(object):

def __init__(self, data):

k = len(data[0]) # 数据维度

def CreateNode(split, data_set): # 按第split维划分数据集exset创建KdNode

if not data_set: # 数据集为空

return None

# key参数的值为一个函数,此函数只有一个参数且返回一个值用来进行比较

# operator模块提供的itemgetter函数用于获取对象的哪些维的数据,参数为需要获取的数据在对象中的序号

#data_set.sort(key=itemgetter(split)) # 按要进行分割的那一维数据排序

data_set.sort(key=lambda x: x[split])

split_pos = len(data_set) // 2 # //为Python中的整数除法

median = data_set[split_pos] # 中位数分割点

split_next = (split + 1) % k # cycle coordinates

# 递归的创建kd树

return KdNode(

median,

split,

CreateNode(split_next, data_set[:split_pos]), # 创建左子树

CreateNode(split_next, data_set[split_pos + 1:])) # 创建右子树

self.root = CreateNode(0, data) # 从第0维分量开始构建kd树,返回根节点

# KDTree的前序遍历

def preorder(root):

print(root.dom_elt)

if root.left: # 节点不为空

preorder(root.left)

if root.right:

preorder(root.right)

# 对构建好的kd树进行搜索,寻找与目标点最近的样本点:

from math import sqrt

from collections import namedtuple

# 定义一个namedtuple,分别存放最近坐标点、最近距离和访问过的节点数

result = namedtuple("Result_tuple",

"nearest_point nearest_dist nodes_visited")

def find_nearest(tree, point):

k = len(point) # 数据维度

def travel(kd_node, target, max_dist):

if kd_node is None:

return result([0] * k, float("inf"),

0) # python中用float("inf")和float("-inf")表示正负无穷

nodes_visited = 1

s = kd_node.split # 进行分割的维度

pivot = kd_node.dom_elt # 进行分割的“轴”

if target[s] <= pivot[s]: # 如果目标点第s维小于分割轴的对应值(目标离左子树更近)

nearer_node = kd_node.left # 下一个访问节点为左子树根节点

further_node = kd_node.right # 同时记录下右子树

else: # 目标离右子树更近

nearer_node = kd_node.right # 下一个访问节点为右子树根节点

further_node = kd_node.left

temp1 = travel(nearer_node, target, max_dist) # 进行遍历找到包含目标点的区域

nearest = temp1.nearest_point # 以此叶结点作为“当前最近点”

dist = temp1.nearest_dist # 更新最近距离

nodes_visited += temp1.nodes_visited

if dist < max_dist:

max_dist = dist # 最近点将在以目标点为球心,max_dist为半径的超球体内

temp_dist = abs(pivot[s] - target[s]) # 第s维上目标点与分割超平面的距离

if max_dist < temp_dist: # 判断超球体是否与超平面相交

return result(nearest, dist, nodes_visited) # 不相交则可以直接返回,不用继续判断

#----------------------------------------------------------------------

# 计算目标点与分割点的欧氏距离

temp_dist = sqrt(sum((p1 - p2)**2 for p1, p2 in zip(pivot, target)))

if temp_dist < dist: # 如果“更近”

nearest = pivot # 更新最近点

dist = temp_dist # 更新最近距离

max_dist = dist # 更新超球体半径

# 检查另一个子结点对应的区域是否有更近的点

temp2 = travel(further_node, target, max_dist)

nodes_visited += temp2.nodes_visited

if temp2.nearest_dist < dist: # 如果另一个子结点内存在更近距离

nearest = temp2.nearest_point # 更新最近点

dist = temp2.nearest_dist # 更新最近距离

return result(nearest, dist, nodes_visited)

return travel(tree.root, point, float("inf")) # 从根节点开始递归

例3.2

data = [[2,3],[5,4],[9,6],[4,7],[8,1],[7,2]]

kd = KdTree(data)

preorder(kd.root)

结果截图

from time import clock

from random import random

# 产生一个k维随机向量,每维分量值在0~1之间

def random_point(k):

return [random() for _ in range(k)]

# 产生n个k维随机向量

def random_points(k, n):

return [random_point(k) for _ in range(n)]

结果截图

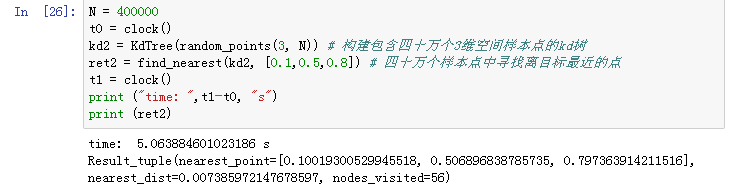

N = 400000

t0 = clock()

kd2 = KdTree(random_points(3, N)) # 构建包含四十万个3维空间样本点的kd树

ret2 = find_nearest(kd2, [0.1,0.5,0.8]) # 四十万个样本点中寻找离目标最近的点

t1 = clock()

print ("time: ",t1-t0, "s")

print (ret2)

结果截图

实验小结

K近邻的优缺点及其应用场景

基本思想是: 在训练集中数据和标签已知的情况下,输入测试数据,将测试数据的特征与训练集中对应的特征进行相互比较,找到训练集中与之最为相似的前K个数据,则该测试数据对应的类别就是K个数据中出现次数最多的那个分类。

由于KNN方法主要靠周围有限的邻近的样本,而不是靠判别类域的方法来确定所属类别的,因此对于类域的交叉或重叠较多的待分样本集来说,KNN方法较其他方法更为适合。KNN算法不仅可以用于分类,还可以用于回归。通过找出一个样本的k个最近邻居,将这些邻居的属性的平均值赋给该样本,就可以得到该样本的属性。更有用的方法是将不同距离的邻居对该样本产生的影响给予不同的权值(weight),如权值与距离成反比。

优点

(1)简单,易于理解,易于实现,无需估计参数。

(2)训练时间为零。它没有显示的训练,不像其它有监督的算法会用训练集train一个模型(也就是拟合一个函数),然后验证集或测试集用该模型分类。KNN只是把样本保存起来,收到测试数据时再处理,所以KNN训练时间为零。

(3)KNN可以处理分类问题,同时天然可以处理多分类问题,适合对稀有事件进行分类。

(4)特别适合于多分类问题(multi-modal,对象具有多个类别标签), KNN比SVM的表现要好。

(5)KNN还可以处理回归问题,也就是预测。

(6)和朴素贝叶斯之类的算法比,对数据没有假设,准确度高,对异常点不敏感。

缺点

(1)计算量太大,尤其是特征数非常多的时候。每一个待分类文本都要计算它到全体已知样本的距离,才能得到它的第K个最近邻点。

(2)可理解性差,无法给出像决策树那样的规则。

(3)是慵懒散学习方法,基本上不学习,导致预测时速度比起逻辑回归之类的算法慢。

(4)样本不平衡的时候,对稀有类别的预测准确率低。当样本不平衡时,如一个类的样本容量很大,而其他类样本容量很小时,有可能导致当输入一个新样本时,该样本的K个邻居中大容量类的样本占多数。

(5)对训练数据依赖度特别大,对训练数据的容错性太差。如果训练数据集中,有一两个数据是错误的,刚刚好又在需要分类的数值的旁边,这样就会直接导致预测的数据的不准确。

应用场景

(1)多分类问题场景

在多分类问题中的k邻法,k邻法的输入为实例的特征向量,对应于特征空间的点,输出为实例的类别。

k邻法假设给定一个训练数据集,其中的实例类别已定,分类时,对新的实例,根据其k个最邻的训练实例的类别,通过多数表决等方式进行预测。因此,k邻法不具有显示的学过程(或者说是一种延迟学),k邻法实际上利用训练数据集对特征向量空间进行划分,并作为其分类的“模型”。

(2)回归问题的场景

KNN算法不仅可以用于分类,还可以用于回归。通过找出一个样本的k个最*邻居,将这些邻居的属性的平均值赋给该样本,就可以得到该样本的属性。

更有用的方法是将不同距离的邻居对该样本产生的影响给予不同的权值(weight),如权值与距离成正比。