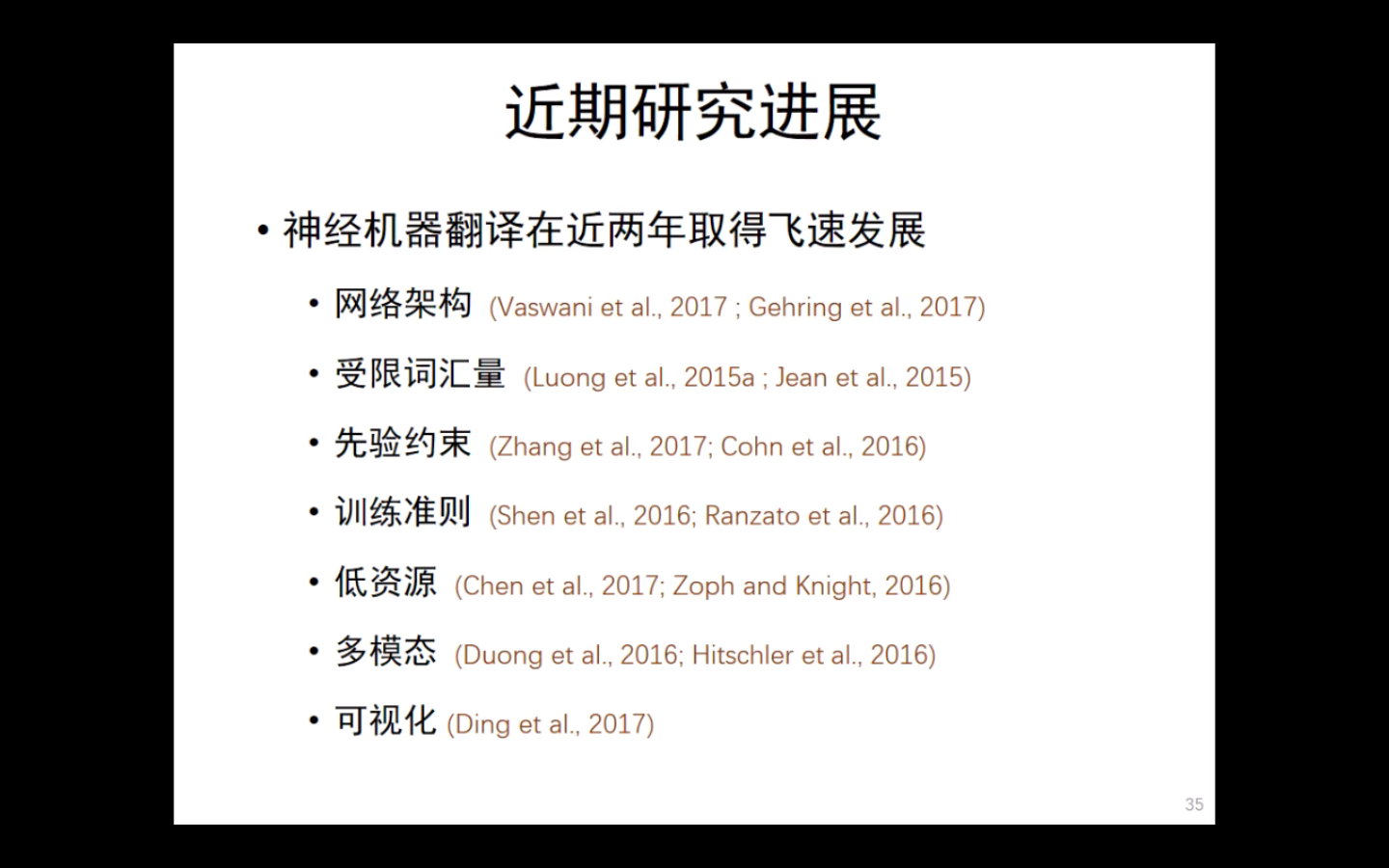

神经机器翻译近期的研究进展,主要集中在7个方面

- 网络架构

- 词汇受限

- 先验约束

- 训练准则

- 低资源

- 多模态

- 可视化

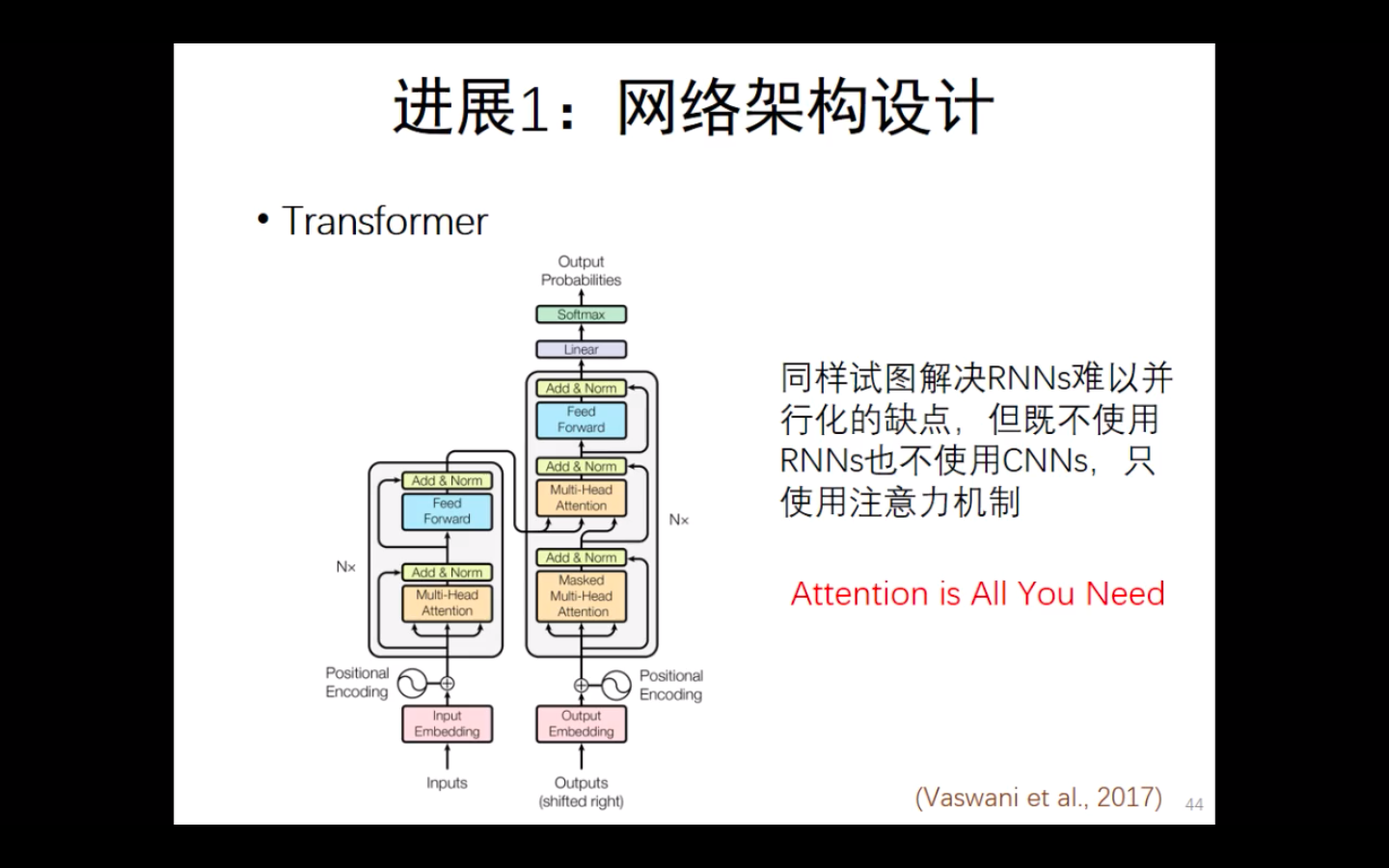

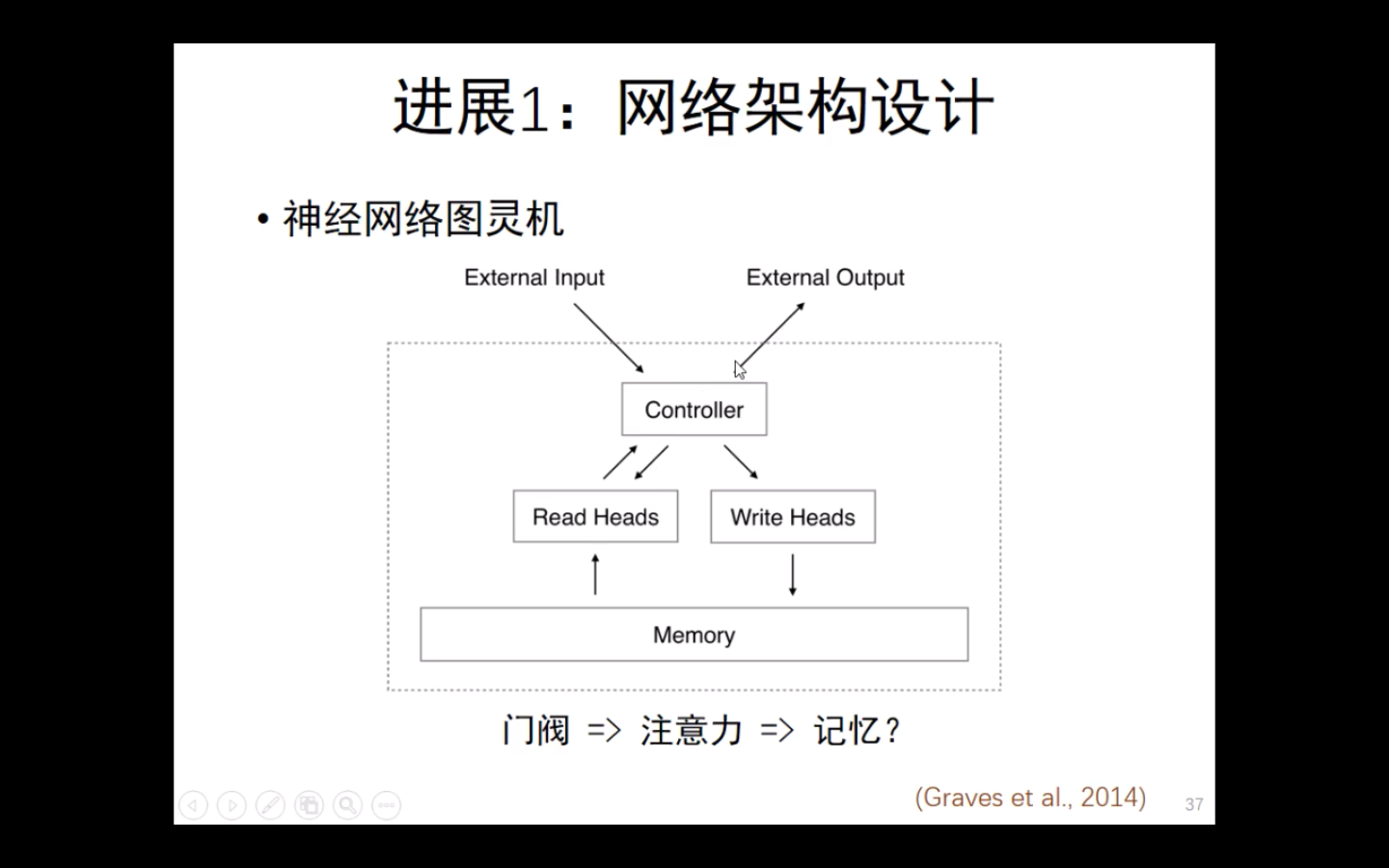

1. 网络架构

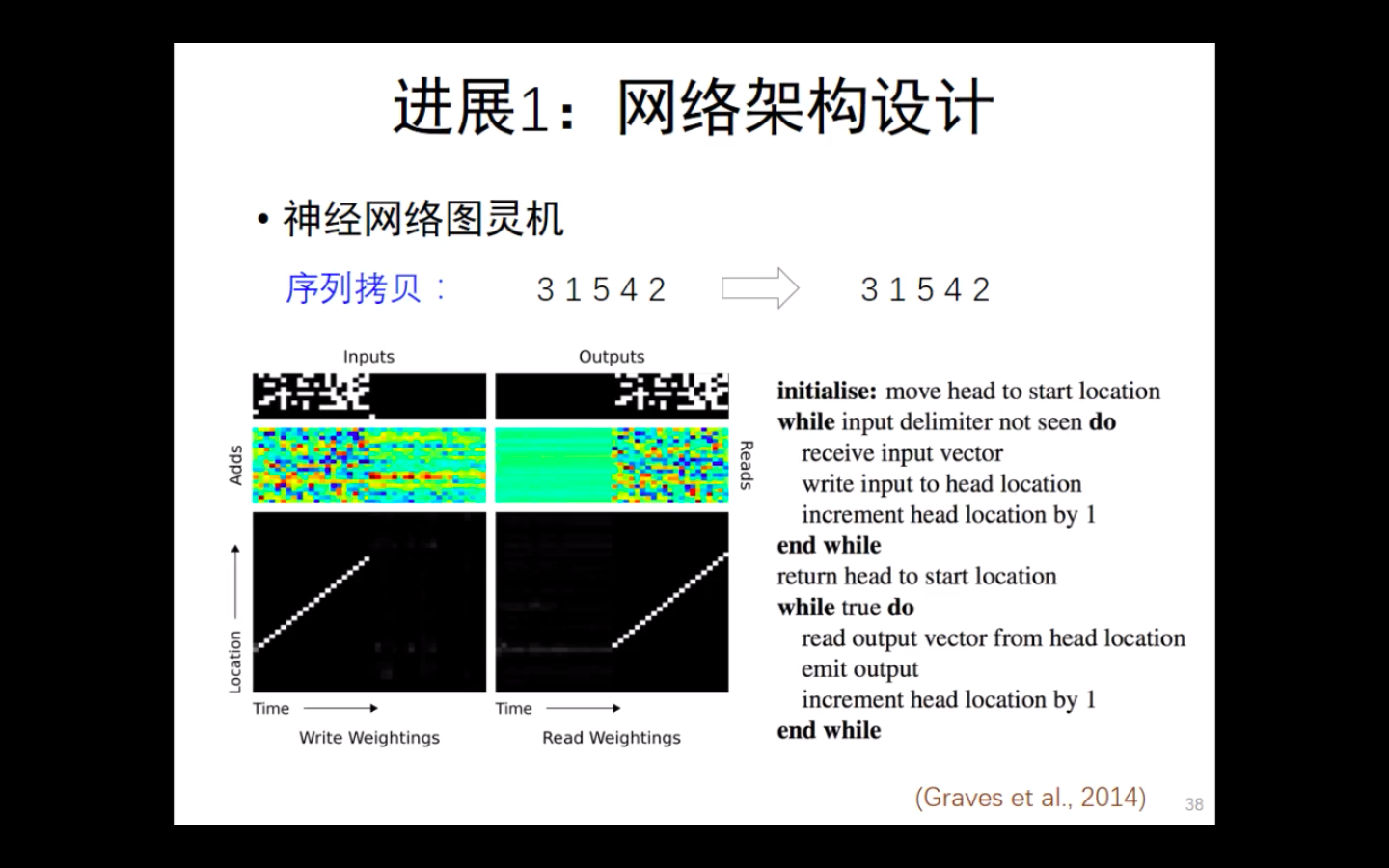

- 神经网络图灵机:考虑加入了Memory机制

序列拷贝:考虑将序列拷贝应用到机器翻译,但是没有取得理想的效果

利用记忆的机制:在decoder时,加入了Memory的机制

更深层的网络,似乎并没有取得什么显著的效果提升。

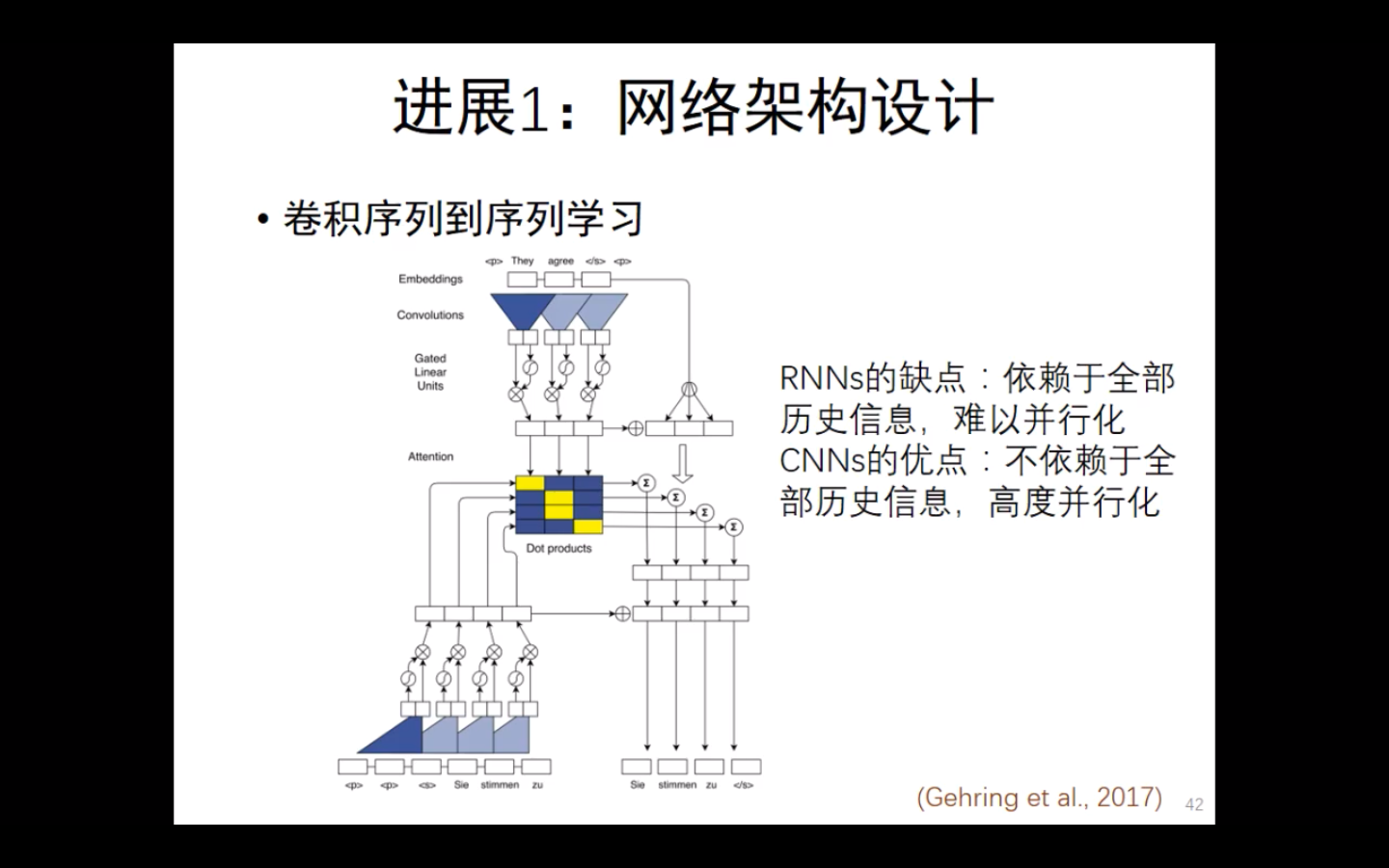

卷积序列到序列的学习

RNN:依赖于全部的历史信息,难以进行并行化。

CNN:不依赖于全部历史信息,高度并行化。

Transformer: Attention is All you need