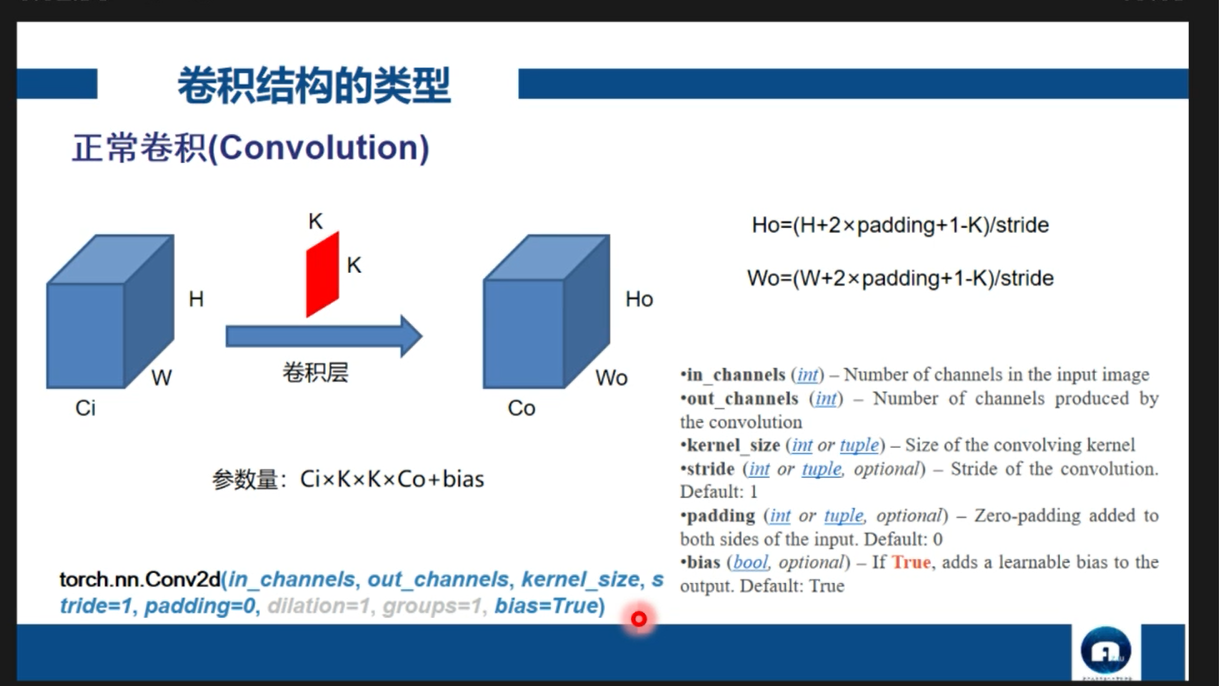

一个卷积核是3维的(Ci*k*k),一个卷积层是4维的

Ci :输入通道数 ,padding :左右两边补零的数量

stride :步长,滑窗隔几个滑一下 。padding 和K 要匹配使用

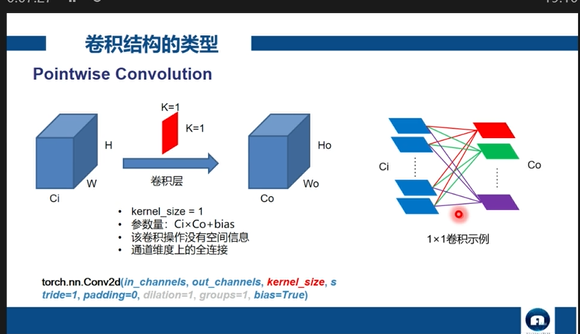

没有提取任何的空间信息,只是简单的缩放

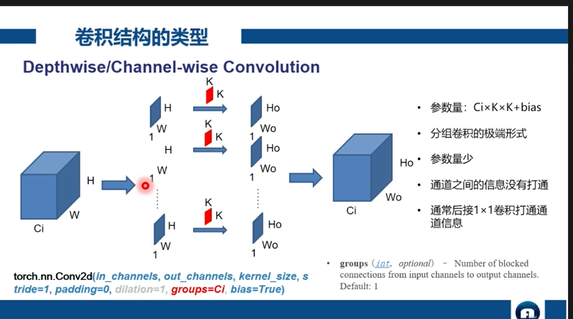

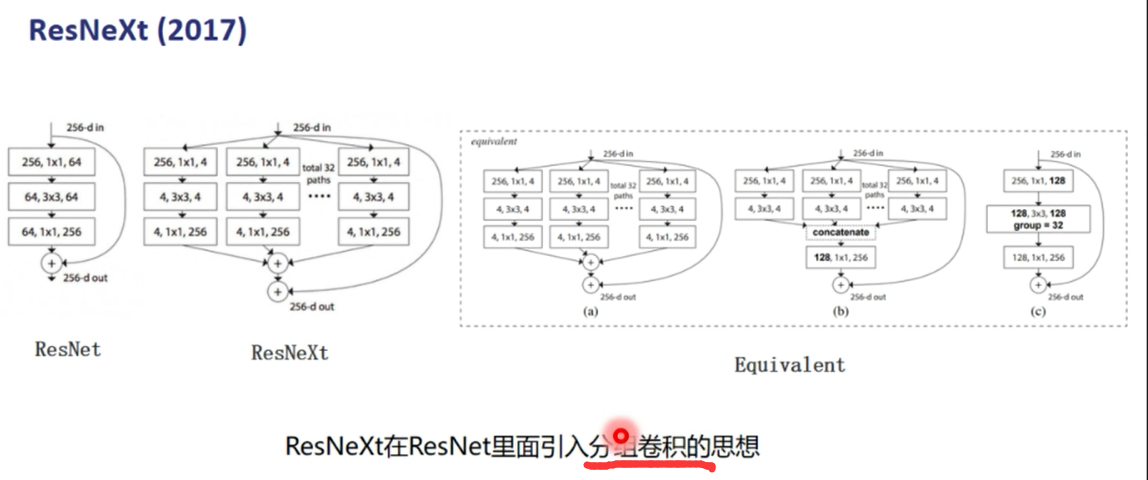

2(Ci/2*K*K/Co/2) 正常卷积的1/2。一般显卡不够用的时候要分组卷积

一般会和pointwise 卷积一起使用

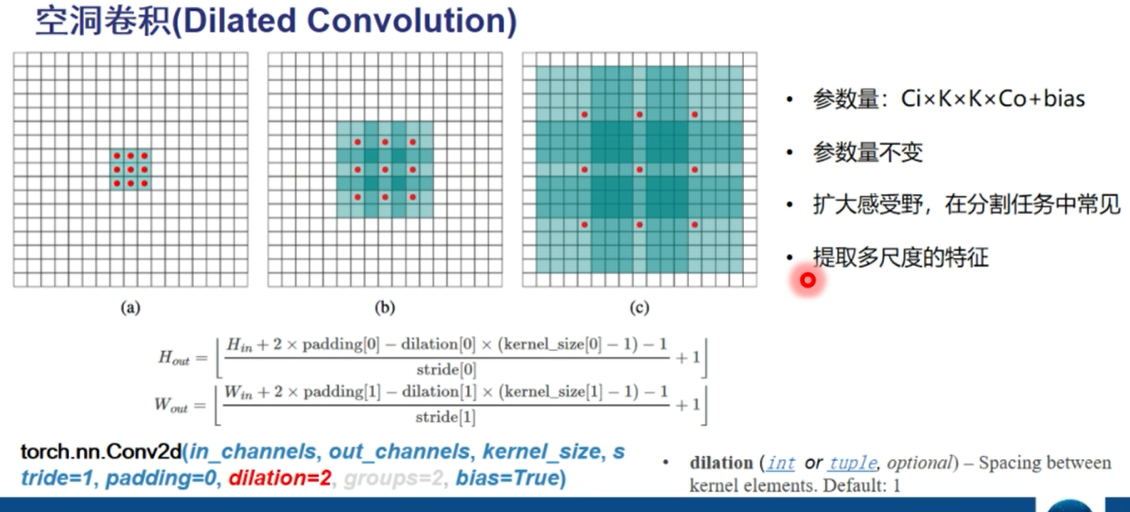

卷积核之间打洞 c图的dilation(扩大) =3(2个卷积和之间隔着3个)

正常卷积把尺寸变小,而反卷积把尺寸变大

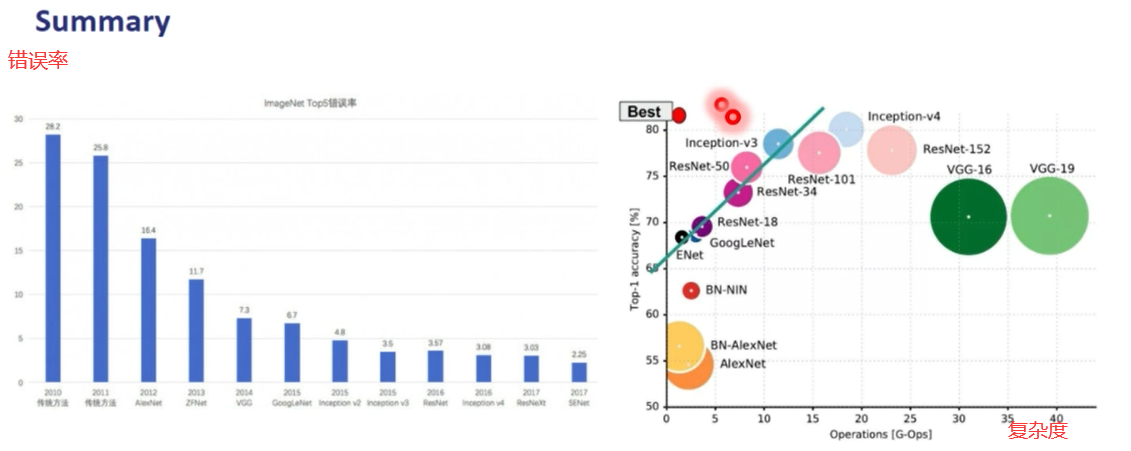

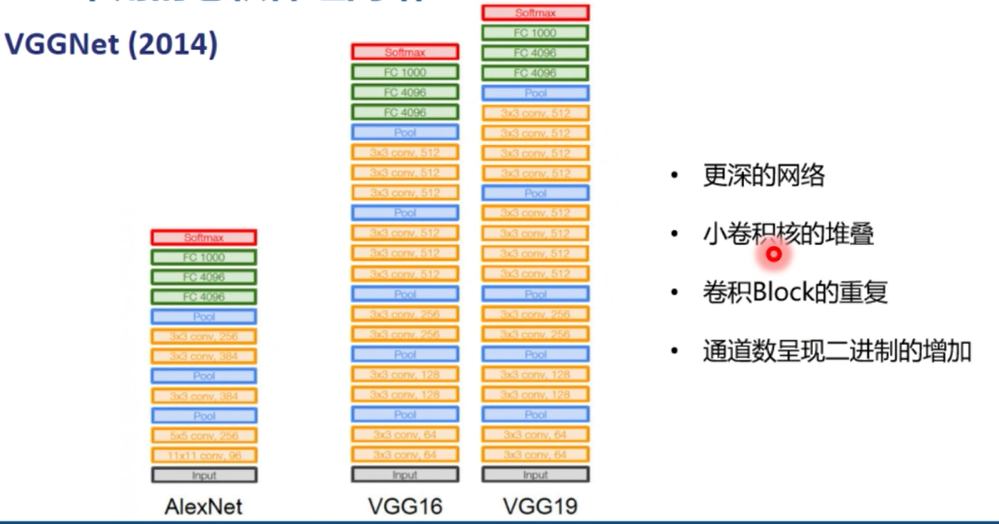

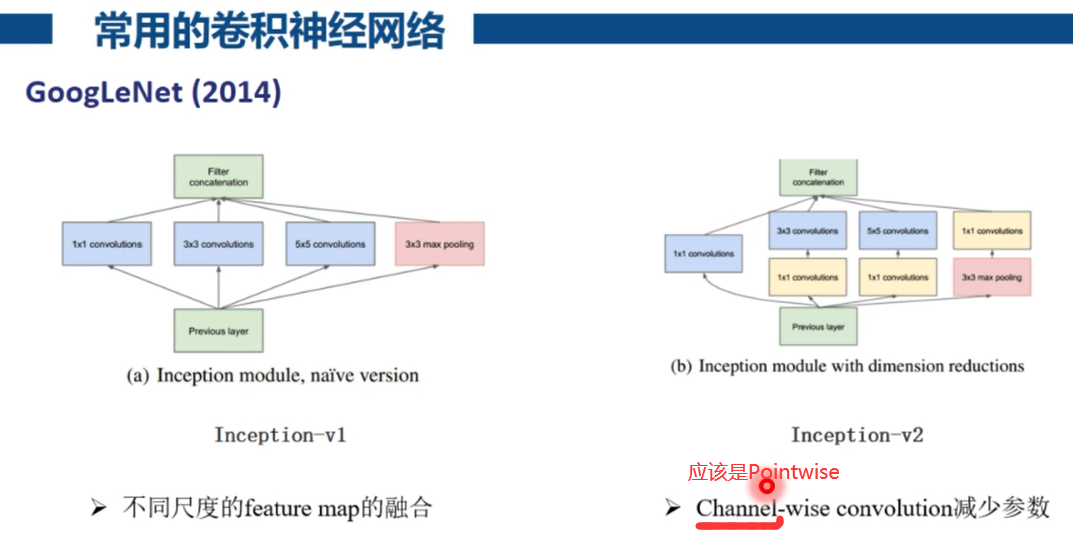

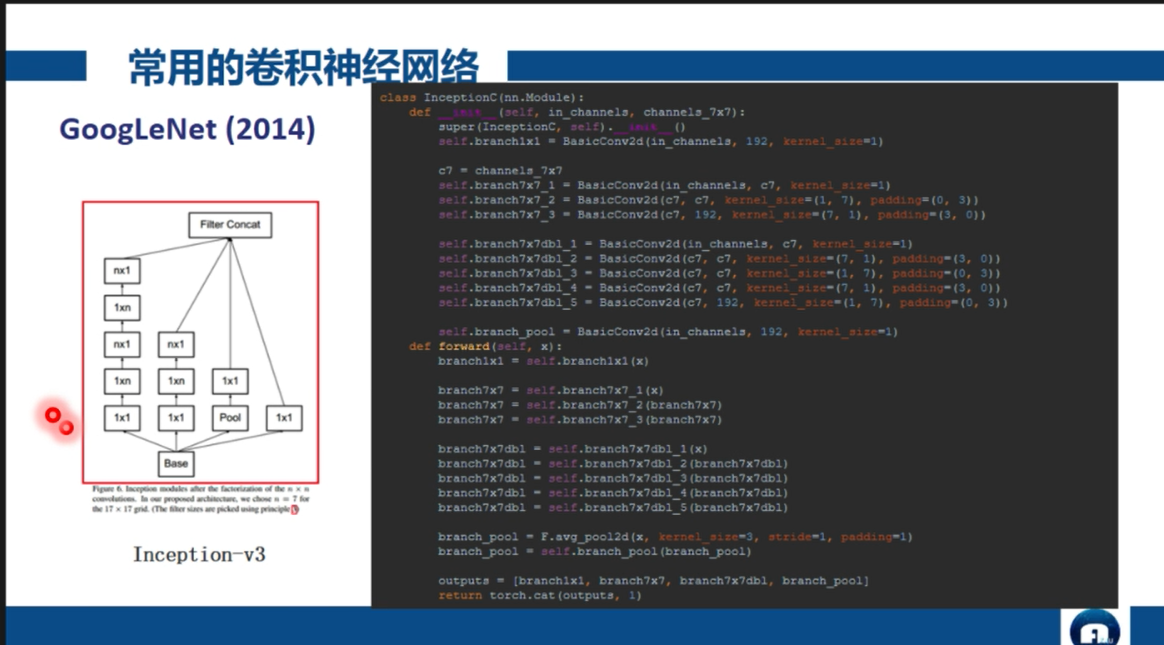

VGG从深度考虑,而GoogLeNet从宽度考虑

浅黄色1*1Conv 为了把输入通道数目降低,从而降低卷积层大小,降低网络参数量

v3 的感受野并没有变化

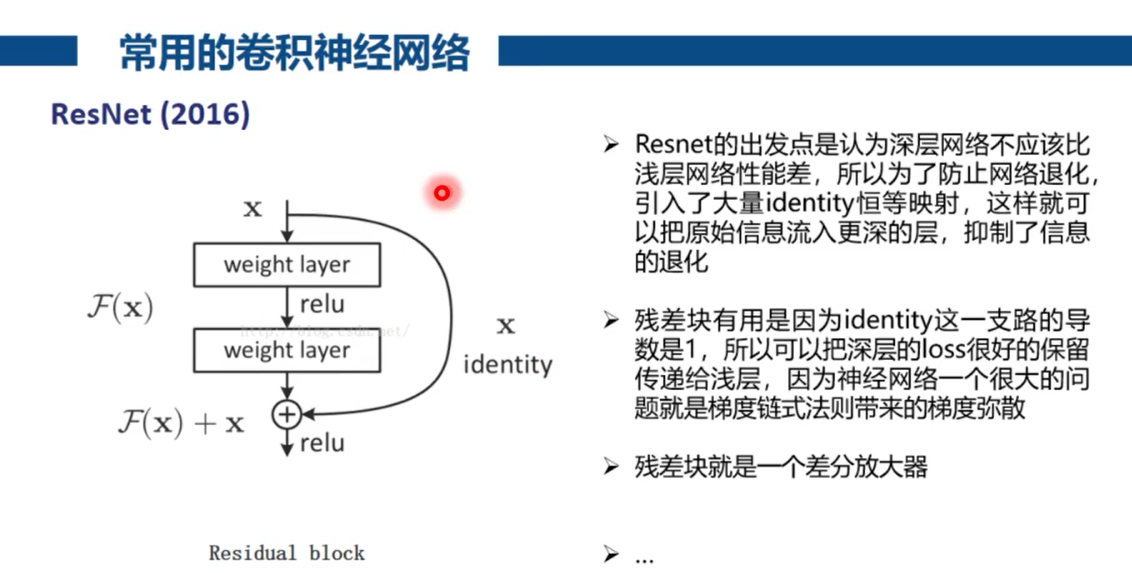

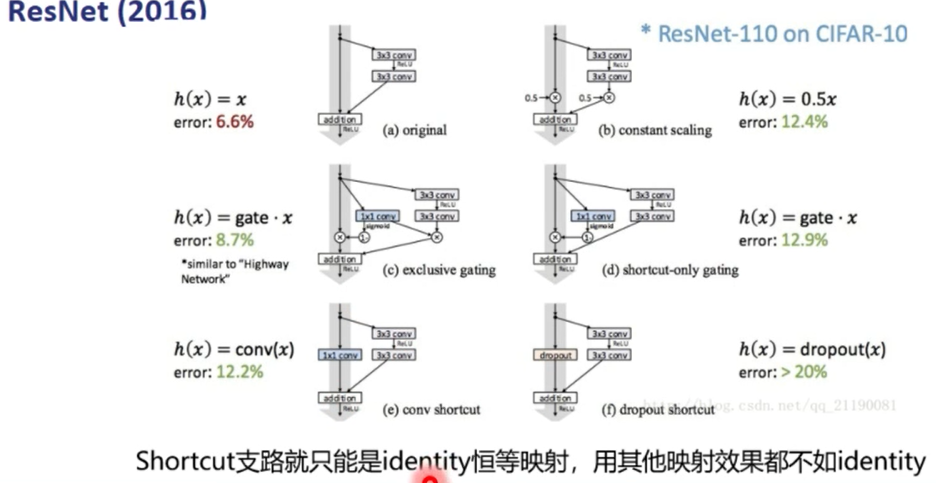

一般网络越深性能越好,但深到一定程度性能开始变差

因为太深网络无法训练

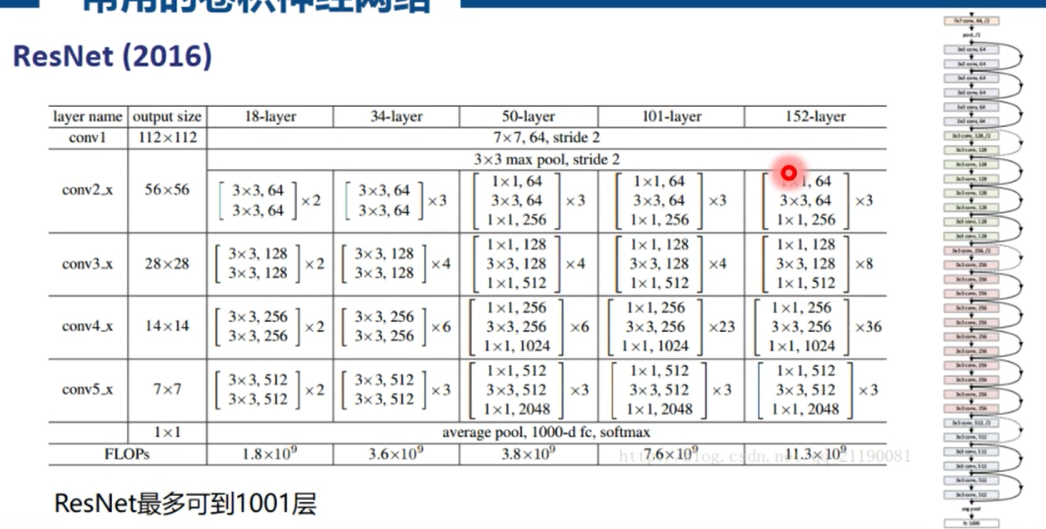

ResNet设计的初衷:训练很深的网络

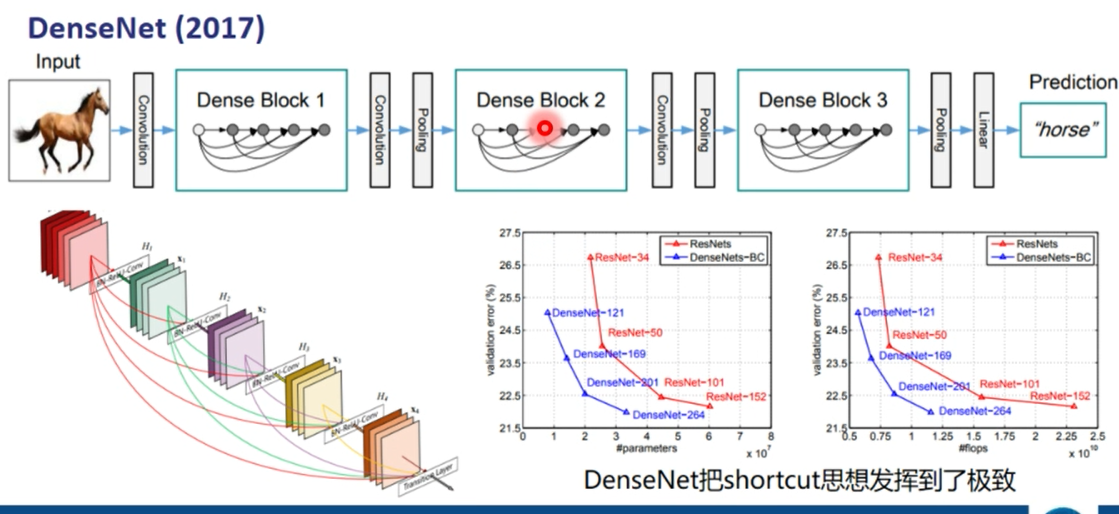

DenseNet :网络小,性能强,但耗时

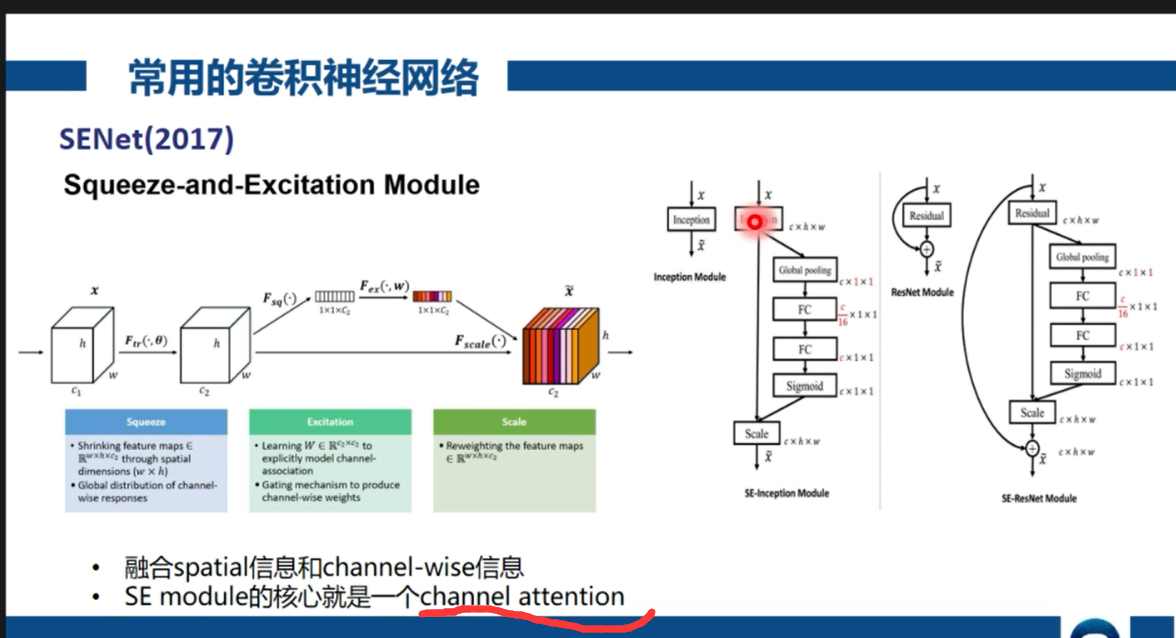

SENet :Pooling 后得到一个C维的向量(代表每个通道数的得分)给channel 打分,区分哪些channel是重要的,attention 是网络自动学习得到的。