上图为神经元的McCulloch-Pitts模型

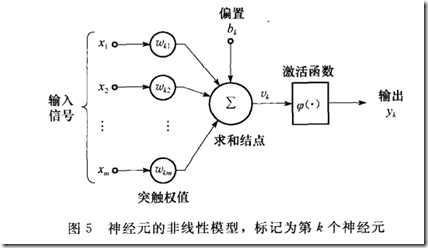

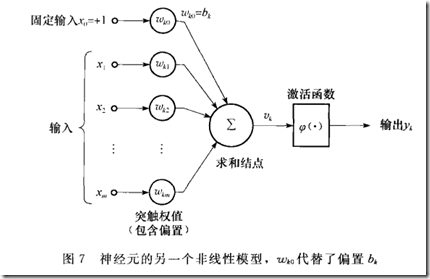

神经元:神经网络操作的基本信息处理单位。

神经元的基本元素:突触、加法器、偏置、激活函数。

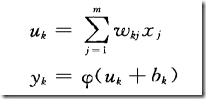

神经元数学表示:

Uk的称呼:线性组合器的输出

Vk=Uk+Bk的称呼:诱导局部域、激活电位。

偏置的作用是为Uk做仿射变换。

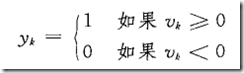

激活函数的类型:阀值函数(Heaviside)、sigmoid函数。

阀值函数:

其中vk是神经元的诱导局部域。

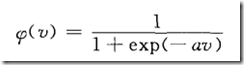

sigmoid函数:函数图形呈“S”形,严格递增。其中logistic函数即为sigmoid函数如下图:

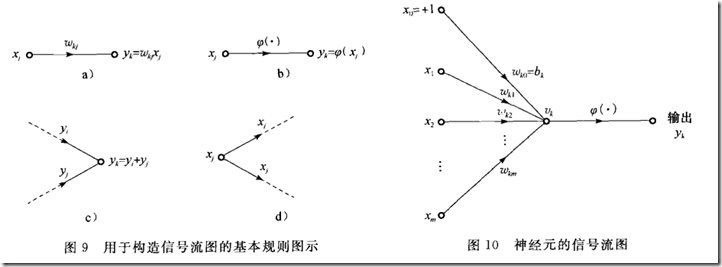

神经元的信号流图:节点之间的有向连接组成一个网络(一句通俗的话)。其中连接分为突触连接、激活链接。

特性:1.每个神经元可表示为一组线性的突触连接,一个外部应用偏置、以及可能的非线性激活链接。偏置由和一个固定为+1的输入连接的突触连接表示。2.神经元的突触给他们相应的输入信号加权。3.输入信号的加权和构成该神经元的诱导局部域。4.激活链接压制神经元的诱导局部域产生输出。

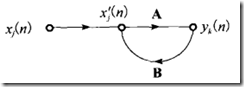

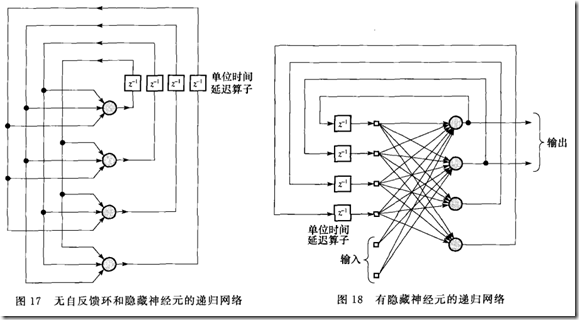

反馈:系统中输出影响输入,则成系统中存在反馈。

算子:算子是一个函数空间到函数空间上的映射O:X→X。

延迟算子:延迟算子相当于一个时间指针,当前序列值乘以一个延迟算子,就相当于把当前序列值得时间向过去拨了一个时刻。![]()

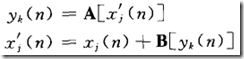

单环反馈系统:

A(1-AB)为系统的闭环算子,AB称为开环算子。通常,开环算子没有交换性,即AB!=BA。

神经网络中神经元的构造方式与用于训练网络的学习算法有着紧密的联系。

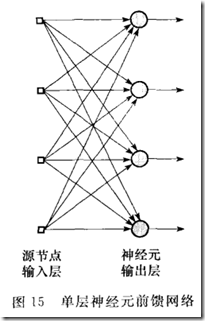

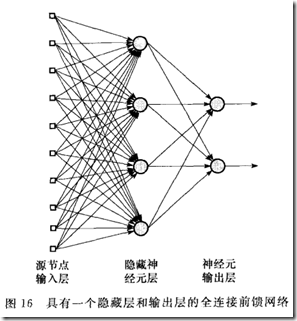

网络结构:单层前馈网络,多层前馈网络,递归网络

知识是人或机器储存起来以备使用的信息或模型,用来对外部世界做出解释、预测和适当的反应。

模式:事物的标准样式。

知识表示的主要特征:1、什么信息时明确表述的;2、物理上信息是如何被编码和使用的。

在“智能”机器的现实应用中,好的方案取决于好的知识表示。

神经网络的主要任务是学习它所依存的外部世界(环境)模型,并且保持该模型和真实世界足够兼容。

世界的知识由两类组成:1、已知世界的状态,由“什么是”事实和“什么是已知道的”事实所表示;这种形式的知识成为先验信息。2、对世界的观察(测量),由神经网络中被设计用于探测环境的传感器获得。一一般说来,这些观察室带有固有噪声的,这样得到的观察会提供一个信息池,从中提取样例来训练神经网络。

样例:1、有符号的,每个样例的输入信号有相应的与之配对的期望响应(即目标输出)。2、无符号,包括输入信号自身的不同实现。

训练数据,训练样本:一组由输入信号和相应的期望响应所组成的输入输出对。

知识的表示规则:

规则1 相似类别中的相似输入通常应产生网络中相似的表示,因此,可以归入同一类中。

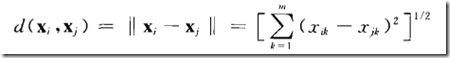

测量输入相似性常用的方法是利用欧几里得距离的概念。定义![]() ,则欧几里得距离公式为:

,则欧几里得距离公式为:

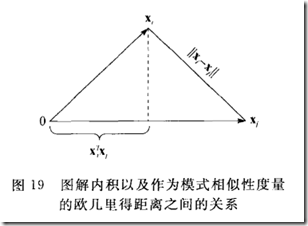

输入Xi和Xj越近,欧几里德距离越小,相似性越大。如果两个向量是相似的,就把他们归入一类。 如图19。

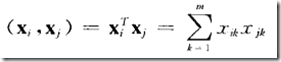

另一个测量相似性的方法是基于点积或内积。  ,内积表示Xi在Xj上的投影,如图19。

,内积表示Xi在Xj上的投影,如图19。

如图: ,欧几里德距离越小,内积越大,两个向量的相似性就越大。

,欧几里德距离越小,内积越大,两个向量的相似性就越大。

规则2 网络对可分离为不同种类的输入向量给出差别很大的表示。

规则3 如果某个特征很重要,那么网络表示这个向量将涉及大量神经元。

规则4 如果存在先验信息和不变性,应该将其附加在网络设计中,这样就不必学习这些信息而简化网络设计。

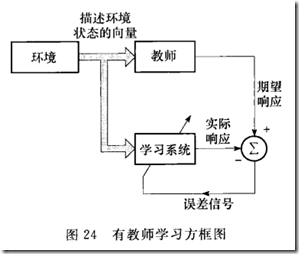

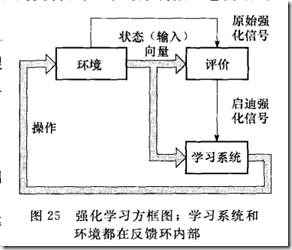

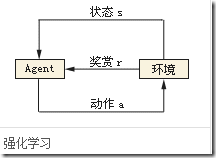

神经网络学习过程分类:有教师学习(监督学习)和无教师学习(强化学习,无监督学习)。

有教师学习有外部的教师做指引,强化学习有外部的评价做指引,无监督学习采用优胜劣汰的方式。

学习任务:

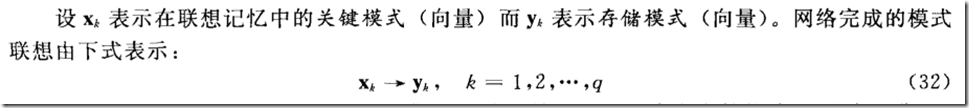

模式联想(自联想、异联想)

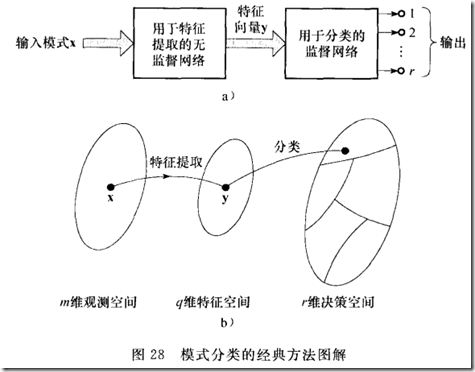

模式识别:模式识别被形式地定义为一个过程,由这个过程将接收到的模式或信号确定为一些指定类别中的一个类。

函数逼近:根据已知N组值拟合函数方程。

控制:

波束形成: