PS:此部分参考B站“机器学习白板推导系列”课程,清华大佬讲解的很棒,具体链接已附上

PPS:该部分视频连接:https://www.bilibili.com/video/av70839977?p=7

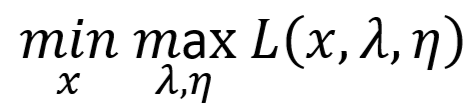

1、约束优化问题

- 原问题

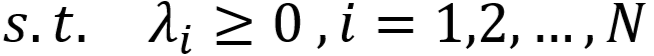

- 对原问题构造拉格朗日函数

![]()

- 原问题转化为无约束形式

2、对偶问题

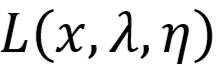

- 上述问题的对偶问题是

- 由上可知

- 原问题是关于 x 的函数

- 对偶问题是关于 λ,η 的函数

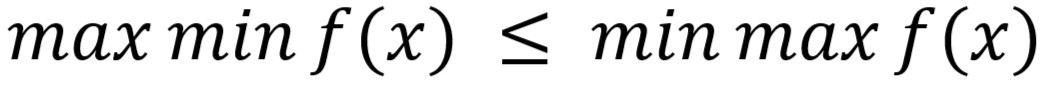

- 根据对偶的性质可知,弱对偶问题满足弱对偶性,则有

3、弱对偶性:对偶问题 ≤ 原问题

- 可类比:鸡头 ≤ 凤尾

- 证明略

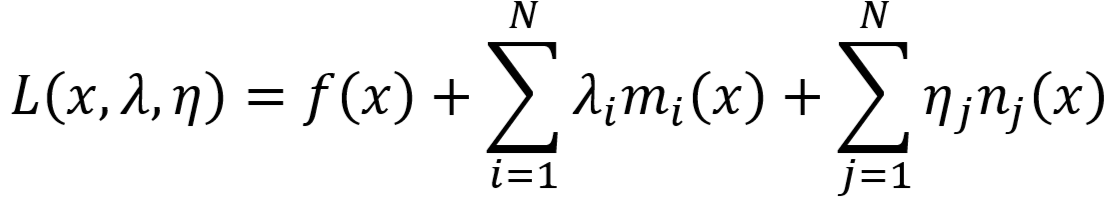

4、强对偶性

- Slater 条件

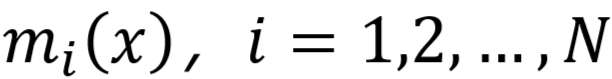

- 已知一组函数集

- 函数定义域为 D

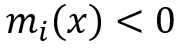

- Slater条件

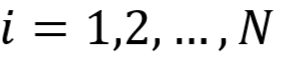

- 至少存在一个

,使得对所有

,使得对所有  ,都满足

,都满足

- 至少存在一个

- 已知一组函数集

- 充分条件

- 凸优化问题+一定的条件 → 强对偶关系

- 例:凸优化问题+Slater条件 → 强对偶关系

- 对于我们遇到的大多数凸优化问题,Slater 条件是成立的

- 仿射函数一定满足 Slater条件

- 性质:

- 如果对偶问题

是强对偶问题,则有:

是强对偶问题,则有:

- 如果对偶问题

![]()

PS:详见“白板推导”P31

5、KKT 条件

- 已知原问题无约束形式

为原问题的拉格朗日函数

为原问题的拉格朗日函数

- 对于上述问题,KKT 条件为

- 可行性

- 互补松弛

- 梯度为零

- 可行性

- KKT 条件推导,详见“白板推导”P32

- 部分内容可参考《统计学习方法》P110

- 具体推导详见视频:https://www.bilibili.com/video/av70839977?p=8