urllib模块基本介绍

所谓网页抓取,就是把URL地址中指定的网络资源从网络流中读取出来,保存到本地。 在Python中有很多库可以用来抓取网页,我们先学习urllib。

urllib2 在 python3.x 中被改为urllib.request

urlopen()

urllib.request.urlopen(url, data=None, [timeout, ]..., cafile=None, capath=None, cadefault=False, context=None)

- url: 需要打开的网址

- data:Post提交的数据

- timeout:设置网站的访问超时时间

直接用urllib.request模块的urlopen()获取页面,page的数据格式为bytes类型,需要decode()解码,转换成str类型。

#导入urllib库

import urllib.request as url_request

# 向指定的url发送请求,并返回服务器响应的类文件对象

response = url_request.urlopen("http://www.baidu.com")

# 类文件对象支持 文件对象的操作方法,如read()方法读取文件全部内容,返回字符串

html = response.read()

urlopen返回对象提供方法:

- read() , readline() ,readlines() , fileno() , close() :对HTTPResponse类型数据进行操作

- info():返回HTTPMessage对象,表示远程服务器返回的头信息

- getcode():返回Http状态码。如果是http请求,200请求成功完成;404网址未找到

- geturl():返回请求的url

使用Request

urllib.request.Request(url, data=None, headers={}, method=None)

使用request()来包装请求,再通过urlopen()获取页面。

#导入urllib库

import urllib.request as url_request

#定义一个url资源

url = "www.baidu.com"

#定义请求头

my_headers = {

"User-Agent" : "Mozilla/5.0 (compatible; MSIE 9.0; Windows NT 6.1; Trident/5.0;"

}

# url 连同 headers,一起构造Request请求,这个请求将附带 IE9.0 浏览器的User-Agent

req = url_request.Request(url, headers = my_headers)

# 向服务器发送这个请求,接受服务器的响应

response = url_request.urlopen(req)

html = response.read()

response响应

response是服务器响应的类文件,除了支持文件外,还支持以下操作

# 返回HTTP的响应码

response.getcode()

# 返回实际数据的URL,防止重定向问题

response.geturl()

# 返回服务器响应的HTTP报头

response.info()

User-Agent

直接用urllib给一个网站发送请求的话,有可能会拒绝我们的访问请求。

给我们的这个请求加上一个身份,就是所谓的User-Agent头。

浏览器 就是互联网世界上公认被允许的身份,如果我们希望我们的爬虫程序更像一个真实用户,那我们第一步,就是需要伪装成一个被公认的浏览器。用不同的浏览器在发送请求的时候,会有不同的User-Agent头。 urllib默认的User-Agent头为:Python-urllib/x.y(x和y是Python主版本和次版本号,例如 Python-urllib/2.7)

添加更多的Header信息

- User-Agent :这个头部可以携带如下几条信息:浏览器名和版本号、操作系统名和版本号、默认语言

- Referer:可以用来防止盗链,有一些网站图片显示来源http://***.com,就是检查Referer来鉴定的

- Connection:表示连接状态,记录Session的状态。

可以通过调用Request.add_header() 添加/修改一个特定的header 也可以通过调用Request.get_header()来查看已有的header:

import urllib.request

import random

url = "http://www.baidu.com"

UserAgent_list = [

"Mozilla/5.0 (Windows NT 6.1; ) Apple.... ",

"Mozilla/5.0 (X11; CrOS i686 2268.111.0)... ",

"Mozilla/5.0 (Macintosh; U; PPC Mac OS X.... ",

"Mozilla/5.0 (Macintosh; Intel Mac OS... "

]

user_agent = random.choice(UserAgent_list)

request = urllib.request.Request(url)

#通过调用Request.add_header() 添加/修改一个特定的header

request.add_header("User-Agent", user_agent)

# 第一个字母大写,后面的全部小写

request.get_header("User-agent")

response = urllib.request.urlopen(req)

html = response.read()

GET请求和POST请求

编码和解码:

编码工作使用urllib.parse中的urlencode()函数,帮我们将key:value这样的键值对转换成"key=value"这样的字符串,解码工作可以使用urllib.parse的unquote()函数。

#导入urllib库

from urllib import parse

#构造对象字典

word = {

"name" : "小龙",

"age" : 23

}

#编码,转换为查询字符串,对象之间用&分割

url_encode = parse.urlencode(word) #python2为 urllib.urlencode(word)

#结果为 :'name=%E5%B0%8F%E9%BE%99&age=23'

#解码

ret = parse.unquote(url_encode) #python2为 urllib.unquote(word)

#结果为 :'name=小龙&age=23'

GET方式

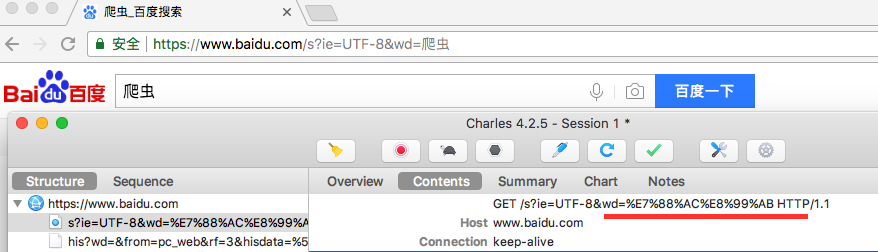

GET请求一般用于我们向服务器获取数据,请求内容添加在地址栏中,比如说,我们用百度搜索爬虫: https://www.baidu.com/s?wd=爬虫

在其中我们可以看到在请求部分里,http://www.baidu.com/s? 之后出现一个长长的字符串,其中就包含我们要查询的关键词爬虫,于是我们可以尝试用默认的Get方式来发送请求。

from urllib import parse,request

url = "http://www.baidu.com/s"

word = {"wd":"爬虫"}

word = parse.urlencode(word) #转换成url编码格式(字符串)

new_url = url + "?" + word # url首个分隔符就是 ?

#构造请求头

headers={ "User-Agent": "Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/51.0.2704.103 Safari/537.36"}

req = request.Request(new_url, headers=headers)

response = request.urlopen(req)

#读取html内容,并解码

html = response.read().decode("utf-8")

POST方式

Request请求对象的里有data参数,它就是用在POST里的,要传送的数据就是这个参数data,data是一个字典,里面要匹配键值对。

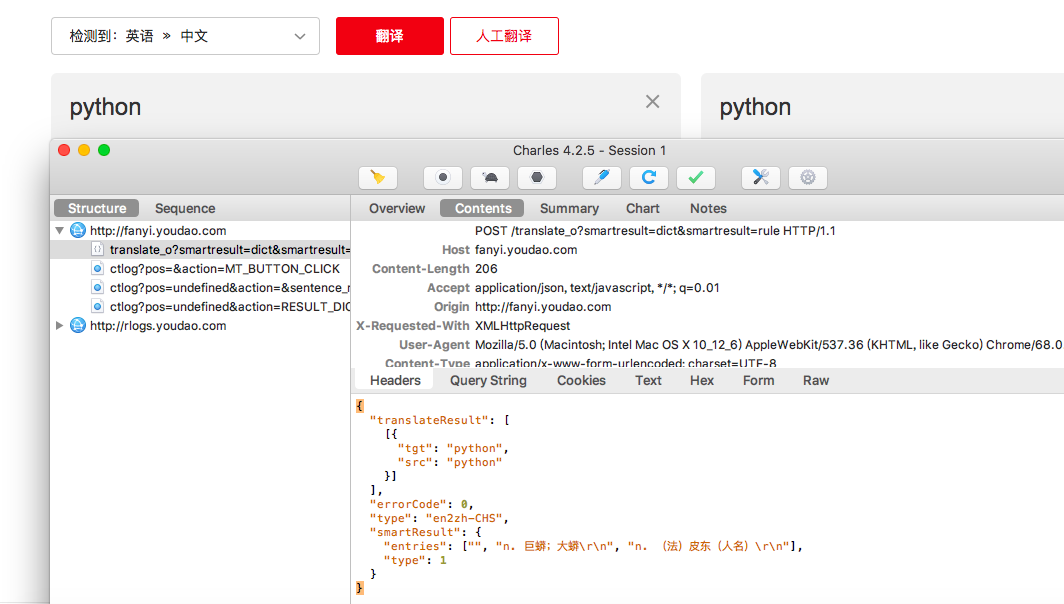

有道词典翻译网站:

输入测试数据,再通过使用Charles观察,其中有一条是POST请求,而向服务器发送的请求数据并不是在url里,我们可以试着模拟这个POST请求。

用POST方式发送请求

from urllib import parse, request

# POST请求的目标URL

url = "http://fanyi.youdao.com/translate?smartresult=dict&smartresult=rule&smartresult=ugc&sessionFrom=null"

headers={

"User-Agent": "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_12_6) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/68.0.3440.106 Safari/537.36"

}

formdata = {

"type":"AUTO",

"i":"i love python",

"doctype":"json",

"xmlVersion":"1.8",

"keyfrom":"fanyi.web",

"ue":"UTF-8",

"action":"FY_BY_ENTER",

"typoResult":"true"

}

data = parse.urlencode(formdata).encode('utf-8')

req = request.Request(url, data = data, headers = headers)

response = request.urlopen(req)

html = response.read().decode("utf-8")

result = json.loads(html)

发送POST请求时,需要特别注意headers的一些属性:

- Content-Length: 100:发送的表单数据长度为100,也就是字符个数是100个。

- X-Requested-With: XMLHttpRequest :表示Ajax异步请求。

- Content-Type: application/x-www-form-urlencoded : 表示浏览器提交 Web 表单时使用,表单数据会按照 name1=value1&name2=value2 键值对形式进行编码。

获取AJAX加载的内容

有些网页内容使用AJAX加载,只要记得,AJAX一般返回的是JSON,直接对AJAX地址进行post或get,就返回JSON数据了。

处理HTTPS请求 SSL证书验证

现在随处可见 https 开头的网站,urllib可以为 HTTPS 请求验证SSL证书,就像web浏览器一样,如果网站的SSL证书是经过CA认证的,则能够正常访问,如:https://www.baidu.com/等...

如果SSL证书验证不通过,或者操作系统不信任服务器的安全证书,比如浏览器在访问12306网站如:https://www.12306.cn/mormhweb/的时候,会警告用户证书不受信任。

urllib在访问的时候则会报出SSLError:

URLError: urlopen error [SSL: CERTIFICATE_VERIFY_FAILED] certificate verify failed (_ssl.c:590)

解决办法:单独处理SSL证书,让程序忽略SSL证书验证错误,即可正常访问。

try:

_create_unverified_https_context = ssl._create_unverified_context

except AttributeError:

# Legacy Python that doesn't verify HTTPS certificates by default

pass

else:

# Handle target environment that doesn't support HTTPS verification

ssl._create_default_https_context = _create_unverified_https_context

关于CA

CA(Certificate Authority)是数字证书认证中心的简称,是指发放、管理、废除数字证书的受信任的第三方机构,如北京数字认证股份有限公司、上海市数字证书认证中心有限公司等...

CA的作用是检查证书持有者身份的合法性,并签发证书,以防证书被伪造或篡改,以及对证书和密钥进行管理。

现实生活中可以用身份证来证明身份, 那么在网络世界里,数字证书就是身份证。和现实生活不同的是,并不是每个上网的用户都有数字证书的,往往只有当一个人需要证明自己的身份的时候才需要用到数字证书。

普通用户一般是不需要,因为网站并不关心是谁访问了网站,现在的网站只关心流量。但是反过来,网站就需要证明自己的身份了。

比如说现在钓鱼网站很多的,比如你想访问的是www.baidu.com,但其实你访问的是www.daibu.com,所以在提交自己的隐私信息之前需要验证一下网站的身份,要求网站出示数字证书。

一般正常的网站都会主动出示自己的数字证书,来确保客户端和网站服务器之间的通信数据是加密安全的。