今天看个5个课时的视频,对假设函数、代价函数、以及梯度下降有了一个大概的了解。

假设函数:

代价函数:

我们的目标就是求得J的最小值

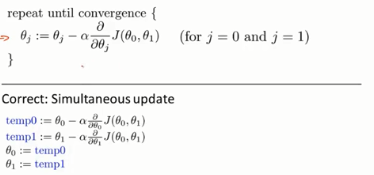

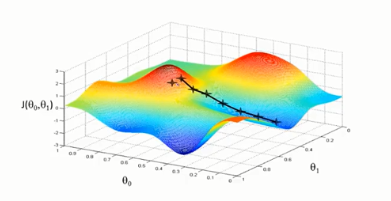

梯度下降:在一个上坡上找一个点,求得这个点周围的绝对值最大的导数(即坡度最大的方向),走一段距离,在重复上面找最小的导数,一直找到这个方向的最小点。

然后在上一个点偏移一些找另一个点,重复上面,又延伸出另一个方向的最小点

一直重复上面动作,各个方向的最小点相互比较,找出最小点,这就是J的最小值。

也可以用这种方法求各种函数的最小值。

这是一张3d图,帮助理解上面所说的。

找坡度最大的方向: