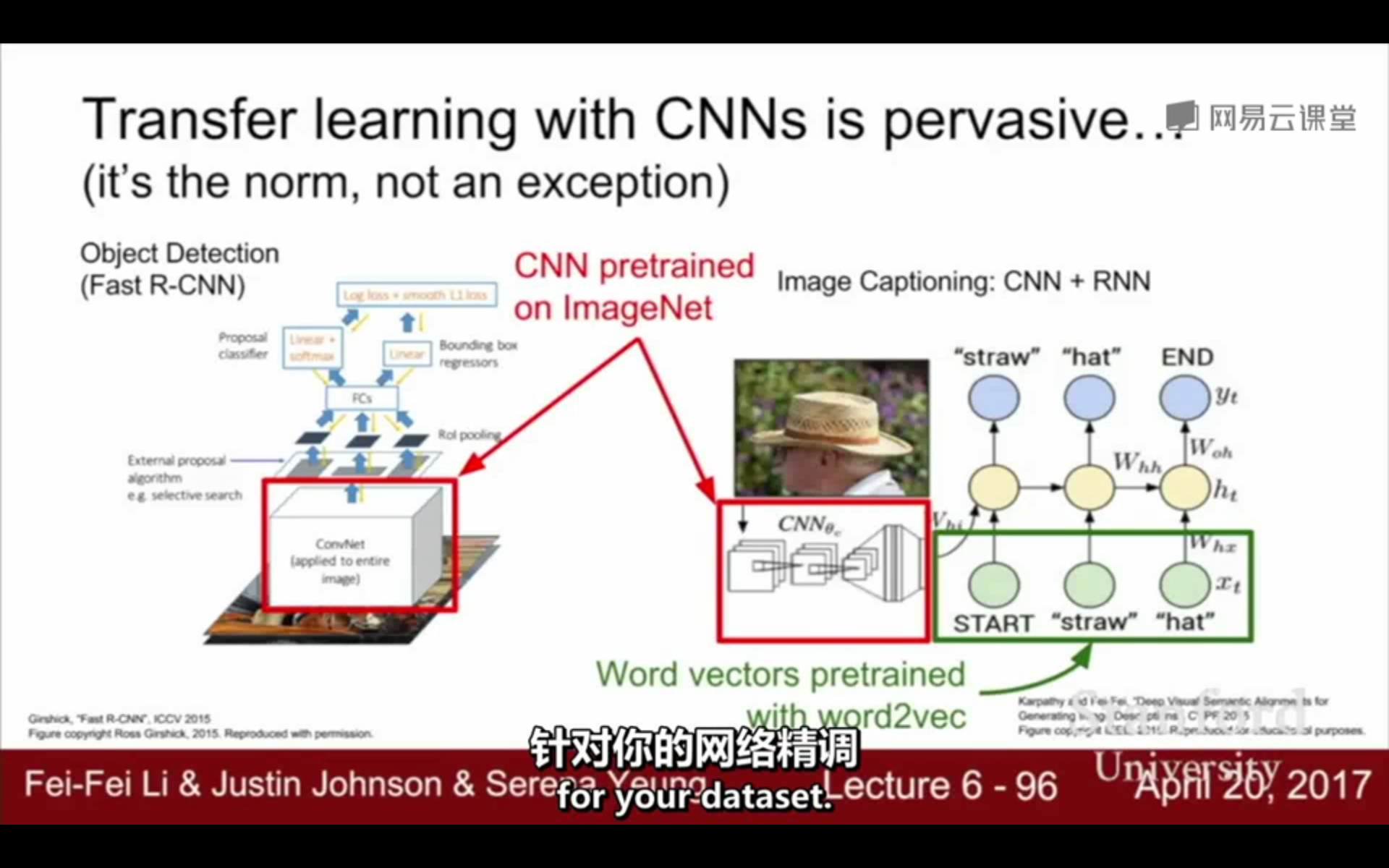

1. 迁移学习:利用已经训练过的用于解决问题A的模型,加上一部分问题B的数据集,对神经网络的大部分层进行冻结,即不改变参数,对模型进行训练,得到一个用于解决问题B的模型

△迁移学习的实质:找到源领域和目标领域之间的相似性,并加以合理利用;迁移学习的前提是两个任务之间存在共性

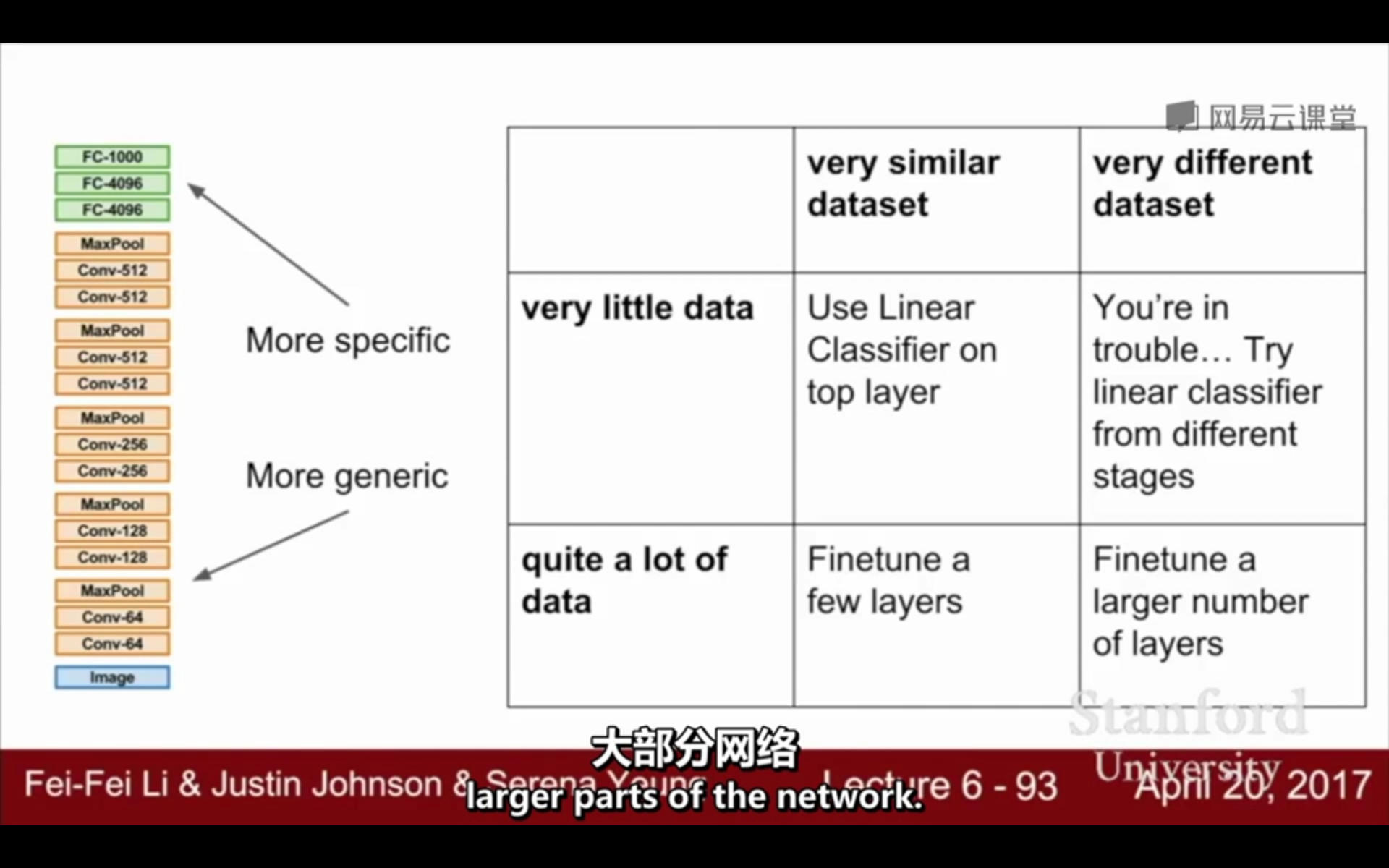

△迁移学习的策略:

①冻结+训练(freeze and train):对除最后一层或者最后几层的全连接层以外的其他层进行冻结,即不改变参数;对最后一层或最后几层的全连接层的权值重新初始化,用small dataset进行进行训练;适用于只有少量数据集的情况

②微调(finetuning):不冻结前面的层数,初始化最后几层的全连接层,利用bigger dataset对最后几层的全连接层进行训练,并使用较低的学习率,对前面的层的参数进行微调进行;适合有较多数据集的情况