1.用Hive对爬虫大作业产生的文本文件(或者英文词频统计下载的英文长篇小说)进行词频统计。

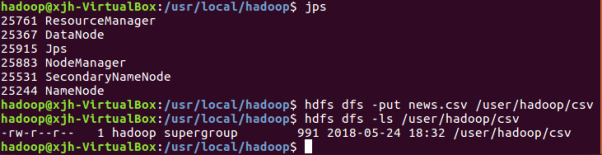

启动Hadoop

start-all.sh

把本地文件上传到hdfs文件系统,然后查看(之前已经把下载的英文小说上传到hdfs了)

hdfs dfs -ls input

启动hive

hive

建立表docs

create table docs(line string);

把hdfs文件系统中input文件夹里的文本文件load进去,写hiveQL命令统计

load data inpath 'input' overwrite into table docs;

create table word_count as select word,count(1) as count from (select explode(split(line,' '))as word from docs) w group by word order by word;

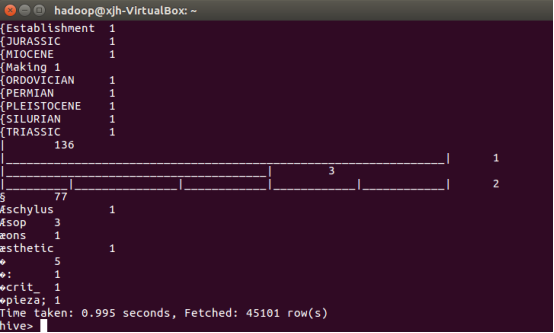

使用select命令查看结果

select * from word_count;

2.用Hive对爬虫大作业产生的csv文件进行数据分析,写一篇博客描述你的分析过程和分析结果。

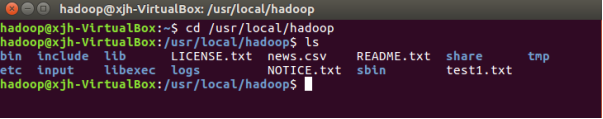

首先查看/usr/local/hadoop目录下的csv文件

上传到文件到dfs

将文件导入hive

load data inpath 'csv' overwrite into table docs;

查看数据

乱码原因:没有把csv文件的编码设置为UTF-8