今天开始做Spark的第5个实验,第一个题目做的还比较顺利,但是到第二个题目就又出现了莫名其妙地错误,经过一下午的解决,目前还没有能够成功解决。

第一题实验内容:

1.Spark SQL 基本操作

将下列 JSON 格式数据复制到 Linux 系统中,并保存命名为 employee.json。

{ "id":1 , "name":" Ella" , "age":36 }

{ "id":2, "name":"Bob","age":29 }

{ "id":3 , "name":"Jack","age":29 }

{ "id":4 , "name":"Jim","age":28 }

{ "id":4 , "name":"Jim","age":28 }

{ "id":5 , "name":"Damon" }

{ "id":5 , "name":"Damon" }

为 employee.json 创建 DataFrame,并写出 Scala 语句完成下列操作:

(1) 查询所有数据;

(2) 查询所有数据,并去除重复的数据;

(3) 查询所有数据,打印时去除 id 字段;

(4) 筛选出 age>30 的记录;

(5) 将数据按 age 分组;

(6) 将数据按 name 升序排列;

(7) 取出前 3 行数据;

(8) 查询所有记录的 name 列,并为其取别名为 username;

(9) 查询年龄 age 的平均值;

(10) 查询年龄 age 的最小值。

源代码:

首先:进行前期的准备工作,在Spark的shell模式下依次输入以下命令:

1 import org.apache.spark.sql.SparkSession 2 val spark=SparkSession.builder().getOrCreate() 3 import spark.implicits._ 4 val df=spark.read.json("file:///usr/local/spark/employee.json")

然后,各个小题的命令如下:

1 df.show() 2 df.distinct().show() 3 df.filter(df("age")>20).show() 4 df.groupBy("name").count().show() 5 df.sort(df("name").asc).show() 6 df.take(3)或df.head(3) 7 df.select(df("name").as("username")).show() 8 df.agg("age"->"avg").show() 9 df.agg("age"->"min").show()

第二题实验内容:

2.编程实现将 RDD 转换为 DataFrame

源文件内容如下(包含 id,name,age):

1,Ella,36

2,Bob,29

3,Jack,29

请将数据复制保存到 Linux 系统中,命名为 employee.txt,实现从 RDD 转换得到

DataFrame,并按“id:1,name:Ella,age:36”的格式打印出 DataFrame 的所有数据。请写出程序代

码。

第一种方法源代码:

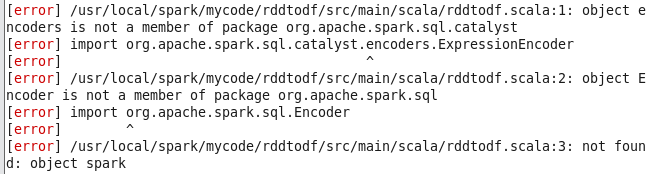

1 import org.apache.spark.sql.catalyst.encoders.ExpressionEncoder 2 import org.apache.spark.sql.Encoder 3 import spark.implicits._ 4 5 object RDDtoDF 6 { 7 def main(args:Array[String]) 8 { 9 case class Employee(id:Long,name:String,age:Long) 10 val employeeDF=spark.sparkContext.textFile("file:///usr/local/spark/employee.txt").map(_.split(",")).map(attributes=>Employee(attributes(0).trim.toInt,attributes(1),attributes(2).trim.toInt)).toDF() 11 employeeDF.createOrReplaceTempView("employee") 12 val employeeRDD=spark.sql("select id,name,age from employee") 13 employeeRDD.map(t=>"id:"+t(0)+","+"name:"+t(1)+","+"age"+t(2)).show() 14 } 15 }

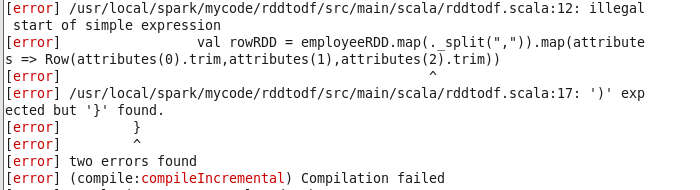

目前出现且尚未解决的错误:

第二种方法源代码:

1 import org.apache.spark.sql.types._ 2 import org.apache.spark.sql.Encoder 3 import org.apache.spark.sql.Row 4 object RDDtoDF 5 { 6 def main(args:Array[String]){ 7 val employeeRDD = spark.sparkContext.textFile("file:///usr/local/spark/employee.txt") 8 val schemaString = "id name age" 9 val fields = schemaString.split(" ").map(fieldName => StructField(fieldName,StringType,nullable=true)) 10 val schema = StructType(fields) 11 val rowRDD = employeeRDD.map(._split(",")).map(attributes => Row(attributes(0).trim,attributes(1),attributes(2).trim)) 12 val employeeDF = spark.createDataFrame(rowRDD,schema) 13 employeeDF.createOrReplaceTempView("employee") 14 val results = spark.sql("SELECT id,name,age FROM employee") 15 results.map(t => "id:"+t(0)+","+"name:"+t(1)+","+"age:"+t(2)).show() 16 } 17 }

目前出现且尚未解决的错误: