逻辑回顾,最多的应用是在分类问题上。

词向量

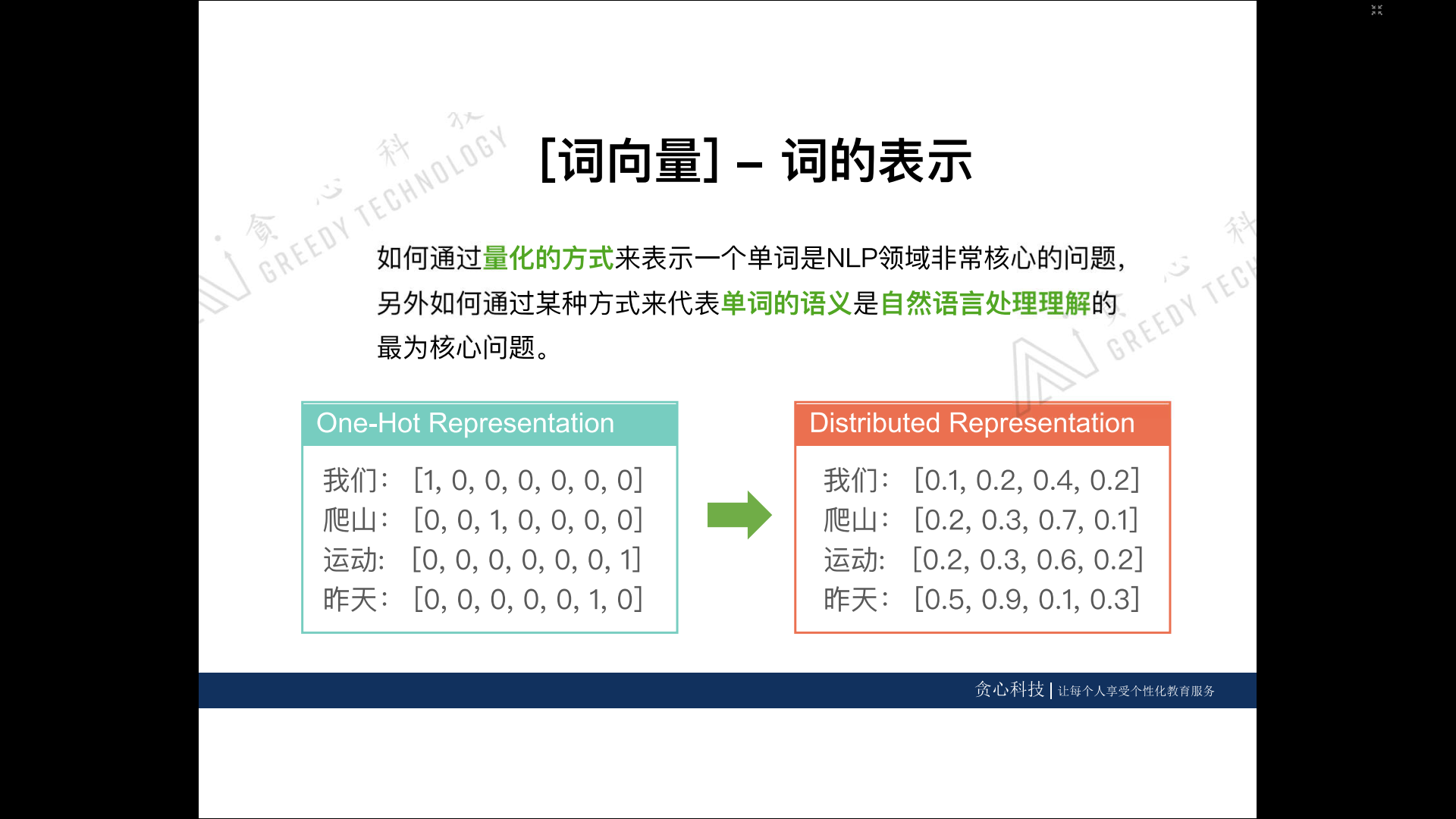

one hot编码不能表示单词间语义相似度,所以就出现了词向量

我们:[1, 0, 0, 0, 0, 0, 0] -> [0.1, 0.3, 0.4, 0.2]

运动:[0, 0, 0, 0, 1, 0, 0] -> [0.3, 0.2, 0.1, 0.4]

稀疏矩阵sparse Mat -> 稠密矩阵 dense Mat

针对词向量的降维算法:T-SNE

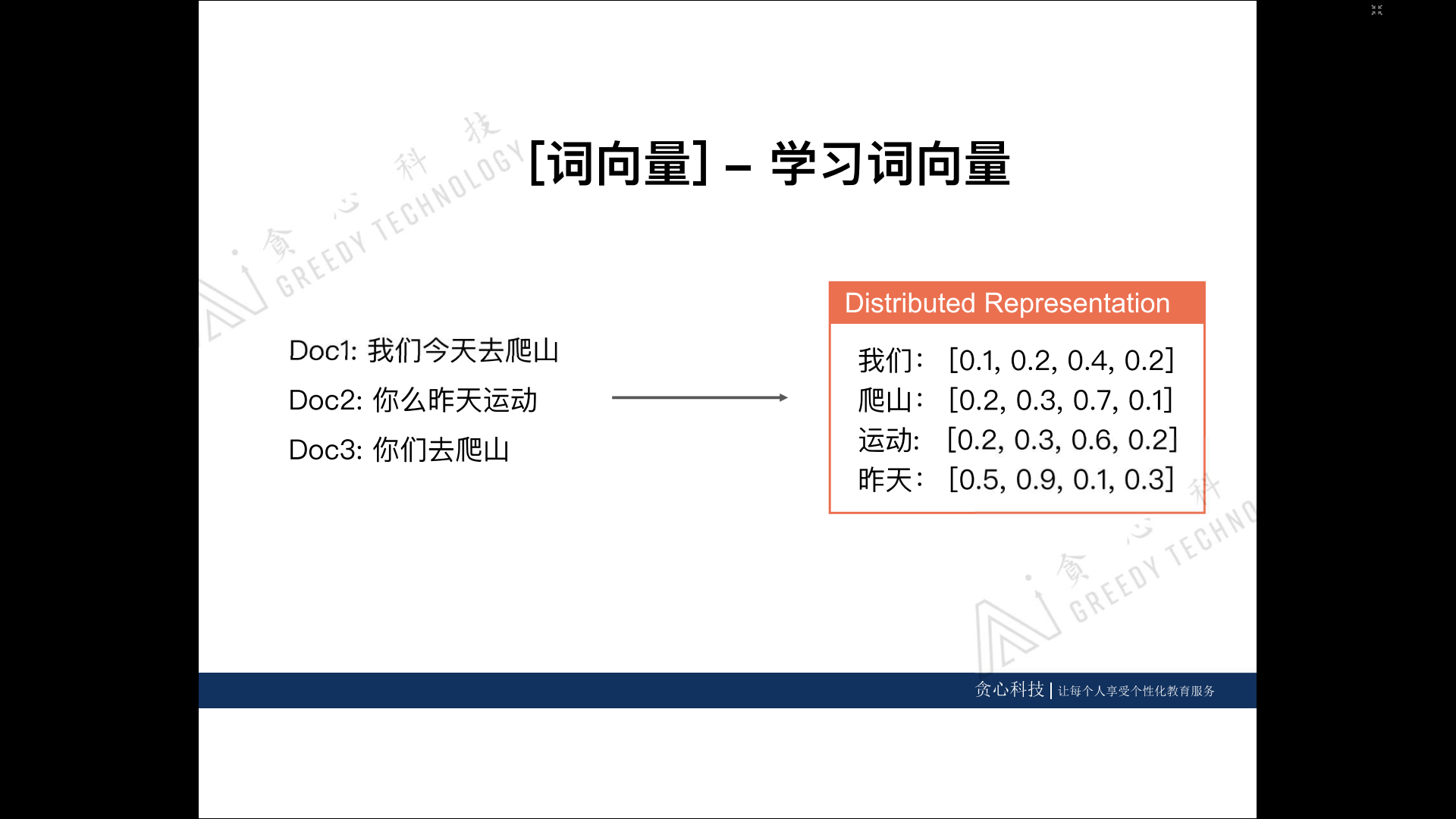

one hot编码和词向量都是将文档等文字量化成数字

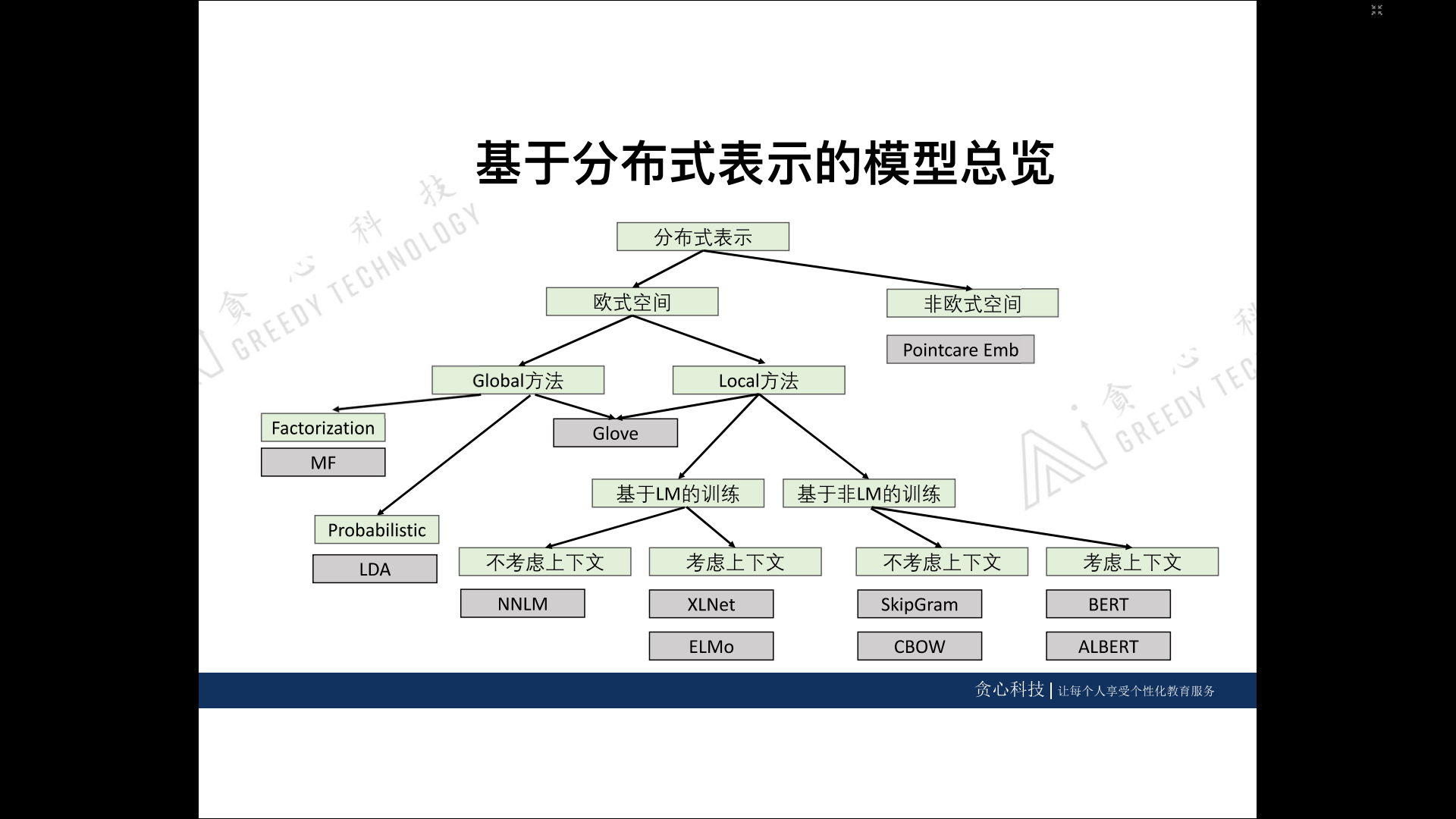

ELMo、bert、XLNet等都是为了将文字转成词向量,得到词之间的相似度

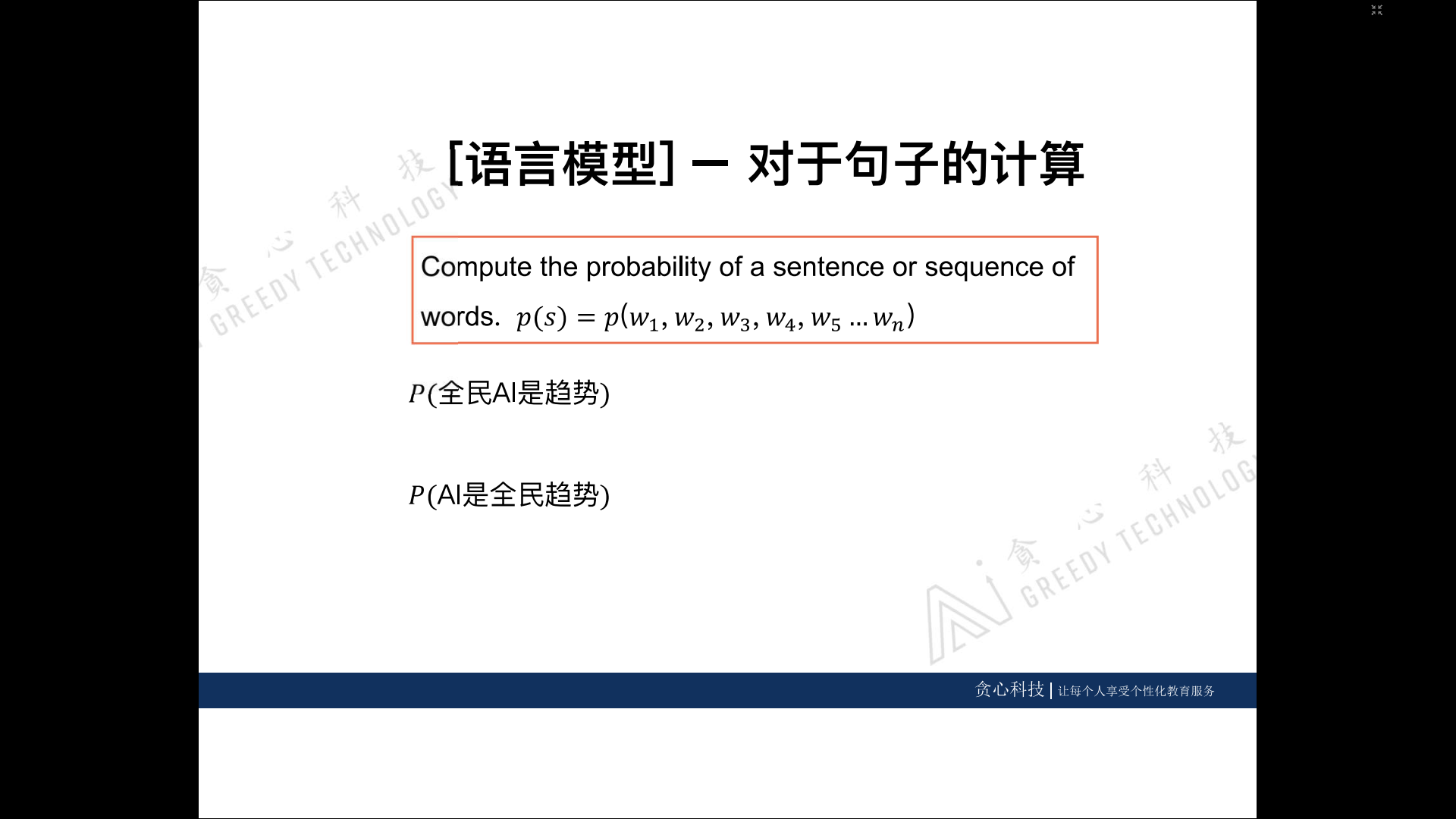

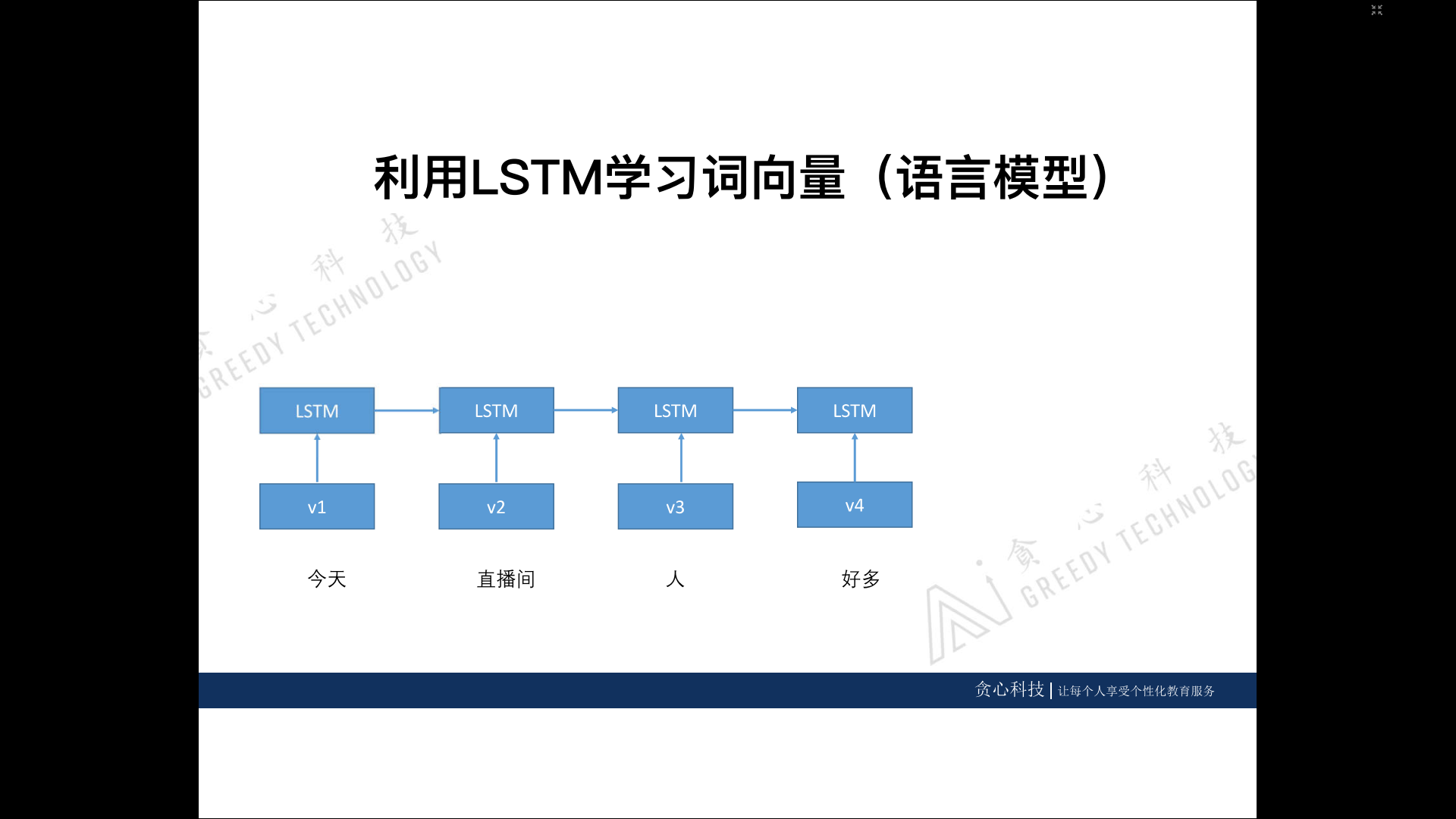

语言模型

语言模型用来判断:是否一句话从语法上通顺,方法是计算一个句子或字序列的可能性

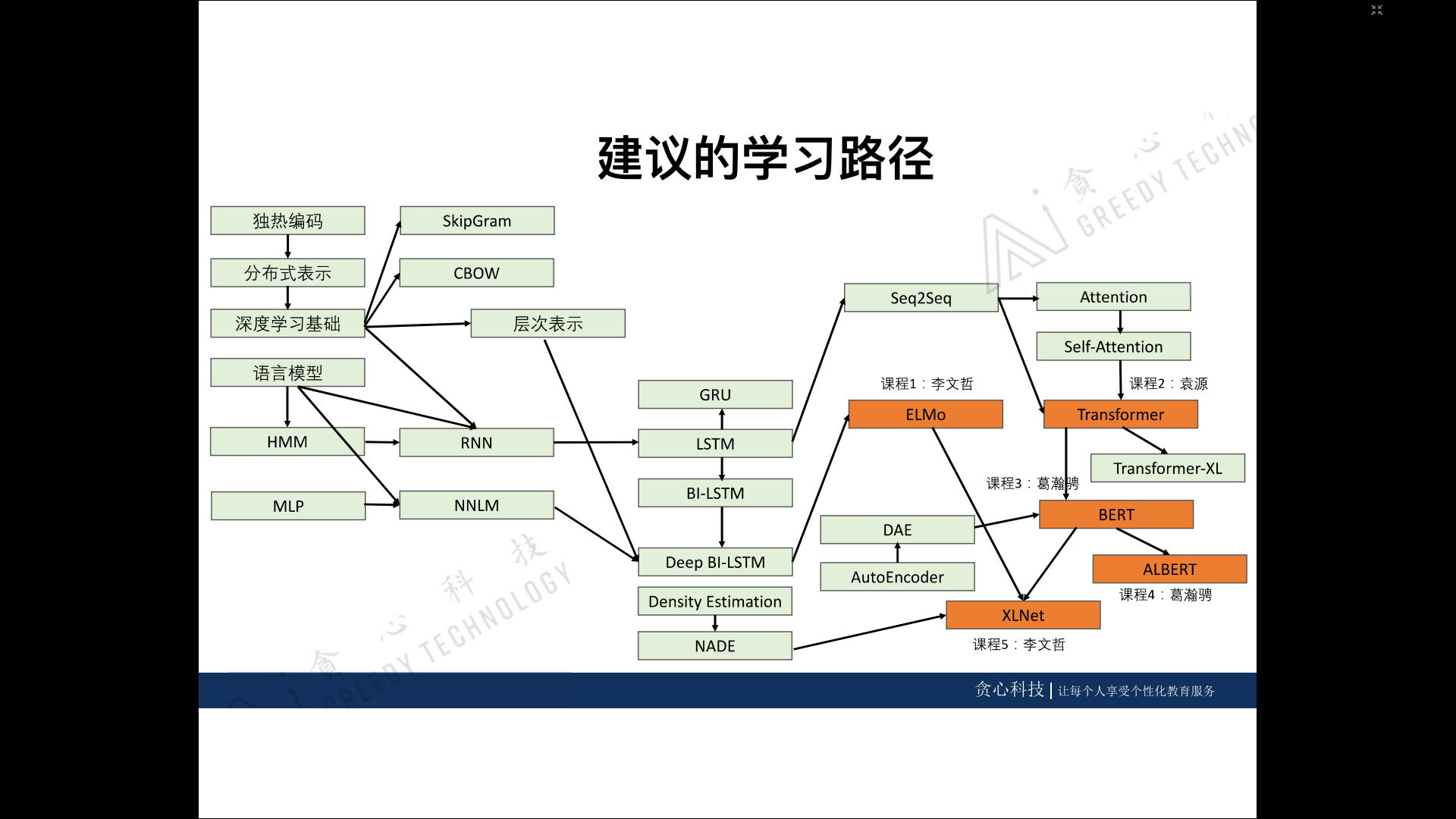

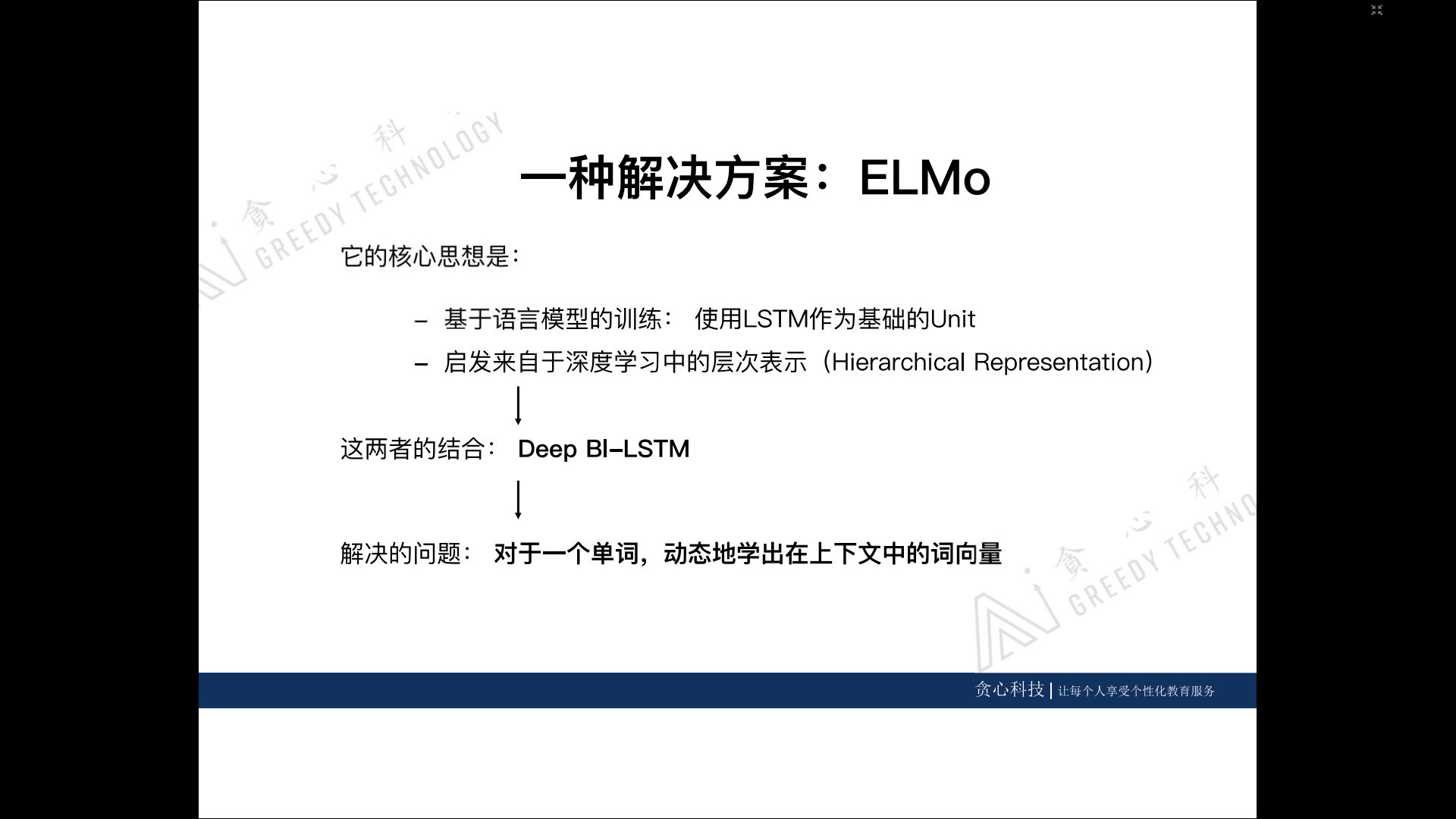

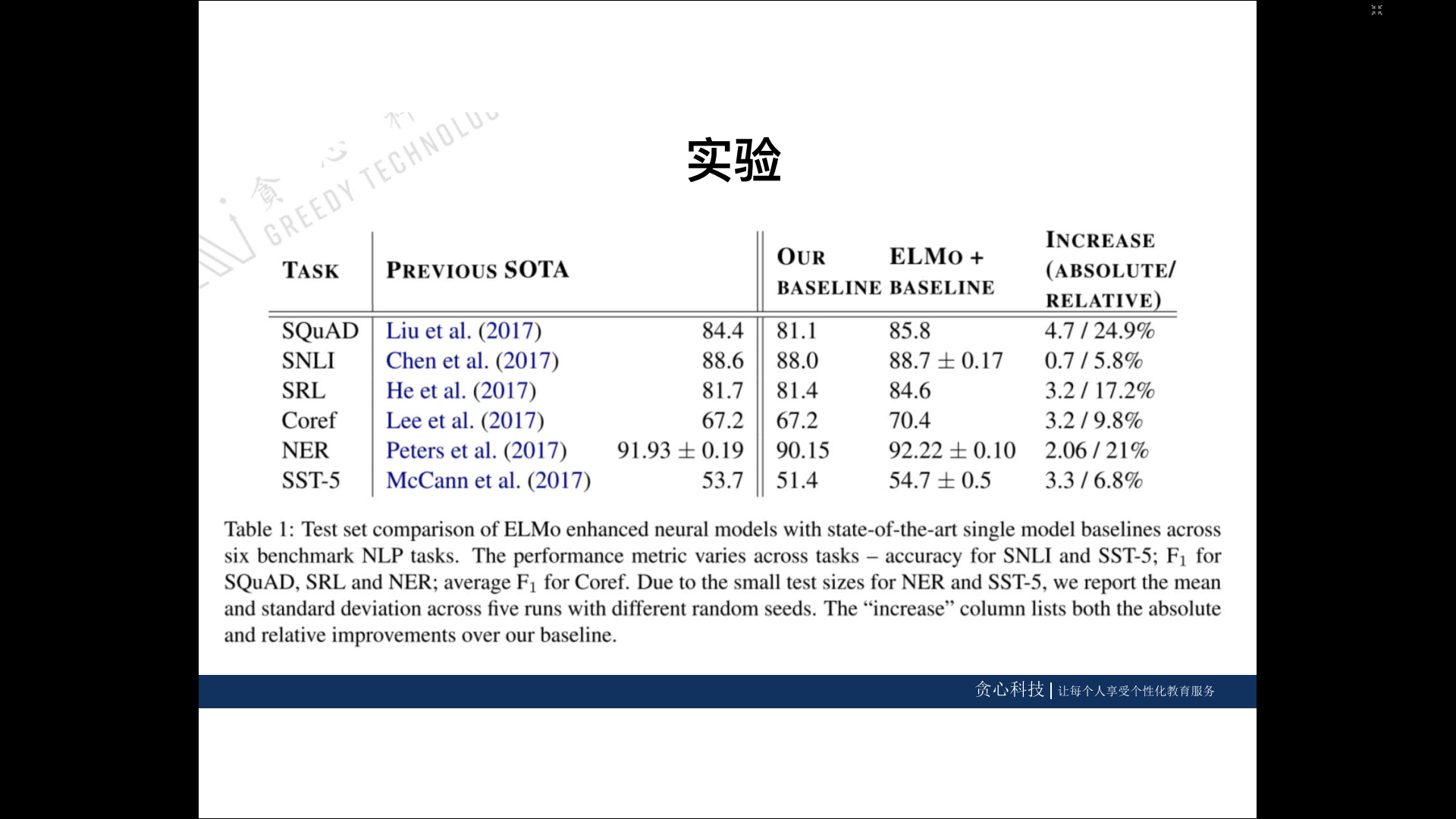

ELMo

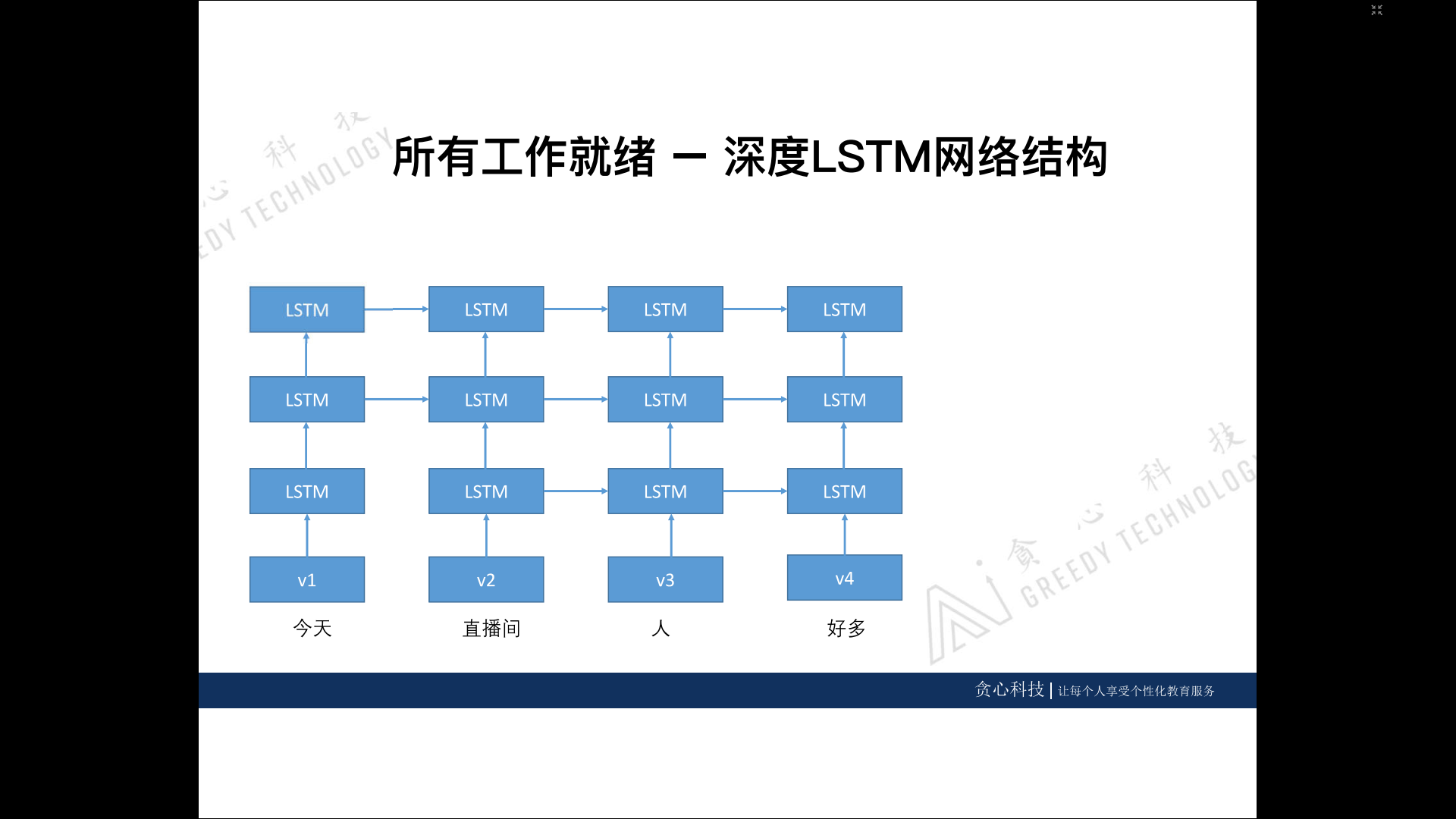

ELMo是deep 双向LSTM的深度学习模型

对比图像的层次表达,NLP:文字 -> 单词特征 -> 句法特征 -> 语义特征