英国机器视觉会议(BMVC)大约两周前在英国卡迪夫结束,是计算机视觉和模式识别领域的顶级会议之一,具有28%的竞争接受率。与其他人相比,这是一个小活动,所以你有足够的时间在会议上走来走去,和论文讲述者一对一的交流,我觉得这大有裨益。

我在会议上展示了一份关于分层多图网络图像分类的工作,在林晓、穆罕默德·艾默尔(主页)和我的博士顾问格雷厄姆·泰勒的监督下,我在SRI国际公司实习期间主要在上面工作。

在本文中,我们基本上试图回答以下问题:“我们能比卷积神经网络做得更好吗?”。 在这里,我讨论这个问题,并通过结果支持我的论点。 我还将引导您使用PyTorch从PASCAL VOC 2012的整个管道前进,获取单个图像。

这篇文章的完整代码在我的Github笔记本上。应该很容易地对其进行调整,以对整个PASCAL数据集进行训练和验证。

那么,为什么我们要比ConvNets做得更好?他们在许多任务上都胜过人类吗?

例如,您可以说图像分类是解决的任务。 好吧,就ImageNet而言,是的。 但是,尽管ImageNet做出了巨大贡献,但这是一个奇怪的任务。 您为什么要区分数百种狗? 因此,结果是我们成功地建立了模型,但是无法区分稍微旋转的狗和猫。 幸运的是,我们现在有了ImageNet-C和其他类似的基准,表明我们离解决它还很遥远。

相关任务(例如对象检测)中出现的另一个未解决的问题是在非常大的图像(例如4000×3000)上进行训练,例如Katharopoulos&Fleuret(ICML,2019)和Ramapuram等人解决了这个问题。 (BMVC,2019)。 多亏了后者,我现在知道如果海报的背景是黑色的,那么很有可能来自Apple。 我也应该保留一些颜色!

因此,也许我们需要不同于卷积神经网络的东西?也许我们应该从一开始就使用具有更好属性的模型,而不是不断修补其错误.

我们认为这种模型可以是图神经网络(GNN):一种可以从图结构数据中学习的神经网络。 GNN具有一些吸引人的属性。 例如,与ConvNets相比,GNN本质上是旋转和平移不变的,因为在图形中根本没有旋转或平移的概念,即没有左右,在某种意义上只有“邻居”(Khasanova和Frossard, ICML,2017)。 因此,人们多年来一直试图解决的使ConvNet更好地推广到不同的轮换的问题可以通过GNN自动解决!

关于从大图像中学习,如何从图像中提取超像素并将低维输入输入到GNN而不是将下采样(例如224×224)图像输入到ConvNet? 与双线性插值相比,超像素似乎是对图像进行下采样的一种更好的方法,因为超像素通常通过保持对象之间的边界来保留很多语义。 借助ConvNet,我们无法直接从这种输入中学习,但是,有一些很好的提议建议利用它们(Kwak等人,AAAI,2017)。

因此,GNN听起来很棒!让我们看看它在实践中的表现。

但是不好了!基于(Kipf&Welling,ICLR,2017)的基准GNN在PASCAL上仅达到19.2%(平均平均精度或mAP),而在每一层中具有相同数量的层和滤波器的ConvNet为32.7%

我们提出了一些改进措施,最终击败了ConvNet!

1. 层次图

在ConvNets中,图像的层次结构是通过池化层隐式建模的。 在GNN中,您至少可以通过两种方式实现这一目标。 首先,您可以使用类似于ConvNets的池化方法,但是对于图而言,定义一种快速且良好的池化方法确实具有挑战性。 相反,我们可以计算多个比例的超像素,并通过将它们与较大的父超像素对应来合并超像素。 但是,由于某些原因,这种合并在我们的案例中效果不佳(我仍然认为效果很好)。 因此,我们改为在输入级别对层次结构建模。 特别是,我们将所有比例的超像素组合成一个集合,并基于语义分割中常用的基于联合的交集(IoU)计算层次关系。

基于该原理,我在下面的代码中构建了层次图。 我还构建了空间图的多尺度版本,但它仅编码空间关系,而IoU应该更好地编码分层关系。 例如,使用IoU,我们可以在远程子节点之间创建快捷方式,即连接两个空间上相距较远但属于同一父节点(例如汽车)的小超像素(例如车轮),如上图所示。

实际上,层次图将mAP提升到31.7%,使其比ConvNet仅低1%,而可训练参数却减少了4倍!如果仅使用空间多尺度图,则结果将比本文中探讨的要差得多。

def compute_iou_binary(seg1, seg2):

inters = float(np.count_nonzero(seg1 & seg2))

#区域可以预先计算

seg1_area = float(np.count_nonzero(seg1))

seg2_area = float(np.count_nonzero(seg2))

return inters / (seg1_area seg2_area - inters)

def hierarchical_graph(masks_multiscale, n_sp_actual, knn_graph=32):

n_sp_total = np.sum(n_sp_actual)

A = np.zeros((n_sp_total, n_sp_total))

for level1, masks1 in enumerate(masks_multiscale):

for level2, masks2 in enumerate(masks_multiscale[level1 1:]):

for i, mask1 in enumerate(masks1):

for j, mask2 in enumerate(masks2):

A[np.sum(n_sp_actual[:level1], dtype=np.int) i,

np.sum(n_sp_actual[:level2 level1 1], dtype=np.int) j] = compute_iou_binary(mask1, mask2)

sparsify_graph(A, knn_graph)

return A A.T

n_sp_actual = []

avg_values_multiscale, coord_multiscale, masks_multiscale = [], [], []

# Scales [1000, 300, 150, 75, 21, 7] ]在论文中

for i, (name, sp) in enumerate(zip(['children', 'parents', 'grandparents'], [1000, 300, 21])):

superpixels = slic(img, n_segments=sp)

n_sp_actual.append(len(np.unique(superpixels)))

avg_values_, coord_, masks_ = superpixel_features(img, superpixels)

avg_values_multiscale.append(avg_values_)

coord_multiscale.append(coord_)

masks_multiscale.append(masks_)

A_spatial_multiscale = spatial_graph(np.concatenate(coord_multiscale), img.shape[:2], knn_graph=knn_graph)

A_hier = hierarchical_graph(masks_multiscale, n_sp_actual, knn_graph=None)

很棒!我们还可以做些什么来进一步改善结果?

2.易学的关系

到目前为止,如果我们可视化滤波器,它们将看起来非常原始(就像高斯一样)。 有关更多详细信息,请参见我的GNN教程。 我们想学习一些类似于ConvNets的边缘检测器,因为效果很好。 但是事实证明,使用GNN来学习它们非常困难。 为此,我们基本上需要根据坐标之间的差异在超像素之间生成边缘。 这样,我们将使GNN能够理解坐标系(旋转,平移)。 我们将使用在PyTorch中定义的2层神经网络,如下所示:

pred_edge = nn.Sequential(nn.Linear(2, 32),

nn.ReLU(True),

nn.Linear(32, L))

其中L是预测边数或滤波器数,例如下面的图表中的4.

我们限制滤波器仅根据 |(x₁,y₁) - (x₂,y₂)|之间的绝对差而不是原始值来学习边缘,从而使滤波器变得对称。 这限制了滤波器的容量,但是它仍然比我们的基准GCN使用的简单高斯滤波器好得多。

在我的Jupyter笔记本中,我创建了一个LearnableGraph类,该类实现了在给定节点坐标(或任何其他特征)和空间图的情况下预测边缘的逻辑。 后者用于在每个节点周围定义一个小的局部邻域,以避免预测所有可能的节点对的边缘,因为它昂贵且连接非常远的超像素没有多大意义。

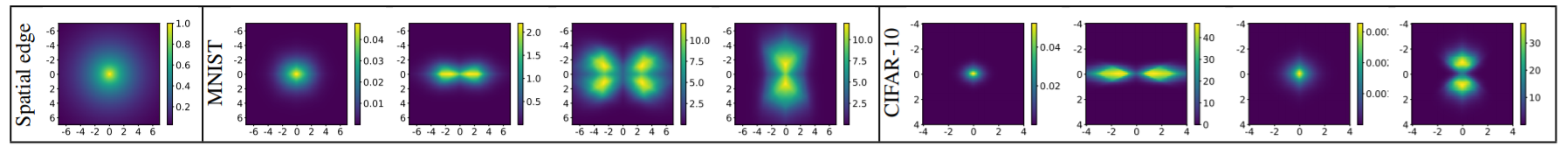

下面,我将训练有素的pred_edge函数可视化。 为此,我假设在其中应用卷积的索引为1的当前节点位于坐标系(x₁,y₁)= 0的中心。 然后,我简单地采样其他节点的坐标(x₂,y₂),并将其输入给pred_edge。 颜色显示边缘的强度取决于与中心节点的距离。

学习到的图也非常强大,但是计算量较大,如果我们生成非常稀疏的图,则可以忽略不计。 32.3%的结果仅比ConvNet低0.4%,如果我们生成更多的过滤器,则可以轻松地改善它!

3. 多尺度GNN

现在,我们有了三个图:空间图,层次图和学习图。 具有空间或层次图的单个图卷积层仅允许特征在“第一邻居”内传播。 在我们的例子中,邻居是软性定义的,因为我们使用高斯来定义层次图的空间图和IoU。 (Defferrard等。 NIPS(2016)提)出了一种多尺度(multihop)图卷积算法,该算法将K-hop邻域内的特征聚合在一起并近似谱图卷积。 有关此方法的详细说明,请参见我的其他文章。 对于我们的空间图,它实质上对应于使用多个不同宽度的高斯。 对于分层图,我们可以通过这种方式在远程子节点之间创建K-hop快捷方式。 对于学习的图,此方法将创建可视化的学习过滤器的多个比例。

使用多尺度图卷积,在我的GraphLayerMultiscale类中实现,结果证明是非常重要的,它使我们的性能比基准卷积神经网络高出0.3%!

4. 以低成本改善关系类型的融合

到目前为止,为了从我们的三个图中学习,我们使用了标准的级联方法。 但是,这种方法有两个问题。 首先,这种融合算子的可训练参数的数量是线性的。 输入和输出要素的维数,比例(K)和关系类型的数量,因此,如果我们一次增加两个或多个这些参数,它的确会快速增长。 其次,我们尝试融合的关系类型可以具有非常不同的性质,并占据流形的非常不同的子空间。 为了同时解决这两个问题,我们提出了类似于(Knyazev等人,NeurIPS-W,2018)的可学习的预测。 通过这种方式,我们将线性相关性解耦,与串联相比,参数数量减少了2-3倍。 此外,可学习的投影变换了多关系特征,因此它们应占据流形的附近子空间,从而促进信息从一种关系传播到另一种关系。

通过使用在下面的GraphLayerFusion类中实现的拟议融合方法,我们将ConvNet击败了达到了34.5%提升1.8%,而参数却减少了2倍! 对于最初对图像的空间结构一无所知的模型,除了以超像素编码的信息外,还给人留下了深刻的印象。 探索其他融合方法(例如这种方法)以获得更好的结果将很有趣。

class GraphLayerFusion(GraphLayerMultiscale):

def __init__(self,

in_features,

out_features,

K,

fusion='pc',

n_hidden=64,

bnorm=True,

activation=nn.ReLU(True),

n_relations=1):

super(GraphLayerFusion, self).__init__(in_features, out_features, K, bnorm, activation, n_relations)

self.fusion = fusion

if self.fusion == 'cp':

fc = [nn.Linear(in_features * K * n_relations, n_hidden),

nn.ReLU(True),

nn.Linear(n_hidden, out_features)]

else:

if self.fusion == 'pc':

fc = [nn.Linear(n_hidden * n_relations, out_features)]

elif self.fusion == 'sum':

fc = [nn.Linear(n_hidden, out_features)]

else:

raise NotImplementedError('cp, pc or sum is expected. Use GraphLayer for the baseline concatenation fusion')

self.proj = nn.ModuleList([nn.Sequential(nn.Linear(in_features * K, n_hidden), nn.Tanh())

for rel in range(n_relations)]) # projection layers followed by nonlinearity

if bnorm:

fc.append(BatchNorm1d_GNN(out_features))

if activation is not None:

fc.append(activation)

self.fc = nn.Sequential(*fc)

def relation_fusion(self, x, A):

B, N = x.shape[:2]

for rel in range(self.n_relations):

y = self.chebyshev_basis(A[:, :, :, rel], x, self.K).view(B, N, -1) # B,N,K,C

if self.fusion in ['pc', 'sum']:

y = self.proj[rel](y) # projection

if self.fusion == 'sum':

y_out = y if rel == 0 else y_out y

continue

# for CP and PC

if rel == 0:

y_out = []

y_out.append(y)

y = self.fc(y_out if self.fusion == 'sum' else (torch.cat(y_out, 2))) # B,N,F

return y

结语

事实证明,有了多关系图网络和一些技巧,我们可以比卷积神经网络做得更好!

不幸的是,在改进GNN的过程中,我们逐渐失去了不变性。 例如,旋转图像后,超像素的形状可能会发生变化,而我们用于节点特征以改善模型的超像素坐标也使其健壮性降低。。

尽管如此,我们的工作只是迈向更好的图像推理模型的一小步,并且我们证明了GNN可以为一个有希望的方向铺平道路。

有关实现的详细信息,请参阅我在Github上的笔记本。

我还高度推荐Matthias Fey的硕士论文,其中包含与非常相关的主题相关的代码

欢迎关注磐创博客资源汇总站:

http://docs.panchuang.net/

欢迎关注PyTorch官方中文教程站:

http://pytorch.panchuang.net/