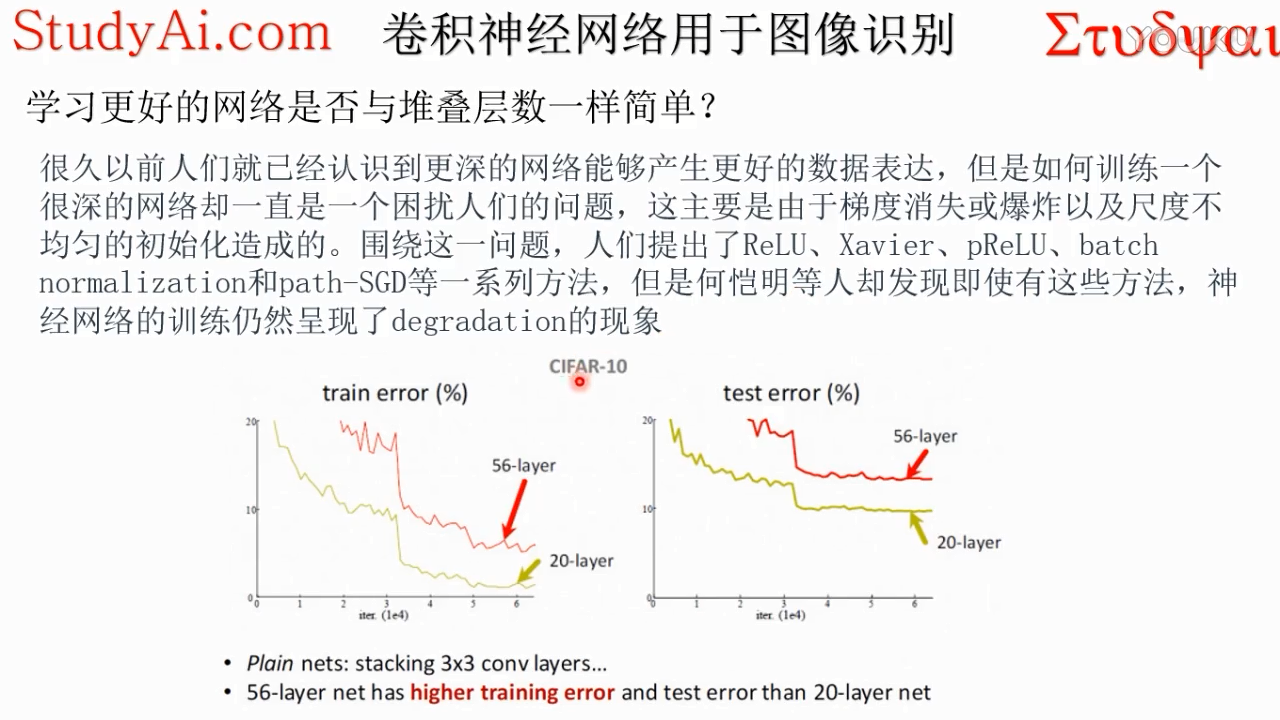

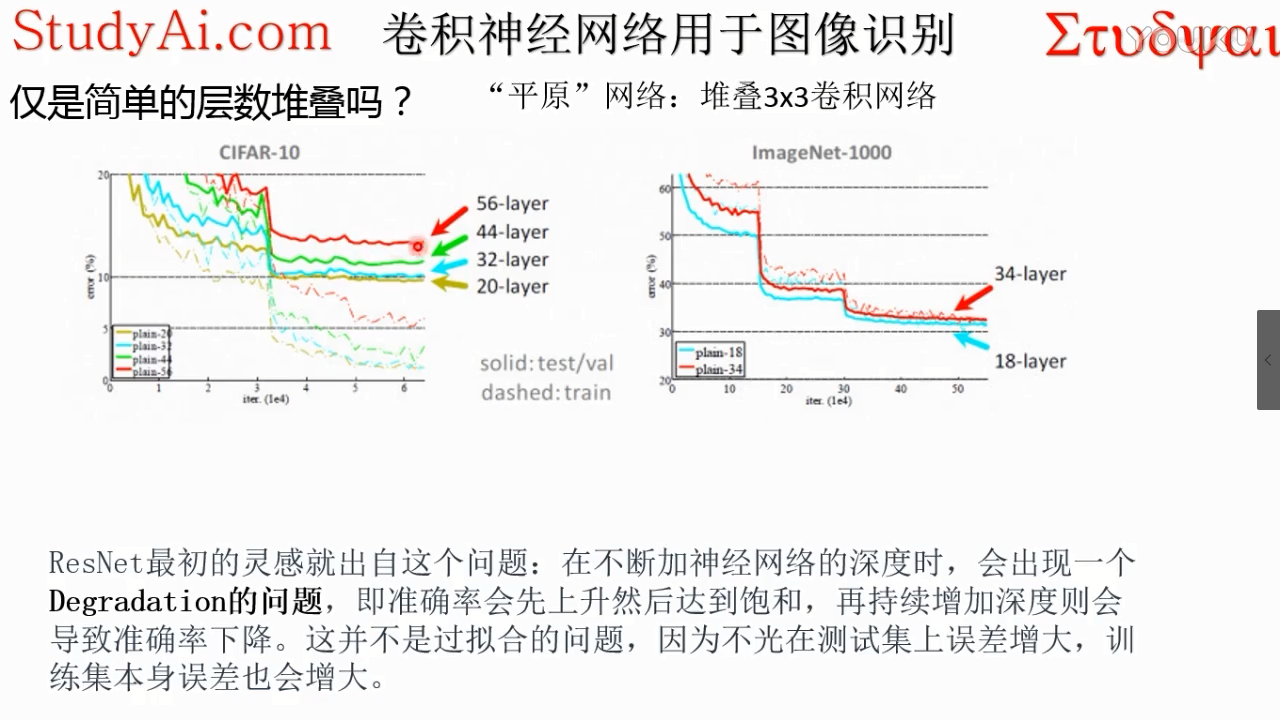

注:平原改为简单堆叠网络

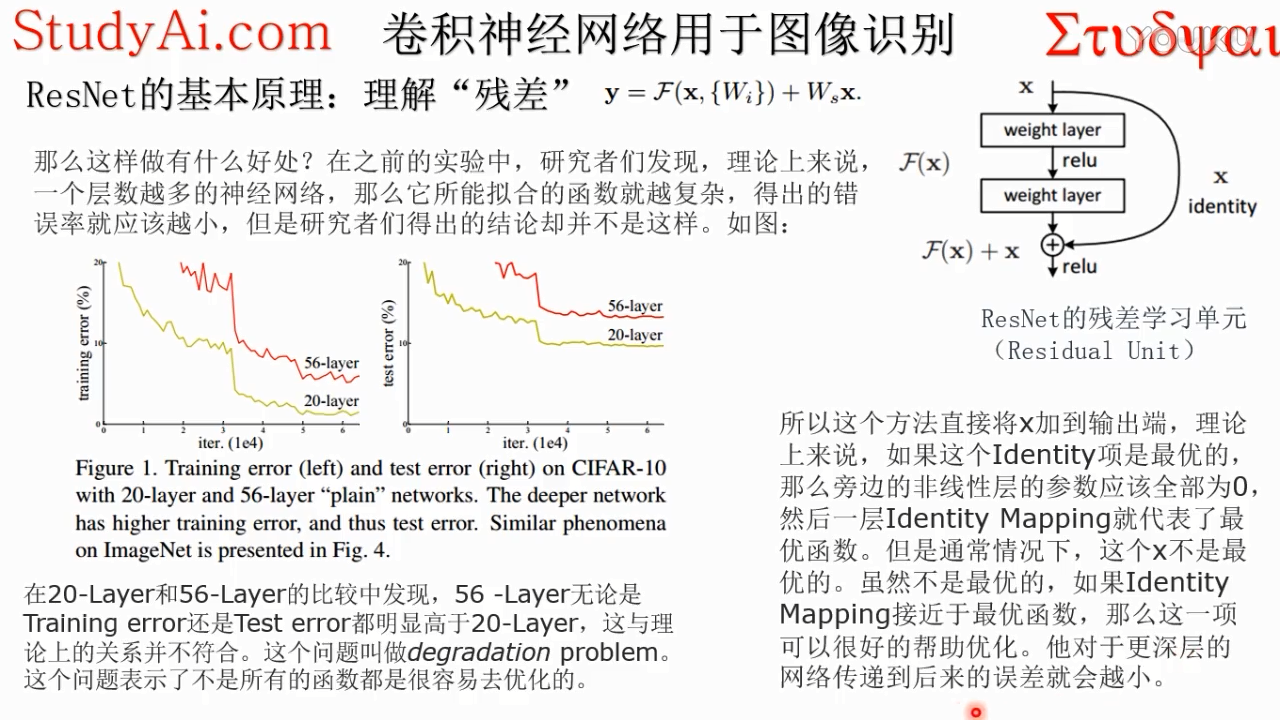

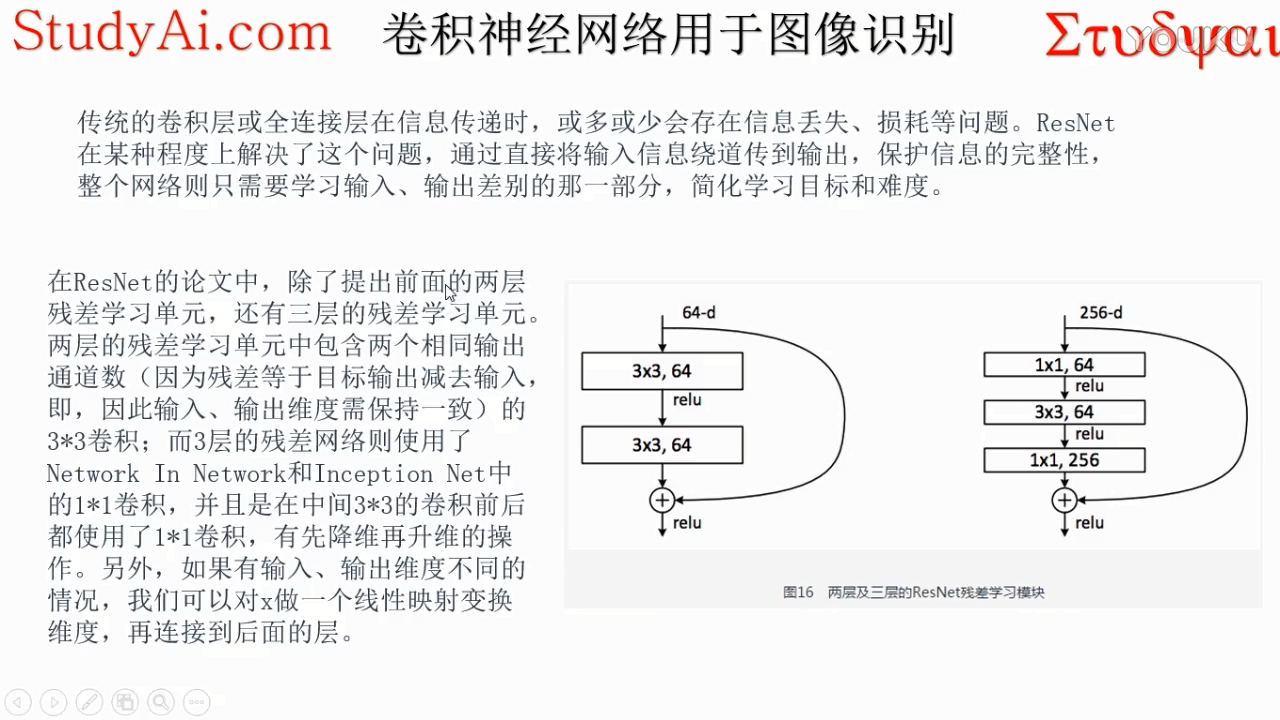

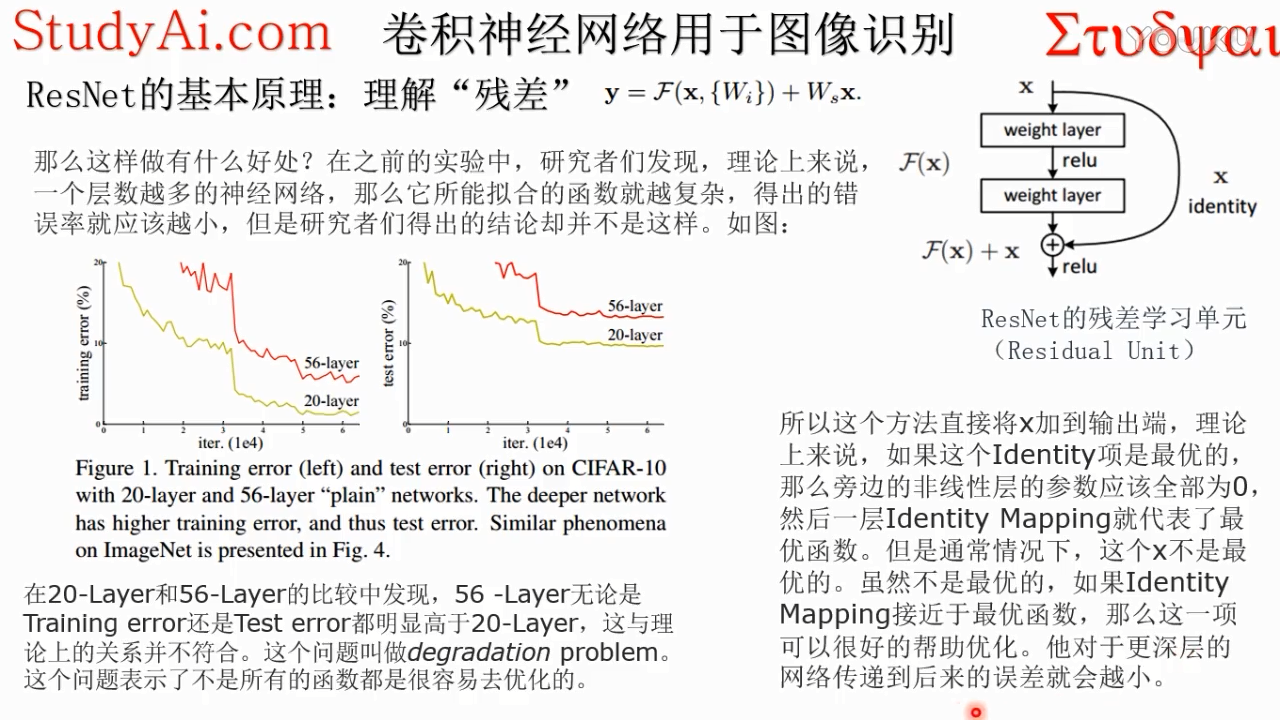

一般x是恒等映射,当x与fx尺寸不同的时候,w作用就是将x变成和fx尺寸相同。

过程:

先用w将x进行恒等映射、扩维映射或者降维映射d得到wx。(没有参数,不需要优化器训练),然后再使用优化器调整这个残差网络,这个时候优化器需要付出的effort就更小了。搜索空间更小,更容易训练

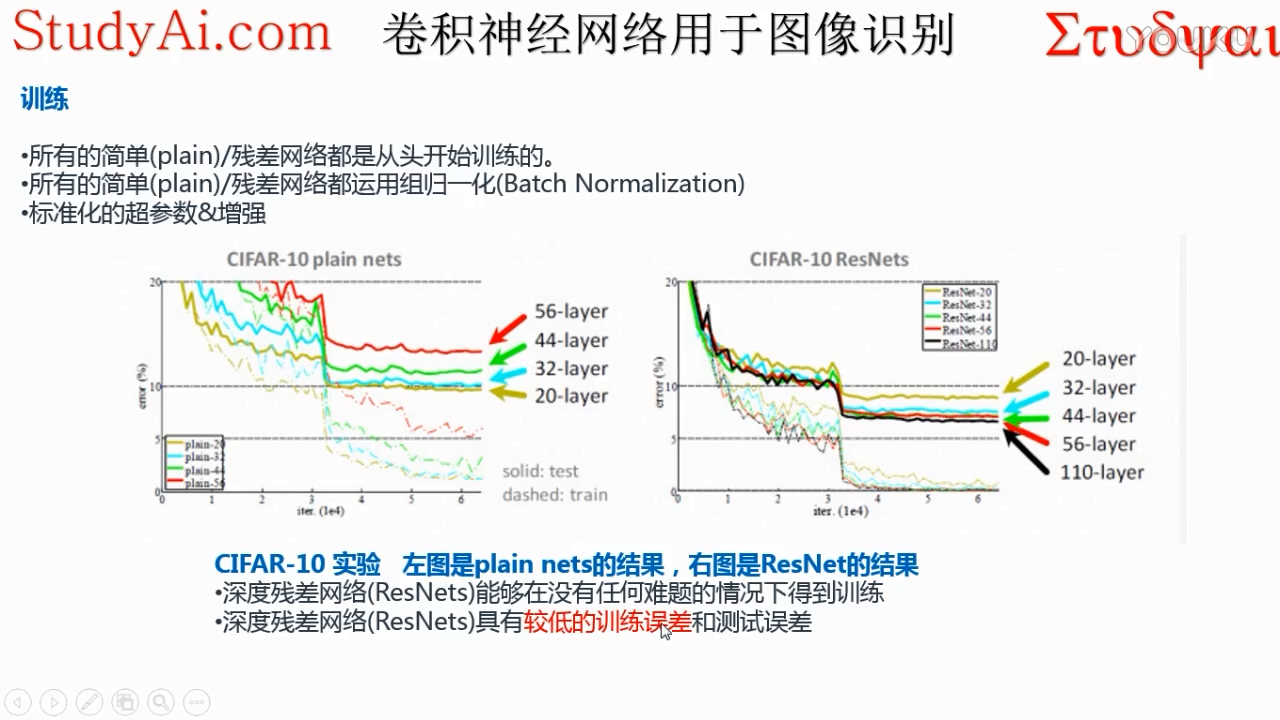

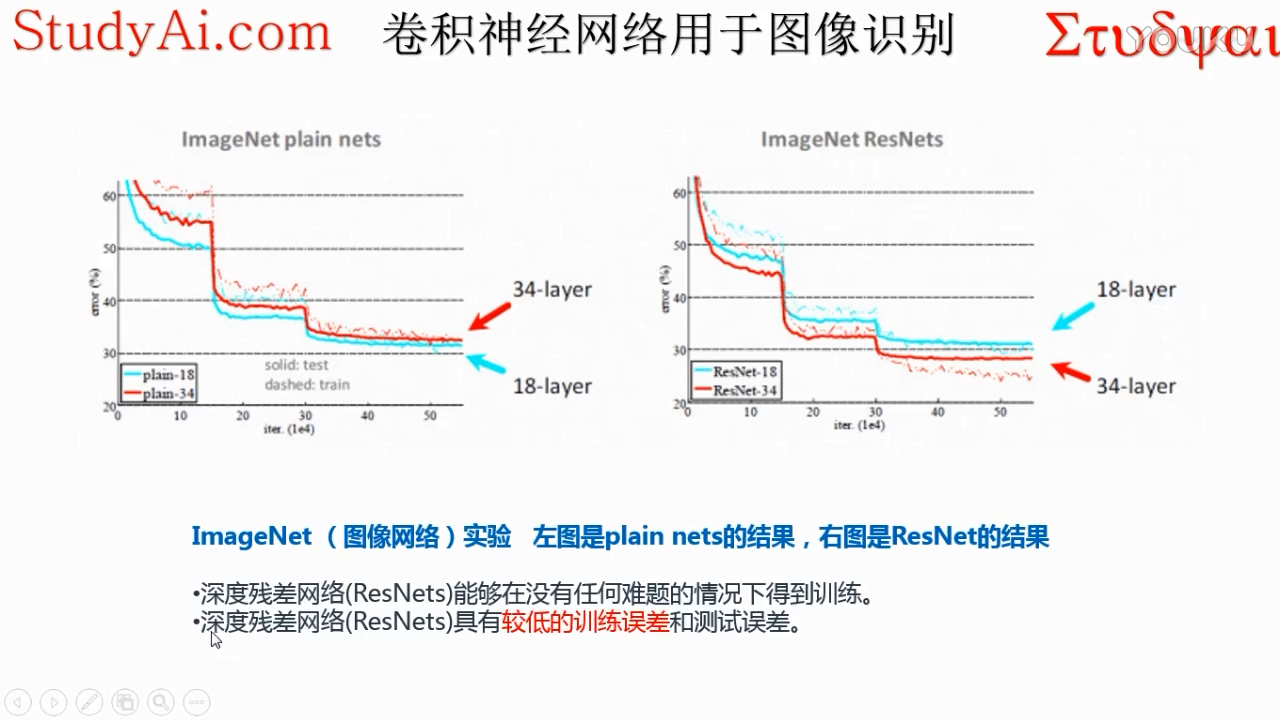

resnets不会发生过拟合!

不训练整体映射,只训练残差映射。

注:平原改为简单堆叠网络

一般x是恒等映射,当x与fx尺寸不同的时候,w作用就是将x变成和fx尺寸相同。

过程:

先用w将x进行恒等映射、扩维映射或者降维映射d得到wx。(没有参数,不需要优化器训练),然后再使用优化器调整这个残差网络,这个时候优化器需要付出的effort就更小了。搜索空间更小,更容易训练

resnets不会发生过拟合!

不训练整体映射,只训练残差映射。