1、2014.Two-stream convolutional networks for action recognition in videos

两个流:空间流做single frame,时间流做multi-frame对稠密光流做CNN处理。两个流分别经过softmax后做class score fusion,(平均法 or SVM)。

2、2015.Towards Good Practices for Very Deep Two-Stream ConvNets

空间流3 channel,时间流10 channel。

trick:

1.空间流在ImageNet上预训练,时间流中的光流转换为0-255灰度图在ImageNet上预训练。

2.learning rate:时间流5e-3,1W个Iteration*0.1,3W次停止。空间流1e-3,4K个Iteration*0.1,1W次停止。

3.data argmentation:由于数据集过小的原因,采用裁剪增加数据集,4个角和1个中心,还有各种尺度的裁剪。从{26,224,192,168}中选择尺度与纵横比进行裁剪。

4.high dropout rate

5.多GPU训练

有PyTorch源码

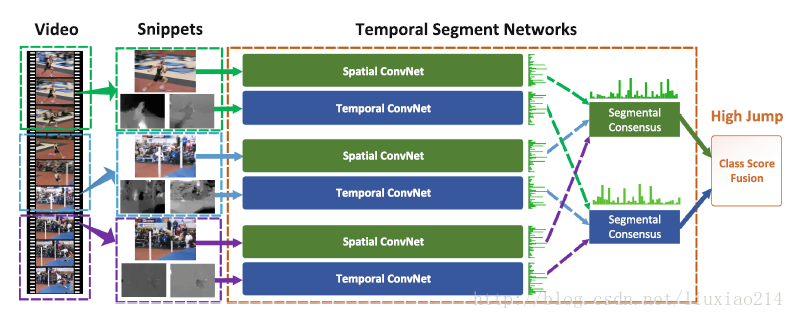

3、16年Temporal Segment Networks Towards Good Practices for Deep Action Recognition

和上一篇是同一批作者,应该是把上一篇的内容丰富了一些,但还没有具体去看。上一篇5页,这一篇17页,后面再说吧。

提出两点贡献:

-

提出一个temporal segment network(TSN)网络,基于视频的动作识别网络,结合了稀疏时间采样策略,和大规模时间结构建模。(将视频分成K个序列,随机抽取一个,网络在所有的序列上共享参数)

-

一系列优化的策略,估计跟上一篇差不太多。

4、16年Convolutional Two-Stream Network Fusion for Video Action Recognition

此论文有公开源代码,用的是MATLAB。

5、17年Hidden Two-Stream Convolutional Networks for Action Recognition

此论文有公开源代码,用的是Caffe。