有哪些 Sensors? 摄像头和激光雷达,毫米波雷达等

sensor 分类:

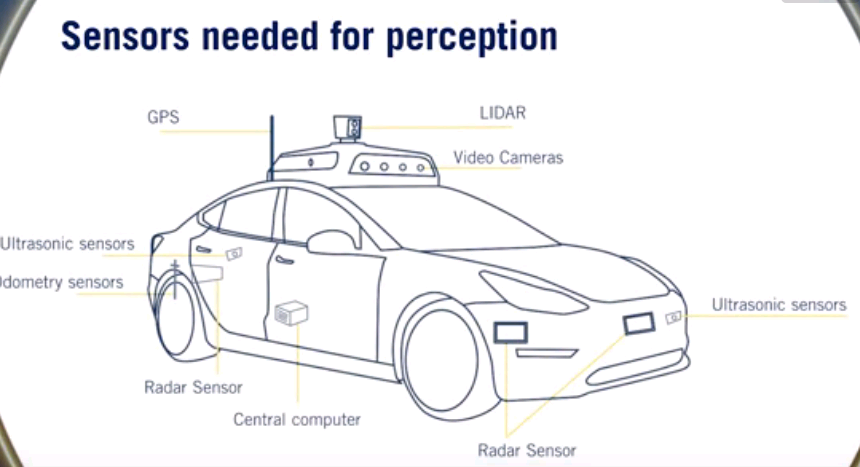

exteroceptive (surrounding), 有 camera(Resolution, FOV, Dynamic range), 立体相机, 双目相机,LIDAR (线数, points/s, rotation rate, FOV), Solid-state LIDAR, RADAR, ULTRASONIC

proprioceptive (internal), 有GNSS(GPS, 北斗, 用在定位,测速,方向), IMU(Inertial Measurement Unit 测加速度,方向,角速度), 轮子测距 wheel odometry

各种传感器典型布局图

from: https://zhuanlan.zhihu.com/p/146911815 (追踪物体速度能力:Radar最好,Camera和Lidar差不多. 不知道为什么?开普勒效应)

有哪些computing hardware?

Drive PX/AGX, Intel & Mobieye EyeQ

还有时钟硬件, 用来对各个sensor 同步时间,这样后续的fusion 才能正常工作.

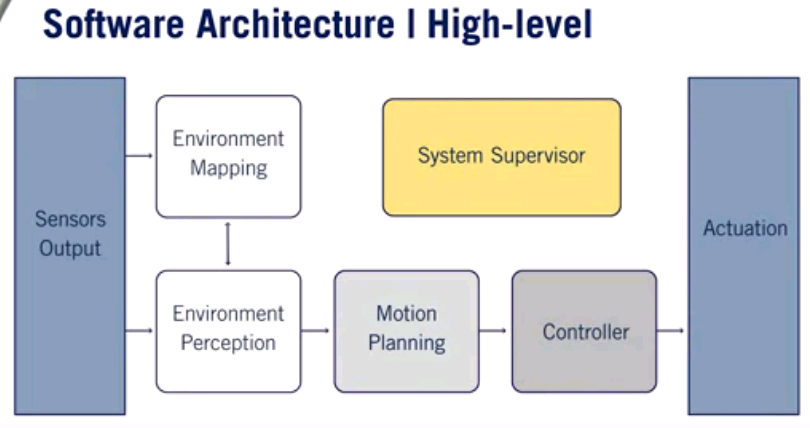

软件有哪些模块?

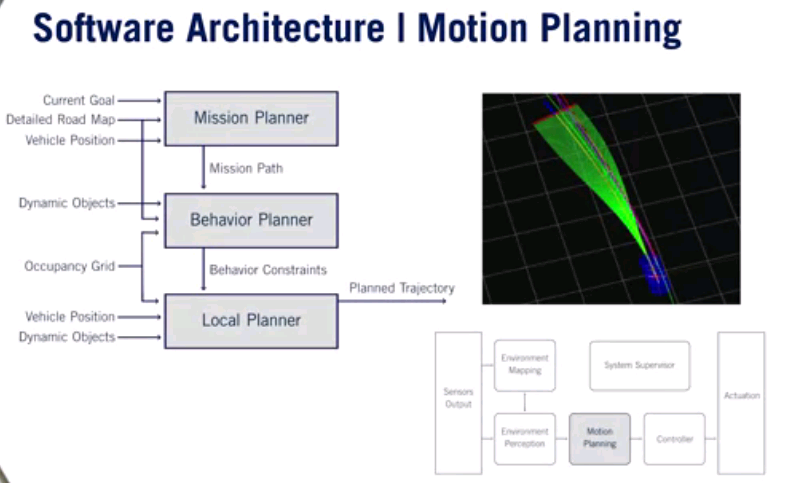

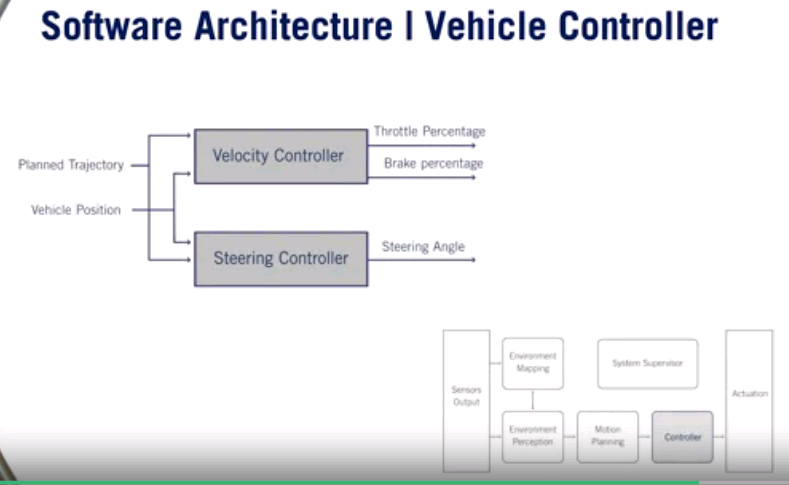

perception, mapping, motion planning, controller, system supervisor

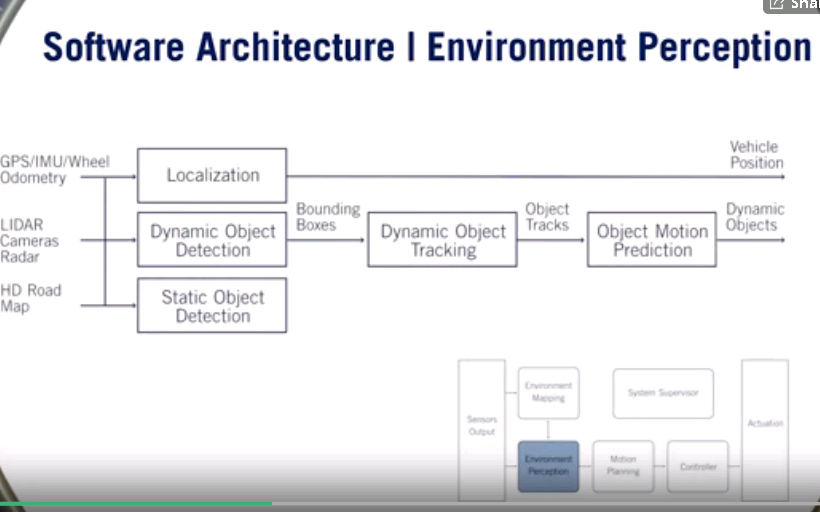

先看 perception

mapping

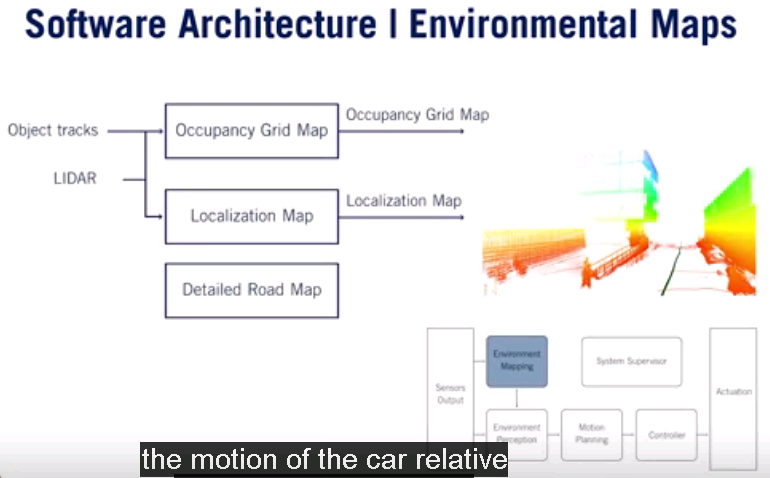

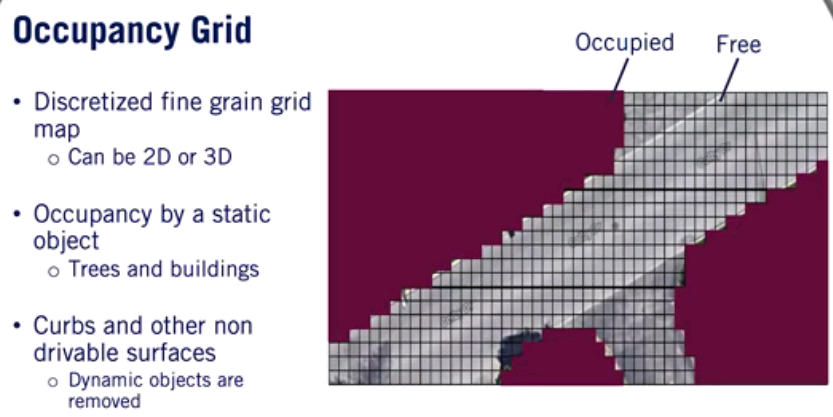

接下来主要讲 Env representation, 也就是3张map

localization map, 比如定位点云

occupancy grip map, 只用来表示static object, 要用filters 过滤掉dynamic objects

detailed road map

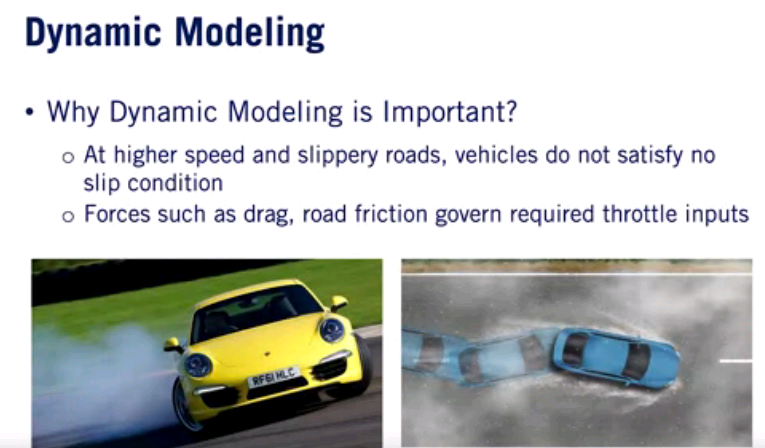

Daynamic Modeling

Kinematic 运动学,包括 position, velocity,主要是低速运动的物体的

Dynamic 动力学,我理解就是动量动能那些,主要是高速运动的物体的

2D 旋转矩阵

Ref

- LiDAR & Camera Fusion in Self-Driving Cars

- Coursera, Self-driving course from Toronto University