1)贴上视频学习笔记,要求真实,不要抄袭,可以手写拍照。

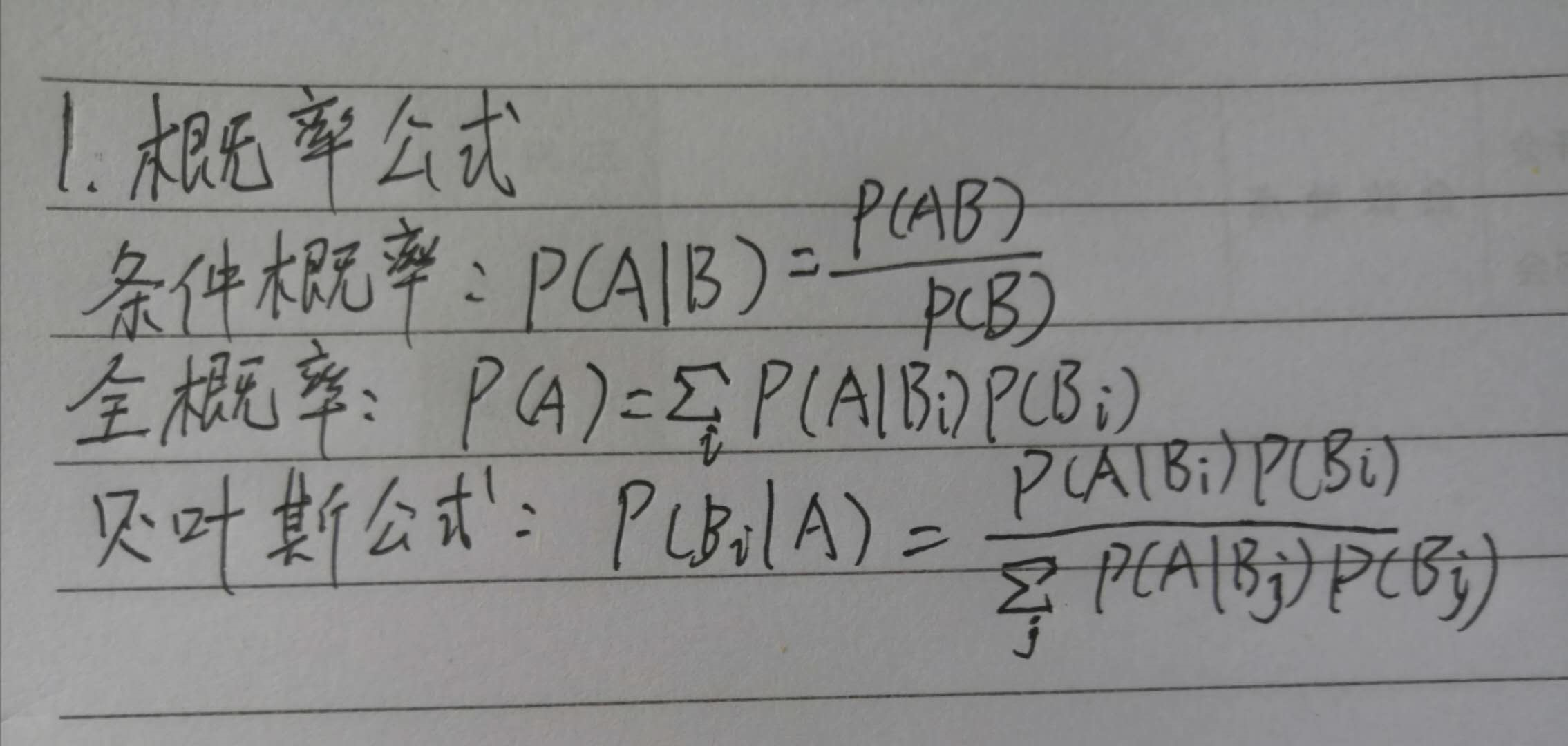

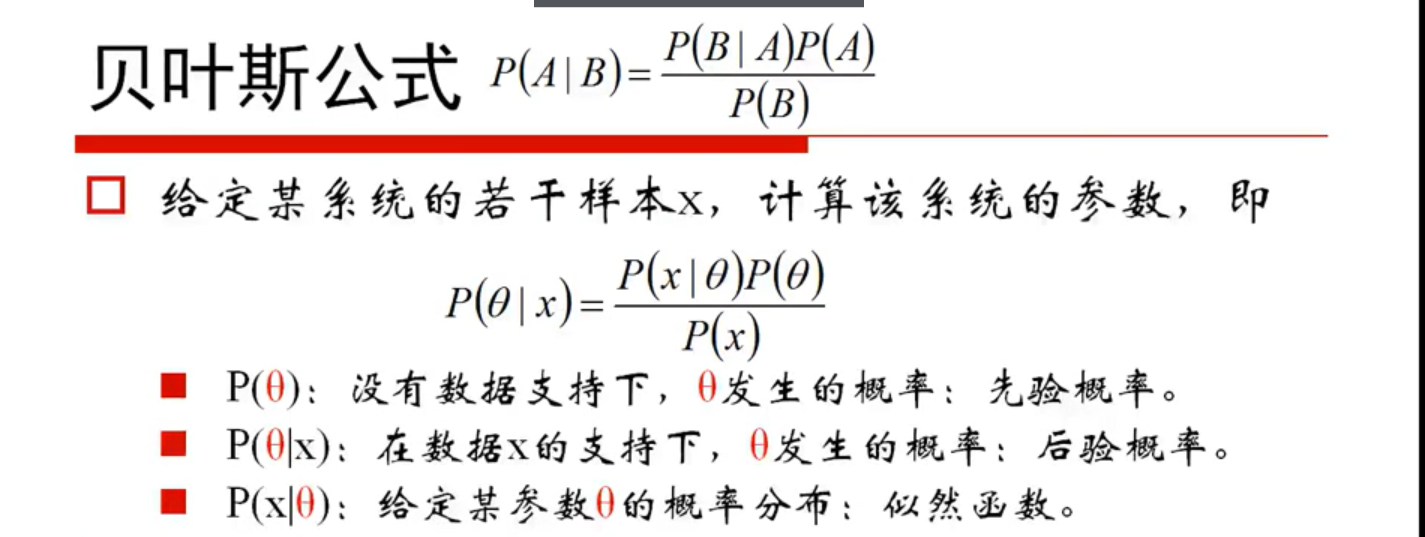

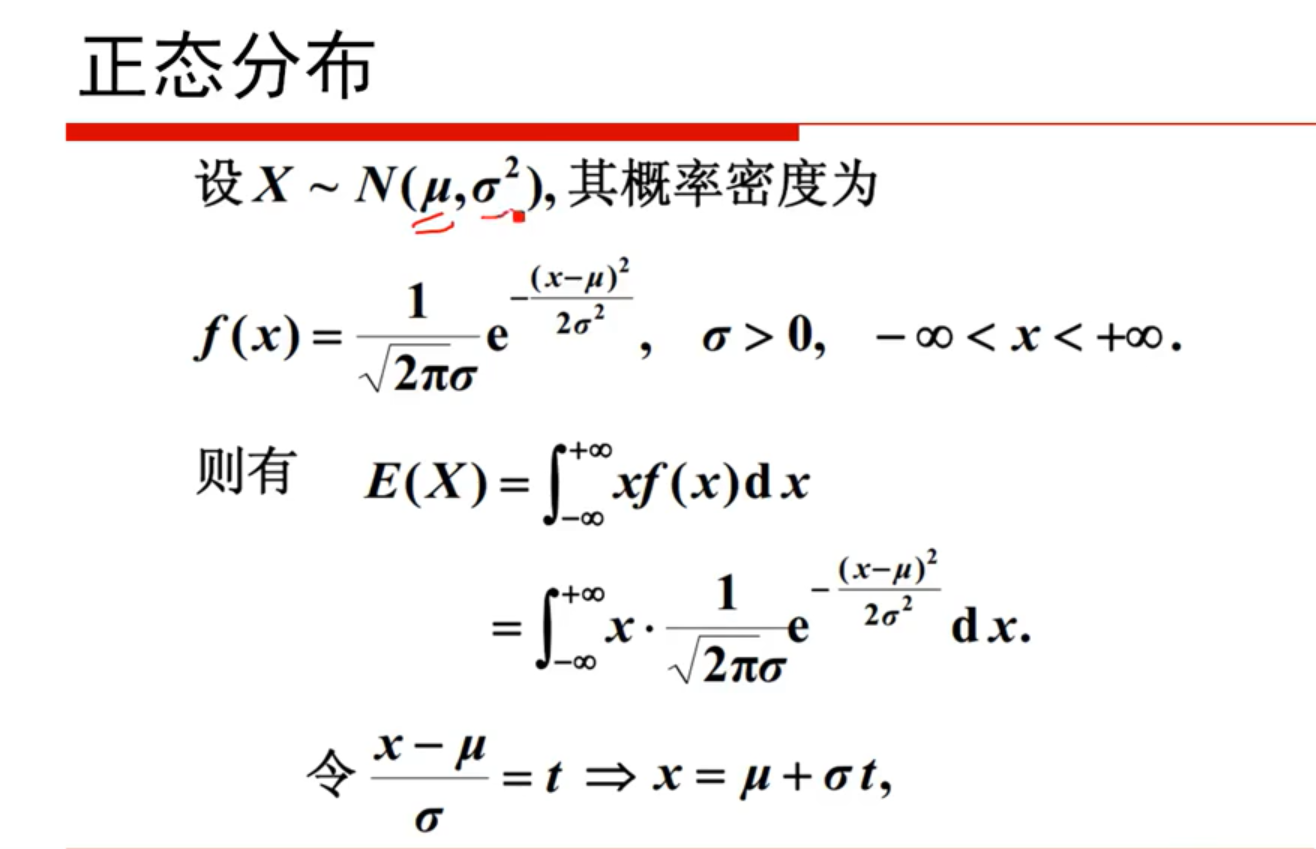

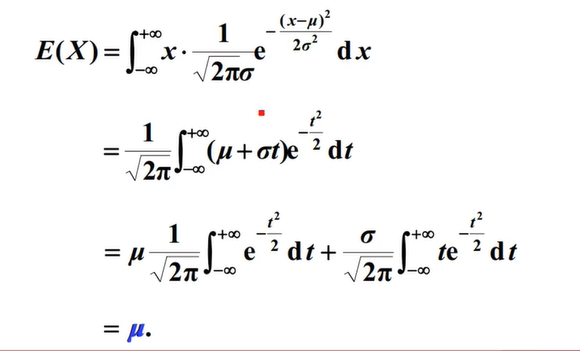

概率公式

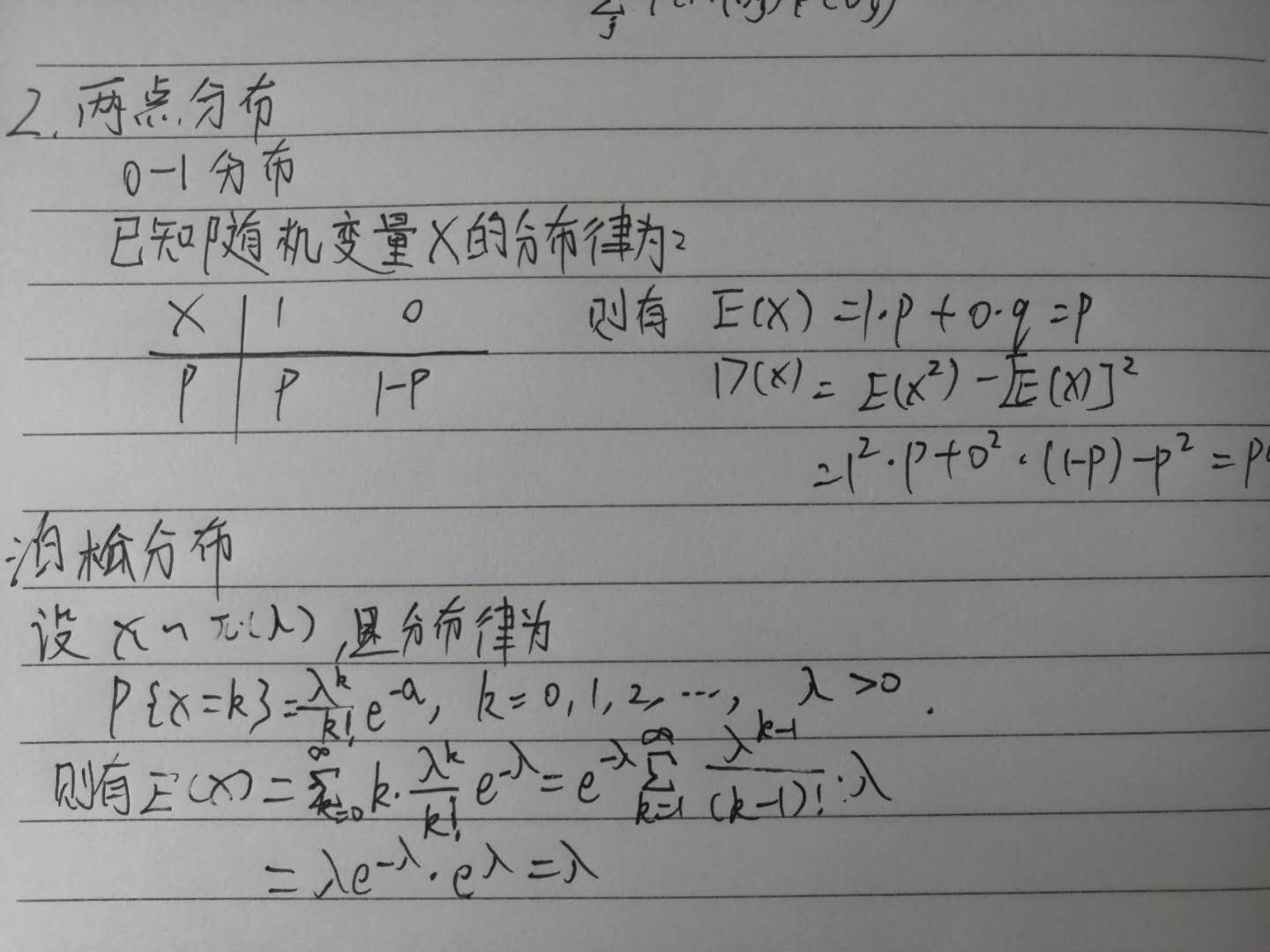

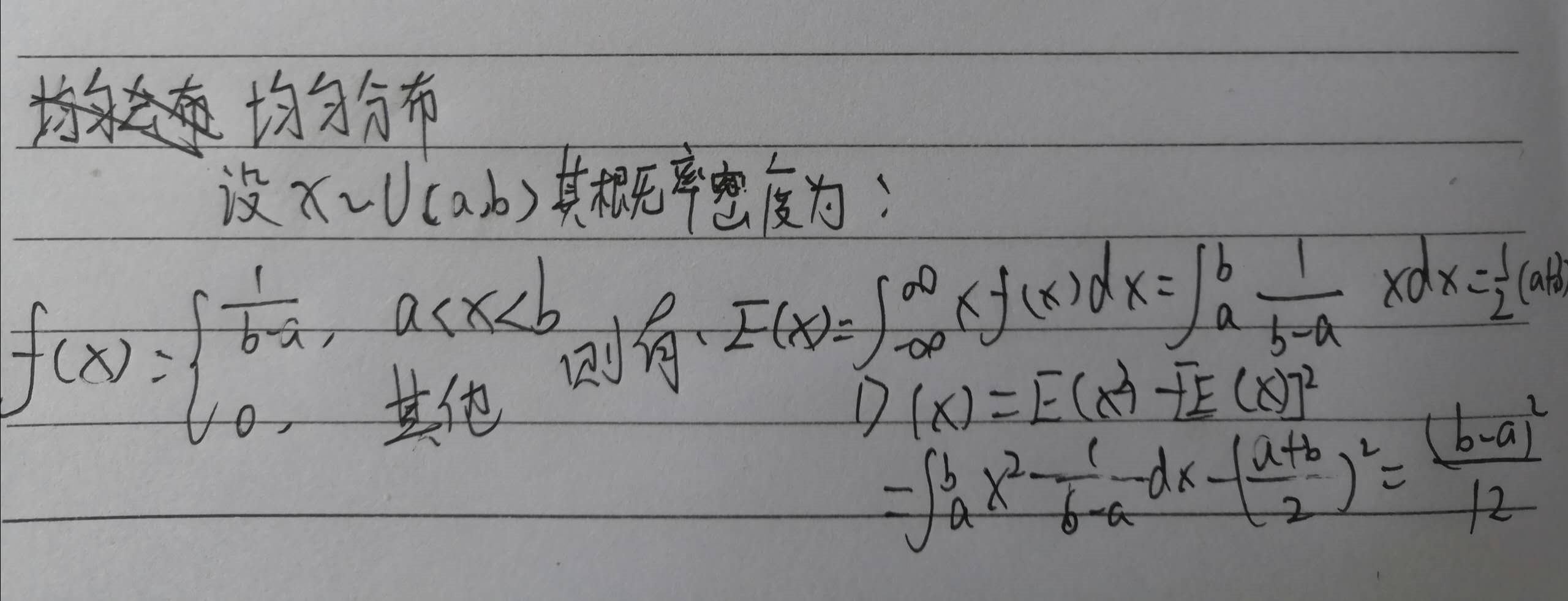

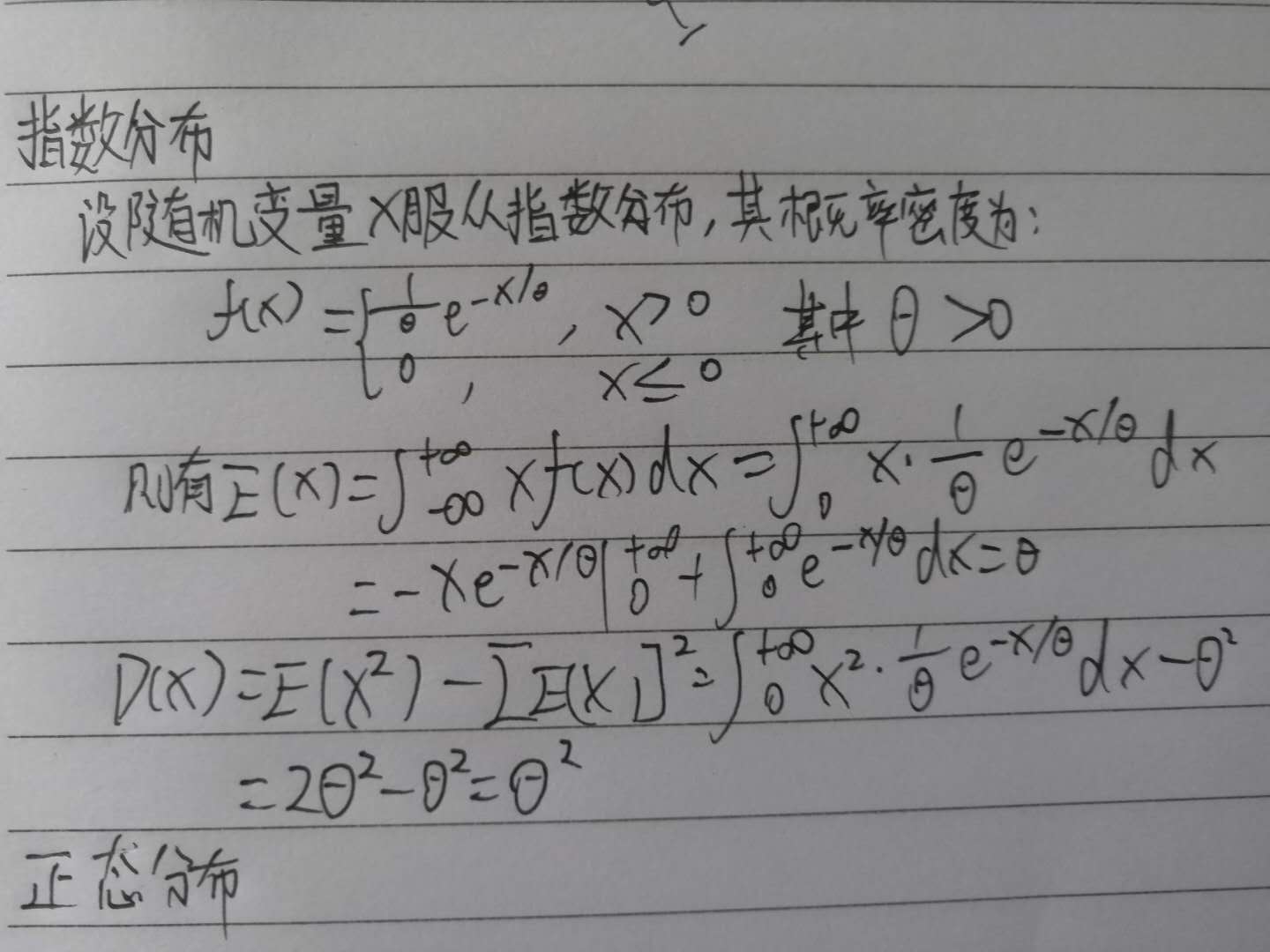

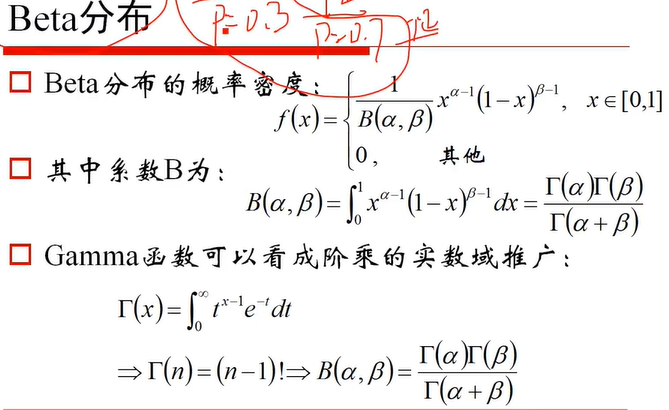

分布式

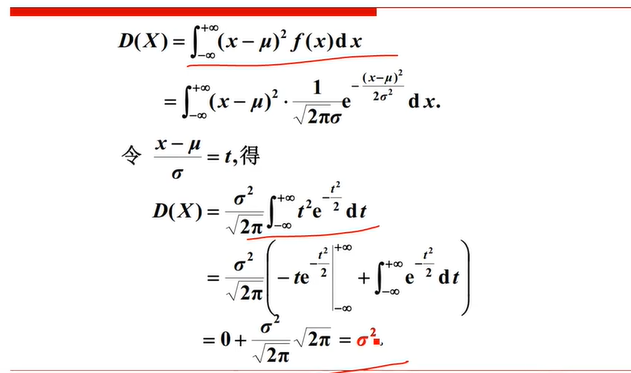

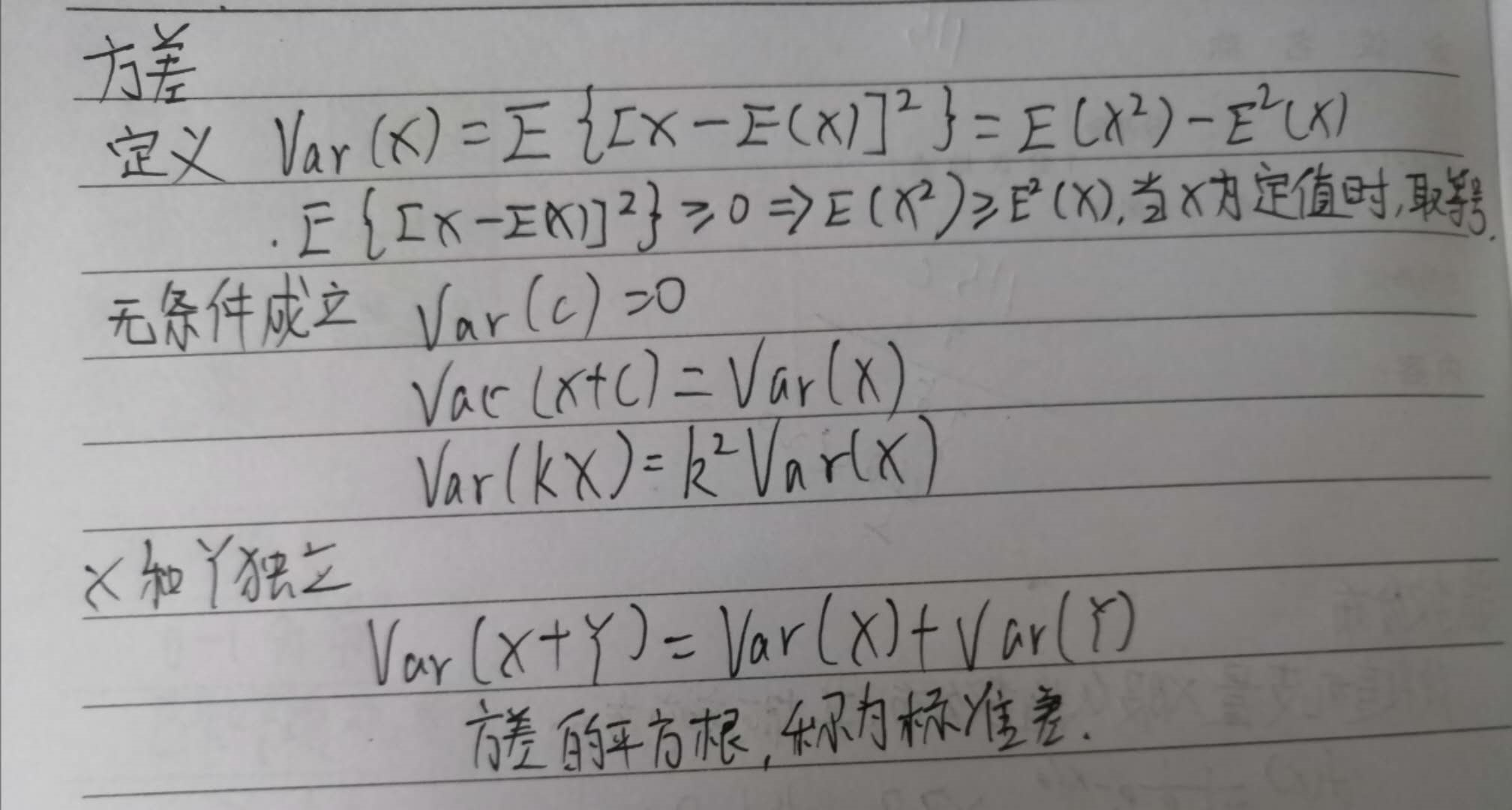

方差

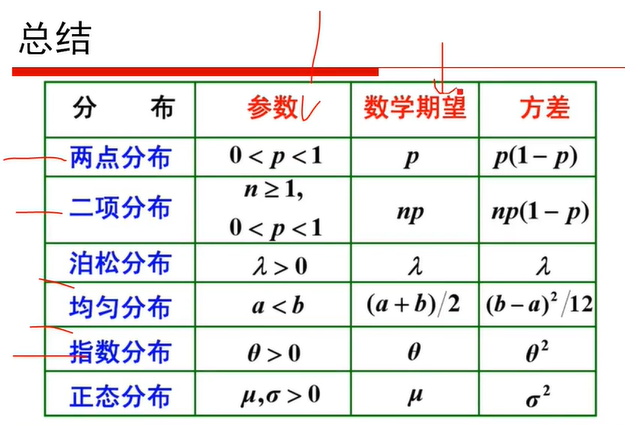

小结

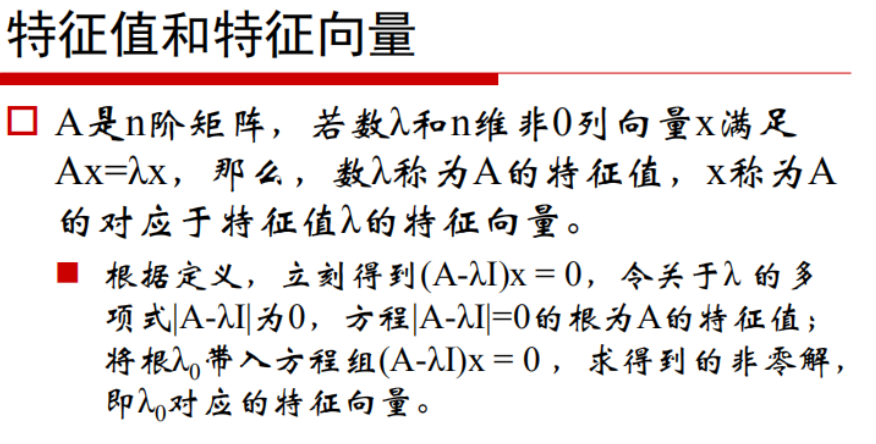

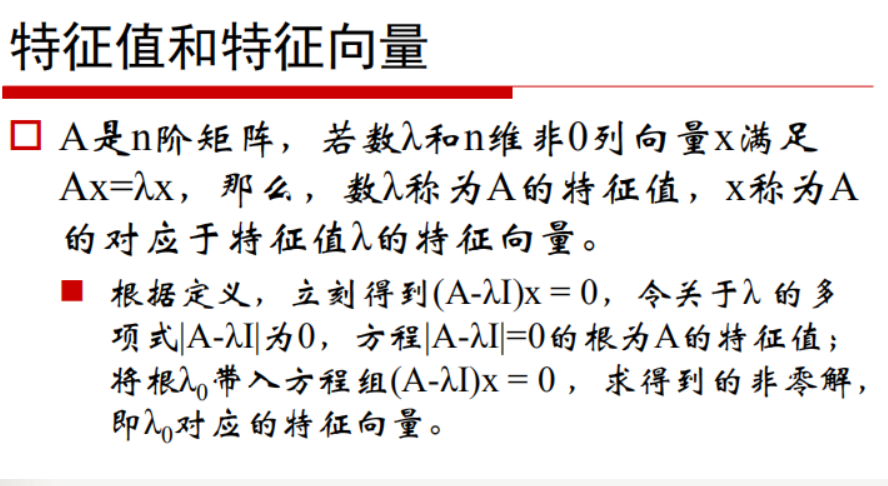

3.矩阵和线代

2)用自己的话总结“梯度”,“梯度下降”和“贝叶斯定理”。

1、梯度:

梯度的本意是一个向量,表示某一函数在该点处的方向导数沿着该方向取得最大值,即函数在该点处沿着该方向变化最快,变化率最大。

2.梯度下降:

梯度下降法简单来说就是一种寻找目标函数最小化的方法,

每一个机器学习模型都有一个损失函数,学习的目的,就是将损失函数最小化。

3.叶贝斯定理:

一切概率都是人们根据自己拥有的信息来推断某件事情发生的可能性,这是一种主观的度量。

P(A|B)= P(B|A)P(A)/P(B)

公式顶一切,P(A|B)当事件B发生的条件下,事件A的条件概率,P(B|A)是当事件A发生的条件下,事件B的条件概率,

P(A)和P(B)分别是事件A和B的先验概率,在贝叶斯概率中,也就是我们对它们概率的一个估计。