viewing frustum: 称视景体、视锥,是三维世界中在屏幕上可见的区域,即虚拟摄像机的视野。

Author

一作: Charles R. Qi 四作: Hao Su

又是他俩,PontNet, PointNet++ CVPR2017, NIPS2017,又来个CVPR2018, 人生赢家啊

Abstract

解决3D object detection问题,使用RGB-D data(使用depth sensore),不同于之间的2D RGB-D图像和3D voxels, 他们经常模糊3D pattern以及3D data的不变性,本文直接作用在RGB-D scan生成的原始点云上

虽然之前PointNet能在小scale point clouds中分割得很好,但是一个主要问题是如何在大规模场景中有效地检测物体 detect objects。

利用降维技术和成熟的2D object detectors, 本文提出Frustum PointNet framework解决了以上的问题。

本框架超过SOTA,并且high efficiency.(runing at 5 fps) 【RGB-D & detection】

这篇论文虽然起名时RGB-D data,但是实际使用的还是点云数据

Introduction

3D sensors已经广泛部署于手机和无人机上,所以现在有越来越多的3D data, 本文学习一个更重要的3D perception tasks--3D object detection

之前的工作大多是把3D数据转换成2D数据(投影)或者体素数据来处理的,但是这样就去失去3D数本质的一些特征以及不变性

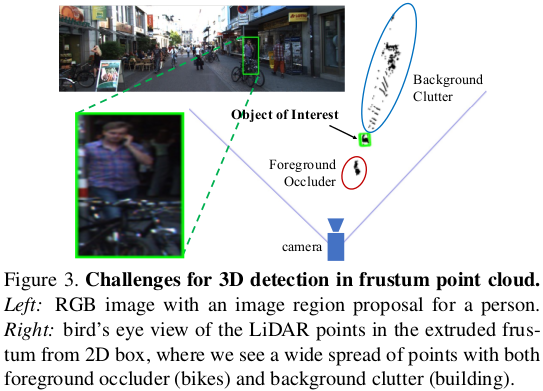

主挑战:

how to efficiently propose possible locations of 3D objects in a 3D space.

3D search的计算复杂度特别高,会随着分辨率增高计算复杂度增高,对于一些大场景或者实时的应用(自动驾驶)不是很实际

本文利用成熟的2D检测技术,通过降维方式

之前的工作都是将RGB-D数据作为2D map用CNN处理,本文更加3D利用depth map映射到point cloud从而直接处理point cloud

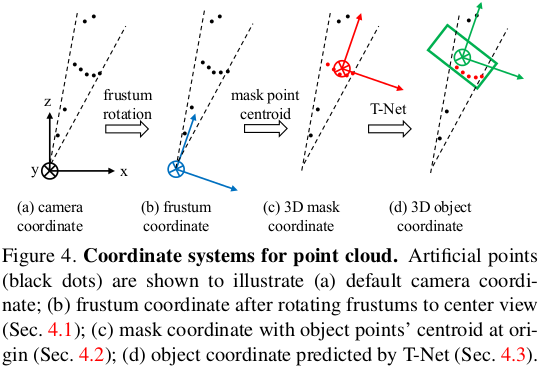

首先会对3D数据进行变换到一个规范框架,通过alignment,就可以不用考虑一些姿态的变化

在KITTI 3D object detection中超过了SOTA, 而且high efficiency

通过不同描述RGB-D data的方式来进行3D detection

- Front view image based methods: 用2D RGB图像

- Bird's eye view based methods:

-

bird's-eye view is an elevated view of an object from above, with a perspective as though the observer were a bird, often used in the making of blueprints, floor plans, and maps

- 3D based methods: point clouds, 3D voxel, mesh

RGB-D data The depth data, obtained from LiDAR or indoor depth sensors, is represented as a point cloud in RGB camera coordinates.

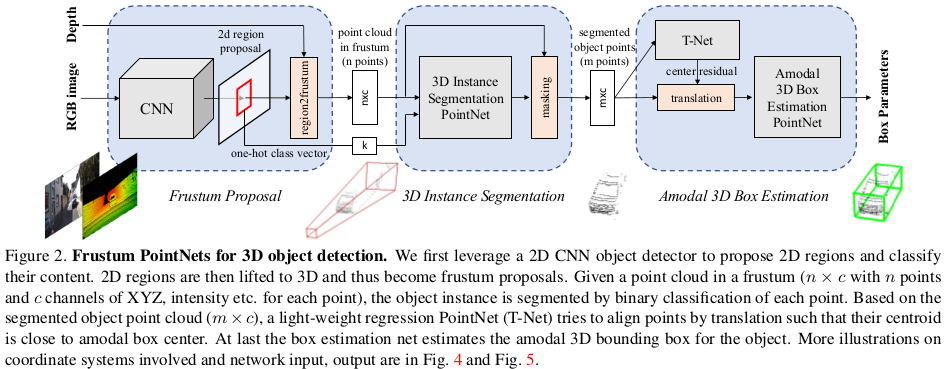

3D Detection with Frustum PointNets

模型主要分为3部分:

- frustum proposao

- 3D instance segmentation

- 3D amodal bounding box estimation

对于实时3D sensor采集的3D数据还是比2D数据的分辨率要低很多,所以用2D图片和2D目标检测的方法来提proposal(同时进行分类)效果很好

This normalization helps improve the rotation-invariance of the algorithm.