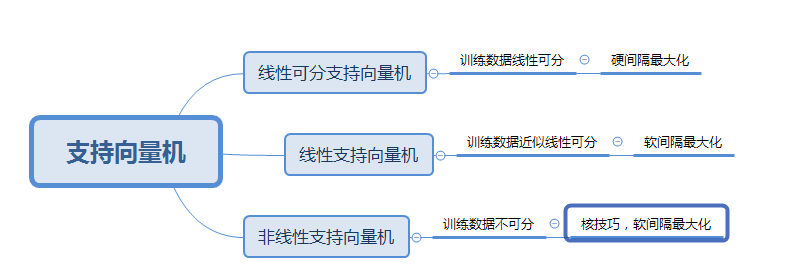

一.支持向量机的学习方法

二.线性可分支持向量机

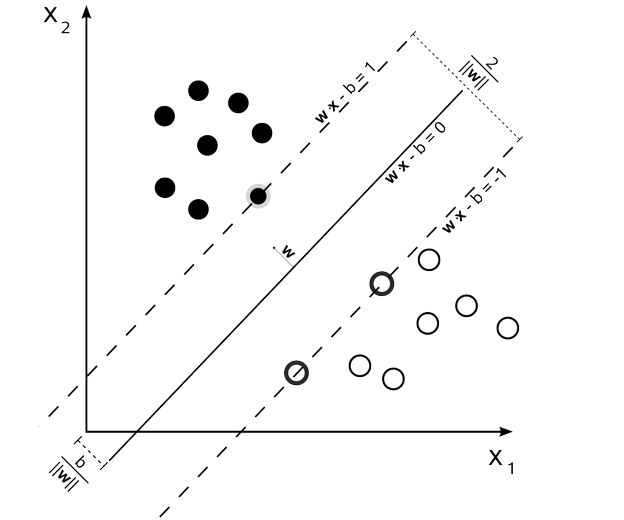

学习的目标是在特征空间中找到一个分离超平面,能将实例分到不同的分类。分离超平面的对应的方程 ,它由法向量

,它由法向量 和截距b决定,分离超平面将特征空间划分为两部分,一部分为正类,一部分为负类。法向量指向的一侧为正类,另一侧为负类。

和截距b决定,分离超平面将特征空间划分为两部分,一部分为正类,一部分为负类。法向量指向的一侧为正类,另一侧为负类。

-

函数间隔

一般来说,一个点距离分离超平面的远近可以表示分类预测的确信程度。在超平面 确定的情况下,

确定的情况下, 能够相对的表示点x距离超平面的远近。而

能够相对的表示点x距离超平面的远近。而 的符号与类标记y的符号是否一致能够表示分类是否正确。所以可用量

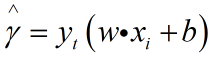

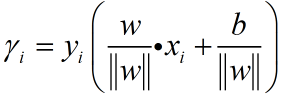

的符号与类标记y的符号是否一致能够表示分类是否正确。所以可用量 来表示分类的正确性及确信度,这就是函数间隔。即

来表示分类的正确性及确信度,这就是函数间隔。即 ,定义超平面(w,b)关于训练数据集T的函数间隔为超平面(w,b)关于T中所有样本点

,定义超平面(w,b)关于训练数据集T的函数间隔为超平面(w,b)关于T中所有样本点

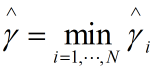

的函数间隔之最小值,即

的函数间隔之最小值,即 。

。

但这样定义的函数间隔有问题,即如果成比例的改变w和b(如将它们改成2w和2b),则函数间隔的值f(x)却变成了原来的2倍(虽然此时超平面没有改变),所以只有函数间隔还远远不够。

事实上,我们可以对法向量w加些约束条件,如规范化, 从而引出真正定义点到超平面的距离--几何间隔(geometrical margin)的概念。即:

从而引出真正定义点到超平面的距离--几何间隔(geometrical margin)的概念。即:

定义超平面(w,b)关于训练集T的几何间隔为超平面(w,b)关于T中所有样本点的几何间隔的最小值,即:

-

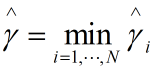

间隔最大化

支持向量机的基本想法是求解能够正确划分训练数据集并且几何间隔最大的分离超平面,也就是说,不仅将正负实例点分开,而其对最难分的实例点(离超平面最近的点)也有足够大的确信度将他们分开。这样的超平面应该对未知的新实例有很好的分类预测能力。

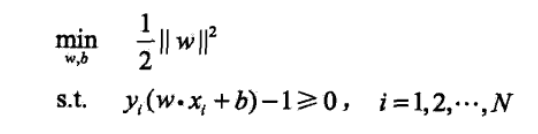

即表示为下面的约束最优化问题:

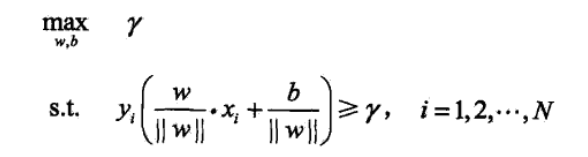

等价于求解:

综上所述,就有下面的线性可分支持向量机的学习算法--最大间隔法

1.构造并求解约束最优化问题:

求得最优解w,b。

2.由此得到分离超平面:

分类决策函数

-

学习的对偶算法

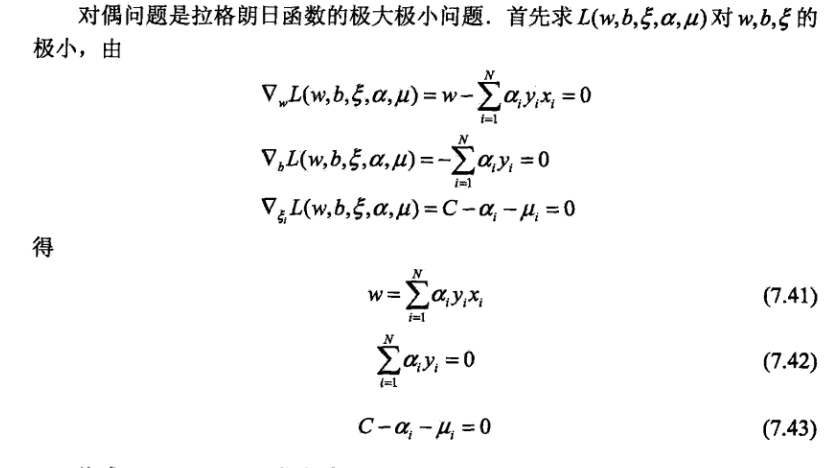

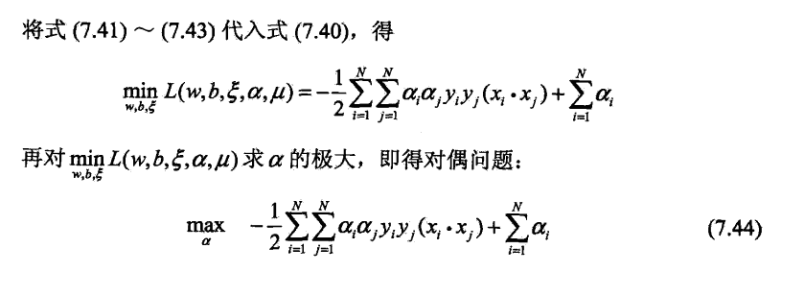

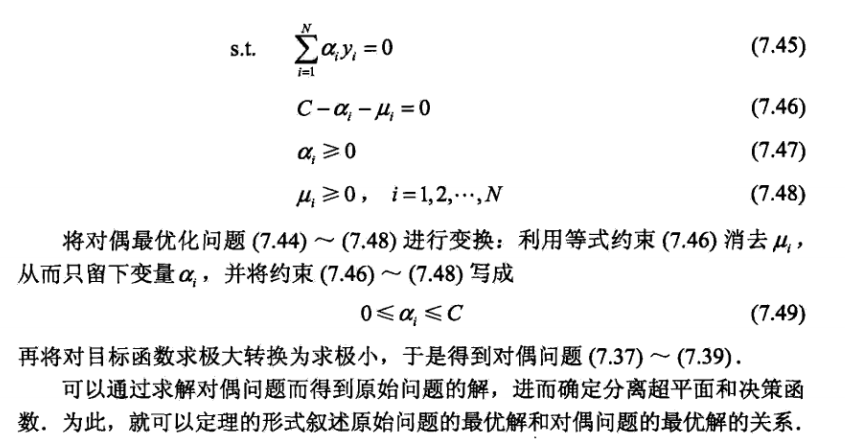

在求解可支持向量机的最优化问题,应用拉格朗日对偶性,通过求解对偶问题得到原始问题的最优解。

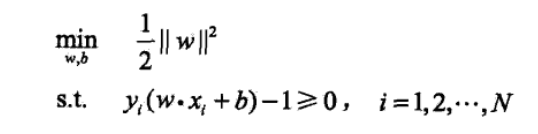

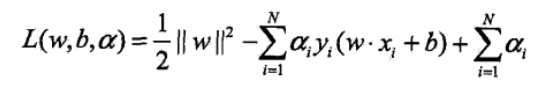

定义拉格朗日函数:

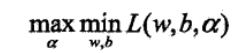

原始问题的对偶问题是极大极小问题:

所以,为了得到对偶问题的解,需要先求 对w,b的极小,再求对

对w,b的极小,再求对 的极大。

的极大。

1.