目录:

1.修改主机名和用户名

2.配置静态IP地址

3.配置SSH无密码连接

4.安装JDK1.7

5.配置Hadoop

6.安装Mysql

7.安装Hive

8.安装Hbase

9.安装Sqoop

********************

5.配置Hadoop(伪分布式)

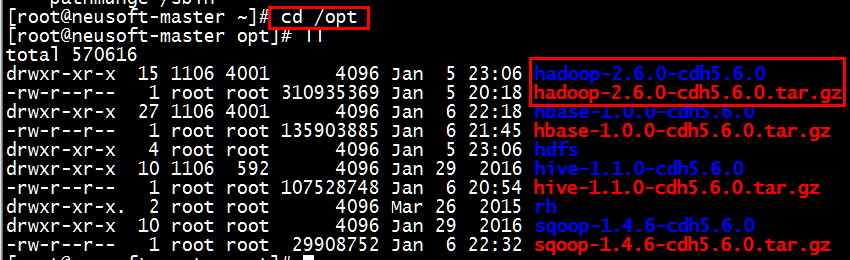

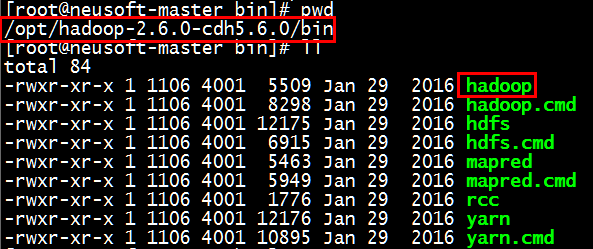

(1)通过SecureCRT上传到Centos中/opt目录,并解压文件

tar -zxvf hadoop-2.6.0-cdh.5.6.0

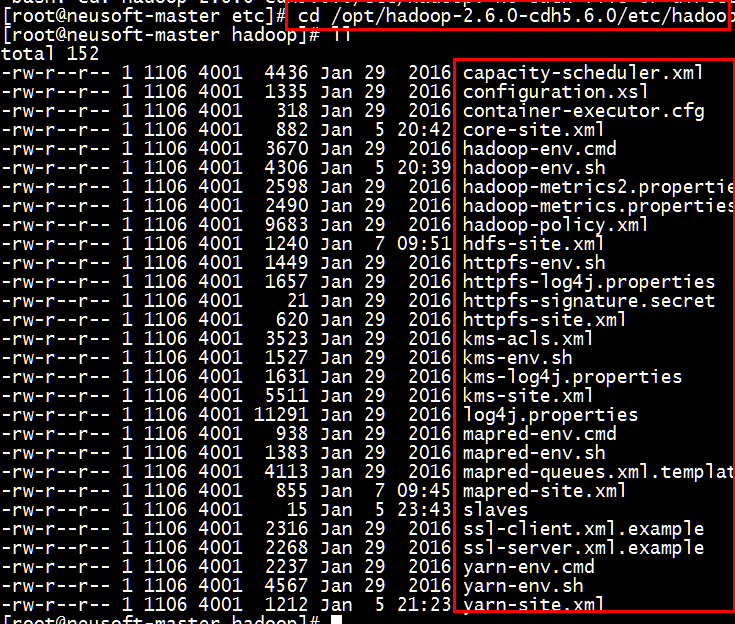

(2)[root@neusoft-master etc]# cd /opt/hadoop-2.6.0-cdh5.6.0/etc/hadoop #配置hadoop的配置文件存放处

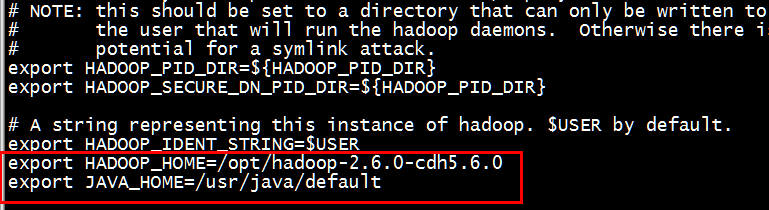

(3)修改hadoop-env.sh,在文件末尾追加

export HADOOP_HOME=/opt/hadoop-2.6.0-cdh5.6.0

export JAVA_HOME=/usr/java/default

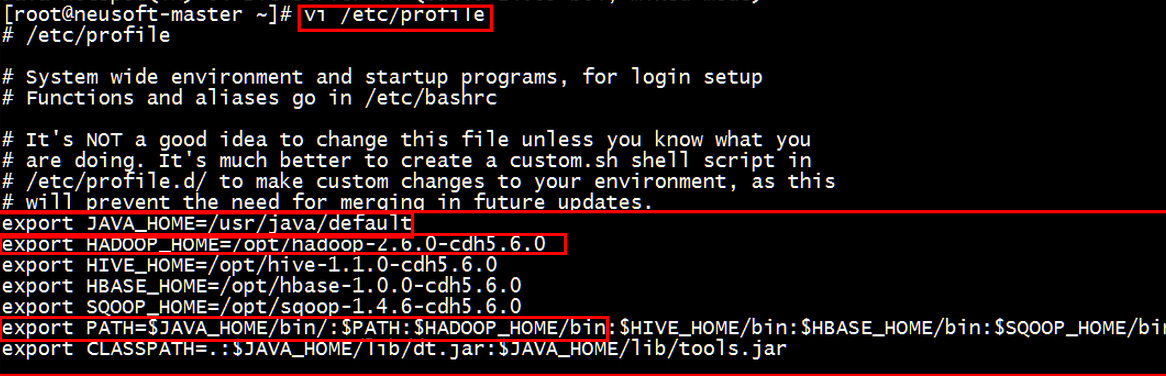

(4)修改/etc/profile文件

-

增加HADOOP_HOME及PATH目录

-

配置文件生效:source /etc/profile (务必记住)

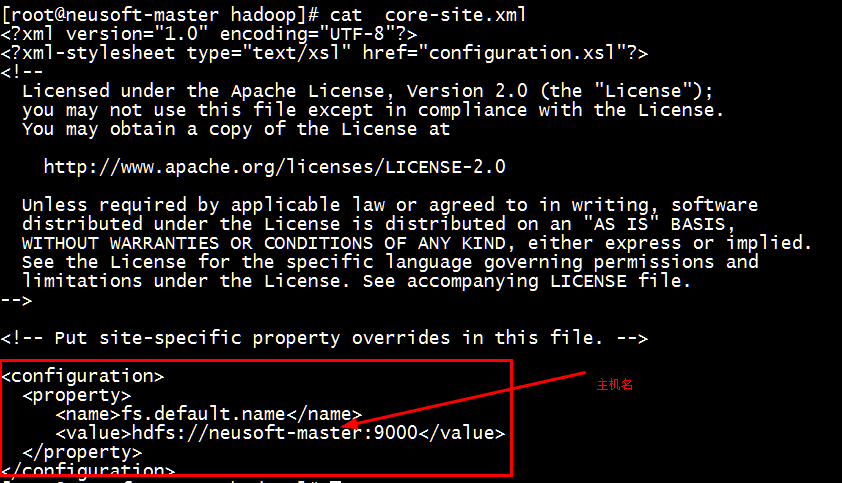

(5)修改core-site.xml,如下

<configuration>

<property>

<name>fs.default.name</name>

<value>hdfs://neusoft-master:9000</value>

</property>

</configuration>

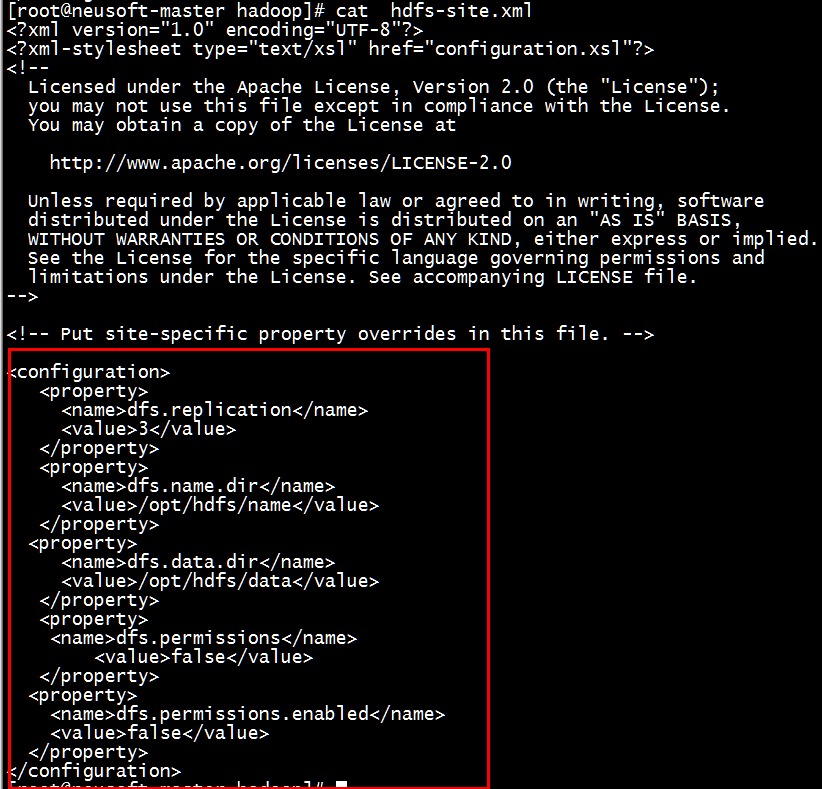

(6)修改hdfs-site.xml

<configuration>

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

<property>

<name>dfs.name.dir</name>

<value>/opt/hdfs/name</value>

</property>

<property>

<name>dfs.data.dir</name>

<value>/opt/hdfs/data</value>

</property>

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

<property>

<name>dfs.permissions.enabled</name>

<value>false</value>

</property>

</configuration>

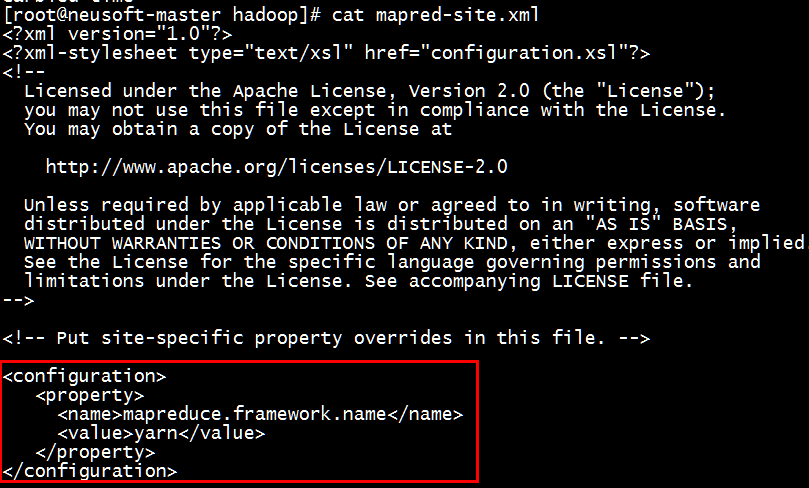

(7)修改mapred-site.xml

mapred-site.xml 在hadoop文件中是以临时文件存放,需要做如下修改之后在修改对应配置文件

cp mapred-site.xml.template mapred-site.xml

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

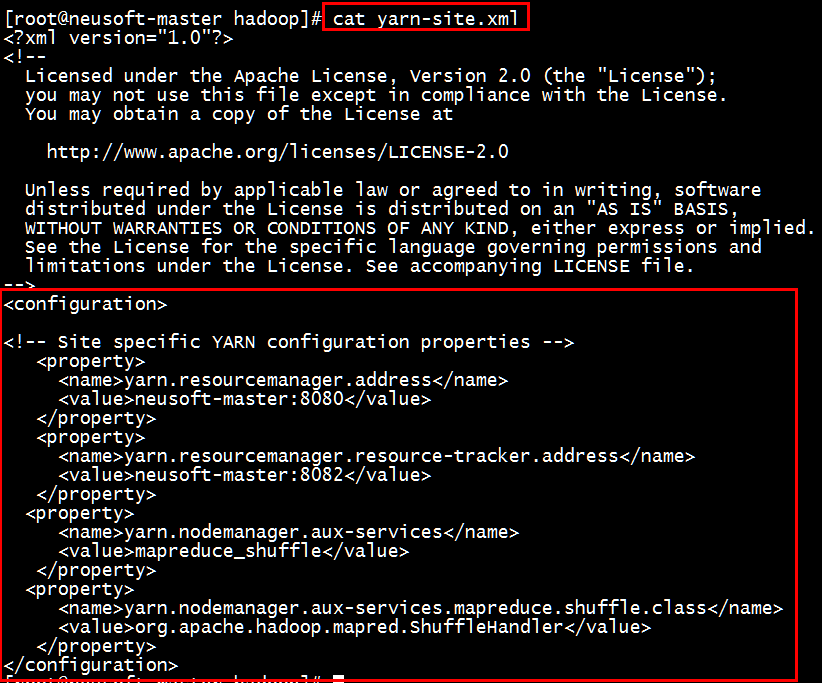

(8)修改 yarn-site.xml

<configuration>

<!-- Site specific YARN configuration properties -->

<property>

<name>yarn.resourcemanager.address</name>

<value>neusoft-master:8080</value>

</property>

<property>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>neusoft-master:8082</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.aux-services.mapreduce.shuffle.class</name>

<value>org.apache.hadoop.mapred.ShuffleHandler</value>

</property>

</configuration>

(9)修改slaves文件,如下指明了主节点同时运行Datanode和Nodemanager

![]()

(10)格式化HDFS

在第一次启动hadoop之前必须先将HDFS格式化

进入bin目录下,执行hadoop namenode -format,按照提示输入Y,格式化成功就会显示格式化成功信息。

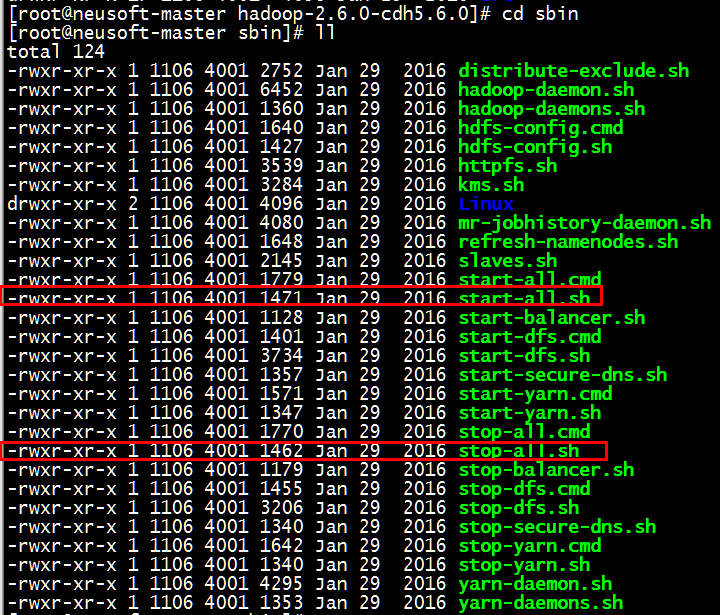

(11)启动Hadoop并验证安装

- 启动Hadoop:如果是非root用户请赋予相应用户执行权限

chmod +x -R /opt/hadoop-2.6.0-cdh5.6.0/sbin

- root用户直接执行启动命令即可:./opt/hadoop-2.6.0-cdh5.6.0/sbin/start-all.sh

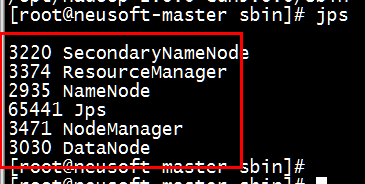

- 执行jps命令查看

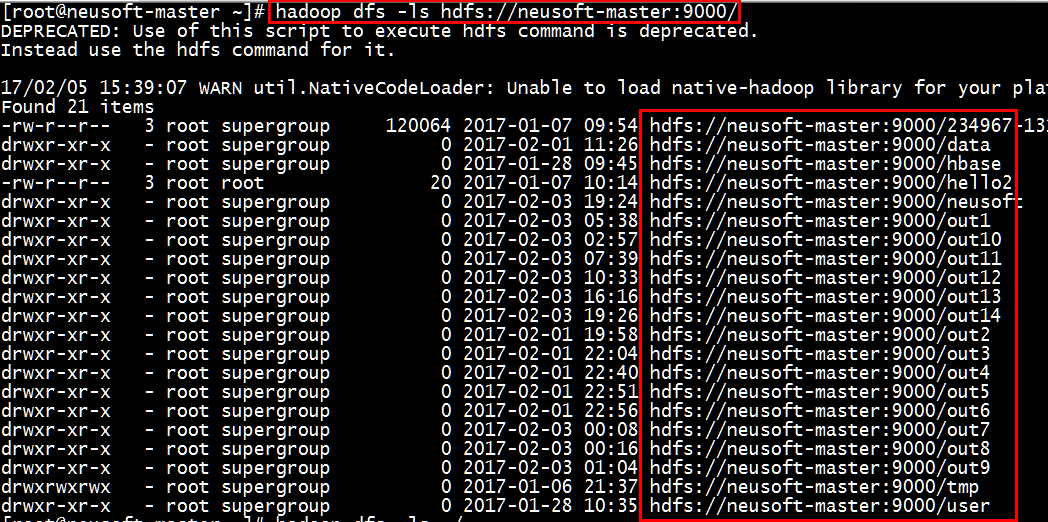

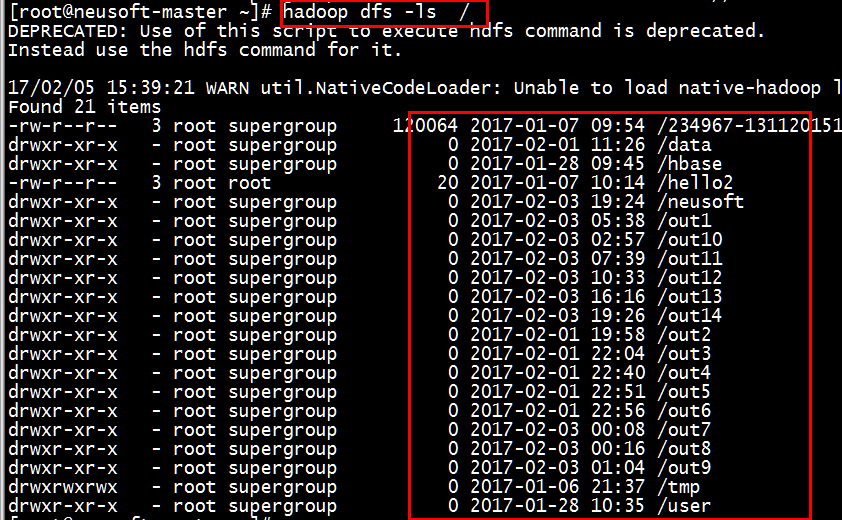

(12)验证安装,执行命令不会有出错信息即可。

[root@neusoft-master ~]# hadoop dfs -ls / [root@neusoft-master ~]# hadoop dfs -ls hdfs://neusoft-master:9000/

注:如果首次安装不会出现下面两个图中的这么多文件,即首次安装不报错即可。

(13)小实验

hadoop dfs -mkdir -p /user/root/input

在linux本地文件系统 /usr/local/filecontent/中创建文件words

vi words

并写入hello you hello me 数据

hadoop dfs -put /usr/local/filecontent/words /user/root/input

hadoop jar /opt/hadoop-2.6.0-cdh5.6.0/share/hadoop/mapreduce2/hadoop-mapreduce-examples-2.6.0-cdh5.6.0.jar wordcount /user/root/input /user/root/output

执行上述三条命令是测试Hadoop自带的测试用例进行测试,之后通过以下命令查看

hadoop dfs -cat /user/root/output/part-r-00000

END~如果对博客的内容有新的见解,请您及时给我留言,我会第一时间解决~