原文地址:https://www.cnblogs.com/pinard/p/6437495.html

上面地址是一篇讲解DNN的文章,其中部分公式推导过程,自己在这里做一些记录,方便以后查阅。

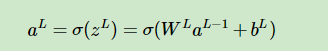

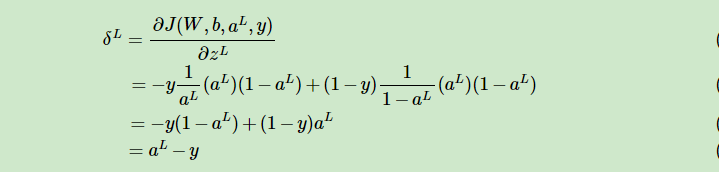

上图公式由下两图公式得来,aL = [ 1/ (1 + e-z) ]对z的求导,用到了sigmoid函数,sigmoid函数求导后的结果 [ e-z / (1 + e-z)2 ],经过转换变成了(aL)(1-aL)。红色部分是巧妙点,所以softmax的交叉熵损失函数可以规避sigmoid函数导数为0的问题,解决了梯度消失问题。