李宏毅教授2017年机器学习心得http://speech.ee.ntu.edu.tw/~tlkagk/courses_ML17.html

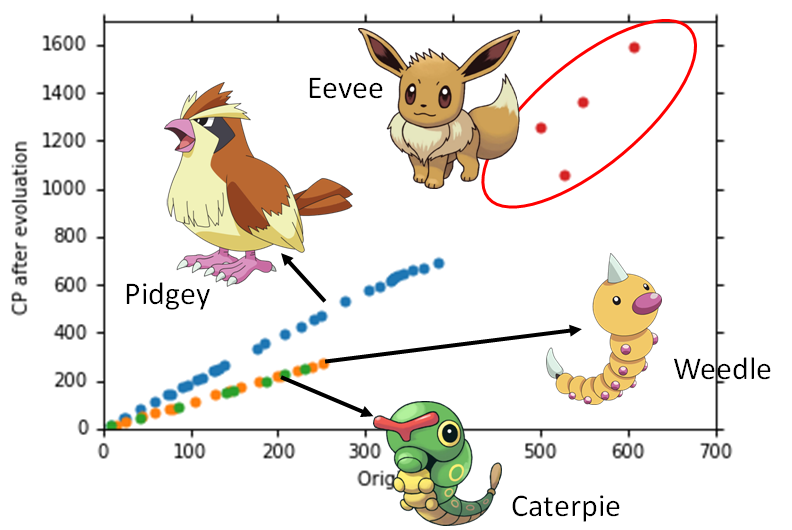

应用示例:神奇宝贝经过进化后的能量值

f(x)=y

x=(xs,xhp,xw,xh) 如Xh表示神奇宝贝的身高Xw表示神奇宝贝的重量Xs表示种类

第一步:建模(model)

版本0:基础版本

找一组函数

b和w可以是任意值

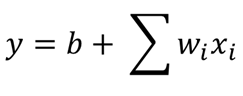

线性模型Linear model:

![]() 是特性feature

是特性feature

![]()

权重 偏倚

版本1:不同种类的神奇宝贝,用不同的线性模型

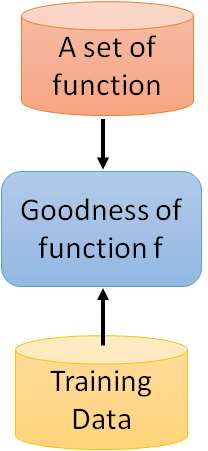

第二步:方法的适用性Goodnessof Function

版本0:基础版本

输入 输出(必须是数值)

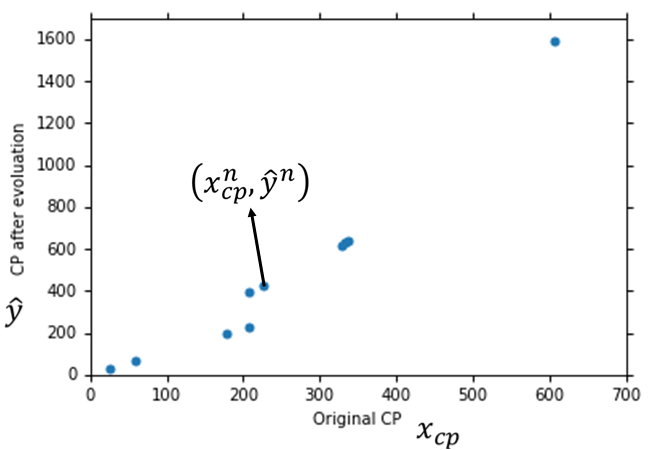

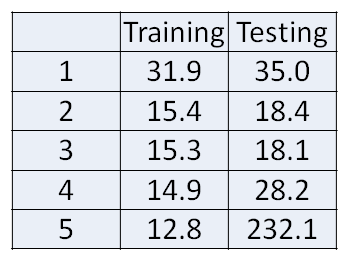

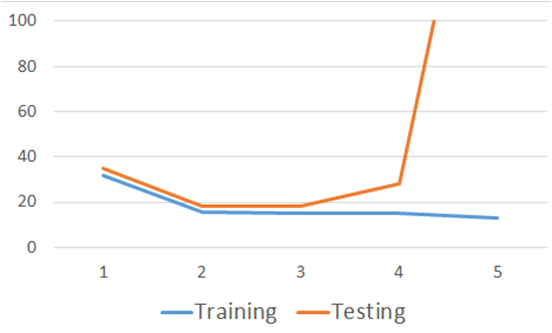

采用以下十组训练数据Training Data

通过函数以及训练数据找到函数的适用性

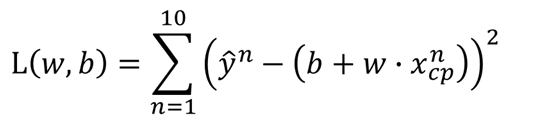

损失函数Loss function

通过损失函数的输出可以知道每一个函数到底有多差

表示实际的进化后的能量值

通过模型预测的进化后的能量值

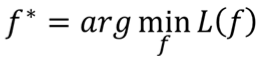

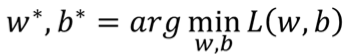

挑选出最优秀的函数,即对应损失函数输出值最小的函数

版本1:规则化regularization

修改损失函数

第三步:梯度下降法 GradientDescent

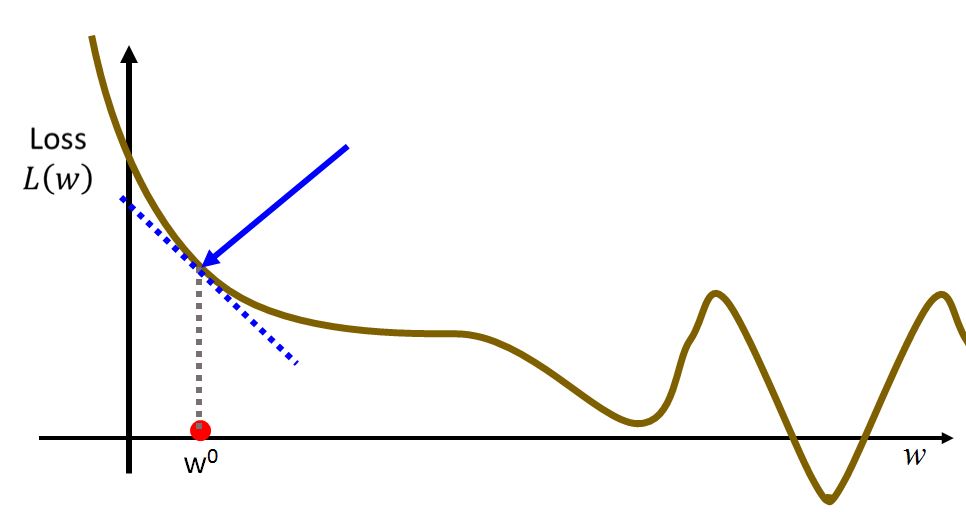

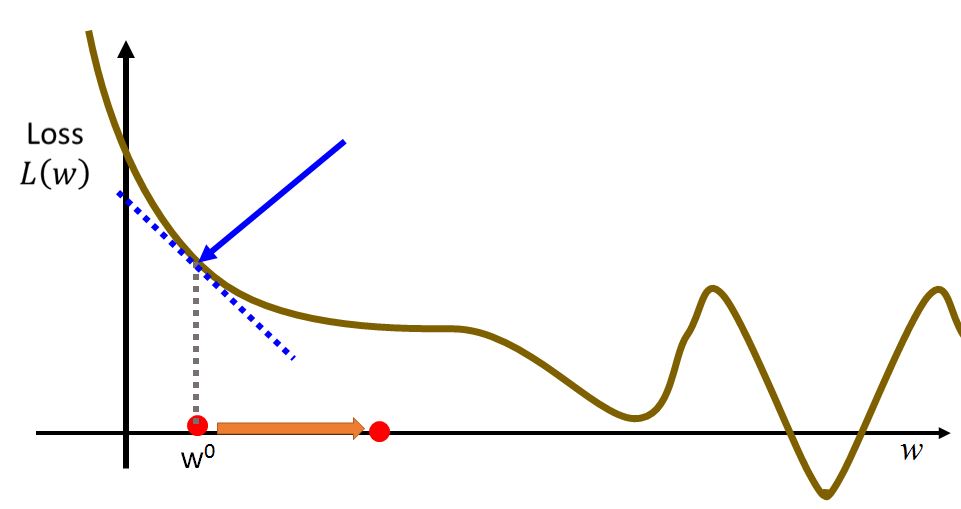

case1:假定损失函数L(w)只有参数w

1、随机选择![]()

2、计算此处的导数值

如果为正 向x轴负方向

如果为负 向x轴正方向

3、

反复迭代

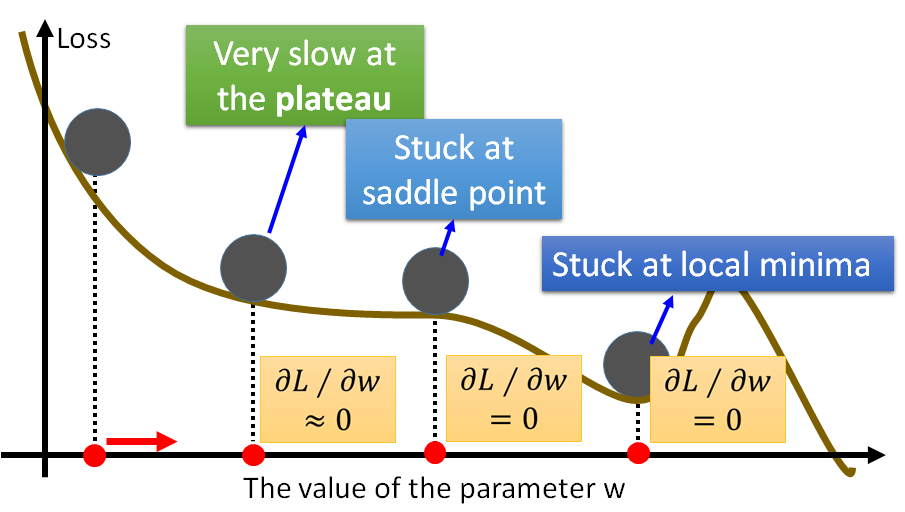

问题1:我们得到的结果并非全局最小值,而是局部最小值WT

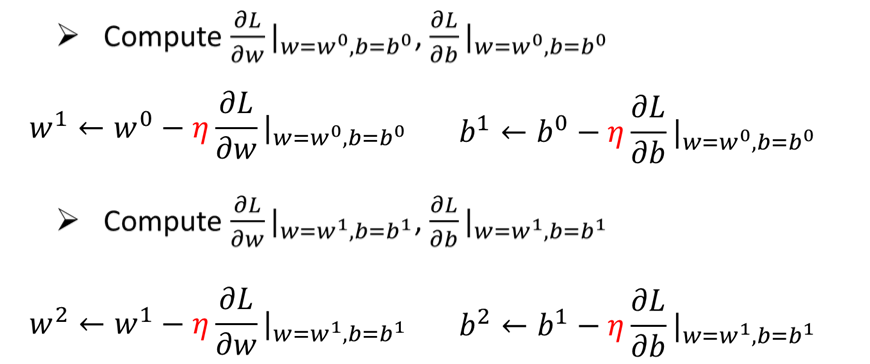

case2:假定损失函数L(w,b)有两个参数w和b

1、随机选择![]()

2、计算此处的偏导值

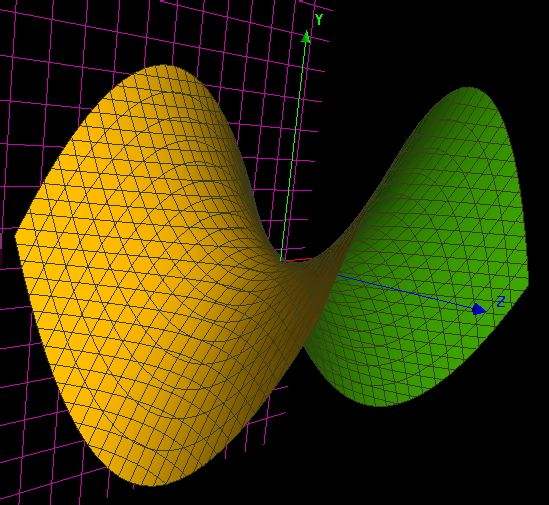

问题2:我们得到的结果并非全局最小值,而是鞍点

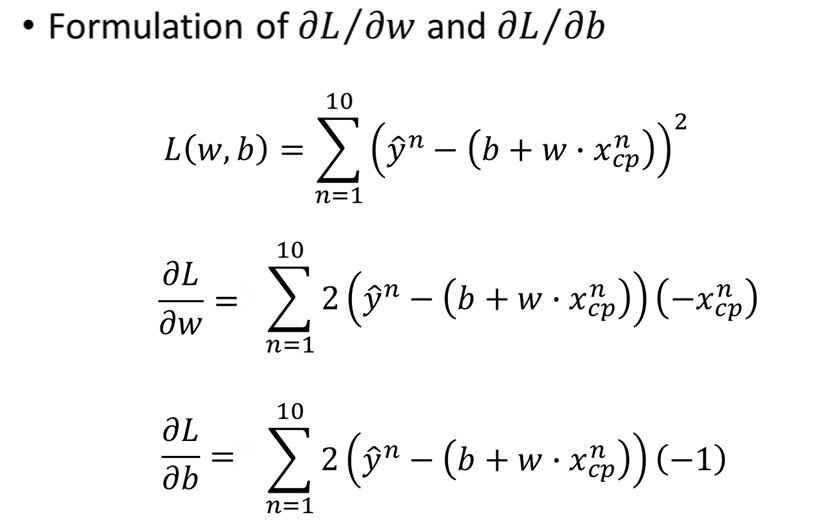

偏导的计算:

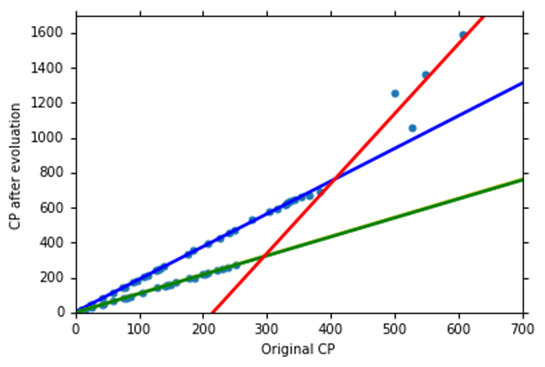

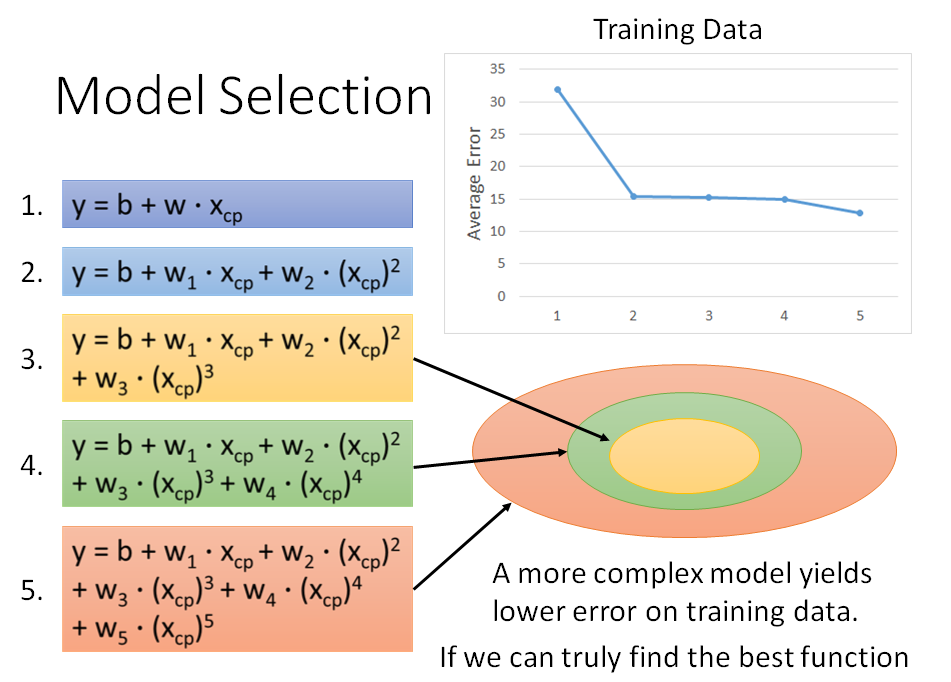

模型的选择:

针对训练数据的损失函数值来说,模型越复杂,即次数越高,其值越低,即效果越好,因为公式2相当于公式3的子集,当公式3的参数w3=0

过拟合overfitting:越复杂的模型未必在测试数据上产生更好的效果

日常学习之余,我还是七月在线https://www.julyedu.com的校园大使

所以,您联系我可以获得各种优惠券,享受优惠。