转载:https://www.cnblogs.com/heguanyou/p/7688344.html

目录

最大似然估计

Laplace分布

Laplace先验导出L1正则化

Gauss先验导出L2正则化

Laplace(拉普拉斯)先验与L1正则化

在之前的一篇博客中L1正则化及其推导推导证明了L1正则化是如何使参数稀疏化人,并且提到过L1正则化如果从贝叶斯的观点看来是Laplace先验,事实上如果从贝叶斯的观点,所有的正则化都是来自于对参数分布的先验。现在来看一下为什么Laplace先验会导出L1正则化,也顺便证明Gauss(高斯)先验会导出L2正则化。

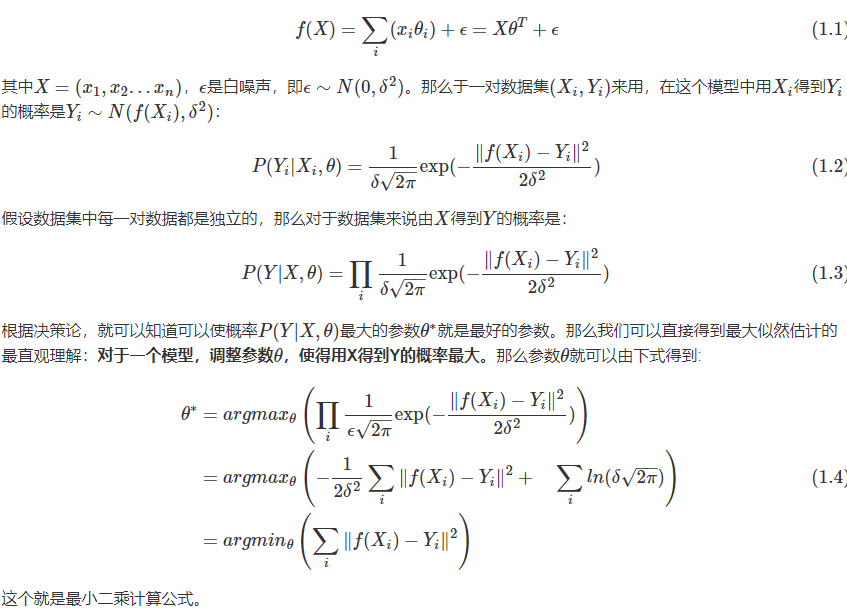

最大似然估计

很多人对最大似然估计不明白,用最简单的线性回归的例子来说:如果有数据集(X,Y),并且Y是有白噪声(就是与测量得到的Y与真实的Yreal有均值为零的高斯分布误差),目的是用新产生的X来得到Y。如果用线性模型来测量,那么有:

Laplace分布

Laplace概率密度函数分布为:

分布的图像如下所示:

图1 Laplace分布

可以看到Laplace分布集中在μ附近,而且b越小,数据的分布就越集中。

Laplace先验导出L1正则化

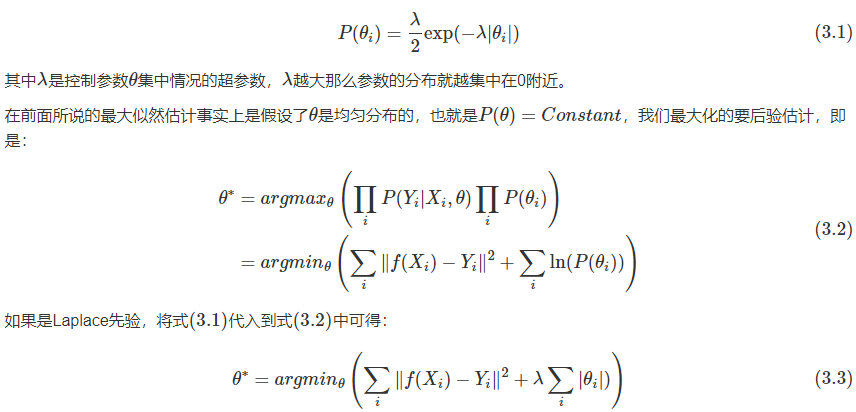

先验的意思是对一种未知的东西的假设,比如说我们看到一个正方体的骰子,那么我们会假设他的各个面朝上的概率都是1/6,这个就是先验。但事实上骰子的材质可能是密度不均的,所以还要从数据集中学习到更接近现实情况的概率。同样,在机器学习中,我们会根据一些已知的知识对参数的分布进行一定的假设,这个就是先验。有先验的好处就是可以在较小的数据集中有良好的泛化性能,当然这是在先验分布是接近真实分布的情况下得到的了,从信息论的角度看,向系统加入了正确先验这个信息,肯定会提高系统的性能。我们假设参数θ是如下的Laplace分布的,这就是Laplace先验:

这就是由Laplace导出L1正则化,我在之前的一篇博客中L1正则化及其推导分析过λ越大,那么参数的分布就越集中在0附近,这个与Laplace先验的分析是一致的。

Gauss先验导出L2正则化

到这里,我们可以很轻易地导出L2正则化,假设参数θ的分布是符合以下的高斯分布: