第六讲、降维

1.特征值分解

设A是n阶方阵,如果有常数入和n维非零列向量α的关系式: Aα = λα 成立,则称λ为方阵A的特征值,非零向量α称为方阵A 的对应于特征值入的特征向量。

2.降维简介

降维(dimensionality reduction) :将数据的特征数量从高维转换到低维;

①实际中很多数据是高维的,但数据"内在的维度"可能更低 通信数据原始有7维:入网时间、套餐价格、每月话费,每月流量、每月通话时长欠费金 额、欠费月数; "内在维度"可能只有3个:用户忠诚度、消费能力、欠费指数。

②解决高维数据的维度灾难问题的一种手段; ③能够作为一种特征抽取的方法; ④便于对数据进行可视化分析;

3.主成分分析

在人脸识别和图像压缩等领域得到了广泛的应用;

基本思想:构造原始特征的一系列线性组合形成的线性无关低维特征,以去除数据的相关性,并使降维后的数据最大程度地保持原始高维数据的方差信息。

①数据集表示

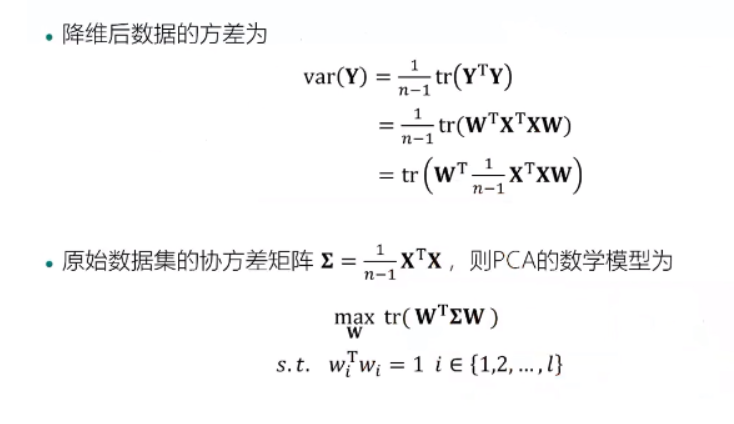

②优化目标

③模型求解

④算法流程

⑤方差比例与数据重构

4.自编码器

定义:—种特殊的神经网络,尝试将输入复制到输出,能够表示非线性变换。

解码器:将隐含表示h转换成输出x';

优化目标:使得x'和x尽量接近;

当隐含层神经元数量小于输入层时,可以当做—种降维算法.

深层自编码器:

指数级地降低表示某些函数的计算成本; 指数级地减少学习某些函数所需的训练数据量; —些实验结果表明,深层自编码器比浅自编码器产生更好的压缩效果。