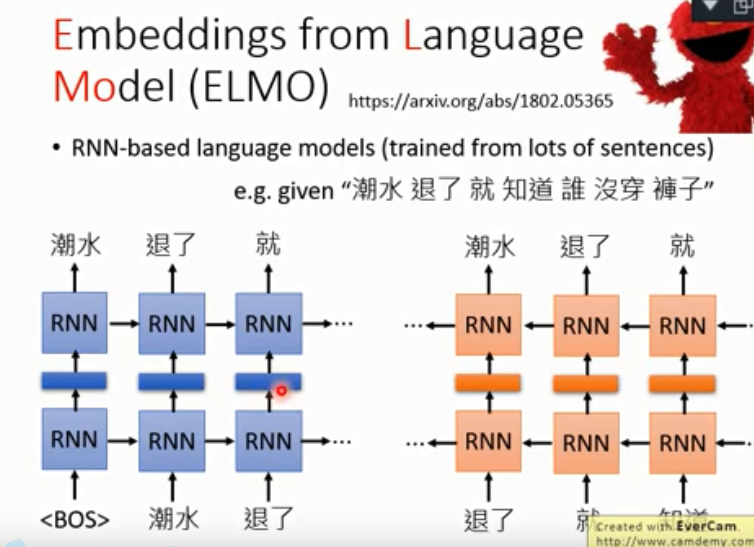

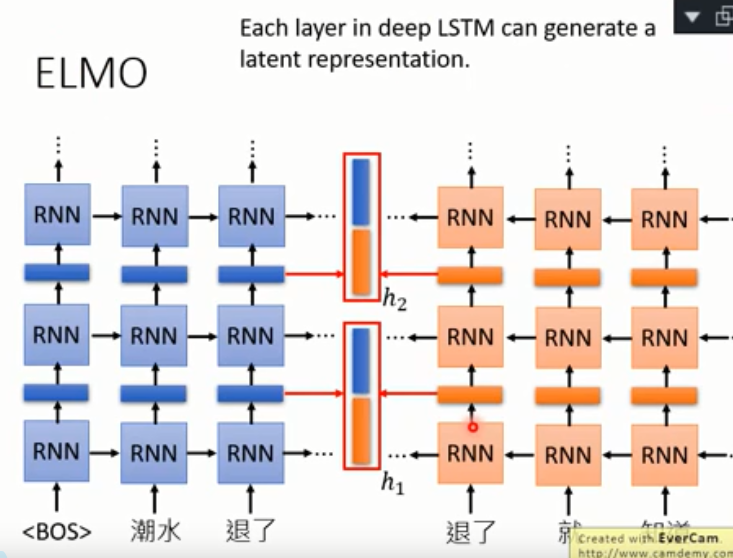

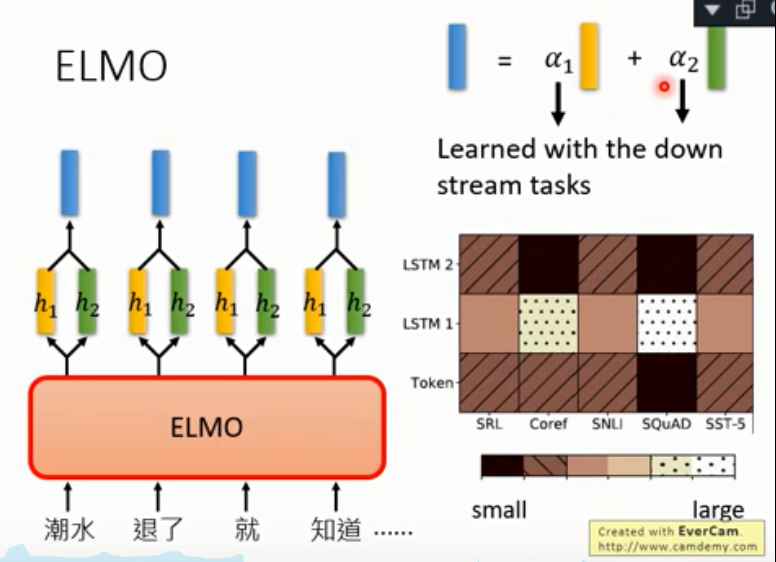

1. ELMO

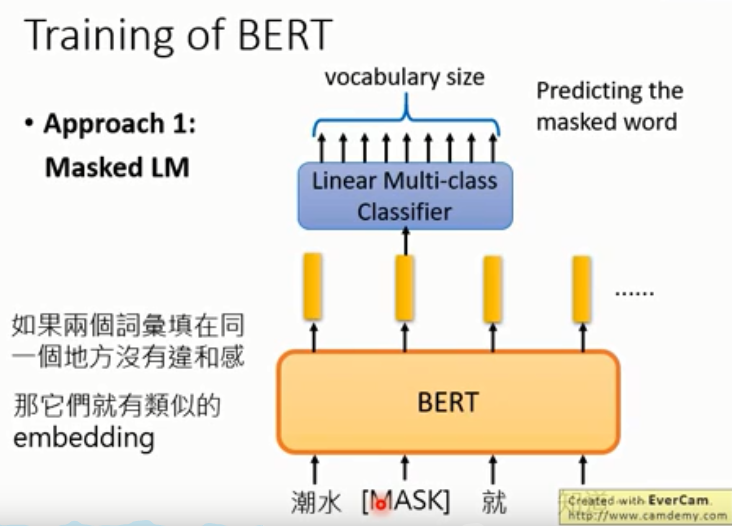

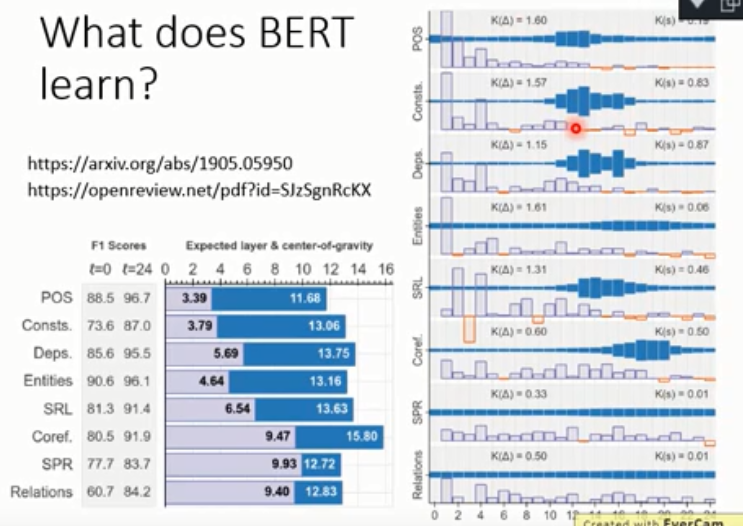

2. BERT

-

就是Transformer的Encoder部分:输入input,输出embedding

-

如果处理中文,用 字 作为单位 (潮水--词,潮--字)

2.1 预测Masked word

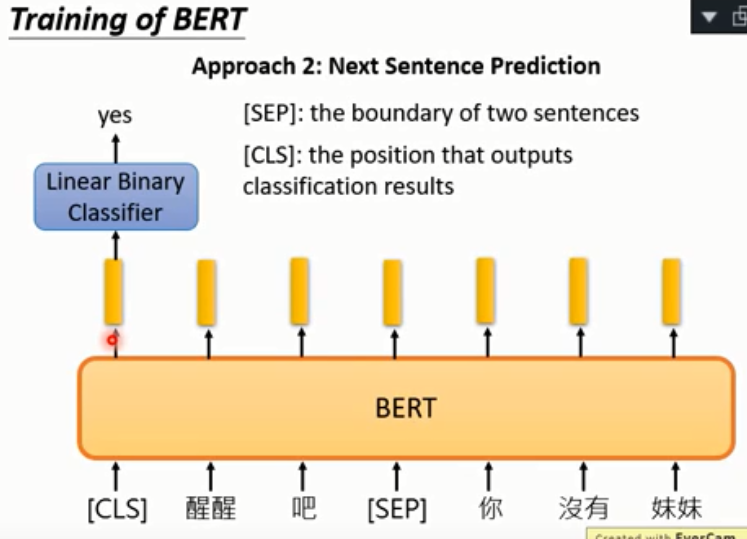

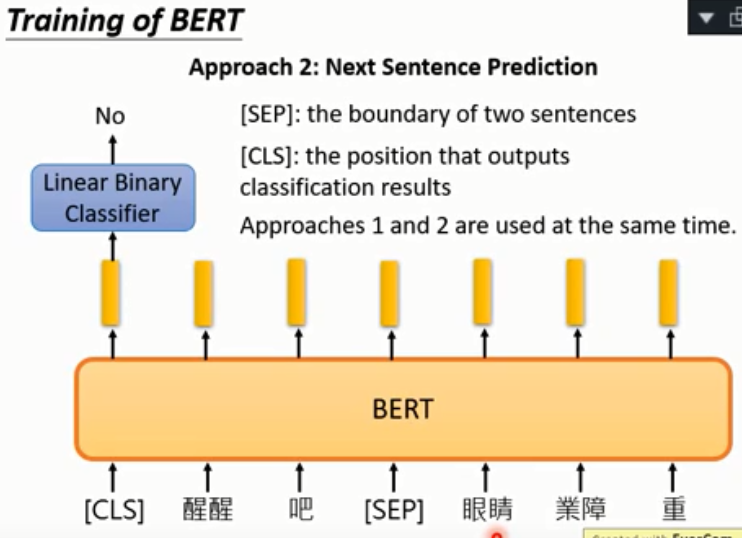

2.2 [SEP] 和 [CLS]

-

[SEP]:两个句子的 边界

-

[CLS]:输出 分类结果 的 位置,输出:[SEP]左右两个句子是否应该接在一起

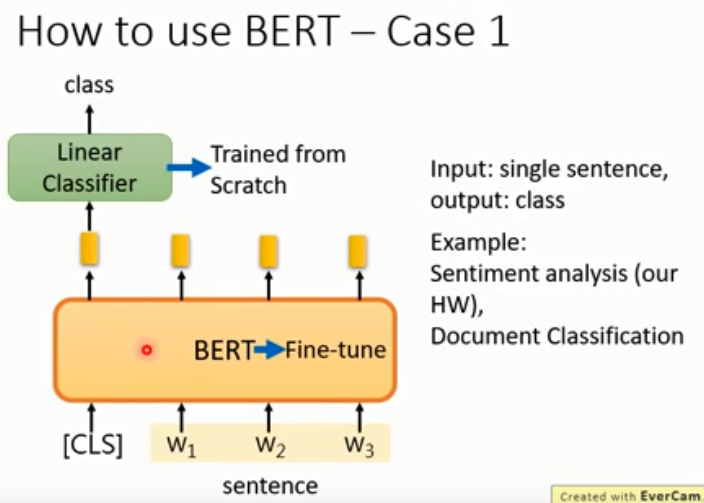

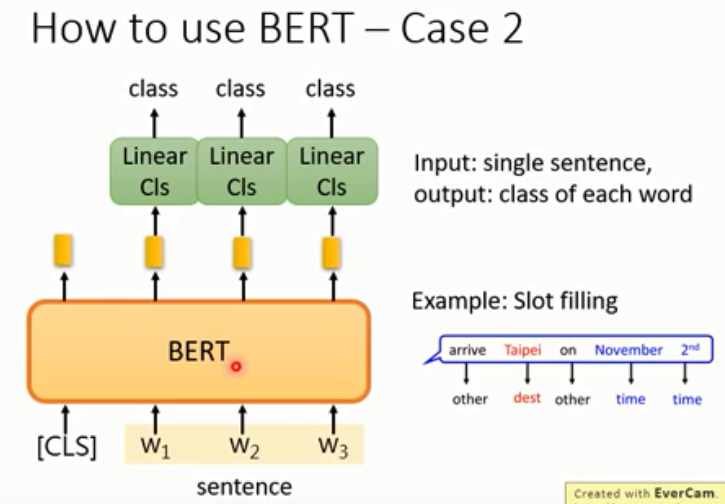

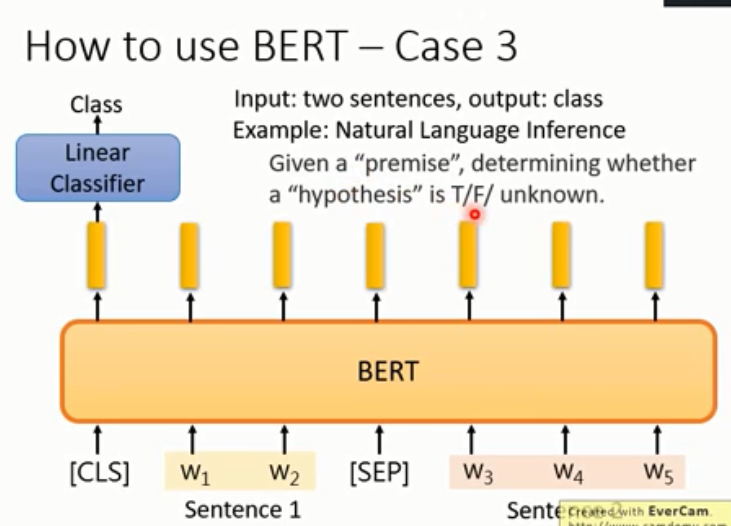

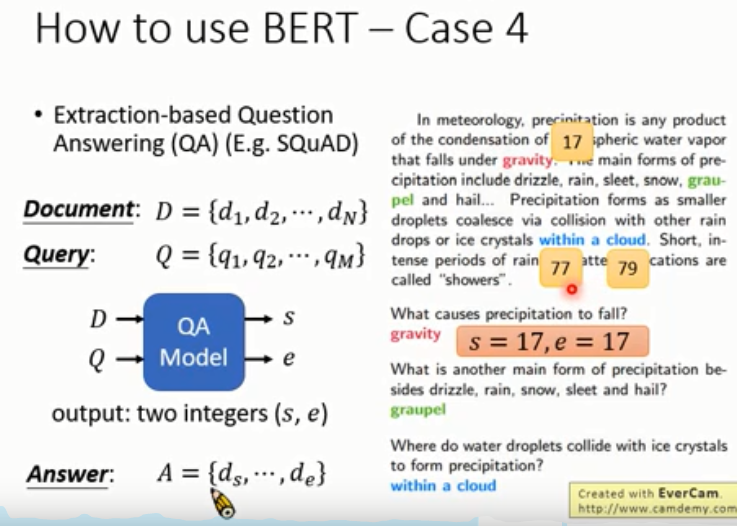

2.3 如何使用BERT

- Case 1:句子的情感分类

- Case 2:句子的单词分类

- Case 3:由前提推测假设对/错

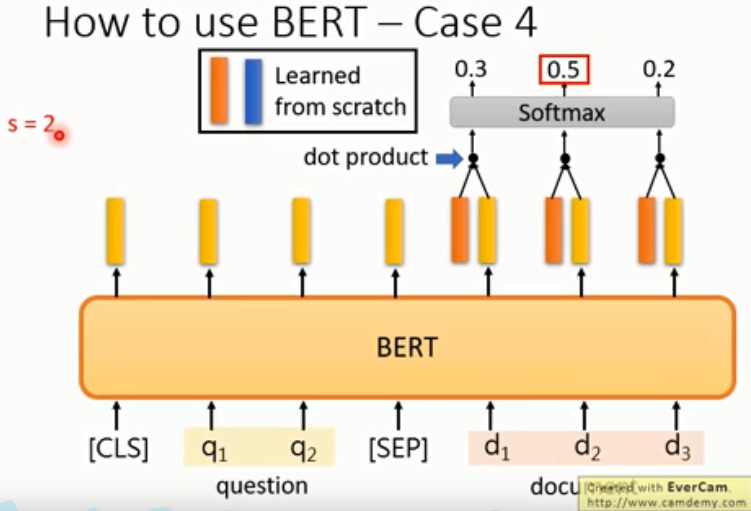

- Case 4:Extrac tion-based Question(输入文章,回答问题)

(答案从 (d_s) 个位置到 (d_e) 个位置的token)

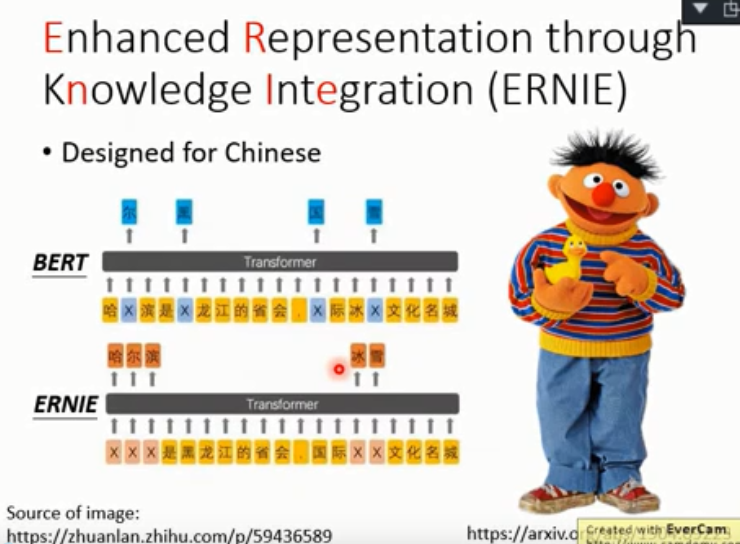

3. ERNIE

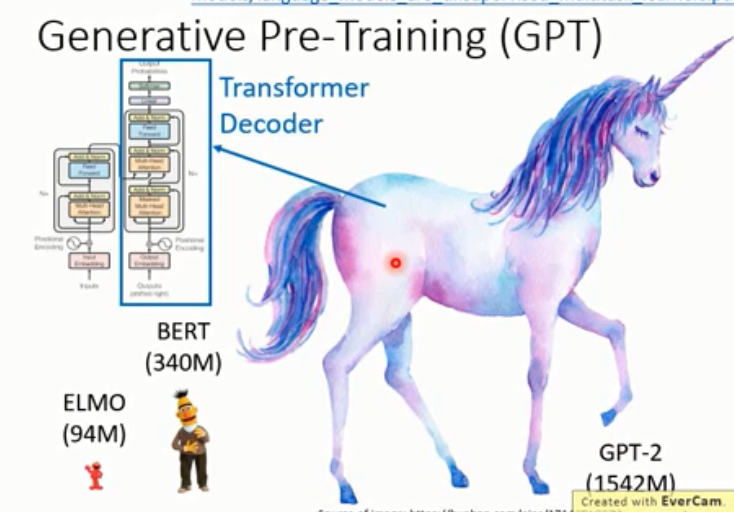

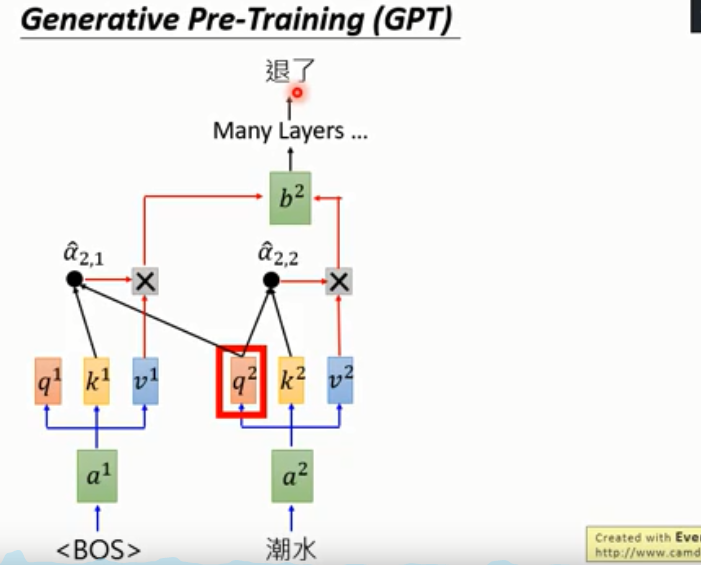

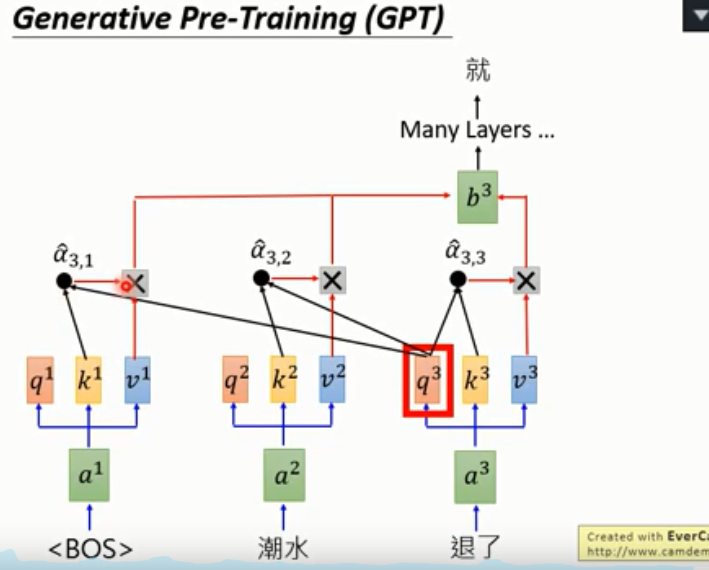

4. GPT

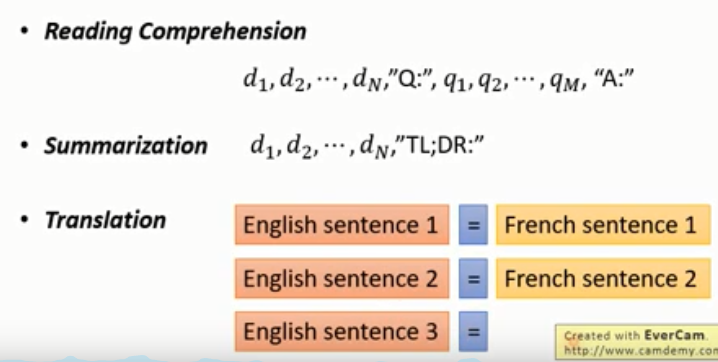

在完全没有资料的情况下,做到下列:

-

Reading Comprehension

-

Summarization

-

Translation