之前对bert轻量化,显存占用减少一半。但是推理速度仍然没多大变化。因此 计划通过tensorRT完成模型的推理加速。

轻量化之前链接: https://www.cnblogs.com/dhName/p/12628828.html

脑残级教程:

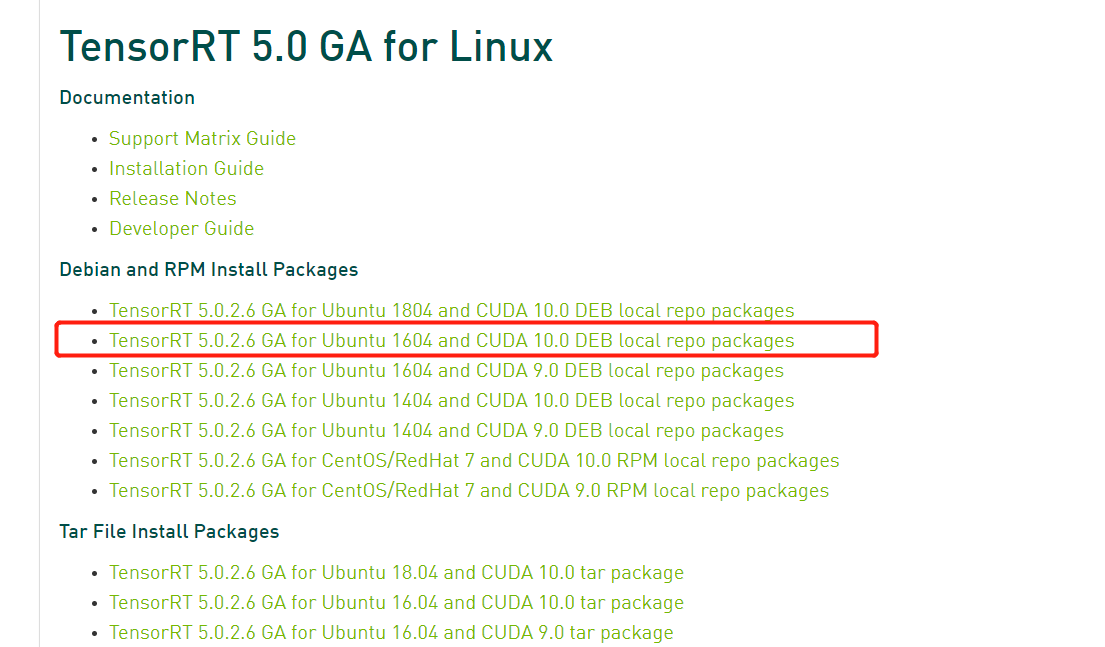

1. 官网 https://developer.nvidia.com/nvidia-tensorrt-5x-download

找到对应的unbuntu版本和cuda版本

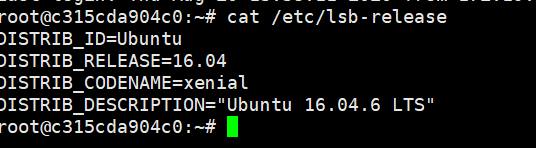

unbuntu 版本查看 : cat /etc/lsb-release

cuda版本: nvidia-smi

那么我只需要下载